Corso

I framework per agenti di IA autonomi sono pensati per sistemi che ragionano attraverso compiti multi-step, selezionano strumenti in modo indipendente ed eseguono azioni per conto degli utenti con minore intervento manuale. SuperAGI lo implementa tramite un loop in stile ReAct e un livello di orchestrazione con priorità alla GUI.

SuperAGI è uno dei primi framework open source progettati specificamente per questo scopo. Offre agli sviluppatori una piattaforma per creare, gestire ed eseguire agenti di IA orientati agli obiettivi tramite una GUI web, con monitoraggio integrato, un marketplace di strumenti e supporto per vari modelli linguistici di grandi dimensioni (LLM).

In questa guida, spiegherò cos’è SuperAGI, illustrerò la sua architettura e le sue funzionalità, ti mostrerò come installarlo con Docker e lo confronterò con AutoGPT e LangChain. Tratterò anche punti di forza, limiti e se sia adatto all’uso in produzione.

Una nota importante prima di iniziare: SuperAGI come framework open source e SuperAGI come azienda non coincidono più. L’azienda è passata a un prodotto SaaS commerciale focalizzato su strumenti di vendita basati sull’IA e il repository open source ha visto un’attività minima dal 2024. Questo articolo si concentra sul framework open source. Tratterò lo stato attuale della manutenzione lungo l’articolo, così da permetterti di decidere consapevolmente se usarlo o meno.

Cos’è SuperAGI?

SuperAGI è un framework open source per agenti di IA autonomi, orientato agli sviluppatori e con licenza MIT. Creato da TransformerOptimus, ha accumulato migliaia di stelle su GitHub e oltre 2.000 fork dal suo lancio nel 2023. Il progetto è scritto principalmente in Python (circa il 70%) con JavaScript per il frontend (circa il 25%).

L’idea di base è questa: SuperAGI non è un modello in sé. È il livello di orchestrazione tra te, un LLM e gli strumenti che vuoi far usare all’agente. Definisci gli obiettivi per il tuo agente, gli assegni strumenti (come ricerca web, gestione file o integrazione con GitHub), scegli un provider LLM, e poi l’agente ragiona autonomamente sul compito, sceglie lo strumento giusto a ogni passo e itera finché non completa l’obiettivo o raggiunge il limite di iterazioni.

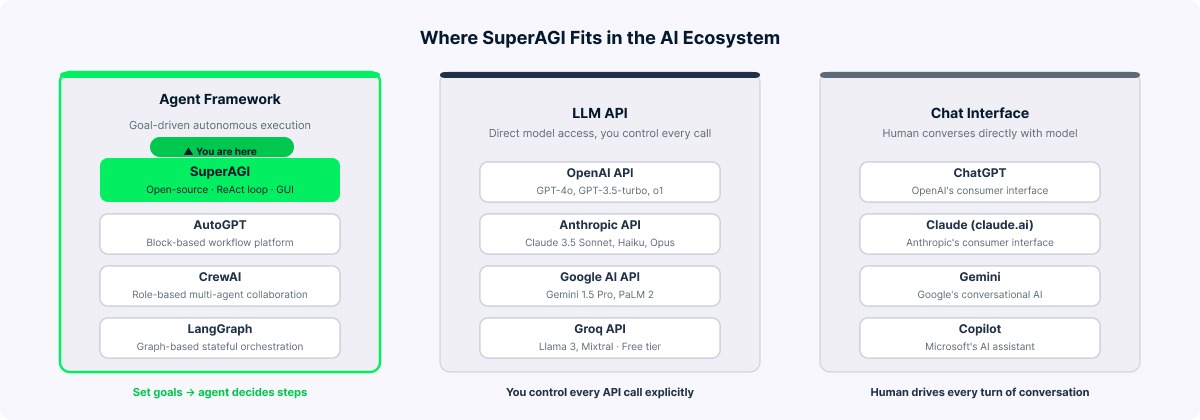

Tre cose da capire subito su dove si colloca SuperAGI nell’ecosistema.

Un framework per agenti (come SuperAGI, AutoGPT o CrewAI) orchestra l’esecuzione autonoma di compiti usando LLM combinati con strumenti. Un’API LLM (come l’API di OpenAI o quella di Anthropic) fornisce accesso grezzo al modello per la generazione di testo e controlli ogni chiamata. Un’interfaccia chat (come ChatGPT o Claude) è un wrapper conversazionale rivolto all’utente, dove le persone interagiscono direttamente con il modello.

SuperAGI opera a livello di framework. Tu imposti gli obiettivi e l’agente decide cosa fare. Questo è fondamentalmente diverso sia dal chattare con un modello sia dal fare chiamate API dirette.

SuperAGI spiegato come framework per agenti. Immagine dell’autore.

Funzionalità principali di SuperAGI

Ora che sai cos’è SuperAGI e in cosa differisce da strumenti più semplici, ecco cosa offre sotto il cofano.

-

Agenti autonomi. Fornisci agenti con obiettivi, istruzioni, strumenti e vincoli specifici. Esistono tre tipi di agente: Default (singolo ciclo pensa-esegui), Fixed Task Queue (scompone gli obiettivi in sotto-attività ordinate) e Dynamic Task Queue (l’agente può aggiungere nuove attività durante l’esecuzione man mano che individua requisiti).

-

Sistema di integrazione degli strumenti. SuperAGI include un ampio set di toolkit integrati, tra cui Google Search, DuckDuckGo, Web Scraper, File Manager, GitHub, Jira, Twitter, Notion, Google Calendar, DALL-E, un Coding Toolkit e uno strumento di Knowledge Search basato su database vettoriali. Toolkit forniti dalla community per servizi come Slack, Instagram o altri servizi di generazione immagini possono essere disponibili a seconda della configurazione specifica. Tratterò l’integrazione degli strumenti più avanti.

-

GUI web-based. Un’interfaccia Next.js accessibile su

localhost:3000offre creazione agenti, assegnazione strumenti, feed attività in tempo reale, configurazione dei provider di modelli, pianificazione agenti e navigazione nel marketplace. -

Agent Performance Monitoring (APM). Introdotta nella versione 0.0.8, la dashboard APM è uno dei veri elementi distintivi di SuperAGI. Fornisce metriche a livello di organizzazione (agenti totali, token consumati, esecuzioni totali), ripartizioni per modello (agenti, esecuzioni e token per LLM) e analisi a livello di agente (token medi per esecuzione, chiamate API totali e runtime). Le schede metriche riordinabili consentono di personalizzare il layout della dashboard.

-

Orchestrazione multi-agente. Puoi eseguire più agenti in parallelo, ognuno configurato con obiettivi, strumenti e modelli LLM differenti, tutti gestiti tramite la GUI unificata.

-

Action Console. È la funzionalità human-in-the-loop. In modalità con permessi ristretti, gli agenti si fermano prima di eseguire azioni critiche (come inviare email o scrivere file) e attendono la tua approvazione tramite l’Action Console. Questo offre un controllo di sicurezza per le operazioni sensibili.

-

Supporto per database vettoriali. SuperAGI supporta Weaviate, Pinecone e Qdrant per la memoria a lungo termine tramite embedding vettoriali. Il contesto a breve termine è mantenuto all’interno dell’esecuzione dell’agente, mentre la conoscenza a lungo termine persiste tra le esecuzioni nel database vettoriale.

-

Marketplace. Un marketplace guidato dalla community ospita strumenti, toolkit, template di agenti, embedding di conoscenza e modelli. Puoi esplorare e installare direttamente dalla GUI.

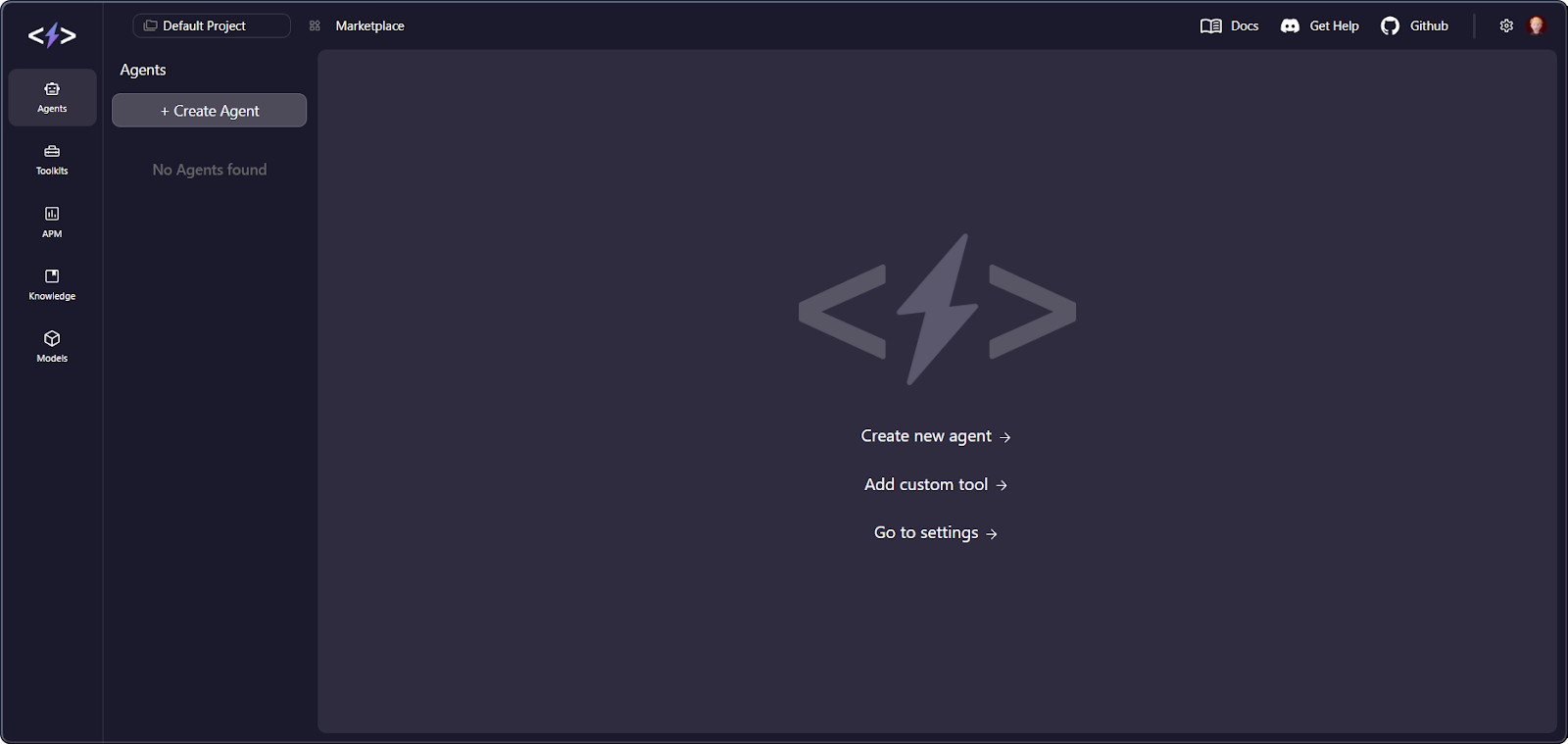

Dashboard principale di SuperAGI con metriche APM. Immagine dell’autore.

Come funziona SuperAGI: panoramica dell’architettura

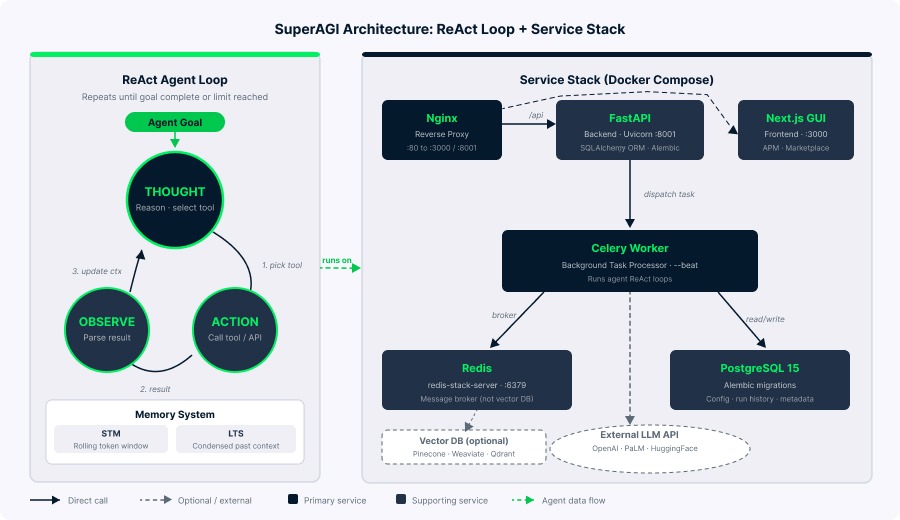

Un’idea sbagliata comune in articoli di terze parti è che SuperAGI usi un loop “pianifica, esegui, rifletti, itera”. Questa formulazione è diffusa, ma l’implementazione assomiglia di più al pattern ReAct (Reason + Act). SuperAGI implementa un loop Pensiero → Azione → Osservazione, in cui l’agente riflette sullo stato attuale, sceglie uno strumento, osserva il risultato e ripete. ReAct è un pattern di agente in cui il modello alterna passaggi di ragionamento (“Pensiero”) e chiamate a strumenti (“Azione”), guidato dalle osservazioni.

Lo stack tecnologico, verificato dal file docker-compose.yaml e dal codice sorte, è così composto:

|

Componente |

Tecnologia |

|

Web framework |

FastAPI |

|

Coda attività |

Celery |

|

Message broker |

Redis (redis-stack-server) |

|

Database |

PostgreSQL 15 |

|

ORM |

SQLAlchemy |

|

Migrazioni |

Alembic |

|

Frontend |

Next.js |

|

Reverse proxy |

Nginx |

|

Linguaggio |

Python |

Il backend usa Uvicorn sulla porta 8001, con Nginx che inoltra /api al backend e tutti gli altri percorsi alla GUI Next.js. Celery gestisce l’elaborazione dei task in background con --beat per le operazioni pianificate. PostgreSQL archivia configurazioni degli agenti, cronologia delle esecuzioni e metadati. Nella configurazione predefinita, Redis funge principalmente da message broker per Celery, non da database vettoriale, contrariamente ad alcune affermazioni di terze parti.

Per la memoria, SuperAGI usa un sistema in due parti. La memoria a breve termine (STM) è una finestra scorrevole basata sul limite di token dell’LLM, mentre il riepilogo a lungo termine (LTS) è un sommario condensato del contesto al di fuori della finestra STM. Insieme, formano l’Agent Summary che alimenta ogni passaggio di ragionamento. I database vettoriali gestiscono separatamente gli embedding di conoscenza.

Architettura di SuperAGI con loop agente ReAct. Immagine dell’autore.

Configurare SuperAGI

Prima di iniziare, assicurati di avere Docker Desktop, Git e l’accesso ad almeno un provider LLM supportato (per esempio una chiave API OpenAI). Aspettati che l’intero stack utilizzi circa 3–4 GB di RAM. Se usi Windows, ti servirà anche WSL2 abilitato.

Installa SuperAGI con Docker

Docker è il metodo di installazione consigliato e più affidabile. Il processo si articola in alcuni passaggi chiari.

Clona e configura

Ecco i passaggi:

# Clone the repository

git clone https://github.com/TransformerOptimus/SuperAGI.git

# Navigate into the project directory

cd SuperAGI

# Copy the configuration template

cp config_template.yaml config.yamlApri config.yaml in un editor di testo e configura il tuo provider LLM. Per OpenAI, imposta OPENAI_API_KEY. Inserisci le chiavi senza virgolette o spazi extra:

# LLM Provider (choose one or more)

OPENAI_API_KEY: sk-your-openai-key-here

# PALM_API_KEY: your-palm-key-here

# HUGGING_FACE_API_KEY: your-hf-key-here

# Optional: for Google Search tool

GOOGLE_API_KEY: your-google-key

SEARCH_ENGINE_ID: your-cse-id

# Optional: for Pinecone vector DB

PINECONE_API_KEY: your-pinecone-keyCompila e avvia i container

Ora crea e avvia i container:

# Build and start all services

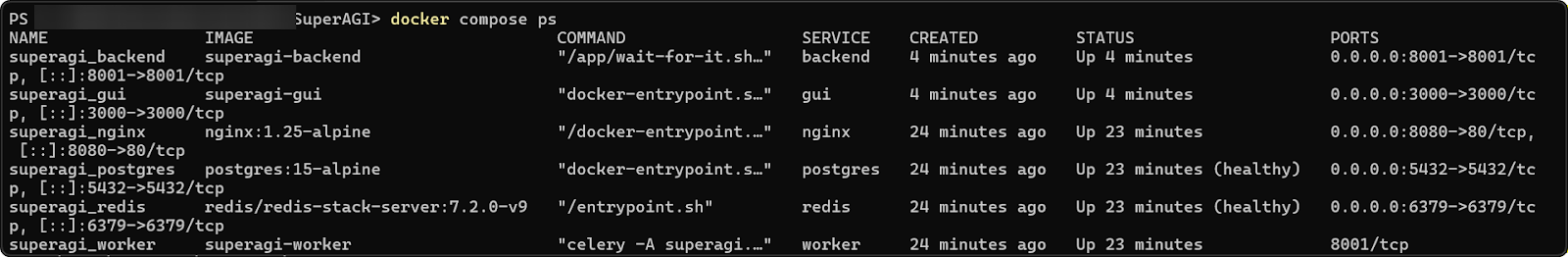

docker compose -f docker-compose.yaml up --buildLa compilazione iniziale richiede circa 10–15 minuti. Una volta che tutti e sei i container sono in esecuzione (backend, celery, gui, redis, postgres e nginx), apri http://localhost:3000 nel browser (la porta predefinita configurata nel file compose per la GUI tramite Nginx).

Container Docker di SuperAGI compilati con successo. Immagine dell’autore.

Verifica l’installazione

Per verificare che tutto funzioni, esegui docker compose ps e conferma che tutti e sei i container siano elencati. Poi vai su localhost:3000, apri Settings e verifica che la configurazione della tua API key sia rilevata.

Problemi comuni e soluzioni

Il repository ufficiale presenta alcuni problemi noti che potresti incontrare. Ecco i più comuni e come risolverli.

Demone Docker non in esecuzione: assicurati che Docker Desktop sia attivo prima di eseguire i comandi compose.

Errore Celery “Unable to load application”: verifica che il file si chiami esattamente config.yaml e non config_template.yaml, poi ricompila con docker compose down && docker compose up --build.

Errore chiave di cifratura: se vedi ValueError: Encryption key must be 32 bytes long, assicurati che ENCRYPTION_KEY in config.yaml sia lungo esattamente 32 caratteri e racchiuso tra virgolette:

ENCRYPTION_KEY: "abcdefghijklmnopqrstuvwxyz123456"

JWT_SECRET_KEY: "your-jwt-secret-key-change-this"JavaScript heap out of memory (container GUI): se la GUI non si compila, il container Next.js necessita di più memoria. Aggiungi questo al servizio gui in docker-compose.yaml:

gui:

environment:

NODE_OPTIONS: "--max-old-space-size=1024"

deploy:

resources:

limits:

memory: 1gPermesso negato sulla porta 80 (Windows): Windows richiede privilegi di amministratore per la porta 80. Modifica il mapping delle porte di Nginx in docker-compose.yaml:

nginx:

ports:

- "8080:80" # Access via localhost:8080 insteadErrore di formato URL Redis: se vedi ValueError: invalid literal for int() relativo a Redis, rimuovi il prefisso redis:// da REDIS_URL in config.yaml:

REDIS_URL: "redis:6379" # Not redis://redis:6379/0Loop di riavvio del container backend: se il backend continua a riavviarsi senza log di errore, potrebbe mancare il comando di avvio. Verifica che docker-compose.yaml includa un entrypoint corretto.

Conflitti di porta: se la porta 3000 o 8080 è già in uso, modifica i mapping delle porte in docker-compose.yaml per usarne di diverse.

Supporto GPU

Per il supporto LLM locali con accelerazione GPU (aggiunto nella v0.0.14), usa il file compose separato:

docker compose -f docker-compose-gpu.yml up --buildQuesto richiede una GPU NVIDIA con NVIDIA Container Toolkit configurato per il runtime GPU di Docker.

Installa SuperAGI manualmente (setup sviluppatore)

Questo metodo non è ufficialmente consigliato ma funziona per sviluppo e debugging. Dovrai configurare backend e frontend separatamente.

Setup backend

# Clone and enter the directory

git clone https://github.com/TransformerOptimus/SuperAGI.git

cd SuperAGI

# Create and activate a virtual environment

pip install virtualenv

virtualenv venv

source venv/bin/activate # Windows: venv\Scripts\activate

# Install Python dependencies

pip install -r requirements.txt

# Copy and edit config

cp config_template.yaml config.yaml

# Edit config.yaml: set POSTGRES_URL to localhost, REDIS_URL to localhost:6379

# Start the backend

./run.sh # Windows: .\run.batTieni presente che le dipendenze Python sono bloccate a versioni più vecchie (openai==0.27.7, FastAPI==0.95.2), il che può causare conflitti in ambienti moderni. L’isolamento in un ambiente virtuale è essenziale.

Setup frontend

Per il frontend, vai su ./gui ed esegui npm install && npm run dev. Devi creare manualmente un database PostgreSQL chiamato super_agi_main con utente superagi e password password. Ti serve anche Redis in esecuzione separatamente.

Creare e gestire agenti in SuperAGI

Ora che hai installato SuperAGI, vediamo come creare ed eseguire il tuo primo agente.

Configurazione dell’agente

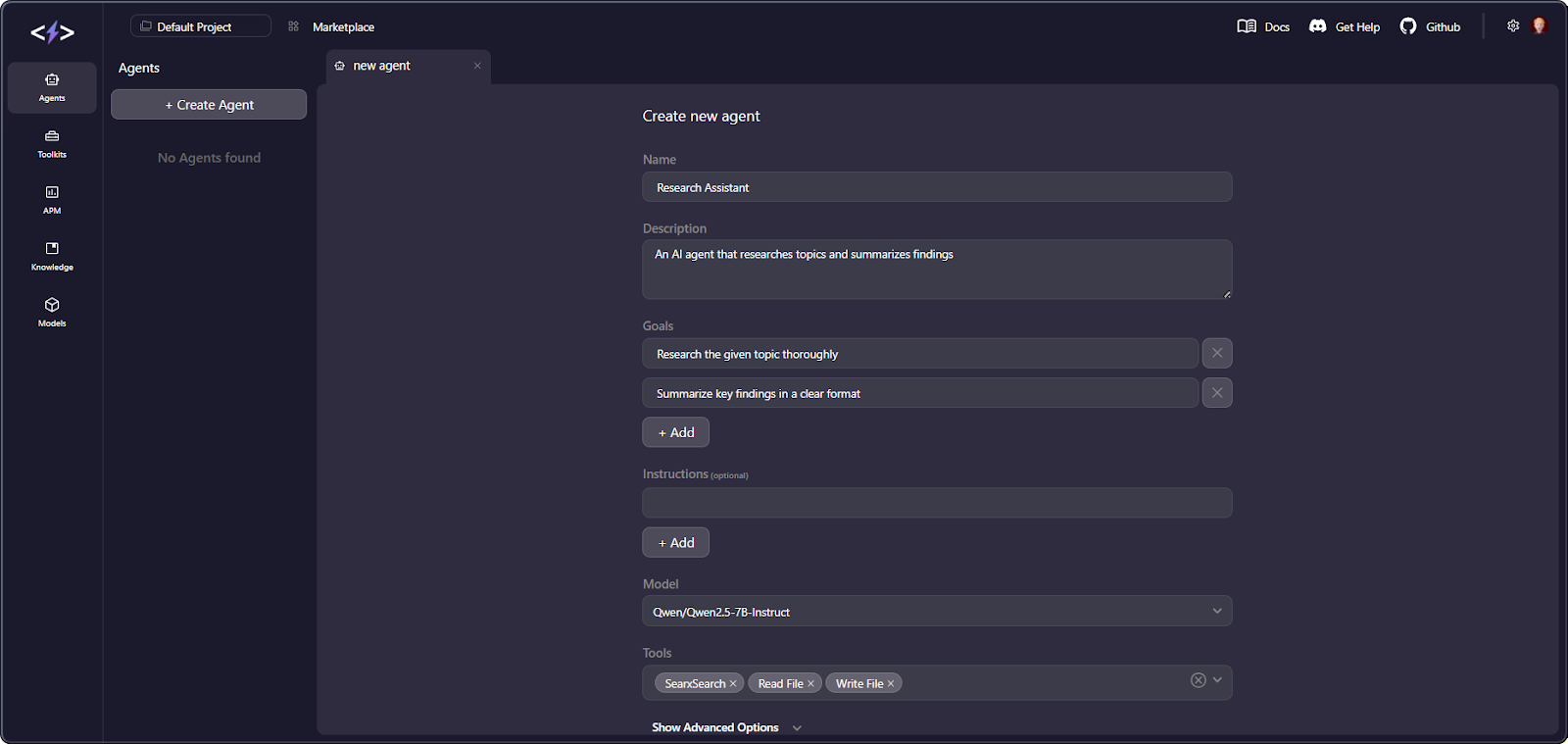

Con SuperAGI in esecuzione, vai alla scheda Agents nella GUI e clicca “Create Agent”. La schermata di provisioning richiede diversi campi: un nome, una descrizione, obiettivi (stringhe di testo che definiscono cosa deve fare l’agente), istruzioni, vincoli, strumenti da assegnare, il modello LLM da usare e un limite massimo di iterazioni.

Limiti di iterazione e controllo dei costi

L’impostazione del numero massimo di iterazioni è il tuo principale controllo di costo e sicurezza. Ogni iterazione attiva almeno una chiamata all’LLM e agenti complessi possono consumare token rapidamente. Inizia con un numero basso (10–15) mentre impari e aumenta man mano che capisci il comportamento del tuo agente.

Modalità di permesso

Esistono due modalità di permesso. La “God Mode” permette all’agente di eseguire liberamente. La modalità ristretta mette in pausa prima di azioni critiche e richiede la tua approvazione tramite l’Action Console. Per chi sta imparando la piattaforma, iniziare con la modalità ristretta è una buona abitudine.

Esecuzione e monitoraggio degli agenti

Dopo aver configurato l’agente, puoi avviarlo e monitorarne i progressi in tempo reale.

Una volta creato, clicca “Create and Run”. L’Activity Feed offre visibilità in tempo reale sul ragionamento dell’agente, sulle scelte degli strumenti e sugli output. Puoi mettere in pausa, riprendere o fermare gli agenti in qualsiasi momento. La dashboard APM, come accennato prima, aggrega metriche tra tutti gli agenti e le esecuzioni per una vista di alto livello.

Creare un nuovo agente nell’interfaccia di SuperAGI. Immagine dell’autore.

Accesso programmatico

Se preferisci lavorare con il codice invece che con la GUI, SuperAGI ti viene incontro.

SuperAGI fornisce anche SDK Python e Node.js che espongono le stesse operazioni CRUD sugli agenti presenti nella GUI (consulta la documentazione ufficiale per esempi d’uso).

Integrazione degli strumenti in SuperAGI

Gli strumenti sono il modo in cui gli agenti interagiscono con il mondo esterno. Assegni strumenti specifici quando crei un agente e l’LLM decide quali usare durante l’esecuzione in base al compito.

SuperAGI include un set solido di strumenti integrati e ti permette di crearne di personalizzati. Ecco cosa trovi subito pronto.

Toolkit integrati

Ecco un riepilogo dei principali toolkit integrati:

|

Toolkit |

Descrizione |

Chiave API richiesta? |

|

Google Search |

Ricerca web tramite Google Custom Search API |

Sì |

|

DuckDuckGo |

Ricerca web incentrata sulla privacy |

No |

|

Coding Toolkit |

WriteCode, WriteSpec, WriteTest, ImproveCode |

No |

|

File Manager |

Leggi, scrivi, aggiungi, elimina file |

No |

|

Web Scraper |

Estrai dati da pagine web |

No |

|

GitHub |

Ricerca repository, operazioni su file, pull request |

Sì |

|

Jira |

Gestione issue (operazioni CRUD) |

Sì |

|

|

Invia email con allegati |

Sì |

|

DALL-E |

Generazione di immagini tramite OpenAI |

Sì |

|

Knowledge Search |

Ricerca semantica su embedding vettoriali |

No (richiede DB vettoriale) |

|

Thinking Tool |

Ragionamento interno con supporto alla memoria a lungo termine |

No |

Strumenti personalizzati

Oltre alle opzioni integrate, puoi estendere SuperAGI con i tuoi toolkit.

Per creare strumenti personalizzati, installa il pacchetto superagi-tools, estendi le classi BaseTool e BaseToolkit, definisci gli schemi di input con Pydantic e registra il toolkit tramite l’URL del suo repository GitHub nella GUI. Dopo aver aggiunto un toolkit personalizzato, ricompila con docker compose down && docker compose up --build.

Considerazioni di sicurezza per l’accesso agli strumenti

L’accesso agli strumenti introduce rischi di sicurezza che meritano attenzione.

Una parola di cautela sull’accesso non limitato agli strumenti: un agente con accesso a email e web potrebbe teoricamente essere sfruttato tramite prompt injection per esfiltrare dati. La scrittura di file senza sandbox potrebbe consentire modifiche indesiderate. Usa sempre la modalità ristretta e assegna solo gli strumenti necessari agli obiettivi specifici di ciascun agente.

SuperAGI vs. AutoGPT

Questo è un confronto di valore perché entrambi i framework mirano allo stesso ambito, ma si sono differenziati significativamente.

|

Dimensione |

SuperAGI |

AutoGPT |

|

Community GitHub |

Migliaia di stelle |

Community sostanzialmente più grande |

|

Ultima release |

v0.0.14 (gen 2024) |

Rilasci continui fino al 2025 |

|

Stato manutenzione |

Attività minima dal 2024 |

Sviluppo attivo |

|

Architettura |

Framework agente ReAct |

Piattaforma a workflow basati su blocchi |

|

UI |

Dashboard web integrata con APM |

Builder Next.js drag-and-drop |

|

Osservabilità |

APM integrato (più maturo) |

Dashboard con integrazione Sentry |

|

Supporto LLM |

OpenAI, PaLM 2, HuggingFace, Replicate, locale |

OpenAI, Anthropic, Groq, Ollama e altri |

|

Licenza |

MIT |

Duale (MIT + Polyform Shield) |

Confronto aggiornato agli inizi del 2026. Controlla i rispettivi repository per gli ultimi aggiornamenti.

La differenza chiave è filosofica. SuperAGI è un framework per agenti orientato agli sviluppatori, dove imposti obiettivi e gli agenti definiscono i passaggi. AutoGPT è evoluto in una piattaforma low-code per workflow in cui gli utenti connettono visivamente i blocchi. SuperAGI offre un’osservabilità integrata più matura tramite la sua dashboard APM, ma AutoGPT ha una community significativamente più grande, sviluppo attivo e un supporto LLM più ampio. Entrambi tendono a mostrare instabilità in modalità autonoma aperta.

Per nuovi progetti oggi, AutoGPT è in genere l’opzione più attivamente mantenuta. Se vuoi studiare un’architettura pulita per agenti o ti serve un APM integrato per la ricerca, SuperAGI resta utile come strumento didattico.

SuperAGI vs. LangChain

La caratterizzazione “SuperAGI equivale a framework per agenti autonomi vs LangChain equivale a toolkit per applicazioni LLM” è verificata e accurata.

|

Dimensione |

SuperAGI |

LangChain |

|

Scopo principale |

Framework per agenti autonomi |

Toolkit di orchestrazione LLM |

|

Livello di astrazione |

Alto (centrato sull’agente, guidato dagli obiettivi) |

Basso (centrato sulle chain, flusso esplicito) |

|

Multi-agente |

Supporto nativo |

Tramite estensione LangGraph |

|

Interfaccia visuale |

Web UI integrata |

No (LangSmith per il monitoraggio) |

|

Supporto DB vettoriali |

3 (Pinecone, Weaviate, Qdrant) |

15+ integrazioni |

|

Documentazione |

Lacune, richiede lettura del codice sorgente |

Ampia, con esempi |

|

Installazione |

Docker Compose (setup più pesante) |

pip install (leggero) |

|

Stabilità in produzione |

Inferiore, sperimentale |

Superiore, più maturo |

Quando scegliere ciascuno: usa LangChain quando ti serve controllo preciso su ogni interazione con l’LLM, per pipeline RAG, interfacce conversazionali o elaborazione di documenti. Usa SuperAGI quando vuoi agenti che operano in autonomia con intervento minimo, preferisci la gestione visuale al codice o vuoi supporto multi-agente integrato con GUI.

LangChain e LangGraph hanno entrambi raggiunto la v1.0 nell’ottobre 2025, con LangGraph che offre orchestrazione di agenti basata su grafi a livello production, workflow con stato e osservabilità profonda tramite LangSmith. Per nuovi progetti in produzione, LangGraph è generalmente il percorso più maturo.

Casi d’uso per SuperAGI

Ecco dove SuperAGI funziona meglio, in base a esempi documentati e utilizzo della community.

- Automazione di task. Gli agenti possono gestire flussi email, operazioni sui file e ricerche web pianificate. La funzionalità di scheduling integrata (una pianificazione per agente) rende semplici i compiti ricorrenti.

- Assistenti alla ricerca. Combinando ricerca web, knowledge search e strumenti di output su file si creano agenti che raccolgono informazioni da più fonti e compilano output strutturati.

- Produttività per sviluppatori. I toolkit GitHub e Jira abilitano gestione automatizzata di issue, review di PR e generazione di codice. Il Coding Toolkit (WriteCode, WriteSpec, WriteTest, ImproveCode) supporta workflow di sviluppo end-to-end.

- Creazione di contenuti. Combinare DALL-E per la generazione di immagini con strumenti testuali crea agenti per workflow di contenuti multimediali. Toolkit della community per altri servizi di generazione immagini possono essere disponibili.

- Gestione social media. Il toolkit Twitter abilita la pubblicazione automatizzata con supporto ai media, sebbene dipenda dalla disponibilità delle API esterne. Toolkit aggiuntivi della community possono essere disponibili per altre piattaforme in base alla tua configurazione.

- Ricorda che le prove di adozione enterprise sono scarse. Il marketing di SuperAGI cita aziende note, ma considera lo strumento adatto a sperimentazione, prototipazione e apprendimento più che a soluzioni pronte per la produzione.

Limitazioni di SuperAGI

Il progetto è in stallo. L’ultima release taggata (v0.0.14) è di gennaio 2024. L’ultimo commit su main è stata una patch di sicurezza a gennaio 2025. L’attività di sviluppo è crollata dopo il 2023, con poche nuove funzionalità visibili da allora. Molte issue recenti sembrano senza risposta nel tracker pubblico.

I rischi di allucinazioni LLM si amplificano nei loop degli agenti. Quando gli agenti prendono decisioni in autonomia basandosi sull’output di un LLM, parametri di strumenti allucinati o fatti inventati possono propagarsi in azioni reali. Un agente multi-step che esegue dieci cicli può consumare molti più token di un passaggio lineare singolo, amplificando sia i costi sia i rischi di errore.

Gli agenti si bloccano spesso. Diverse issue su GitHub riportano agenti bloccati nello stato “Thinking” per periodi prolungati senza avanzare. Il limite di iterazioni fornisce un arresto forzato, ma gli agenti possono consumare risorse significative prima di raggiungerlo.

La documentazione ha lacune. Anche prima che alcune pagine venissero rimosse durante il passaggio commerciale dell’azienda, la documentazione era meno completa rispetto a concorrenti come LangChain. Lavorare con SuperAGI spesso richiede leggere direttamente il codice sorgente.

I costi in token crescono rapidamente. Ogni passaggio nel loop ReAct richiede almeno una chiamata all’LLM. A seconda della complessità del compito, questo può accumularsi più velocemente rispetto a implementazioni a chain più semplici.

L’azienda ha cambiato rotta. Come già detto, l’azienda è passata a un prodotto SaaS. Il sito superagi.com non mette più in evidenza il progetto open source e alcune pagine della documentazione ora restituiscono errori 404.

Considerazioni sulla sicurezza

La sicurezza è l’aspetto in cui SuperAGI mostra la sua età. I sistemi agentici amplificano l’impatto delle vulnerabilità, quindi questi problemi contano più che in un’app tradizionale. Ecco cosa devi sapere prima di usarlo.

Segreti e configurazione

Le API key sono archiviate in chiaro in config.yaml senza cifratura, integrazione con vault o meccanismi di rotazione. I campi ENCRYPTION_KEY e JWT_SECRET_KEY vengono distribuiti con valori segnaposto insicuri che vanno cambiati prima di qualsiasi deploy oltre alla tua macchina locale.

Isolamento dell’esecuzione

I container Docker forniscono un isolamento di processo di base, ma non esiste sandboxing avanzato. Gli agenti hanno accesso di rete illimitato e possono scrivere nel filesystem senza controlli. Per deploy più sicuri, le linee guida di sandboxing di NVIDIA raccomandano di limitare accesso di rete e scritture su filesystem, aspetti che SuperAGI non implementa.

Vulnerabilità note

Sono state divulgate pubblicamente varie vulnerabilità di gravità elevata (inclusa esecuzione remota di codice e perdita di configurazioni) che restano non patchate a causa dell’inattività del progetto. I report sono documentati su hunter, una piattaforma di divulgazione delle vulnerabilità. Sono stati segnalati anche problemi aggiuntivi come SSRF, scritture arbitrarie di file e configurazioni CORS errate.

Se fai affidamento su SuperAGI, verifica le fork della community per patch e sottoponi sempre a audit qualsiasi fork prima di usarla.

Rischi di prompt injection

Gli attacchi di prompt injection diventano particolarmente pericolosi quando gli agenti possono eseguire azioni nel mondo reale. SuperAGI è vulnerabile a prompt injection diretti e indiretti: istruzioni malevole in pagine web analizzate potrebbero dirottare il comportamento dell’agente. Considera tutti gli output da strumenti non affidabili (soprattutto contenuti web) come potenziali vettori d’attacco.

SuperAGI non documenta difese oltre ai gate di approvazione manuale dell’Action Console, quindi usa sempre la modalità con permessi ristretti.

Raccomandazioni di deploy

Se distribuisci SuperAGI oltre i test locali, prendi almeno queste precauzioni: sostituisci tutti i segreti di default, eseguilo dietro autenticazione (VPN o reverse proxy), usa la modalità con permessi ristretti e assegna solo gli strumenti necessari a ciascun agente.

SuperAGI è pronto per la produzione?

In base allo stato attuale di manutenzione e sicurezza, non soddisfa i criteri tipici di prontezza alla produzione. SuperAGI stesso lo riconosce: il README su GitHub dichiara esplicitamente che il progetto è “in fase di sviluppo attivo e potrebbe avere ancora problemi”.

La valutazione più estesa è più sfumata. Il numero di versione pre-1.0 (v0.0.14) segnala uno stato sperimentale. L’attività di sviluppo mostra un picco netto a metà 2023 seguito da attività minima in seguito. Sono state segnalate più vulnerabilità di sicurezza con risposte pubbliche limitate e il passaggio dell’azienda a prodotti commerciali indica che al momento non c’è una roadmap visibile che suggerisca un nuovo investimento nel framework open source.

La dashboard APM è un vero punto di forza. È più matura di quanto molti concorrenti offrano out of the box e resta uno dei veri elementi distintivi di SuperAGI per team che fanno ricerca sugli agenti.

Conclusione

SuperAGI ha introdotto diverse idee che hanno influenzato l’ecosistema degli agenti: APM integrato, un marketplace di strumenti e gestione con priorità alla GUI.

Detto questo, la realtà del 2026 è che il progetto SuperAGI è fermo. L’azienda ha cambiato rotta, vulnerabilità di sicurezza rimangono non risolte e non ci sono sviluppi visibili. Per lavori in produzione, alternative attivamente mantenute come LangGraph, CrewAI e Microsoft Agent Framework sono scelte migliori.

Come prossimo passo, dai un’occhiata al nostro corso Introduzione agli agenti di IA o al nostro tutorial su come costruire IA locale con Docker e n8n.

Sono un data engineer e community builder: lavoro su pipeline dati, cloud e strumenti di AI, e scrivo tutorial pratici e ad alto impatto per DataCamp e per sviluppatori alle prime armi.

FAQs

Posso ancora usare SuperAGI nel 2026 o è di fatto non mantenuto?

Sì, il codebase funziona ancora. Puoi clonarlo, eseguirlo con Docker e creare agenti. Tuttavia il progetto è non mantenuto: nessun rilascio da gennaio 2024 e issue senza risposta. Ottimo per imparare l’architettura degli agenti, ma evita l’uso in produzione a causa di vulnerabilità di sicurezza non patchate.

Dovrei imparare SuperAGI come principiante?

Se vuoi capire come funzionano gli agenti autonomi sotto il cofano, sì. Il codebase di SuperAGI è pulito e ben strutturato. Il loop ReAct, l’integrazione degli strumenti e la dashboard APM sono ottimi esempi per imparare. Ma se il tuo obiettivo è creare app di produzione, parti da LangGraph o CrewAI. Hanno documentazione migliore, community attive e funzionalità pronte per la produzione.

Come si confronta SuperAGI con framework più recenti come CrewAI?

CrewAI si concentra sulla collaborazione multi-agente basata su ruoli ed è attivamente mantenuto con aggiornamenti regolari. SuperAGI adotta un approccio single-agent-first. Per nuovi progetti nel 2026, CrewAI è la scelta migliore: sviluppo attivo, documentazione migliore ed ecosistema in crescita. Scegli CrewAI se ti serve collaborazione per ruoli, oppure LangGraph se vuoi affidabilità di livello production.

Mi serve una GPU potente per eseguire SuperAGI?

No. SuperAGI chiama i provider LLM via API per impostazione predefinita, quindi l’inferenza avviene sui loro server. Ti servono solo circa 3–4 GB di RAM per i container Docker. L’opzione GPU è rilevante solo se vuoi eseguire LLM locali.

Qual è il modo più economico per sperimentare con SuperAGI?

Usa modelli economici come gpt-3.5-turbo o API gratuite come Groq (che offre accesso gratuito ai modelli Llama). Imposta le iterazioni massime a 10–15 e inizia con agenti semplici a singolo strumento. Monitora l’uso dei token tramite la dashboard APM. Nota che l’HuggingFace Inference API ha problemi di compatibilità con le aspettative in formato OpenAI di SuperAGI, quindi resta su provider compatibili con OpenAI.