Curso

Los frameworks de agentes de IA autónomos están pensados para sistemas que razonan tareas de varios pasos, eligen herramientas de forma independiente y ejecutan acciones en nombre del usuario con menos intervención manual. SuperAGI lo implementa mediante un bucle al estilo ReAct y una capa de orquestación con enfoque GUI.

SuperAGI es uno de los primeros frameworks de código abierto diseñados específicamente para este fin. Ofrece a los desarrolladores una plataforma para crear, gestionar y ejecutar agentes de IA orientados a objetivos a través de una interfaz web, con monitorización integrada, un marketplace de herramientas y compatibilidad con múltiples modelos de lenguaje grandes (LLMs).

En esta guía te explico qué es SuperAGI, su arquitectura y funciones, cómo instalarlo con Docker y lo comparo con AutoGPT y LangChain. También verás en qué destaca, dónde flojea y si es apto para entornos de producción.

Antes de empezar, una nota importante: SuperAGI como framework open source y SuperAGI como empresa ya no son lo mismo. La empresa ha girado hacia un SaaS comercial centrado en herramientas de ventas con IA, y el repositorio open source apenas tiene actividad desde 2024. Este artículo se centra en el framework de código abierto. A lo largo del texto comentaré su estado de mantenimiento actual para que puedas decidir con criterio si te conviene usarlo.

¿Qué es SuperAGI?

SuperAGI es un framework de agentes de IA autónomos, open source y orientado a desarrolladores, bajo licencia MIT. Lo creó TransformerOptimus y ha acumulado miles de estrellas en GitHub y más de 2.000 forks desde su lanzamiento en 2023. El proyecto está escrito principalmente en Python (aprox. 70%) y JavaScript en el frontend (aprox. 25%).

La idea clave es esta: SuperAGI no es un modelo. Es la capa de orquestación entre tú, un LLM y las herramientas que quieras que use el agente. Definirás objetivos para tu agente, le asignarás herramientas (como búsqueda web, gestión de archivos o integración con GitHub), elegirás un proveedor de LLM y el agente razona la tarea de forma autónoma, elige la herramienta adecuada en cada paso y itera hasta completar el objetivo o alcanzar el límite de iteraciones.

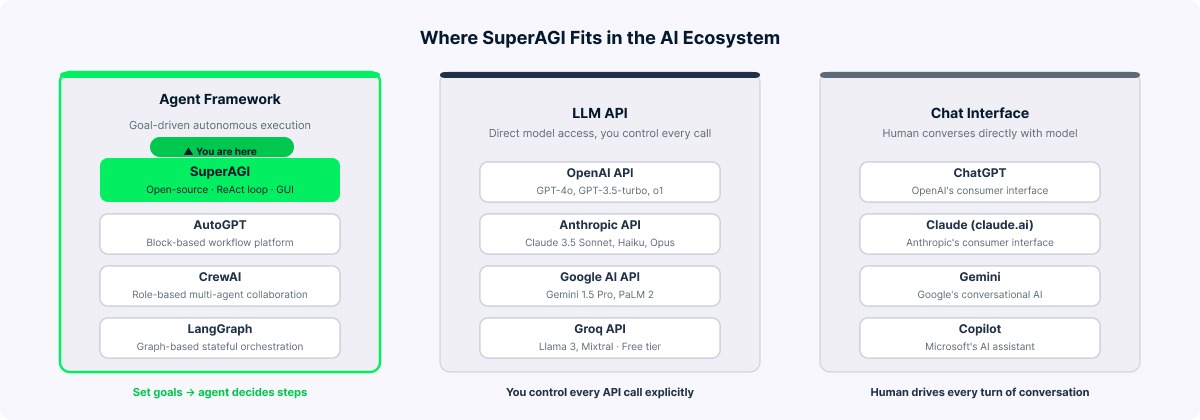

Tres ideas que conviene tener claras sobre dónde encaja SuperAGI en el ecosistema.

Un framework de agentes (como SuperAGI, AutoGPT o CrewAI) orquesta la ejecución autónoma de tareas usando LLMs combinados con herramientas. Una API de LLM (como la de OpenAI o Anthropic) ofrece acceso bruto al modelo para generación de texto y tú controlas cada llamada. Una interfaz de chat (como ChatGPT o Claude) es una capa conversacional de cara al usuario donde las personas interactúan directamente con el modelo.

SuperAGI opera a nivel de framework. Tú defines objetivos y el agente decide qué hacer. Esto es muy diferente tanto de chatear con un modelo como de hacer llamadas directas a la API.

SuperAGI como framework de agentes. Imagen del autor.

Funciones clave de SuperAGI

Ahora que ya sabes qué es SuperAGI y en qué se diferencia de herramientas más simples, veamos qué ofrece realmente bajo el capó.

-

Agentes autónomos. Creas agentes con objetivos, instrucciones, herramientas y restricciones. Hay tres tipos: Default (un único ciclo pensar-ejecutar), Fixed Task Queue (descompone objetivos en subtareas ordenadas) y Dynamic Task Queue (el agente puede añadir nuevas tareas durante la ejecución a medida que detecta necesidades).

-

Sistema de integración de herramientas. SuperAGI incluye un amplio conjunto de toolkits integrados: Google Search, DuckDuckGo, Web Scraper, File Manager, GitHub, Jira, Twitter, Notion, Google Calendar, DALL-E, un Coding Toolkit y una herramienta de Knowledge Search basada en bases de datos vectoriales. También puede haber toolkits de la comunidad para servicios como Slack, Instagram u otros generadores de imágenes, según tu configuración. Más adelante detallo la integración de herramientas.

-

GUI web. Una interfaz Next.js accesible en

localhost:3000permite crear agentes, asignar herramientas, ver actividad en tiempo real, configurar proveedores de modelos, programar agentes y explorar el marketplace. -

Agent Performance Monitoring (APM). Introducido en la versión 0.0.8, el panel APM es uno de los diferenciadores reales de SuperAGI. Ofrece métricas a nivel de organización (agentes totales, tokens consumidos, ejecuciones), desgloses por modelo (agentes, ejecuciones y tokens por LLM) y analíticas a nivel de agente (tokens medios por ejecución, llamadas a API totales y tiempo de ejecución). Las tarjetas reordenables permiten personalizar el panel.

-

Orquestación multiagente. Puedes ejecutar varios agentes a la vez, cada uno con objetivos, herramientas y LLMs distintos, todo gestionado desde la misma GUI.

-

Action Console. Es la función human-in-the-loop. En modo de permisos restringidos, los agentes se detienen antes de ejecutar acciones críticas (como enviar emails o escribir archivos) y esperan tu aprobación desde la Action Console. Es un control de seguridad para operaciones sensibles.

-

Compatibilidad con bases vectoriales. SuperAGI admite Weaviate, Pinecone y Qdrant para memoria a largo plazo mediante embeddings vectoriales. El contexto a corto plazo se mantiene durante la ejecución del agente; el conocimiento a largo plazo persiste entre ejecuciones en la base vectorial.

-

Marketplace. Un marketplace de la comunidad con herramientas, toolkits, plantillas de agentes, embeddings de conocimiento y modelos. Puedes explorar e instalar desde la propia GUI.

Panel principal de SuperAGI con métricas APM. Imagen del autor.

Cómo funciona SuperAGI: visión de la arquitectura

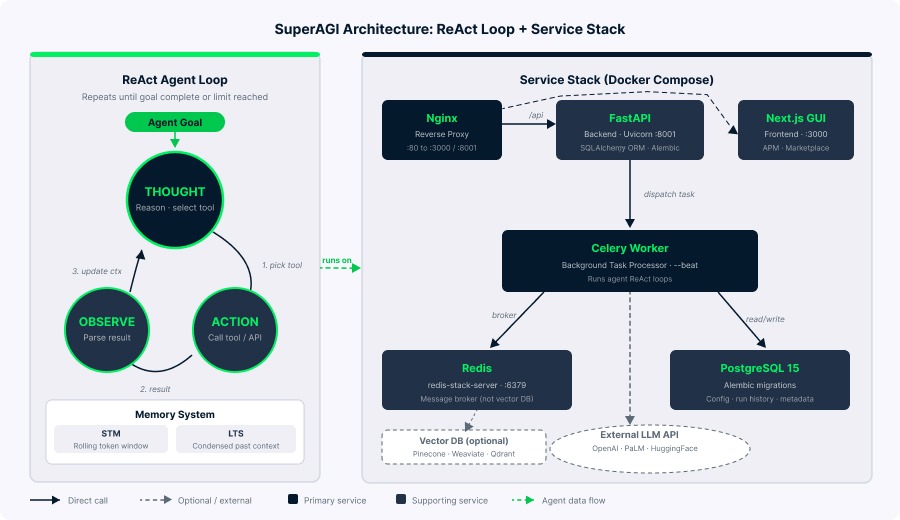

Un malentendido común en artículos de terceros es que SuperAGI usa un bucle "planificar, ejecutar, reflexionar, iterar". Esa formulación es habitual en resúmenes, pero la implementación se parece más al patrón ReAct (Reason + Act). SuperAGI implementa un bucle Thought → Action → Observation: el agente piensa sobre el estado actual, elige una herramienta, observa el resultado y repite. ReAct alterna pasos de razonamiento ("Thought") y llamadas a herramientas ("Action"), guiado por observaciones.

El stack técnico, verificado en el docker-compose.yaml y el código fuente, se desglosa así:

|

Componente |

Tecnología |

|

Framework web |

FastAPI |

|

Cola de tareas |

Celery |

|

Message broker |

Redis (redis-stack-server) |

|

Base de datos |

PostgreSQL 15 |

|

ORM |

SQLAlchemy |

|

Migraciones |

Alembic |

|

Frontend |

Next.js |

|

Proxy inverso |

Nginx |

|

Lenguaje |

Python |

El backend usa Uvicorn en el puerto 8001, con Nginx haciendo proxy /api hacia el backend y el resto de rutas a la GUI en Next.js. Celery gestiona tareas en segundo plano con --beat para operaciones programadas. PostgreSQL almacena configuración de agentes, historial de ejecuciones y metadatos. En la configuración por defecto, Redis sirve básicamente como broker de Celery, no como base vectorial, pese a lo que afirman algunas fuentes.

Para la memoria, SuperAGI usa un sistema en dos partes. La memoria a corto plazo (STM) es una ventana deslizante basada en el límite de tokens del LLM, mientras que el resumen a largo plazo (LTS) condensa el contexto fuera de esa ventana. En conjunto forman el Agent Summary que alimenta cada paso de razonamiento. Las bases vectoriales gestionan los embeddings de conocimiento por separado.

Arquitectura de SuperAGI con bucle ReAct. Imagen del autor.

Configuración de SuperAGI

Antes de empezar, asegúrate de tener Docker Desktop, Git y acceso a al menos un proveedor de LLM compatible (por ejemplo, una clave de API de OpenAI). Calcula que todo el stack usará entre 3 y 4 GB de RAM. Si usas Windows, necesitas tener WSL2 habilitado.

Instalar SuperAGI con Docker

Docker es el método recomendado y más fiable. El proceso se divide en unos pocos pasos claros.

Clona y configura

Sigue estos pasos:

# Clona el repositorio

git clone https://github.com/TransformerOptimus/SuperAGI.git

# Entra en el directorio del proyecto

cd SuperAGI

# Copia la plantilla de configuración

cp config_template.yaml config.yamlAbre config.yaml en un editor de texto y configura tu proveedor de LLM. Para OpenAI, define OPENAI_API_KEY. Introduce las claves sin comillas ni espacios extra:

# Proveedor de LLM (elige uno o varios)

OPENAI_API_KEY: sk-your-openai-key-here

# PALM_API_KEY: your-palm-key-here

# HUGGING_FACE_API_KEY: your-hf-key-here

# Opcional: para la herramienta Google Search

GOOGLE_API_KEY: your-google-key

SEARCH_ENGINE_ID: your-cse-id

# Opcional: para la base vectorial Pinecone

PINECONE_API_KEY: your-pinecone-keyCompila y arranca los contenedores

Ahora compila y lanza los contenedores:

# Compila y arranca todos los servicios

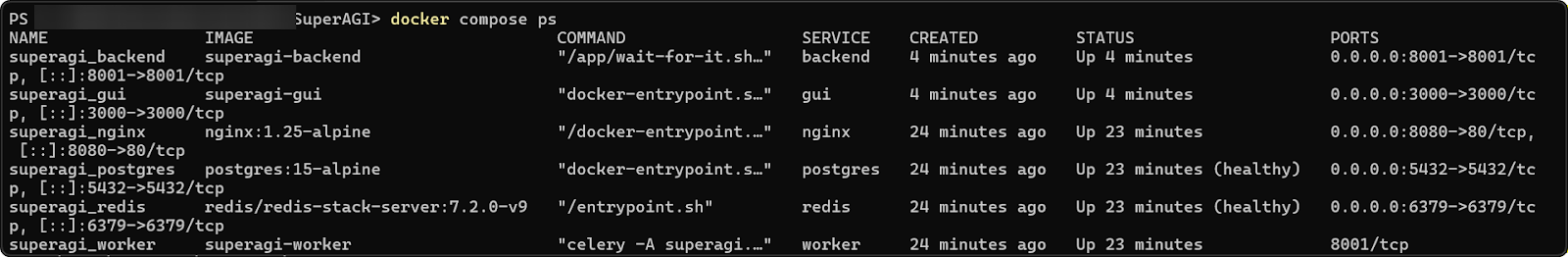

docker compose -f docker-compose.yaml up --buildLa compilación inicial tarda unos 10 a 15 minutos. Cuando los seis contenedores estén en marcha (backend, celery, gui, redis, postgres y nginx), abre http://localhost:3000 en el navegador (puerto por defecto configurado en el compose para la GUI vía Nginx).

Contenedores Docker de SuperAGI compilados con éxito. Imagen del autor.

Verifica la instalación

Para confirmar que todo funciona, ejecuta docker compose ps y comprueba que aparecen los seis contenedores. Luego ve a localhost:3000, entra en Settings y verifica que se detectan tus claves de API.

Problemas comunes y soluciones

El repositorio oficial tiene varios problemas conocidos que quizá te encuentres. Estos son los más habituales y cómo solucionarlos.

Docker daemon no está en ejecución: asegúrate de que Docker Desktop está activo antes de lanzar comandos de compose.

Error de Celery "Unable to load application": confirma que tu archivo se llama exactamente config.yaml y no config_template.yaml, y recompila con docker compose down && docker compose up --build.

Error de clave de cifrado: si ves ValueError: Encryption key must be 32 bytes long, asegúrate de que ENCRYPTION_KEY en config.yaml tiene exactamente 32 caracteres y va entre comillas:

ENCRYPTION_KEY: "abcdefghijklmnopqrstuvwxyz123456"

JWT_SECRET_KEY: "your-jwt-secret-key-change-this"JavaScript heap out of memory (contenedor GUI): si la GUI falla al compilar, el contenedor de Next.js necesita más memoria. Añade esto al servicio gui en docker-compose.yaml:

gui:

environment:

NODE_OPTIONS: "--max-old-space-size=1024"

deploy:

resources:

limits:

memory: 1gPermiso denegado en el puerto 80 (Windows): Windows requiere privilegios de administrador para el puerto 80. Cambia el mapeo de puertos de Nginx en docker-compose.yaml:

nginx:

ports:

- "8080:80" # Accede vía localhost:8080Error de formato de URL de Redis: si aparece ValueError: invalid literal for int() relacionado con Redis, elimina el prefijo redis:// de REDIS_URL en config.yaml:

REDIS_URL: "redis:6379" # No uses redis://redis:6379/0Bucle de reinicio del contenedor backend: si el backend se reinicia sin logs de error, puede faltar el comando de arranque. Comprueba que docker-compose.yaml incluye un entrypoint correcto.

Conflictos de puertos: si el puerto 3000 o 8080 ya está en uso, edita los mapeos de puertos en docker-compose.yaml para usar otros.

Compatibilidad con GPU

Para compatibilidad con LLMs locales acelerados por GPU (añadido en v0.0.14), usa el archivo compose específico:

docker compose -f docker-compose-gpu.yml up --buildRequiere una GPU NVIDIA con NVIDIA Container Toolkit configurado para el runtime de GPU en Docker.

Instalar SuperAGI manualmente (entorno de desarrollo)

No es el método recomendado oficialmente, pero funciona para desarrollo y depuración. Tendrás que configurar backend y frontend por separado.

Configuración del backend

# Clona y entra en el directorio

git clone https://github.com/TransformerOptimus/SuperAGI.git

cd SuperAGI

# Crea y activa un entorno virtual

pip install virtualenv

virtualenv venv

source venv/bin/activate # Windows: venv\Scripts\activate

# Instala dependencias de Python

pip install -r requirements.txt

# Copia y edita la config

cp config_template.yaml config.yaml

# Edita config.yaml: pon POSTGRES_URL a localhost, REDIS_URL a localhost:6379

# Arranca el backend

./run.sh # Windows: .\run.batTen en cuenta que las dependencias de Python están fijadas a versiones antiguas (openai==0.27.7, FastAPI==0.95.2), lo que puede causar conflictos en entornos modernos. Es esencial aislar con entorno virtual.

Configuración del frontend

Para el frontend, ve a ./gui y ejecuta npm install && npm run dev. Debes crear manualmente una base de datos PostgreSQL llamada super_agi_main con usuario superagi y contraseña password. También necesitas Redis en ejecución por separado.

Creación y gestión de agentes en SuperAGI

Con SuperAGI instalado, veamos cómo crear y ejecutar tu primer agente.

Configuración del agente

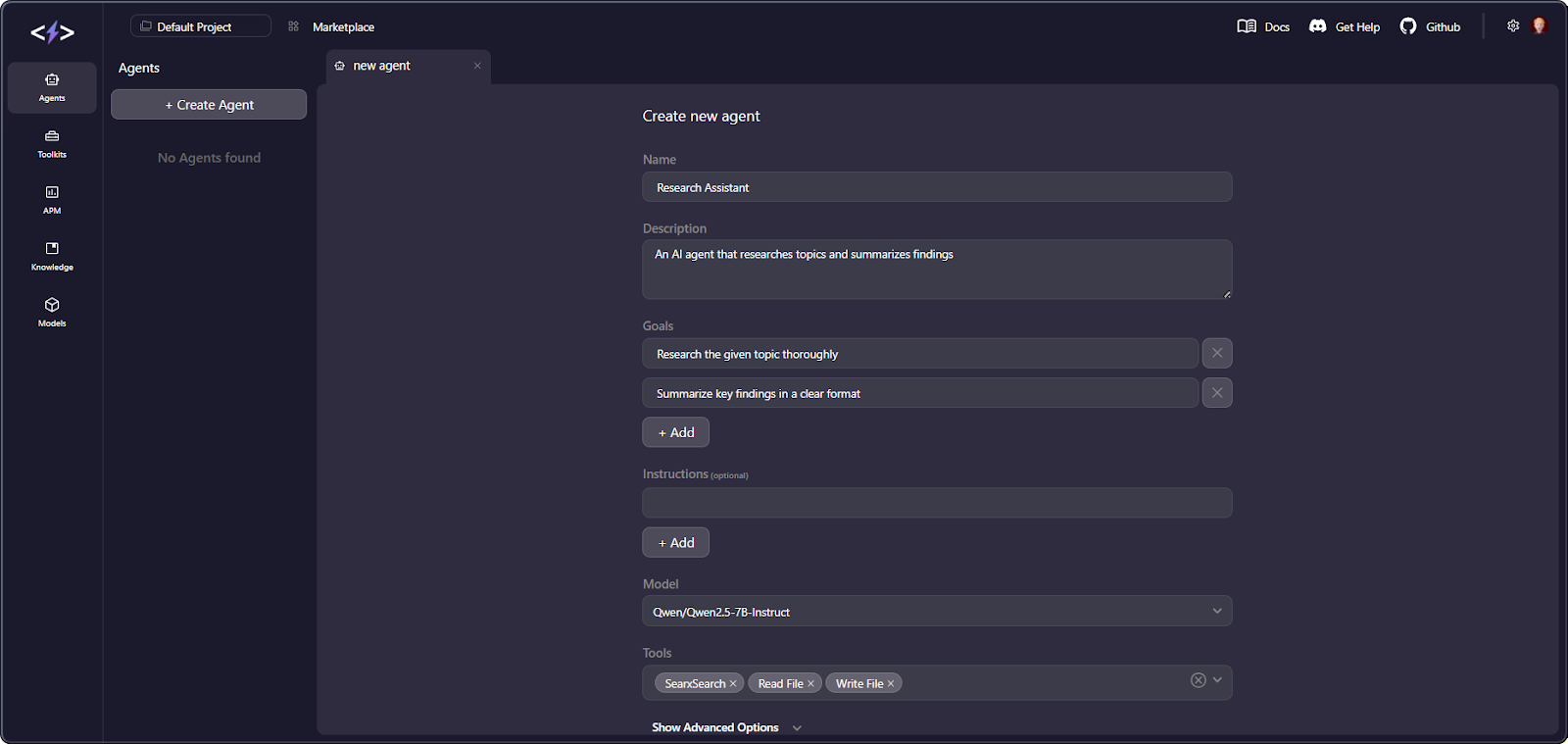

Con SuperAGI en marcha, ve a la pestaña Agents de la GUI y haz clic en "Create Agent". La pantalla de aprovisionamiento solicita varios campos: nombre, descripción, objetivos (cadenas de texto con lo que debe lograr el agente), instrucciones, restricciones, herramientas a asignar, el modelo LLM a usar y un límite de iteraciones.

Límites de iteración y control de costes

El límite de iteraciones es tu principal control de coste y seguridad. Cada iteración dispara al menos una llamada al LLM, y los agentes complejos pueden consumir tokens rápidamente. Empieza con un número bajo (10 a 15) mientras aprendes y súbelo según entiendas el comportamiento de tu agente.

Modos de permiso

Existen dos modos de permisos. "God Mode" permite que el agente ejecute sin restricciones. El modo restringido pausa antes de acciones críticas y requiere tu aprobación desde la Action Console. Para empezar, es buena práctica usar el modo restringido.

Ejecución y monitorización de agentes

Tras configurar el agente, puedes lanzarlo y seguir su progreso en tiempo real.

Una vez creado, haz clic en "Create and Run". El Activity Feed ofrece visibilidad en tiempo real del razonamiento del agente, la selección de herramientas y los resultados. Puedes pausar, reanudar o detener agentes en cualquier momento. El panel APM, como comenté, agrega métricas de todos los agentes y ejecuciones para una vista de alto nivel.

Creando un nuevo agente en la interfaz de SuperAGI. Imagen del autor.

Acceso programático

Si prefieres trabajar con código en lugar de la GUI, SuperAGI también te cubre.

SuperAGI ofrece SDKs para Python y Node.js que exponen las mismas operaciones CRUD de agentes que la GUI (consulta la documentación oficial para ver ejemplos).

Integración de herramientas en SuperAGI

Las herramientas son cómo los agentes interactúan con el exterior. Las asignas al crear un agente y el LLM decide cuáles usar durante la ejecución según la tarea.

SuperAGI viene con un buen conjunto de herramientas integradas y te permite crear las tuyas. Esto es lo que tienes de serie.

Toolkits integrados

Resumen de los principales toolkits:

|

Toolkit |

Descripción |

¿Requiere API key? |

|

Google Search |

Búsqueda web vía Google Custom Search API |

Sí |

|

DuckDuckGo |

Búsqueda web con foco en privacidad |

No |

|

Coding Toolkit |

WriteCode, WriteSpec, WriteTest, ImproveCode |

No |

|

File Manager |

Leer, escribir, añadir y borrar archivos |

No |

|

Web Scraper |

Extraer datos de páginas web |

No |

|

GitHub |

Búsqueda en repos, operaciones de archivos, pull requests |

Sí |

|

Jira |

Gestión de issues (operaciones CRUD) |

Sí |

|

|

Enviar correos con adjuntos |

Sí |

|

DALL-E |

Generación de imágenes vía OpenAI |

Sí |

|

Knowledge Search |

Búsqueda semántica sobre embeddings vectoriales |

No (requiere base vectorial) |

|

Thinking Tool |

Razonamiento interno con soporte de memoria a largo plazo |

No |

Herramientas personalizadas

Más allá de las opciones integradas, puedes ampliar SuperAGI con tus propios toolkits.

Para crear herramientas personalizadas, instala el paquete superagi-tools, extiende las clases BaseTool y BaseToolkit, define esquemas de entrada con Pydantic y registra el toolkit mediante la URL de su repo en GitHub desde la GUI. Tras añadir un toolkit personalizado, recompila con docker compose down && docker compose up --build.

Consideraciones de seguridad para el acceso a herramientas

El acceso a herramientas introduce riesgos de seguridad que conviene gestionar con cuidado.

Un aviso sobre el acceso sin restricciones: un agente con email y web podría ser víctima de inyecciones de prompt y filtrar datos. El acceso de escritura a archivos sin sandbox puede permitir modificaciones no deseadas. Usa siempre el modo restringido y asigna solo las herramientas necesarias para los objetivos concretos de cada agente.

SuperAGI vs. AutoGPT

Es una comparación de alto valor porque ambos frameworks abordan el mismo tipo de problema, aunque han evolucionado de forma distinta.

|

Dimensión |

SuperAGI |

AutoGPT |

|

Comunidad en GitHub |

Miles de estrellas |

Comunidad sustancialmente mayor |

|

Último lanzamiento |

v0.0.14 (ene 2024) |

Lanzamientos continuos hasta 2025 |

|

Estado de mantenimiento |

Actividad mínima desde 2024 |

Desarrollo activo |

|

Arquitectura |

Framework de agente ReAct |

Plataforma de flujos por bloques |

|

UI |

Panel web integrado con APM |

Constructor drag-and-drop en Next.js |

|

Observabilidad |

APM integrado (más maduro) |

Panel con integración Sentry |

|

Compatibilidad LLM |

OpenAI, PaLM 2, HuggingFace, Replicate, local |

OpenAI, Anthropic, Groq, Ollama y otros |

|

Licencia |

MIT |

Dual (MIT + Polyform Shield) |

Comparación actualizada a inicios de 2026. Consulta los repositorios para ver las últimas novedades.

La diferencia clave es filosófica. SuperAGI es un framework de agentes orientado al desarrollador: defines objetivos y los agentes descubren los pasos. AutoGPT ha evolucionado hacia una plataforma low-code de flujos visuales donde conectas bloques. SuperAGI ofrece observabilidad integrada más madura con su tablero APM, pero AutoGPT tiene una comunidad mucho mayor, desarrollo activo y soporte LLM más amplio. Ambos tienden a ser inestables en modo autónomo abierto.

Para proyectos nuevos hoy, AutoGPT suele ser la opción con mantenimiento más activo. Si te interesa estudiar una arquitectura de agentes clara o necesitas APM integrado para investigación, SuperAGI sigue aportando valor como herramienta de aprendizaje.

SuperAGI vs. LangChain

La caracterización "SuperAGI equivale a framework de agentes autónomos frente a LangChain equivale a toolkit para aplicaciones con LLM" es correcta.

|

Dimensión |

SuperAGI |

LangChain |

|

Propósito principal |

Framework de agentes autónomos |

Toolkit de orquestación de LLMs |

|

Nivel de abstracción |

Alto (centrado en agente y objetivos) |

Más bajo (centrado en cadenas, flujo explícito) |

|

Multiagente |

Soporte nativo |

Vía extensión LangGraph |

|

Interfaz visual |

UI web integrada |

No (LangSmith para monitorización) |

|

Soporte de bases vectoriales |

3 (Pinecone, Weaviate, Qdrant) |

15+ integraciones |

|

Documentación |

Con lagunas, a veces hay que leer el código |

Extensa y con ejemplos |

|

Instalación |

Docker Compose (montaje más pesado) |

pip install (ligero) |

|

Estabilidad en producción |

Menor, experimental |

Mayor, más madura |

Cuándo elegir cada uno: usa LangChain cuando necesites control preciso de cada interacción con el LLM, para RAG, interfaces conversacionales o procesamiento de documentos. Usa SuperAGI cuando quieras agentes que operen con mínima intervención, prefieras gestión visual frente a código o necesites soporte multiagente con GUI.

LangChain y LangGraph alcanzaron la v1.0 en octubre de 2025; LangGraph ofrece orquestación de agentes basada en grafos de nivel producción con flujos con estado y observabilidad profunda vía LangSmith. Para nuevos proyectos en producción, LangGraph suele ser la vía más madura.

Casos de uso de SuperAGI

Estos son los escenarios donde mejor encaja SuperAGI, según ejemplos documentados y uso de la comunidad.

- Automatización de tareas. Los agentes pueden gestionar flujos de email, operaciones de archivos y búsquedas web programadas. La programación integrada (una por agente) facilita tareas recurrentes.

- Asistentes de investigación. Combinando búsqueda web, búsqueda de conocimiento y herramientas de salida a archivo, crean agentes que recaban información de múltiples fuentes y la compilan en salidas estructuradas.

- Productividad de desarrollo. Los toolkits de GitHub y Jira permiten gestión automática de incidencias, revisiones de PR y generación de código. El Coding Toolkit (WriteCode, WriteSpec, WriteTest, ImproveCode) cubre flujos de desarrollo end-to-end.

- Creación de contenido. Combinando DALL-E para imágenes con herramientas de texto, puedes crear agentes para flujos de contenido multimedia. Puede haber toolkits de la comunidad para otros servicios de generación de imágenes.

- Gestión de redes sociales. El toolkit de Twitter permite publicaciones automáticas con soporte de medios, sujeto a la disponibilidad de la API externa. Según tu configuración, quizá haya toolkits comunitarios para otras plataformas.

- Ten en cuenta que hay pocas pruebas de adopción en empresa. El marketing de SuperAGI cita compañías conocidas, pero trátalo como una herramienta para experimentar, prototipar y aprender, más que como una solución lista para producción.

Limitaciones de SuperAGI

El proyecto está estancado. El último lanzamiento etiquetado (v0.0.14) fue en enero de 2024. El último commit en main fue un parche de seguridad en enero de 2025. La actividad se redujo drásticamente tras 2023, con pocas funciones nuevas visibles. Muchos issues recientes no tienen respuesta en el tracker público.

Los riesgos de alucinación del LLM se amplifican en bucles de agentes. Si los agentes toman decisiones basadas en salidas del LLM, parámetros de herramientas inventados o hechos falsos pueden derivar en acciones reales. Un agente multietapa que corre diez ciclos consume muchos más tokens que una pasada lineal, aumentando costes y riesgo de error.

Los agentes se atascan con frecuencia. Varios issues en GitHub informan de agentes en estado "Thinking" durante largos periodos sin avanzar. El límite de iteraciones pone un tope duro, pero pueden consumir recursos antes de alcanzarlo.

La documentación tiene lagunas. Incluso antes de que algunas páginas desaparecieran con el giro comercial de la empresa, la documentación era menos completa que la de competidores como LangChain. A menudo hay que leer el código fuente.

Los costes en tokens crecen rápido. Cada paso del bucle ReAct implica al menos una llamada al LLM. Según la complejidad, suma más que implementaciones de cadenas más simples.

La empresa ha pivotado. Como se mencionó, la compañía se ha orientado a un producto SaaS. El sitio superagi.com ya no destaca el proyecto open source y algunas páginas de documentación devuelven 404.

Consideraciones de seguridad

La seguridad es donde SuperAGI acusa el paso del tiempo. Los sistemas agénticos amplifican el impacto de las vulnerabilidades, así que estos puntos importan más que en una app tradicional. Esto es lo que debes saber antes de usarlo.

Secretos y configuración

Las claves de API se guardan en texto plano en config.yaml sin cifrado, sin integración con vault ni rotación. Los campos ENCRYPTION_KEY y JWT_SECRET_KEY traen valores inseguros por defecto que debes cambiar antes de cualquier despliegue más allá de tu máquina local.

Aislamiento de ejecución

Los contenedores Docker aportan aislamiento básico de procesos, pero no hay sandboxing avanzado. Los agentes tienen acceso a red sin restricciones y pueden escribir en el sistema de archivos sin controles. Para despliegues más seguros, las guías de sandboxing de NVIDIA recomiendan restringir acceso a red y escrituras, algo que SuperAGI no implementa.

Vulnerabilidades conocidas

Se han divulgado públicamente varias vulnerabilidades graves (incluida ejecución remota de código y fugas de configuración) que siguen sin parche por la inactividad del proyecto. Hay reportes documentados en hunter, una plataforma de divulgación. También se han notificado SSRF, escrituras arbitrarias de archivos y errores de CORS.

Si dependes de SuperAGI, revisa forks comunitarios con parches y audítalos siempre antes de usarlos.

Riesgos de inyección de prompts

Los ataques de inyección de prompt son especialmente peligrosos cuando los agentes pueden ejecutar acciones reales. SuperAGI es vulnerable tanto a inyección directa como indirecta; instrucciones maliciosas en páginas web rastreadas pueden secuestrar el comportamiento. Trata toda salida de herramientas no confiables (especialmente contenido web) como potencial vector de ataque.

SuperAGI no documenta defensas más allá de las aprobaciones manuales de la Action Console, así que usa siempre el modo de permisos restringidos.

Recomendaciones de despliegue

Si despliegas SuperAGI más allá de pruebas locales, como mínimo: cambia todos los secretos por defecto, ponlo detrás de autenticación (VPN o proxy inverso), usa el modo restringido y asigna solo las herramientas necesarias a cada agente.

¿Está SuperAGI listo para producción?

Por su estado actual de mantenimiento y seguridad, no cumple los criterios habituales de preparación para producción. El propio SuperAGI lo reconoce: el README de GitHub indica que el proyecto está "en desarrollo activo y puede tener problemas".

El análisis más largo es matizado. La versión pre-1.0 (v0.0.14) indica carácter experimental. La actividad mostró un pico en 2023 y luego cayó. Se han reportado vulnerabilidades con poca respuesta pública y, tras el giro comercial, no hay hoja de ruta visible que indique una inversión renovada en el framework open source.

El panel APM es un punto claramente positivo. Es más maduro que lo que ofrecen muchos competidores de serie y sigue siendo un diferenciador real para equipos que investigan con agentes.

Conclusión

SuperAGI fue pionero en varias ideas que influyeron en el ecosistema de agentes: APM integrado, marketplace de herramientas y gestión con enfoque GUI.

Dicho esto, la realidad en 2026 es que el proyecto está parado. La empresa ha pivotado, hay vulnerabilidades sin resolver y no se ve desarrollo nuevo. Para producción, alternativas activas como LangGraph, CrewAI y Microsoft Agent Framework son mejores opciones.

Como siguiente paso, échale un vistazo a nuestro curso Introduction to AI Agents o al tutorial sobre construir IA local con Docker y n8n.

Soy ingeniero de datos y creador de comunidades. Trabajo con canalizaciones de datos, nube y herramientas de IA, al tiempo que escribo tutoriales prácticos y de gran impacto para DataCamp y programadores emergentes.

FAQs

¿Puedo seguir usando SuperAGI en 2026 o está, en la práctica, sin mantener?

Sí, el código sigue funcionando. Puedes clonarlo, ejecutarlo con Docker y crear agentes. Pero el proyecto está sin mantenimiento: no hay lanzamientos desde enero de 2024 y los issues quedan sin respuesta. Genial para aprender arquitectura de agentes, pero evita su uso en producción por vulnerabilidades de seguridad sin parchear.

¿Debería aprender SuperAGI si soy principiante?

Si quieres entender cómo funcionan los agentes autónomos por dentro, sí. El código de SuperAGI es limpio y bien estructurado. El bucle ReAct, la integración de herramientas y el panel APM son grandes ejemplos para aprender. Pero si tu objetivo es construir apps de producción, empieza con LangGraph o CrewAI. Tienen mejor documentación, comunidades activas y funciones listas para producción.

¿Cómo se compara SuperAGI con frameworks más nuevos como CrewAI?

CrewAI se centra en la colaboración multiagente basada en roles y se mantiene activamente con actualizaciones regulares. SuperAGI adopta un enfoque de agente único primero. Para proyectos nuevos en 2026, CrewAI es mejor elección: desarrollo activo, mejor documentación y un ecosistema en crecimiento. Elige CrewAI si necesitas colaboración por roles, o LangGraph si buscas fiabilidad de nivel producción.

¿Necesito una GPU potente para ejecutar SuperAGI?

No. SuperAGI llama a proveedores de LLM vía API por defecto, así que la inferencia ocurre en sus servidores. Solo necesitas unos 3 a 4 GB de RAM para los contenedores Docker. La opción de GPU solo es relevante si quieres ejecutar LLMs locales.

¿Cuál es la forma más barata de experimentar con SuperAGI?

Usa modelos asequibles como gpt-3.5-turbo o APIs gratuitas como Groq (que ofrece acceso gratis a modelos Llama). Define el máximo de iteraciones en 10–15 y empieza con agentes sencillos de una sola herramienta. Controla tu consumo de tokens desde el panel APM. Ten en cuenta que HuggingFace Inference API presenta incompatibilidades con las expectativas de formato OpenAI de SuperAGI, así que quédate con proveedores compatibles con OpenAI.