Cours

Les frameworks d'agents IA autonomes sont conçus pour des systèmes capables de raisonner sur des tâches multi-étapes, de choisir des outils de manière indépendante et d'exécuter des actions au nom des utilisateurs avec un minimum d'interventions manuelles. SuperAGI met cela en œuvre via une boucle de type ReAct et une couche d'orchestration orientée GUI.

SuperAGI est l'un des premiers frameworks open source conçus spécifiquement à cet effet. Il offre aux développeurs une plateforme pour créer, gérer et exécuter des agents IA pilotés par objectifs via une interface web, avec supervision intégrée, marketplace d'outils et prise en charge de multiples modèles de langage de grande taille (LLM).

Dans ce guide, je présente SuperAGI, son architecture et ses fonctionnalités, j'explique comment l'installer avec Docker, et je le compare à AutoGPT et LangChain. J'aborde également ses points forts, ses limites et sa pertinence en production.

Précision importante avant de commencer : SuperAGI, le framework open source, et SuperAGI, l'entreprise, ne racontent plus la même histoire. L'entreprise s'est tournée vers un produit SaaS commercial axé sur des outils de vente alimentés par l'IA, et le dépôt open source est peu actif depuis 2024. Cet article traite du framework open source. Je ferai régulièrement le point sur son statut de maintenance afin de vous aider à décider s'il vous convient.

Qu'est-ce que SuperAGI ?

SuperAGI est un framework d'agents IA autonomes, open source et orienté développeurs, sous licence MIT. Créé par TransformerOptimus, il a accumulé des milliers d'étoiles GitHub et plus de 2 000 forks depuis 2023. Le projet est écrit principalement en Python (environ 70 %) avec un frontend en JavaScript (environ 25 %).

Idée clé : SuperAGI n'est pas un modèle. C'est la couche d'orchestration entre vous, un LLM et les outils que vous souhaitez donner à l'agent. Vous définissez des objectifs, vous lui assignez des outils (recherche web, gestion de fichiers, intégration GitHub, etc.), vous choisissez un fournisseur de LLM, puis l'agent raisonne de manière autonome, sélectionne l'outil adéquat à chaque étape et itère jusqu'à atteindre l'objectif ou la limite d'itérations.

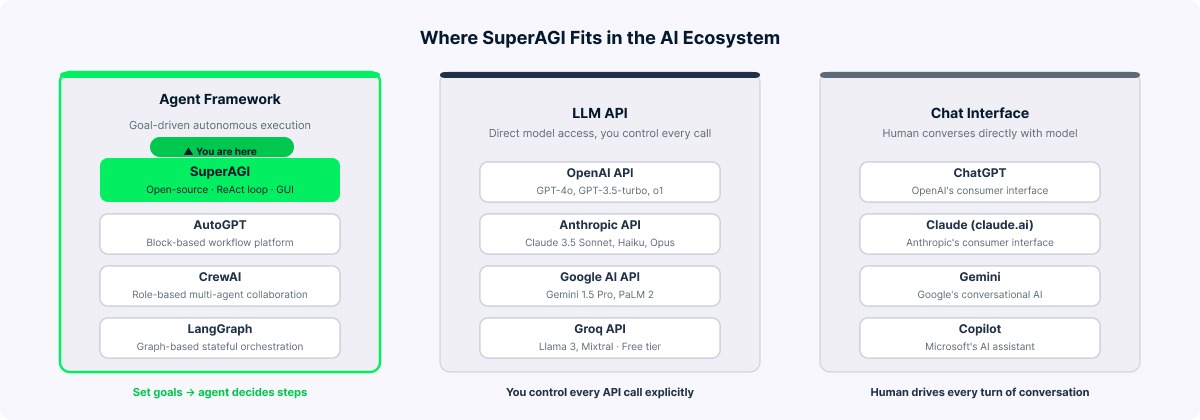

Trois points à comprendre d'emblée sur la place de SuperAGI dans l'écosystème :

Un framework d'agents (comme SuperAGI, AutoGPT ou CrewAI) orchestre l'exécution autonome de tâches à l'aide de LLM et d'outils. Une API LLM (OpenAI API, Anthropic API, etc.) donne accès au modèle pour la génération de texte, et vous contrôlez chaque appel. Une interface de chat (ChatGPT, Claude) est une couche conversationnelle où l'humain interagit directement avec le modèle.

SuperAGI se situe au niveau framework. Vous fixez des objectifs, l'agent décide quoi faire. C'est fondamentalement différent d'un chat avec un modèle ou d'appels d'API directs.

SuperAGI expliqué comme framework d'agents. Image de l'auteur.

Fonctionnalités essentielles de SuperAGI

Maintenant que vous savez ce qu'est SuperAGI et en quoi il diffère d'outils plus simples, voici ce qu'il offre sous le capot.

-

Agents autonomes. Vous déployez des agents avec des objectifs, instructions, outils et contraintes précis. Trois types existent : Default (cycle unique penser‑exécuter), Fixed Task Queue (décompose les objectifs en sous-tâches ordonnées) et Dynamic Task Queue (l'agent peut ajouter des tâches en cours d'exécution lorsqu'il identifie des besoins).

-

Système d'intégration d'outils. SuperAGI inclut un large ensemble de toolkits intégrés : Google Search, DuckDuckGo, Web Scraper, File Manager, GitHub, Jira, Twitter, Notion, Google Calendar, DALL‑E, un Coding Toolkit et un outil de recherche de connaissances basé sur des bases vectorielles. Des toolkits communautaires pour Slack, Instagram ou d'autres services de génération d'images peuvent aussi être disponibles selon votre configuration. J'aborderai l'intégration d'outils plus loin.

-

GUI web. Une interface Next.js accessible sur

localhost:3000permet de créer des agents, d'assigner des outils, de suivre l'activité en temps réel, de configurer les fournisseurs de modèles, de planifier des agents et de parcourir la marketplace. -

Agent Performance Monitoring (APM). Introduit en version 0.0.8, le tableau de bord APM est un vrai point de différenciation de SuperAGI. Il fournit des métriques au niveau organisation (nombre d'agents, tokens consommés, exécutions totales), des décompositions par modèle (agents, exécutions et tokens par LLM) et des analyses au niveau agent (moyenne de tokens par run, appels API totaux et durée). Des cartes de métriques réorganisables permettent de personnaliser la mise en page.

-

Orchestration multi-agents. Vous pouvez exécuter plusieurs agents en parallèle, chacun avec des objectifs, outils et modèles LLM différents, le tout piloté depuis la même interface.

-

Action Console. C'est la fonctionnalité human-in-the-loop. En mode permissions restreintes, les agents s'interrompent avant des actions sensibles (envoi d'e‑mails, écriture de fichiers, etc.) et attendent votre validation dans l'Action Console. C'est un garde-fou pour les opérations à risque.

-

Support des bases vectorielles. SuperAGI prend en charge Weaviate, Pinecone et Qdrant pour la mémoire à long terme via des embeddings vectoriels. Le contexte à court terme est maintenu dans le run de l'agent, tandis que les connaissances à long terme persistent entre les runs dans la base vectorielle.

-

Marketplace. Une marketplace communautaire propose des outils, toolkits, templates d'agents, embeddings de connaissances et modèles. Vous pouvez parcourir et installer directement depuis la GUI.

Tableau de bord principal de SuperAGI avec métriques APM. Image de l'auteur.

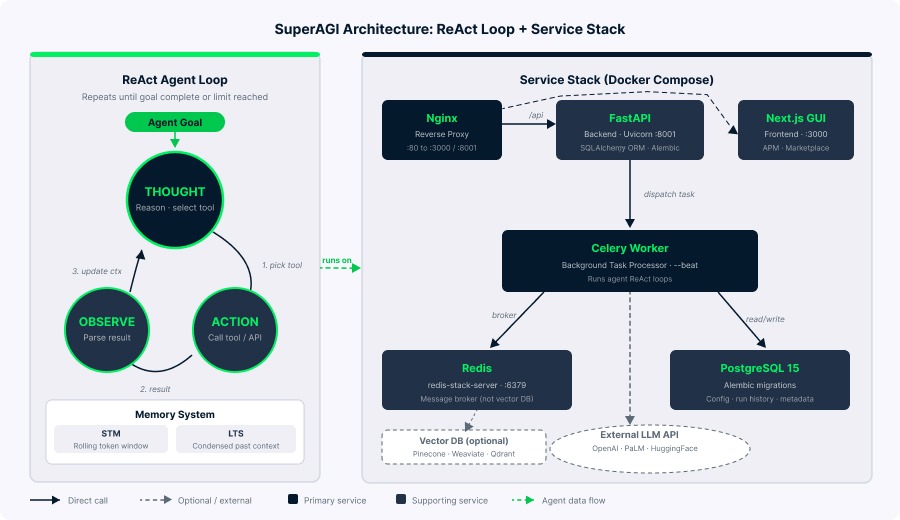

Fonctionnement de SuperAGI : vue d'ensemble de l'architecture

Une idée reçue fréquente est que SuperAGI utilise une boucle « planifier, exécuter, réfléchir, itérer ». Cette formulation est courante dans des billets tiers, mais l'implémentation ressemble plutôt au schéma ReAct (Reason + Act). SuperAGI implémente une boucle Pensée → Action → Observation : l'agent raisonne sur l'état courant, choisit un outil, observe le résultat et répète. ReAct alterne des étapes de raisonnement (« Thought ») et des appels d'outils (« Action »), guidés par les observations.

La pile technique, vérifiée dans le docker-compose.yaml et le code source, se décompose ainsi :

|

Composant |

Technologie |

|

Framework web |

FastAPI |

|

File d'attente |

Celery |

|

Broker de messages |

Redis (redis-stack-server) |

|

Base de données |

PostgreSQL 15 |

|

ORM |

SQLAlchemy |

|

Migrations |

Alembic |

|

Frontend |

Next.js |

|

Reverse proxy |

Nginx |

|

Langage |

Python |

Le backend utilise Uvicorn sur le port 8001, avec Nginx qui proxifie /api vers le backend et toutes les autres routes vers la GUI Next.js. Celery gère les tâches en arrière-plan avec --beat pour les opérations planifiées. PostgreSQL stocke la configuration des agents, l'historique d'exécution et les métadonnées. Par défaut, Redis sert surtout de broker de messages Celery, et non de base vectorielle, malgré certaines affirmations tierces.

Pour la mémoire, SuperAGI utilise un système en deux parties. La mémoire à court terme (STM) est une fenêtre glissante basée sur la limite de tokens du LLM, tandis que le résumé long terme (LTS) condense le contexte en dehors de la fenêtre STM. Ensemble, ils constituent le résumé d'agent utilisé à chaque étape de raisonnement. Les bases vectorielles gèrent séparément les embeddings de connaissances.

Architecture de SuperAGI avec boucle d'agent ReAct. Image de l'auteur.

Mise en place de SuperAGI

Avant de commencer, assurez-vous d'avoir Docker Desktop, Git et l'accès à au moins un fournisseur de LLM pris en charge (par exemple une clé d'API OpenAI). Comptez 3 à 4 Go de RAM pour l'ensemble de la pile. Sous Windows, WSL2 doit être activé.

Installer SuperAGI avec Docker

Docker est la méthode recommandée et la plus fiable. Le processus se déroule en quelques étapes claires.

Cloner et configurer

Procédure :

# Cloner le dépôt

git clone https://github.com/TransformerOptimus/SuperAGI.git

# Accéder au répertoire du projet

cd SuperAGI

# Copier le template de configuration

cp config_template.yaml config.yamlOuvrez config.yaml dans un éditeur et configurez votre fournisseur de LLM. Pour OpenAI, renseignez OPENAI_API_KEY. Entrez vos clés sans guillemets ni espaces superflus :

# Fournisseur LLM (choisissez-en un ou plusieurs)

OPENAI_API_KEY: sk-your-openai-key-here

# PALM_API_KEY: your-palm-key-here

# HUGGING_FACE_API_KEY: your-hf-key-here

# Optionnel : pour l'outil Google Search

GOOGLE_API_KEY: your-google-key

SEARCH_ENGINE_ID: your-cse-id

# Optionnel : pour la base vectorielle Pinecone

PINECONE_API_KEY: your-pinecone-keyConstruire et démarrer les conteneurs

Construisez et lancez les conteneurs :

# Construire et démarrer tous les services

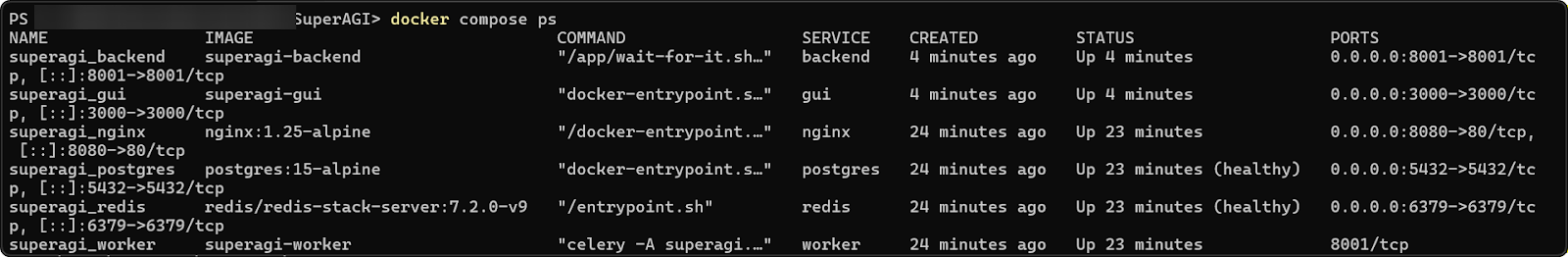

docker compose -f docker-compose.yaml up --buildLa première construction prend environ 10 à 15 minutes. Une fois les six conteneurs lancés (backend, celery, gui, redis, postgres et nginx), ouvrez http://localhost:3000 dans votre navigateur (port par défaut configuré pour la GUI via Nginx).

Conteneurs Docker SuperAGI construits avec succès. Image de l'auteur.

Vérifier l'installation

Pour tout vérifier, exécutez docker compose ps et confirmez que les six conteneurs sont listés. Puis accédez à localhost:3000, ouvrez Settings et vérifiez la prise en compte de vos clés API.

Problèmes courants et correctifs

Le dépôt officiel comporte plusieurs problèmes connus. Voici les plus fréquents et leurs correctifs.

Daemon Docker non démarré : assurez-vous que Docker Desktop est actif avant d'exécuter des commandes compose.

Erreur Celery « Unable to load application » : vérifiez que votre fichier s'appelle bien config.yaml et non config_template.yaml, puis reconstruisez avec docker compose down && docker compose up --build.

Erreur de clé de chiffrement : si vous voyez ValueError: Encryption key must be 32 bytes long, assurez-vous que ENCRYPTION_KEY dans config.yaml fait exactement 32 caractères et est entre guillemets :

ENCRYPTION_KEY: "abcdefghijklmnopqrstuvwxyz123456"

JWT_SECRET_KEY: "your-jwt-secret-key-change-this"Dépassement de mémoire JavaScript (conteneur GUI) : si la construction du GUI échoue, le conteneur Next.js a besoin de plus de mémoire. Ajoutez ceci au service gui dans docker-compose.yaml :

gui:

environment:

NODE_OPTIONS: "--max-old-space-size=1024"

deploy:

resources:

limits:

memory: 1gPermission refusée sur le port 80 (Windows) : Windows nécessite des droits admin pour le port 80. Modifiez le mapping de port Nginx dans docker-compose.yaml :

nginx:

ports:

- "8080:80" # Accès via localhost:8080Erreur de format d'URL Redis : si vous voyez ValueError: invalid literal for int() en lien avec Redis, supprimez le préfixe redis:// de REDIS_URL dans config.yaml :

REDIS_URL: "redis:6379" # Pas redis://redis:6379/0Boucle de redémarrage du conteneur backend : si le backend redémarre sans logs d'erreur, la commande de démarrage manque peut-être. Vérifiez qu'un entrypoint adéquat est défini dans docker-compose.yaml.

Conflits de ports : si le port 3000 ou 8080 est déjà utilisé, modifiez les mappings de ports dans docker-compose.yaml.

Support GPU

Pour l'accélération GPU avec des LLM locaux (ajoutée en v0.0.14), utilisez le fichier compose séparé :

docker compose -f docker-compose-gpu.yml up --buildCela exige un GPU NVIDIA avec NVIDIA Container Toolkit configuré pour le runtime GPU de Docker.

Installer SuperAGI manuellement (setup développeur)

Cette méthode n'est pas officiellement recommandée mais fonctionne pour le développement et le débogage. Vous devrez configurer séparément le backend et le frontend.

Configuration du backend

# Cloner et entrer dans le répertoire

git clone https://github.com/TransformerOptimus/SuperAGI.git

cd SuperAGI

# Créer et activer un environnement virtuel

pip install virtualenv

virtualenv venv

source venv/bin/activate # Windows : venv\Scripts\activate

# Installer les dépendances Python

pip install -r requirements.txt

# Copier et éditer la config

cp config_template.yaml config.yaml

# Éditer config.yaml : définir POSTGRES_URL sur localhost, REDIS_URL sur localhost:6379

# Démarrer le backend

./run.sh # Windows : .\run.batNotez que les dépendances Python sont verrouillées sur des versions anciennes (openai==0.27.7, FastAPI==0.95.2), ce qui peut entraîner des conflits dans des environnements récents. L'isolement via un environnement virtuel est essentiel.

Configuration du frontend

Pour le frontend, allez dans ./gui et exécutez npm install && npm run dev. Vous devez créer manuellement une base PostgreSQL nommée super_agi_main avec l'utilisateur superagi et le mot de passe password. Redis doit également tourner séparément.

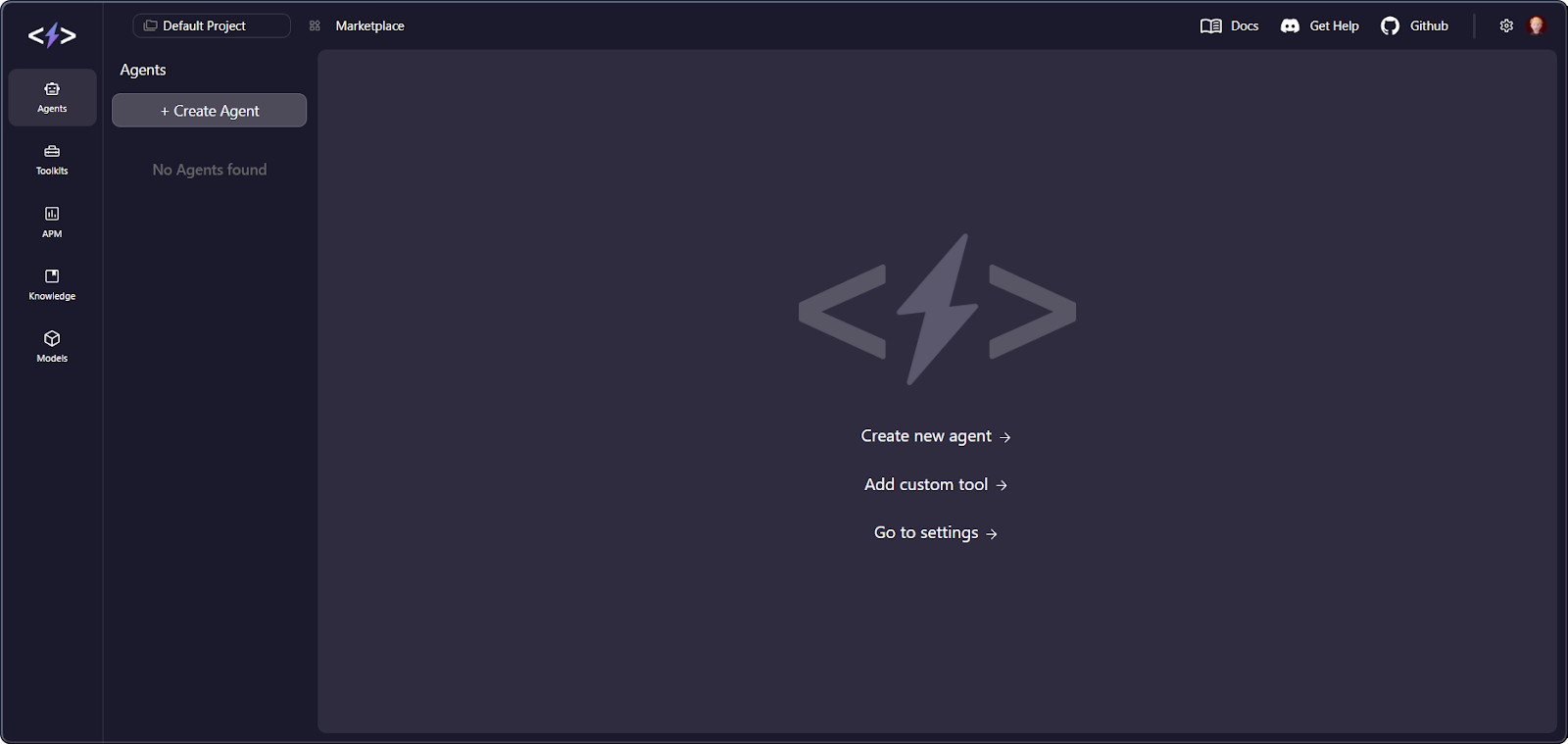

Créer et gérer des agents dans SuperAGI

Maintenant que SuperAGI est installé, voyons comment créer et lancer votre premier agent.

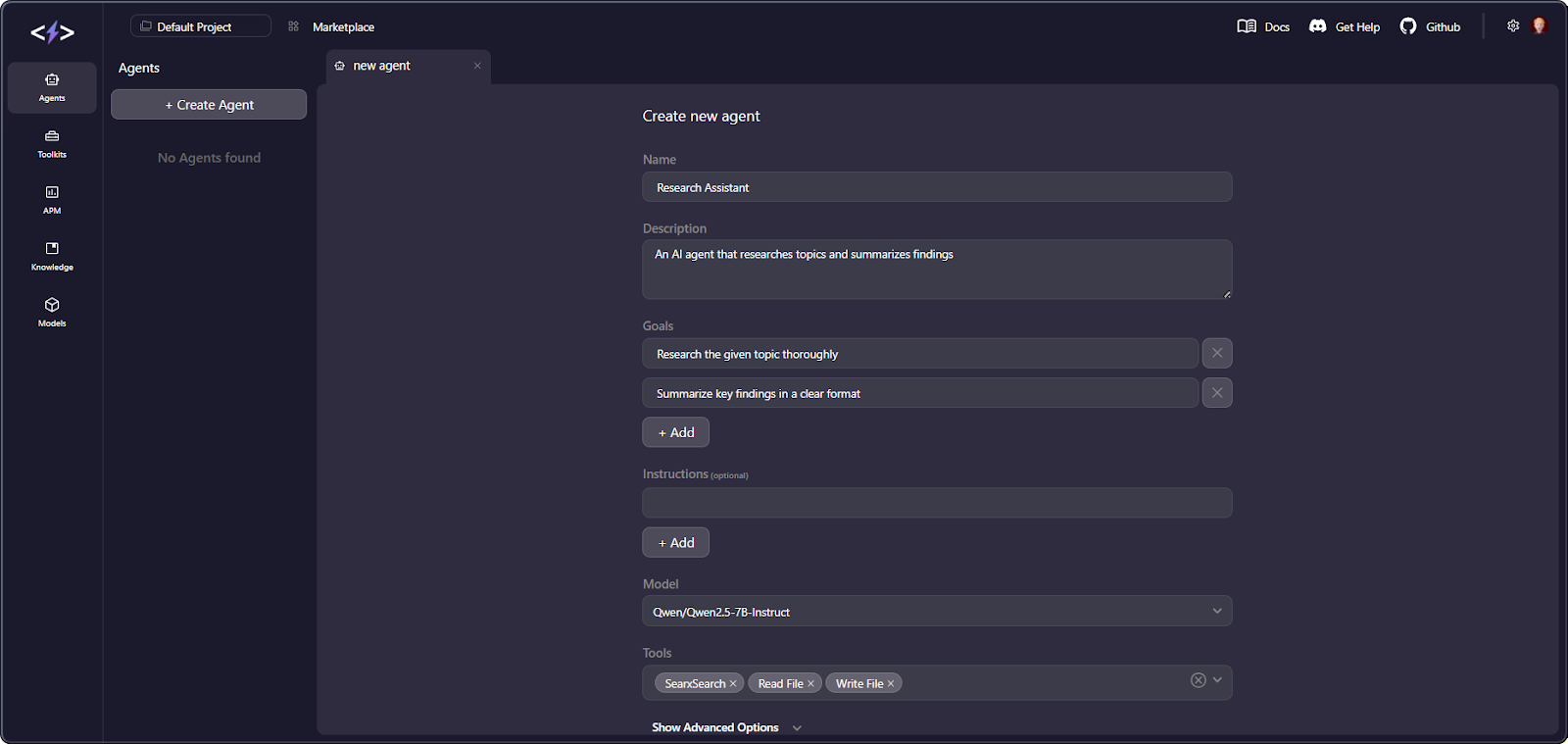

Configuration d'un agent

Avec SuperAGI en cours d'exécution, accédez à l'onglet Agents et cliquez sur « Create Agent ». L'écran de provisionnement demande plusieurs champs : nom, description, objectifs (chaînes de texte définissant ce que l'agent doit accomplir), instructions, contraintes, outils à assigner, modèle LLM à utiliser et limite d'itérations.

Limites d'itérations et contrôle des coûts

La limite d'itérations est votre principal levier de coût et de sécurité. Chaque itération génère au moins un appel LLM, et des agents complexes peuvent consommer beaucoup de tokens. Débutez bas (10‑15) le temps d'apprendre, puis augmentez au fur et à mesure que vous comprenez le comportement de l'agent.

Modes d'autorisation

Deux modes existent. Le « God Mode » laisse l'agent exécuter librement. Le mode restreint interrompt avant les actions critiques et requiert votre approbation via l'Action Console. Pour démarrer, le mode restreint est une bonne pratique.

Exécution et supervision des agents

Après configuration, vous pouvez lancer l'agent et suivre sa progression en temps réel.

Une fois créé, cliquez sur « Create and Run ». Le flux d'activité offre une visibilité en temps réel du raisonnement, des choix d'outils et des résultats. Vous pouvez mettre en pause, reprendre ou arrêter à tout moment. Le tableau de bord APM agrège les métriques sur tous les agents et runs pour une vue d'ensemble.

Création d'un nouvel agent dans l'interface SuperAGI. Image de l'auteur.

Accès programmatique

Si vous préférez le code à la GUI, SuperAGI prévoit ce cas.

SuperAGI propose également des SDK Python et Node.js qui exposent les mêmes opérations CRUD sur les agents que la GUI (voir la documentation officielle pour des exemples).

Intégration des outils dans SuperAGI

Les outils sont la façon dont les agents interagissent avec le monde extérieur. Vous assignez des outils à la création de l'agent, et le LLM choisit lesquels utiliser selon la tâche.

SuperAGI est livré avec un ensemble solide d'outils intégrés et permet d'en créer sur mesure. Voici ce que vous obtenez par défaut.

Toolkits intégrés

Voici un résumé des principaux toolkits :

|

Toolkit |

Description |

Clé API requise ? |

|

Google Search |

Recherche web via l'API Google Custom Search |

Oui |

|

DuckDuckGo |

Recherche web axée sur la confidentialité |

Non |

|

Coding Toolkit |

WriteCode, WriteSpec, WriteTest, ImproveCode |

Non |

|

File Manager |

Lire, écrire, ajouter, supprimer des fichiers |

Non |

|

Web Scraper |

Extraire des données de pages web |

Non |

|

GitHub |

Recherche de dépôts, opérations sur fichiers, pull requests |

Oui |

|

Jira |

Gestion des tickets (opérations CRUD) |

Oui |

|

|

Envoi d'e‑mails avec pièces jointes |

Oui |

|

DALL-E |

Génération d'images via OpenAI |

Oui |

|

Knowledge Search |

Recherche sémantique sur des embeddings vectoriels |

Non (nécessite une base vectorielle) |

|

Thinking Tool |

Raisonnement interne avec support de mémoire long terme |

Non |

Outils personnalisés

Au-delà des options intégrées, vous pouvez étendre SuperAGI avec vos propres toolkits.

Pour créer des outils sur mesure, installez le paquet superagi-tools, étendez les classes BaseTool et BaseToolkit, définissez les schémas d'entrée avec Pydantic et enregistrez le toolkit via l'URL de son repo GitHub dans la GUI. Après ajout, reconstruisez avec docker compose down && docker compose up --build.

Considérations de sécurité pour l'accès aux outils

L'accès aux outils introduit des risques de sécurité à traiter avec soin.

Attention aux accès non restreints : un agent avec accès e‑mail et web peut théoriquement être détourné via une injection de prompt pour exfiltrer des données. Des droits d'écriture sans sandbox peuvent entraîner des modifications non souhaitées. Utilisez toujours le mode restreint et n'assignez que les outils nécessaires aux objectifs spécifiques de chaque agent.

SuperAGI vs. AutoGPT

La comparaison est pertinente car les deux frameworks visent le même espace problème, mais ont fortement divergé.

|

Dimension |

SuperAGI |

AutoGPT |

|

Communauté GitHub |

Milliers d'étoiles |

Communauté nettement plus vaste |

|

Dernière version |

v0.0.14 (janv. 2024) |

Publications continues jusqu'en 2025 |

|

Statut de maintenance |

Activité minimale depuis 2024 |

Développement actif |

|

Architecture |

Framework d'agent ReAct |

Plateforme de workflows par blocs |

|

UI |

Tableau de bord web avec APM |

Builder Next.js drag‑and‑drop |

|

Observabilité |

APM intégré (plus abouti) |

Dashboard avec intégration Sentry |

|

Support LLM |

OpenAI, PaLM 2, HuggingFace, Replicate, local |

OpenAI, Anthropic, Groq, Ollama, et autres |

|

Licence |

MIT |

Double (MIT + Polyform Shield) |

Comparaison actuelle début 2026. Consultez les dépôts pour les dernières mises à jour.

La différence clé est philosophique. SuperAGI est un framework d'agents orienté développeurs : vous fixez des objectifs, les agents décident des étapes. AutoGPT a évolué vers une plateforme low‑code où l'on relie visuellement des blocs. SuperAGI propose une observabilité intégrée plus mature via son APM, mais AutoGPT bénéficie d'une communauté bien plus large, d'un développement actif et d'un support LLM plus étendu. Les deux restent instables en mode autonome très ouvert.

Pour des projets neufs aujourd'hui, AutoGPT est généralement l'option la mieux maintenue. Si vous souhaitez étudier une architecture d'agent propre ou avez besoin d'un APM intégré à des fins de recherche, SuperAGI reste intéressant pour l'apprentissage.

SuperAGI vs. LangChain

La caractérisation « SuperAGI = framework d'agents autonomes » contre « LangChain = trousse à outils d'orchestration LLM » est exacte.

|

Dimension |

SuperAGI |

LangChain |

|

Objectif principal |

Framework d'agents autonomes |

Boîte à outils d'orchestration LLM |

|

Niveau d'abstraction |

Élevé (centré agent, piloté par objectifs) |

Plus bas (centré chaînes, flux explicite) |

|

Multi-agents |

Support natif |

Via l'extension LangGraph |

|

Interface visuelle |

UI web intégrée |

Non (LangSmith pour le monitoring) |

|

Support des bases vectorielles |

3 (Pinecone, Weaviate, Qdrant) |

15+ intégrations |

|

Documentation |

Lacunes, lecture du code source nécessaire |

Très fournie, avec exemples |

|

Installation |

Docker Compose (setup plus lourd) |

pip install (léger) |

|

Stabilité en production |

Plus faible, expérimental |

Plus élevée, plus mature |

Quand choisir chac : utilisez LangChain lorsque vous avez besoin d'un contrôle fin sur chaque interaction LLM, pour des pipelines de RAG, des interfaces conversationnelles ou du traitement de documents. Choisissez SuperAGI si vous voulez des agents qui opèrent de manière indépendante, préférez un pilotage visuel plutôt que par code, ou avez besoin du support multi-agents avec GUI.

LangChain et LangGraph ont tous deux atteint la v1.0 en octobre 2025, LangGraph offrant une orchestration d'agents en production basée sur des graphes, avec workflows états conservés et observabilité poussée via LangSmith. Pour de nouveaux projets en production, LangGraph est généralement la voie la plus mature.

Cas d'usage de SuperAGI

Voici où SuperAGI excelle, d'après les exemples documentés et les usages de la communauté.

- Automatisation de tâches. Les agents gèrent des workflows e‑mail, des opérations fichiers et des recherches web planifiées. La planification intégrée (une planification par agent) facilite les tâches récurrentes.

- Assistants de recherche. En combinant recherche web, recherche de connaissances et export de fichiers, les agents rassemblent des informations multi-sources et produisent des livrables structurés.

- Productivité développeur. Les toolkits GitHub et Jira permettent la gestion automatisée des tickets, des revues de PR et de la génération de code. Le Coding Toolkit (WriteCode, WriteSpec, WriteTest, ImproveCode) couvre des workflows de dév de bout en bout.

- Création de contenus. En combinant DALL‑E pour l'image et des outils texte, on obtient des agents pour des workflows de contenu multimédia. Des toolkits communautaires pour d'autres générateurs d'images peuvent être disponibles.

- Gestion des réseaux sociaux. Le toolkit Twitter permet des publications automatisées avec médias, sous réserve de la disponibilité des API externes. D'autres toolkits communautaires peuvent exister selon votre setup.

- Gardez à l'esprit que les preuves d'adoption en entreprise sont faibles. Le marketing de SuperAGI cite de grands noms, mais considérez-le plutôt comme un outil d'expérimentation, de prototypage et d'apprentissage que comme une solution prête pour la production.

Limites de SuperAGI

Le projet est en pause. La dernière release taguée (v0.0.14) date de janvier 2024. Le dernier commit sur main était un patch de sécurité en janvier 2025. L'activité a fortement chuté après 2023, avec peu de nouvelles fonctionnalités visibles. De nombreux tickets récents restent sans réponse.

Les risques d'hallucination LLM s'amplifient en boucle d'agent. Lorsque des agents prennent des décisions sur la base de sorties LLM, des paramètres d'outil hallucines ou des faits inventés peuvent déclencher des actions réelles. Un agent multi-étapes sur dix cycles consomme bien plus de tokens qu'un flux linéaire, augmentant coûts et risques d'erreurs.

Les agents se bloquent fréquemment. Plusieurs issues GitHub signalent des agents coincés longtemps en « Thinking » sans progression. La limite d'itérations impose un arrêt, mais la consommation de ressources peut déjà être importante.

La documentation présente des lacunes. Même avant la mise hors ligne de certaines pages lors du pivot commercial, la doc était moins complète que chez LangChain. Travailler avec SuperAGI impose souvent de lire le code source.

Les coûts de tokens montent vite. Chaque étape de la boucle ReAct demande au moins un appel LLM. Selon la complexité, l'addition grimpe plus vite que pour des chaînes plus simples.

L'entreprise a pivoté. Comme indiqué plus haut, l'entreprise s'oriente vers un produit SaaS. Le site superagi.com ne met plus en avant le projet open source, et certaines pages de doc renvoient désormais des 404.

Considérations de sécurité

La sécurité révèle l'ancienneté de SuperAGI. Les systèmes agentiques amplifient l'impact des vulnérabilités, ce qui rend ces points d'autant plus critiques. Voici l'essentiel avant usage.

Secrets et configuration

Les clés d'API sont stockées en clair dans config.yaml sans chiffrement, ni intégration à un coffre-fort, ni rotation. Les champs ENCRYPTION_KEY et JWT_SECRET_KEY sont fournis avec des valeurs par défaut non sécurisées à changer avant toute utilisation au-delà de votre machine locale.

Isolation d'exécution

Les conteneurs Docker offrent une isolation de processus basique, sans sandbox avancé. Les agents ont un accès réseau non restreint et peuvent écrire sur le système de fichiers sans contrôles. Pour des déploiements plus sûrs, les recommandations de sandboxing de NVIDIA préconisent de restreindre l'accès réseau et les écritures disque, ce que SuperAGI n'implémente pas.

Vulnérabilités connues

Plusieurs vulnérabilités sévères (dont exécution de code à distance et fuites de configuration) ont été divulguées publiquement mais restent non corrigées en raison de l'inactivité du projet. Des rapports sont documentés sur hunter, une plateforme de divulgation. D'autres problèmes (SSRF, écritures arbitraires de fichiers, mauvaises configurations CORS) ont aussi été signalés.

Si vous dépendez de SuperAGI, consultez les forks communautaires pour des patchs et auditez systématiquement avant usage.

Risques d'injection de prompts

Les attaques par injection de prompt sont particulièrement dangereuses quand les agents peuvent agir dans le monde réel. SuperAGI est vulnérable aux injections directes et indirectes : des instructions malveillantes dans des pages scrapées peuvent détourner le comportement. Traitez toutes les sorties d'outils non fiables (notamment le web) comme des vecteurs d'attaque potentiels.

SuperAGI ne documente pas de défenses au-delà des validations manuelles de l'Action Console : utilisez toujours le mode permissions restreintes.

Recommandations de déploiement

Si vous déployez SuperAGI au-delà de tests locaux, appliquez au minimum : remplacement de tous les secrets par défaut, exécution derrière une authentification (VPN ou reverse proxy), mode permissions restreintes et attribution d'outils strictement nécessaires à chaque agent.

SuperAGI est-il prêt pour la production ?

Au vu de l'état de maintenance et de sécurité actuel, il ne répond pas aux critères habituels de disponibilité en production. SuperAGI le reconnaît lui-même : le README GitHub indique que le projet est « en cours de développement actif et peut encore présenter des problèmes ».

L'analyse plus fine est nuancée. La numérotation pré‑1.0 (v0.0.14) signale un statut expérimental. L'activité a connu un pic à mi‑2023 puis est retombée. Plusieurs vulnérabilités de sécurité ont été signalées avec peu de réponses publiques, et le pivot de l'entreprise vers des produits commerciaux laisse le framework open source sans feuille de route visible.

Le tableau de bord APM est un vrai point fort : plus mature que beaucoup d'alternatives par défaut, et un véritable différenciateur pour les équipes qui travaillent sur la recherche d'agents.

Conclusion

SuperAGI a introduit plusieurs idées qui ont influencé l'écosystème des agents : APM intégré, marketplace d'outils et gestion orientée GUI.

Cela dit, en 2026, le projet est à l'arrêt. L'entreprise a pivoté, des vulnérabilités de sécurité restent sans correctif et aucun nouveau développement n'est visible. Pour la production, des alternatives activement maintenues comme LangGraph, CrewAI et Microsoft Agent Framework sont à privilégier.

Pour aller plus loin, découvrez notre cours Introduction to AI Agents ou notre tutoriel sur la création d'IA locale avec Docker et n8n.

Je suis ingénieur de données et créateur de communautés. Je travaille sur les pipelines de données, le cloud et les outils d'IA, tout en rédigeant des tutoriels pratiques et percutants pour DataCamp et les développeurs émergents.

FAQs

Puis-je encore utiliser SuperAGI en 2026, ou est-il pratiquement à l'abandon ?

Oui, la base de code fonctionne encore. Vous pouvez la cloner, l'exécuter avec Docker et construire des agents. Le projet n'est toutefois plus maintenu : aucune release depuis janvier 2024 et des issues sans réponse. Excellent pour apprendre l'architecture d'agents, mais à éviter en production en raison de vulnérabilités non corrigées.

Dois-je apprendre SuperAGI en tant que débutant ?

Si vous voulez comprendre comment fonctionnent les agents autonomes en interne, oui. La base de code de SuperAGI est propre et bien structurée. La boucle ReAct, l'intégration d'outils et le tableau de bord APM sont d'excellents exemples pédagogiques. Mais si votre objectif est de construire des apps de production, commencez plutôt par LangGraph ou CrewAI : meilleure doc, communautés actives et fonctionnalités prêtes pour la production.

Comment SuperAGI se compare-t-il aux frameworks plus récents comme CrewAI ?

CrewAI se concentre sur la collaboration multi-agents par rôles et est activement maintenu avec des mises à jour régulières. SuperAGI adopte une approche « single-agent first ». Pour de nouveaux projets en 2026, CrewAI est un meilleur choix : développement actif, meilleure doc et écosystème en croissance. Choisissez CrewAI pour la collaboration par rôles, ou LangGraph pour une fiabilité de niveau production.

Ai-je besoin d'un GPU puissant pour exécuter SuperAGI ?

Non. Par défaut, SuperAGI appelle des fournisseurs de LLM via API, donc l'inférence se fait sur leurs serveurs. Il vous faut seulement environ 3 à 4 Go de RAM pour les conteneurs Docker. L'option GPU n'est pertinente que si vous exécutez des LLM locaux.

Quelle est la manière la moins coûteuse d'expérimenter avec SuperAGI ?

Utilisez des modèles abordables comme gpt-3.5-turbo ou des API gratuites comme Groq (accès gratuit aux modèles Llama). Réglez max iterations sur 10–15 et commencez par des agents simples à outil unique. Surveillez l'usage de tokens via le tableau de bord APM. Notez que HuggingFace Inference API a des incompatibilités avec les attentes de format OpenAI de SuperAGI ; preférez des fournisseurs compatibles OpenAI.