Curso

Frameworks de agentes autônomos de IA são projetados para sistemas que raciocinam por tarefas em múltiplas etapas, escolhem ferramentas de forma independente e executam ações em nome do usuário com menos intervenção manual. O SuperAGI implementa isso por meio de um loop no estilo ReAct e uma camada de orquestração com foco em GUI.

SuperAGI é um dos primeiros frameworks open source criados especificamente para esse propósito. Ele oferece aos desenvolvedores uma plataforma para criar, gerenciar e executar agentes orientados a objetivos por uma GUI web, com monitoramento embutido, marketplace de ferramentas e suporte a vários modelos de linguagem de grande porte (LLMs).

Neste guia, vou explicar o que é o SuperAGI, apresentar sua arquitetura e recursos, mostrar como instalá-lo com Docker e compará-lo com AutoGPT e LangChain. Também vou abordar seus pontos fortes, limitações e se ele é indicado para uso em produção.

Um aviso importante antes de começarmos: o SuperAGI como framework open source e a empresa SuperAGI já não seguem o mesmo caminho. A empresa migrou para um produto SaaS comercial focado em vendas com IA, e o repositório open source teve atividade mínima desde 2024. Este artigo se concentra no framework open source. Ao longo do texto, vou comentar o status atual de manutenção para você decidir com segurança se deve usá-lo.

O que é o SuperAGI?

O SuperAGI é um framework de agente autônomo de IA, open source e voltado para desenvolvedores, licenciado sob a MIT License. Foi criado por TransformerOptimus e acumulou milhares de estrelas no GitHub e mais de 2.000 forks desde seu lançamento em 2023. O projeto é escrito principalmente em Python (cerca de 70%), com JavaScript no frontend (cerca de 25%).

A ideia central é a seguinte: o SuperAGI não é um modelo. Ele é a camada de orquestração entre você, um LLM e as ferramentas que você quer que o agente use. Você define os objetivos do agente, atribui ferramentas (como busca na web, gerenciamento de arquivos ou integração com GitHub), escolhe um provedor de LLM e, então, o agente raciocina autonomamente sobre a tarefa, escolhe a ferramenta certa a cada etapa e itera até concluir o objetivo ou atingir o limite de iterações.

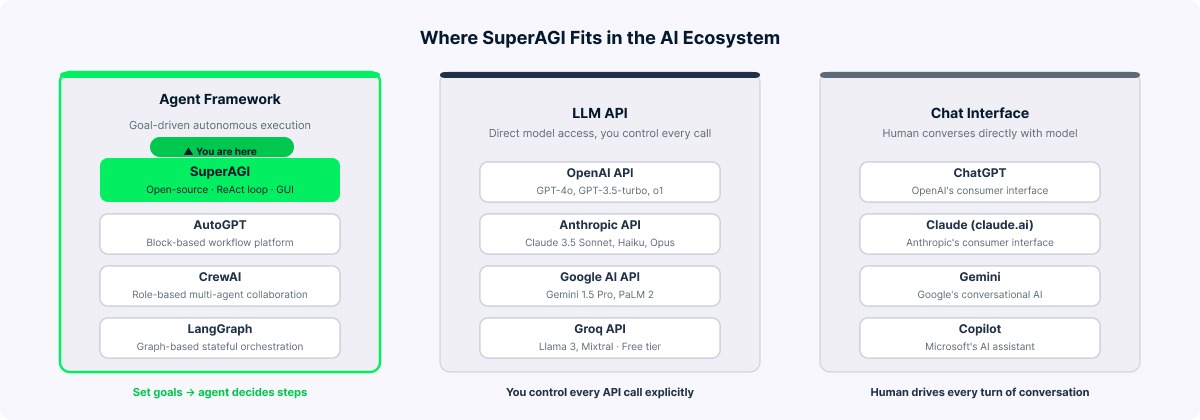

Três pontos importantes para entender onde o SuperAGI se encaixa no ecossistema.

Um framework de agente (como SuperAGI, AutoGPT ou CrewAI) orquestra a execução autônoma de tarefas usando LLMs combinados com ferramentas. Uma API de LLM (como as APIs da OpenAI ou da Anthropic) fornece acesso bruto ao modelo para geração de texto, e você controla cada chamada. Uma interface de chat (como ChatGPT ou Claude) é uma camada conversacional voltada ao usuário, onde humanos interagem diretamente com o modelo.

O SuperAGI está no nível de framework. Você define objetivos e o agente decide o que fazer. Isso é bem diferente tanto de conversar com um modelo quanto de fazer chamadas diretas à API.

SuperAGI como framework de agentes. Imagem do autor.

Recursos principais do SuperAGI

Agora que você já entendeu o que é o SuperAGI e como ele difere de ferramentas mais simples, veja o que ele traz por baixo do capô.

-

Agentes autônomos. Você provisiona agentes com objetivos, instruções, ferramentas e restrições específicos. Há três tipos de agente: Default (ciclo único pensar-executar), Fixed Task Queue (decompõe objetivos em subtarefas ordenadas) e Dynamic Task Queue (o agente pode adicionar novas tarefas durante a execução conforme descobre necessidades).

-

Sistema de integração de ferramentas. O SuperAGI inclui um conjunto amplo de toolkits nativos, como Google Search, DuckDuckGo, Web Scraper, File Manager, GitHub, Jira, Twitter, Notion, Google Calendar, DALL-E, um Coding Toolkit e uma ferramenta de Knowledge Search baseada em bancos vetoriais. Toolkits da comunidade para serviços como Slack, Instagram ou outros geradores de imagem também podem estar disponíveis dependendo do setup. Vou detalhar a integração de ferramentas mais adiante.

-

GUI baseada na web. Uma interface Next.js acessível em

localhost:3000oferece criação de agentes, atribuição de ferramentas, feed de atividades em tempo real, configuração de provedores de modelos, agendamento de agentes e navegação no marketplace. -

Agent Performance Monitoring (APM). Introduzido na versão 0.0.8, o dashboard de APM é um dos diferenciais reais do SuperAGI. Ele fornece métricas por organização (total de agentes, tokens consumidos, total de execuções), detalhamento por modelo (agentes, execuções e tokens por LLM) e analytics por agente (média de tokens por execução, total de chamadas de API e tempo de execução). Cards de métricas reordenáveis permitem personalizar o layout do painel.

-

Orquestração de múltiplos agentes. Você pode executar vários agentes simultaneamente, cada um com objetivos, ferramentas e modelos LLM distintos, todos gerenciados pela mesma GUI.

-

Action Console. Este é o recurso de human-in-the-loop. No modo de permissões restritas, os agentes pausam antes de ações críticas (como enviar e-mails ou escrever arquivos) e aguardam sua aprovação pelo Action Console. Isso cria uma barreira de segurança para operações sensíveis.

-

Suporte a bancos vetoriais. O SuperAGI suporta Weaviate, Pinecone e Qdrant para memória de longo prazo via embeddings vetoriais. O contexto de curto prazo é mantido durante a execução do agente, enquanto o conhecimento de longo prazo persiste entre execuções no banco vetorial.

-

Marketplace. Um marketplace comunitário reúne ferramentas, toolkits, templates de agentes, embeddings de conhecimento e modelos. Você pode navegar e instalar direto pela GUI.

Dashboard do SuperAGI com métricas de APM. Imagem do autor.

Como o SuperAGI funciona: visão geral da arquitetura

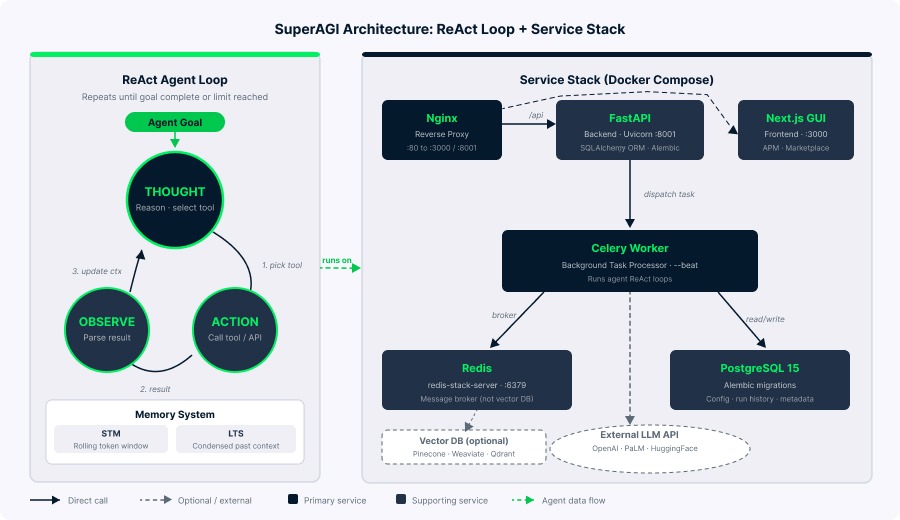

Um equívoco comum em artigos de terceiros é que o SuperAGI usa um loop "planejar, executar, refletir, iterar". Essa descrição é comum por aí, mas a implementação se assemelha mais ao padrão ReAct (Reason + Act). O SuperAGI implementa um loop Pensamento → Ação → Observação, em que o agente pensa sobre o estado atual, escolhe uma ferramenta, observa o resultado e repete. ReAct é um padrão de agente em que o modelo alterna entre etapas de raciocínio ("Thought") e chamadas de ferramentas ("Action"), guiado pelas observações.

A stack técnica, verificada a partir do docker-compose.yaml e do código-fonte, se divide assim:

|

Componente |

Tecnologia |

|

Framework web |

FastAPI |

|

Fila de tarefas |

Celery |

|

Message broker |

Redis (redis-stack-server) |

|

Banco de dados |

PostgreSQL 15 |

|

ORM |

SQLAlchemy |

|

Migrações |

Alembic |

|

Frontend |

Next.js |

|

Reverse proxy |

Nginx |

|

Linguagem |

Python |

O backend usa Uvicorn na porta 8001, com o Nginx fazendo proxy de /api para o backend e de todos os outros caminhos para a GUI em Next.js. O Celery processa tarefas em background com --beat para operações agendadas. O PostgreSQL armazena configuração dos agentes, histórico de execuções e metadados. No setup padrão, o Redis serve principalmente como message broker do Celery, não como banco vetorial, apesar de alguns relatos de terceiros.

Para memória, o SuperAGI usa um sistema em duas partes. A memória de curto prazo (STM) é uma janela deslizante baseada no limite de tokens do LLM, enquanto o resumo de longo prazo (LTS) condensa o contexto fora da janela de STM. Juntas, formam o Agent Summary que alimenta cada etapa de raciocínio. Bancos vetoriais tratam embeddings de conhecimento separadamente.

Arquitetura do SuperAGI com loop ReAct. Imagem do autor.

Configurando o SuperAGI

Antes de começar, garanta que você tenha o Docker Desktop, o Git e acesso a pelo menos um provedor de LLM suportado (por exemplo, uma chave de API da OpenAI). Espere que a stack completa use algo entre 3 e 4 GB de RAM. Se você estiver no Windows, também vai precisar do WSL2 habilitado.

Instalar o SuperAGI com Docker

O Docker é o método recomendado e mais confiável de instalação. O processo se divide em algumas etapas claras.

Clonar e configurar

Siga os passos:

# Clone o repositório

git clone https://github.com/TransformerOptimus/SuperAGI.git

# Entre no diretório do projeto

cd SuperAGI

# Copie o template de configuração

cp config_template.yaml config.yamlAbra o config.yaml em um editor de texto e configure seu provedor de LLM. Para OpenAI, defina OPENAI_API_KEY. Insira suas chaves sem aspas ou espaços extras:

# Provedor de LLM (escolha um ou mais)

OPENAI_API_KEY: sk-your-openai-key-here

# PALM_API_KEY: your-palm-key-here

# HUGGING_FACE_API_KEY: your-hf-key-here

# Opcional: para a ferramenta Google Search

GOOGLE_API_KEY: your-google-key

SEARCH_ENGINE_ID: your-cse-id

# Opcional: para o banco vetorial Pinecone

PINECONE_API_KEY: your-pinecone-keyBuild e inicialização dos containers

Agora faça o build e inicie os containers:

# Build e start de todos os serviços

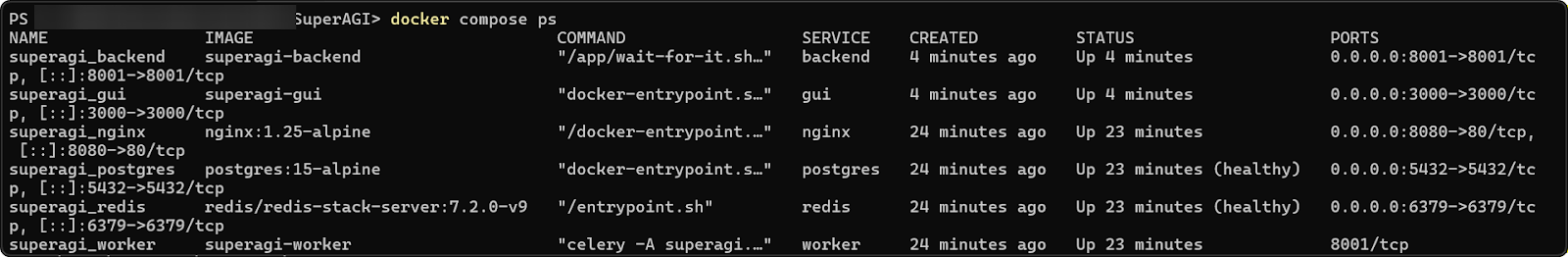

docker compose -f docker-compose.yaml up --buildO build inicial leva cerca de 10 a 15 minutos. Quando os seis containers estiverem rodando (backend, celery, gui, redis, postgres e nginx), abra http://localhost:3000 no navegador (a porta padrão configurada no compose para a GUI via Nginx).

Containers do SuperAGI construídos com sucesso. Imagem do autor.

Verificar a instalação

Para confirmar que tudo está funcionando, rode docker compose ps e verifique se os seis containers estão listados. Depois, vá para localhost:3000, acesse Settings e confira se sua configuração de API key foi detectada.

Problemas comuns e correções

O repositório oficial tem alguns issues conhecidos que você pode encontrar. Veja os mais comuns e como resolver.

Daemon do Docker não está rodando: garanta que o Docker Desktop esteja ativo antes de usar comandos compose.

Erro do Celery "Unable to load application": confira se o arquivo se chama exatamente config.yaml e não config_template.yaml; depois, reconstrua com docker compose down && docker compose up --build.

Erro de chave de criptografia: se aparecer ValueError: Encryption key must be 32 bytes long, garanta que ENCRYPTION_KEY no config.yaml tenha exatamente 32 caracteres e esteja entre aspas:

ENCRYPTION_KEY: "abcdefghijklmnopqrstuvwxyz123456"

JWT_SECRET_KEY: "your-jwt-secret-key-change-this"JavaScript heap out of memory (container da GUI): se o build da GUI falhar, o container do Next.js precisa de mais memória. Adicione isto ao serviço gui no docker-compose.yaml:

gui:

environment:

NODE_OPTIONS: "--max-old-space-size=1024"

deploy:

resources:

limits:

memory: 1gPermissão negada na porta 80 (Windows): o Windows exige privilégios de admin para a porta 80. Altere o mapeamento de porta do Nginx no docker-compose.yaml:

nginx:

ports:

- "8080:80" # Acesse via localhost:8080Erro de formato da URL do Redis: se aparecer ValueError: invalid literal for int() relacionado ao Redis, remova o prefixo redis:// de REDIS_URL no config.yaml:

REDIS_URL: "redis:6379" # Não use redis://redis:6379/0Loop de reinicialização do container de backend: se o backend continuar reiniciando sem logs de erro, pode estar faltando o comando de startup. Verifique se o docker-compose.yaml inclui um entrypoint adequado.

Conflitos de porta: se a porta 3000 ou 8080 já estiver em uso, edite os mapeamentos no docker-compose.yaml para usar portas diferentes.

Suporte a GPU

Para suporte a LLMs locais com aceleração por GPU (adicionado na v0.0.14), use o compose separado:

docker compose -f docker-compose-gpu.yml up --buildIsso requer uma GPU NVIDIA com o NVIDIA Container Toolkit configurado para runtime de GPU no Docker.

Instalar o SuperAGI manualmente (setup de desenvolvimento)

Este método não é oficialmente recomendado, mas funciona para desenvolvimento e depuração. Você precisará configurar backend e frontend separadamente.

Configuração do backend

# Clone e entre no diretório

git clone https://github.com/TransformerOptimus/SuperAGI.git

cd SuperAGI

# Crie e ative um ambiente virtual

pip install virtualenv

virtualenv venv

source venv/bin/activate # Windows: venv\Scripts\activate

# Instale as dependências Python

pip install -r requirements.txt

# Copie e edite a config

cp config_template.yaml config.yaml

# Edite o config.yaml: defina POSTGRES_URL para localhost, REDIS_URL para localhost:6379

# Inicie o backend

./run.sh # Windows: .\run.batAtenção: as dependências Python estão fixadas em versões antigas (openai==0.27.7, FastAPI==0.95.2), o que pode causar conflitos em ambientes modernos. Isolar em ambiente virtual é essencial.

Configuração do frontend

No frontend, acesse ./gui e rode npm install && npm run dev. Você precisa criar manualmente um banco PostgreSQL chamado super_agi_main com usuário superagi e senha password. Você também precisa do Redis executando separadamente.

Criando e gerenciando agentes no SuperAGI

Com o SuperAGI instalado, vamos ver como criar e executar seu primeiro agente.

Configuração do agente

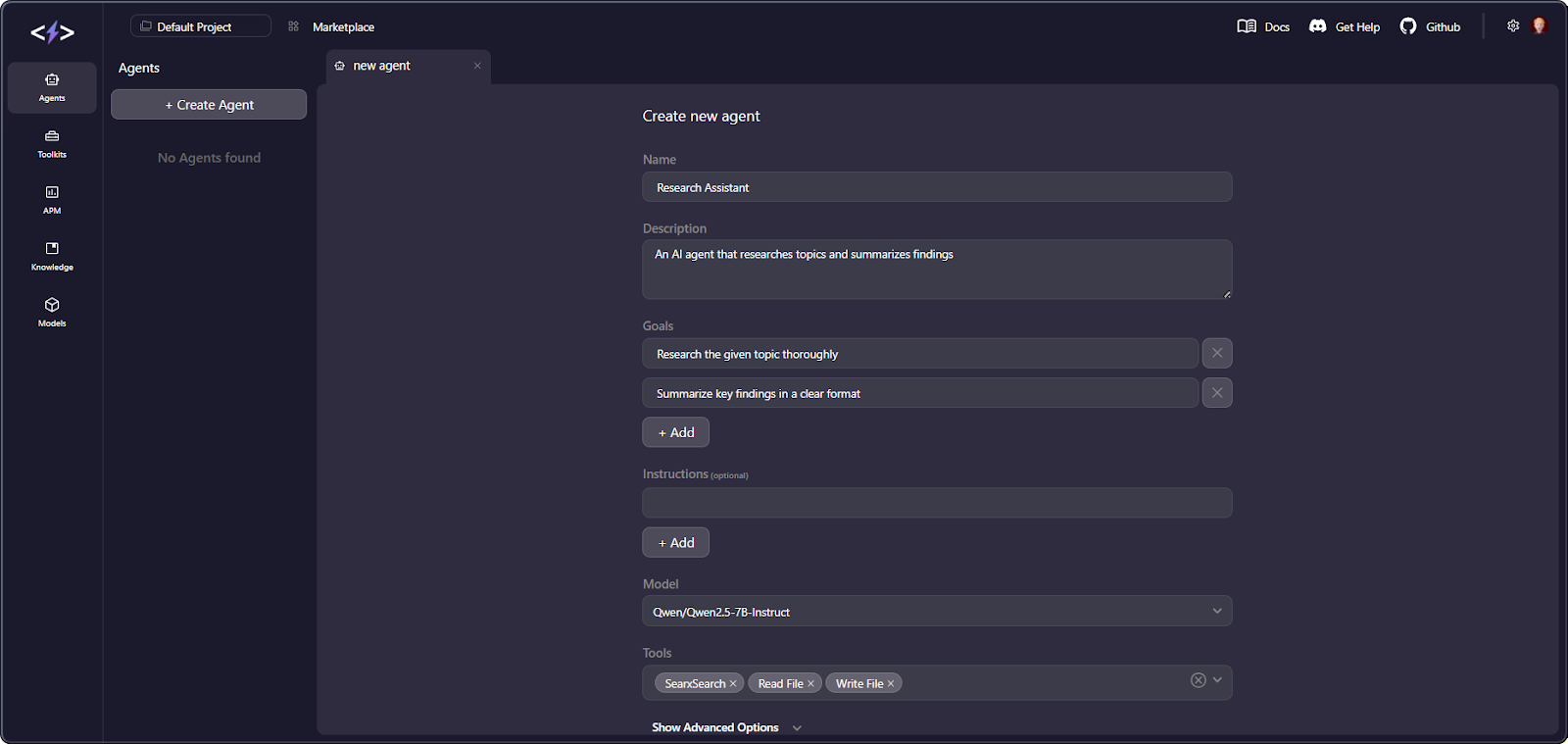

Com o SuperAGI rodando, vá até a aba Agents na GUI e clique em "Create Agent". A tela de provisionamento pede vários campos: nome, descrição, objetivos (textos que definem o que o agente deve cumprir), instruções, restrições, ferramentas a atribuir, o modelo LLM a usar e um limite de iterações.

Limites de iteração e controle de custos

O limite de iterações é seu principal controle de custo e de segurança. Cada iteração aciona pelo menos uma chamada ao LLM, e agentes complexos podem consumir tokens rapidamente. Comece com um número baixo (10 a 15) enquanto aprende e aumente conforme entender o comportamento do agente.

Modos de permissão

Existem dois modos de permissão. O "God Mode" deixa o agente executar livremente. O modo restrito pausa antes de ações críticas e requer sua aprovação pelo Action Console. Para quem está começando, iniciar no modo restrito é uma boa prática.

Executando e monitorando agentes

Depois de configurar o agente, você pode lançá-lo e acompanhar o progresso em tempo real.

Após criar, clique em "Create and Run". O Activity Feed traz visibilidade em tempo real do raciocínio do agente, seleção de ferramentas e saídas. Você pode pausar, retomar ou parar agentes a qualquer momento. O dashboard de APM, como mencionei antes, agrega métricas de todos os agentes e execuções para uma visão mais ampla.

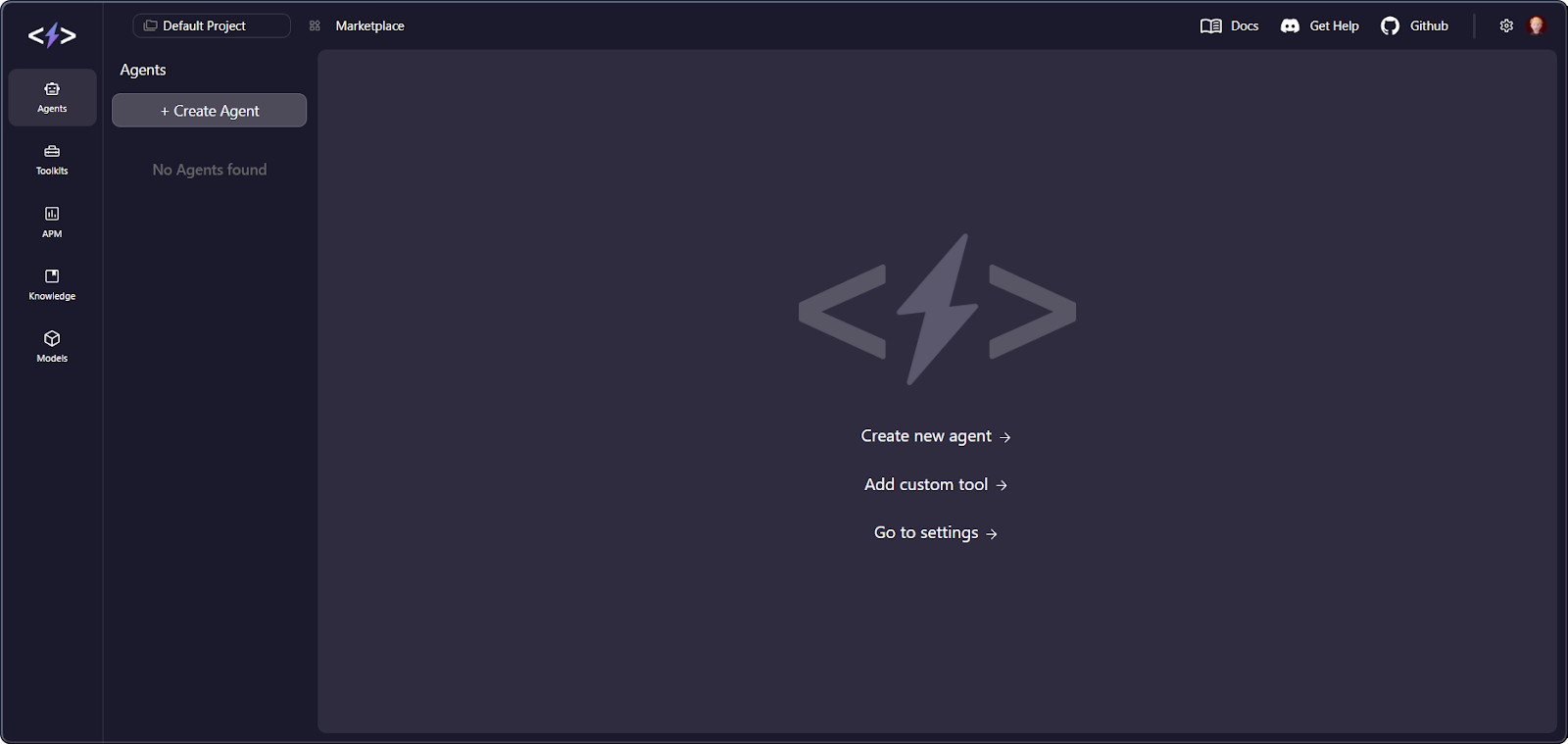

Criando um novo agente na interface do SuperAGI. Imagem do autor.

Acesso programático

Se você prefere trabalhar por código em vez da GUI, o SuperAGI atende bem.

O SuperAGI também fornece SDKs em Python e Node.js que expõem as mesmas operações CRUD de agentes disponíveis na GUI (consulte a documentação oficial para exemplos de uso).

Integração de ferramentas no SuperAGI

As ferramentas são como os agentes interagem com o mundo externo. Você atribui ferramentas específicas ao criar um agente, e o LLM decide quais usar durante a execução conforme a tarefa.

O SuperAGI vem com um conjunto robusto de ferramentas nativas e permite criar ferramentas personalizadas. Veja o que você tem pronto para uso.

Toolkits nativos

Aqui vai um resumo dos principais toolkits:

|

Toolkit |

Descrição |

Requer API key? |

|

Google Search |

Busca na web via Google Custom Search API |

Sim |

|

DuckDuckGo |

Busca na web com foco em privacidade |

Não |

|

Coding Toolkit |

WriteCode, WriteSpec, WriteTest, ImproveCode |

Não |

|

File Manager |

Ler, escrever, anexar e excluir arquivos |

Não |

|

Web Scraper |

Extrair dados de páginas web |

Não |

|

GitHub |

Busca em repositórios, operações de arquivo, pull requests |

Sim |

|

Jira |

Gestão de issues (operações CRUD) |

Sim |

|

|

Enviar e-mails com anexos |

Sim |

|

DALL-E |

Geração de imagens via OpenAI |

Sim |

|

Knowledge Search |

Busca semântica sobre embeddings vetoriais |

Não (requer banco vetorial) |

|

Thinking Tool |

Raciocínio interno com suporte a memória de longo prazo |

Não |

Ferramentas personalizadas

Além das opções nativas, você pode estender o SuperAGI com seus próprios toolkits.

Para criar ferramentas personalizadas, instale o pacote superagi-tools, estenda as classes BaseTool e BaseToolkit, defina schemas de entrada com Pydantic e registre o toolkit via URL do repositório no GitHub pela GUI. Depois de adicionar um toolkit personalizado, reconstrua com docker compose down && docker compose up --build.

Considerações de segurança para acesso a ferramentas

O acesso a ferramentas introduz riscos de segurança que merecem atenção.

Um alerta sobre acesso irrestrito a ferramentas: um agente com e-mail e web pode, em tese, ser explorado via prompt injection para exfiltrar dados. Escrita em arquivos sem sandbox pode permitir modificações indesejadas. Sempre use o modo restrito e atribua apenas as ferramentas necessárias aos objetivos de cada agente.

SuperAGI vs. AutoGPT

Esta é uma comparação de alto valor porque ambos os frameworks atacam o mesmo problema, mas tomaram rumos diferentes.

|

Dimensão |

SuperAGI |

AutoGPT |

|

Comunidade no GitHub |

Milhares de estrelas |

Comunidade substancialmente maior |

|

Último release |

v0.0.14 (jan/2024) |

Lançamentos contínuos até 2025 |

|

Status de manutenção |

Atividade mínima desde 2024 |

Desenvolvimento ativo |

|

Arquitetura |

Framework de agente ReAct |

Plataforma de workflows em blocos |

|

UI |

Dashboard web com APM integrado |

Builder Next.js drag-and-drop |

|

Observabilidade |

APM integrado (mais maduro) |

Dashboard com integração Sentry |

|

Suporte a LLMs |

OpenAI, PaLM 2, HuggingFace, Replicate, local |

OpenAI, Anthropic, Groq, Ollama e outros |

|

Licença |

MIT |

Dupla (MIT + Polyform Shield) |

Comparação atualizada no início de 2026. Confira os repositórios para as últimas novidades.

A principal diferença é filosófica. O SuperAGI é um framework de agente voltado para desenvolvedores, em que você define objetivos e os agentes descobrem os passos. O AutoGPT evoluiu para uma plataforma low-code de workflows, onde o usuário conecta blocos visualmente. O SuperAGI oferece observabilidade mais madura com seu dashboard de APM, mas o AutoGPT tem comunidade muito maior, desenvolvimento ativo e suporte mais amplo a LLMs. Ambos tendem a apresentar instabilidade em modo autônomo aberto.

Para novos projetos hoje, o AutoGPT geralmente é a opção mais ativamente mantida. Se você quer estudar arquitetura de agentes de forma limpa ou precisa de APM nativo para pesquisa, o SuperAGI ainda agrega valor como ferramenta de aprendizado.

SuperAGI vs. LangChain

A caracterização "SuperAGI é framework de agentes autônomos versus LangChain é toolkit de orquestração de LLMs" é correta.

|

Dimensão |

SuperAGI |

LangChain |

|

Propósito principal |

Framework de agente autônomo |

Toolkit de orquestração de LLM |

|

Nível de abstração |

Alto (centrado no agente, orientado a objetivos) |

Mais baixo (centrado em chains, fluxo explícito) |

|

Multiagente |

Suporte nativo |

Via extensão LangGraph |

|

Interface visual |

UI web integrada |

Não (LangSmith para monitoramento) |

|

Suporte a banco vetorial |

3 (Pinecone, Weaviate, Qdrant) |

15+ integrações |

|

Documentação |

Lacunas, exige ler o código-fonte |

Extensa, com exemplos |

|

Instalação |

Docker Compose (setup mais pesado) |

pip install (leve) |

|

Estabilidade em produção |

Menor, experimental |

Maior, mais madura |

Quando escolher cada um: use LangChain quando precisar de controle preciso sobre cada interação com o LLM, para pipelines de RAG, interfaces conversacionais ou processamento de documentos. Use SuperAGI quando quiser agentes que operem de forma independente com mínima intervenção, preferir gestão visual em vez de código ou desejar suporte multiagente nativo com GUI.

LangChain e LangGraph chegaram à v1.0 em outubro de 2025, com o LangGraph oferecendo orquestração de agentes baseada em grafos, pronta para produção, com workflows com estado e observabilidade profunda via LangSmith. Para novos projetos em produção, o LangGraph tende a ser o caminho mais maduro.

Casos de uso do SuperAGI

Aqui estão os cenários em que o SuperAGI funciona melhor, com base em exemplos documentados e uso da comunidade.

- Automação de tarefas. Agentes podem lidar com fluxos de e-mail, operações de arquivo e buscas web agendadas. O recurso de agendamento nativo (um agendamento por agente) facilita tarefas recorrentes.

- Assistentes de pesquisa. Ao combinar busca na web, busca em conhecimento e ferramentas de saída para arquivos, é possível criar agentes que reúnem informações em várias fontes e compilam resultados estruturados.

- Produtividade de desenvolvedores. Os toolkits GitHub e Jira habilitam automação de issues, reviews de PR e geração de código. O Coding Toolkit (WriteCode, WriteSpec, WriteTest, ImproveCode) suporta workflows de desenvolvimento ponta a ponta.

- Criação de conteúdo. Combinando DALL-E para geração de imagens com ferramentas de texto, dá para criar agentes para fluxos de conteúdo multimídia. Toolkits comunitários para outros serviços de imagem também podem estar disponíveis.

- Gestão de mídias sociais. O toolkit do Twitter permite postagens automatizadas com suporte a mídia, embora isso dependa da disponibilidade das APIs externas. Outros toolkits da comunidade podem estar disponíveis para diferentes plataformas, conforme o seu setup.

- Lembre-se de que há poucas evidências de adoção corporativa. O marketing do SuperAGI cita empresas conhecidas, mas encare-o como ferramenta para experimentação, prototipagem e aprendizado, não como uma solução pronta para produção.

Limitações do SuperAGI

O projeto está parado. O último release marcado (v0.0.14) saiu em janeiro de 2024. O último commit na main foi um patch de segurança em janeiro de 2025. A atividade de desenvolvimento caiu muito após 2023, com poucos recursos novos visíveis desde então. Muitos issues recentes parecem sem resposta no rastreador público.

Riscos de alucinação de LLM se amplificam em loops de agentes. Quando agentes tomam decisões com base na saída do LLM, parâmetros alucinados de ferramentas ou fatos fabricados podem virar ações reais. Um agente de múltiplas etapas rodando dez ciclos pode consumir muito mais tokens do que uma passagem linear, ampliando custo e risco de erro.

Agentes frequentemente ficam presos. Vários issues no GitHub relatam agentes travados em estado de "Thinking" por longos períodos sem progredir. O limite de iterações impõe um corte, mas o agente pode consumir muitos recursos até chegar lá.

A documentação tem lacunas. Mesmo antes de algumas páginas saírem do ar com a migração comercial da empresa, a documentação já era menos completa que a de concorrentes como o LangChain. Trabalhar com o SuperAGI muitas vezes exige ler o código-fonte diretamente.

Os custos de tokens crescem rápido. Cada etapa no loop ReAct exige pelo menos uma chamada ao LLM. Dependendo da complexidade, isso pode somar mais rápido do que implementações mais simples em chain.

A empresa mudou o foco. Como mencionado, a empresa migrou para um produto SaaS. O site superagi.com não destaca mais o projeto open source, e algumas páginas de documentação retornam 404.

Considerações de segurança

Segurança é onde o SuperAGI mostra sua idade. Sistemas agentic amplificam o impacto de vulnerabilidades, então esses pontos importam mais do que em um app tradicional. Veja o que você precisa saber antes de usá-lo.

Segredos e configuração

As chaves de API ficam em texto puro no config.yaml, sem criptografia, integração com cofre ou rotação. Os campos ENCRYPTION_KEY e JWT_SECRET_KEY vêm com valores inseguros de placeholder que devem ser trocados antes de qualquer deploy além do seu ambiente local.

Isolamento de execução

Containers Docker oferecem isolamento básico de processo, mas não há sandboxing avançado. Agentes têm acesso irrestrito à rede e podem escrever no filesystem sem controles. Para deploys mais seguros, a orientação de sandboxing da NVIDIA recomenda restringir acesso de rede e escritas no filesystem, o que o SuperAGI não implementa.

Vulnerabilidades conhecidas

Diversas vulnerabilidades de alta gravidade (incluindo execução remota de código e vazamento de configuração) foram divulgadas publicamente e permanecem sem patch devido à inatividade do projeto. Relatos estão documentados no hunter, uma plataforma de disclosure. Outros problemas como SSRF, escrita arbitrária de arquivos e configurações incorretas de CORS também foram reportados.

Se você depender do SuperAGI, verifique forks da comunidade em busca de correções e sempre audite qualquer fork antes de usá-lo.

Riscos de prompt injection

Ataques de prompt injection ficam especialmente perigosos quando agentes podem executar ações no mundo real. O SuperAGI é vulnerável a injeções diretas e indiretas; instruções maliciosas em páginas raspadas podem sequestrar o comportamento do agente. Trate toda saída de ferramentas não confiáveis (especialmente conteúdo web) como possível vetor de ataque.

O SuperAGI não documenta defesas além dos gates manuais do Action Console, então use sempre o modo de permissões restritas.

Recomendações de deploy

Se você for implantar o SuperAGI além de testes locais, adote pelo menos estas precauções: troque todos os segredos padrão, rode atrás de autenticação (VPN ou reverse proxy), use modo restrito e atribua apenas as ferramentas necessárias a cada agente.

O SuperAGI está pronto para produção?

Pelo status atual de manutenção e segurança, ele não atende aos critérios típicos de prontidão para produção. O próprio SuperAGI reconhece isso: o README do GitHub declara que o projeto está "em desenvolvimento ativo e pode apresentar problemas".

A avaliação completa é mais sutil. A versão pré-1.0 (v0.0.14) sinaliza status experimental. A atividade de desenvolvimento mostra um pico acentuado em meados de 2023 e mínima atividade depois. Várias vulnerabilidades de segurança foram reportadas com resposta pública limitada, e a migração da empresa para produtos comerciais significa que, no momento, não há roadmap visível indicando investimento renovado no framework open source.

O dashboard de APM é um ponto realmente positivo. Ele é mais maduro do que o que muitos concorrentes oferecem de fábrica e segue como um diferencial real do SuperAGI para times que pesquisam agentes.

Conclusão

O SuperAGI antecipou várias ideias que influenciaram o ecossistema de agentes: APM integrado, marketplace de ferramentas e gestão com foco em GUI.

Dito isso, a realidade de 2026 é que o projeto SuperAGI está parado. A empresa mudou o foco, vulnerabilidades de segurança seguem sem correção e não há desenvolvimento novo visível. Para produção, alternativas ativamente mantidas como LangGraph, CrewAI e Microsoft Agent Framework são escolhas melhores.

Como próximo passo, conheça nosso curso Introduction to AI Agents ou nosso tutorial sobre construir IA local com Docker e n8n.

Sou engenheiro de dados e criador de comunidades que trabalha com pipelines de dados, nuvem e ferramentas de IA, além de escrever tutoriais práticos e de alto impacto para o DataCamp e desenvolvedores iniciantes.

FAQs

Posso usar o SuperAGI em 2026, ou ele está efetivamente sem manutenção?

Sim, o código ainda funciona. Você pode clonar, rodar com Docker e criar agentes. Porém, o projeto está sem manutenção: sem releases desde janeiro de 2024 e issues sem resposta. Ótimo para aprender arquitetura de agentes, mas evite uso em produção por vulnerabilidades de segurança sem correção.

Vale a pena aprender SuperAGI como iniciante?

Se você quer entender como agentes autônomos funcionam nos bastidores, sim. O código do SuperAGI é limpo e bem estruturado. O loop ReAct, a integração de ferramentas e o dashboard de APM são ótimos exemplos para aprendizado. Mas, se o seu objetivo é construir apps de produção, comece por LangGraph ou CrewAI. Eles têm documentação melhor, comunidades ativas e recursos prontos para produção.

Como o SuperAGI se compara a frameworks mais novos como o CrewAI?

O CrewAI foca em colaboração multiagente baseada em papéis e é ativamente mantido, com atualizações frequentes. O SuperAGI adota uma abordagem single-agent-first. Para novos projetos em 2026, o CrewAI é a melhor escolha: tem desenvolvimento ativo, documentação melhor e um ecossistema em crescimento. Escolha CrewAI para colaboração baseada em papéis, ou LangGraph para confiabilidade em produção.

Preciso de uma GPU potente para rodar o SuperAGI?

Não. O SuperAGI chama provedores de LLM via API por padrão, então a inferência acontece nos servidores deles. Você precisa de cerca de 3 a 4 GB de RAM para os containers do Docker. A opção de GPU só é relevante se você quiser rodar LLMs locais.

Qual é a forma mais barata de experimentar o SuperAGI?

Use modelos acessíveis como gpt-3.5-turbo ou APIs gratuitas como a Groq (que oferece acesso grátis a modelos Llama). Defina máximo de iterações em 10–15 e comece com agentes simples de uma única ferramenta. Monitore o uso de tokens pelo dashboard de APM. Observe que a HuggingFace Inference API tem incompatibilidades com as expectativas de formato OpenAI do SuperAGI; portanto, mantenha-se em provedores compatíveis com OpenAI.