Curso

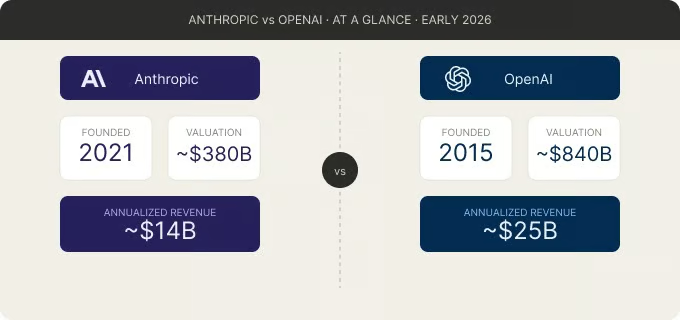

Se você trabalha com grandes modelos de linguagem (LLMs), certamente já utilizou um produto da OpenAI ou da Anthropic, ou de ambas. A OpenAI popularizou a categoria com o ChatGPT, que, segundo relatos, possui centenas de milhões de usuários ativos semanais. A Anthropic, fundada em 2021 por ex-pesquisadores da OpenAI, tornou-se a segunda maior empresa de IA em receita, com analistas estimando sua receita anualizada na casa das dezenas de bilhões.

Mas esta não é apenas uma comparação de modelos. A Anthropic e a OpenAI representam duas abordagens diferentes para a construção de IA. A OpenAI focou no alcance amplo ao consumidor e na integração multimodal. A Anthropic focou na confiança corporativa, na pesquisa de segurança e no processamento de contextos profundos.

O que é a OpenAI?

OpenAI é a empresa por trás do ChatGPT, da família de modelos GPT, do DALL-E e do Sora. Foi fundada em 2015 em São Francisco, originalmente como uma organização sem fins lucrativos. Em outubro de 2025, concluiu uma reestruturação para se tornar uma Public Benefit Corporation (PBC), dissolvendo o antigo modelo de lucro limitado. O braço sem fins lucrativos foi renomeado para OpenAI Foundation, que mantém o poder de nomeação do conselho e aproximadamente 26% do capital social.

A parceria da OpenAI com a Microsoft é central para sua operação. O Azure é o provedor de nuvem exclusivo para as chamadas de API da OpenAI, e a OpenAI comprometeu-se com US$ 250 bilhões em serviços Azure durante a vigência do contrato. A parceria foi reafirmada publicamente em fevereiro de 2026, mesmo com a OpenAI levantando US$ 110 bilhões em sua rodada de financiamento mais recente, reportada como uma das maiores rodadas de financiamento privado já registradas.

No lado do produto, a OpenAI seguiu uma estratégia de iteração rápida e descontinuação agressiva de modelos. Em fevereiro de 2026, a empresa aposentou vários modelos legados do ChatGPT, incluindo o GPT-4o e o GPT-4.1. Em março de 2026, a série intermediária GPT-5.1 também foi aposentada. Isso mantém a linha de produtos focada, mas exige que os desenvolvedores fiquem atentos aos cronogramas de migração.

A família GPT-5 é a geração atual da OpenAI. Foi lançada em agosto de 2025 com uma arquitetura de "roteador" que seleciona automaticamente entre modos de raciocínio rápido (Instant) e profundo (Thinking), dependendo da complexidade da consulta. Os principais modelos a conhecer são:

- GPT-5.4 (lançado em março de 2026, o carro-chefe mais recente com uma janela de contexto de 1,05 milhão de tokens),

- GPT-5.3 Codex (o especialista em codificação agentica), e

- GPT-5.2 (o carro-chefe anterior, agora sendo aposentado).

- Também lançados em março de 2026 estão o GPT-5.4 mini e GPT-5.4 nano, variantes menores criadas para velocidade e menor custo. O GPT-5.4 mini mantém a maior parte das forças de codificação, uso de ferramentas e multimodalidade do GPT-5.4, enquanto roda mais de duas vezes mais rápido. O GPT-5.4 nano é voltado para tarefas mais simples de alto volume.

- A OpenAI também lançou modelos de pesos abertos (gpt-oss-120b e gpt-oss-20b sob a licença Apache 2.0), uma mudança notável em relação à sua abordagem historicamente fechada.

O que é a Anthropic?

Anthropic é a empresa por trás da família de modelos Claude. Foi fundada em 2021 por Dario Amodei (CEO), Daniela Amodei (Presidente) e cerca de dez outros ex-pesquisadores da OpenAI que saíram devido a divergências sobre prioridades de segurança e comercialização.

A identidade técnica da empresa centra-se na Constitutional AI, uma abordagem de treinamento onde o modelo autocritica suas saídas em relação a um conjunto escrito de princípios éticos, em vez de depender apenas do feedback humano. A Anthropic publicou uma revisão da Constituição do Claude em janeiro de 2026, mudando de uma abordagem de alinhamento baseada em regras para uma baseada em raciocínio: em vez de apenas dizer ao modelo o que seguir, a constituição explica por que as regras existem, com o objetivo de permitir um julgamento mais sutil em situações novas.

O principal parceiro de nuvem e treinamento da Anthropic é a Amazon Web Services (AWS), com a Amazon investindo um total de US$ 8 bilhões. Os modelos Claude também estão disponíveis no Google Cloud Vertex AI (o Google detém cerca de 14% da Anthropic) e, a partir de março de 2026, também no Microsoft Foundry.

A família Claude 4 é a geração atual. A convenção de nomenclatura usa três níveis: Opus (carro-chefe, mais capaz), Sonnet (equilibrado) e Haiku (rápido e econômico). Os modelos mais recentes são:

- Claude Opus 4.6 (lançado em fevereiro de 2026, o modelo de raciocínio de nível superior com uma janela de contexto de 1 milhão de tokens e 128K de saída máxima)

- Claude Sonnet 4.6 (também de fevereiro de 2026, o padrão para usuários gratuitos e pagos com uma janela de contexto de 1M), e

- Claude Haiku 4.5 (lançado em outubro de 2025, a opção econômica).

Além dos modelos principais, a Anthropic lançou o Claude Code (um agente de codificação baseado em terminal), agentes estilo desktop para trabalho de conhecimento não técnico e SDKs de agente para Python e TypeScript para construir fluxos de trabalho agenticos personalizados.

Anthropic vs. OpenAI: Comparação das capacidades dos modelos

Ambas as plataformas são capazes em uma ampla gama de tarefas, mas seus pontos fortes diferem. Não existe um único modelo melhor para tudo. Deixe-me detalhar por categoria.

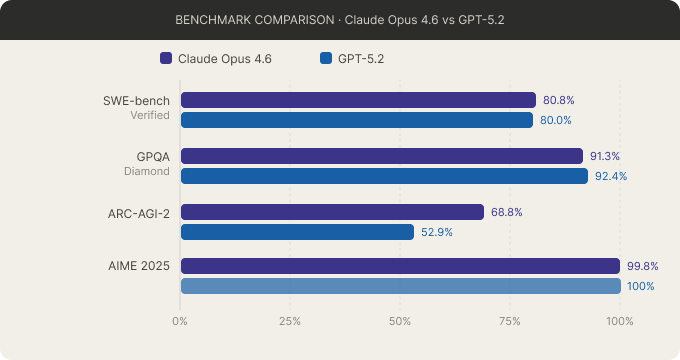

Pontuações de benchmark em quatro testes principais. Imagem do autor.

Raciocínio e resolução de problemas

Ambas as empresas agora oferecem raciocínio híbrido, onde um único modelo pode alternar entre respostas rápidas e pensamento estendido (chain-of-thought). O Claude introduziu isso primeiro com o Claude 3.7 Sonnet em fevereiro de 2025. A OpenAI seguiu com o roteador unificado do GPT-5 em agosto de 2025.

Nos benchmarks, o cenário é misto:

- AIME 2025 (competição de matemática): O GPT-5.2 lidera, incluindo uma pontuação perfeita em algumas configurações de teste.

- GPQA Diamond (ciência de nível de pós-graduação): O GPT-5.2 supera o Claude por uma pequena margem.

- ARC-AGI-2 (lógica visual nova, difícil de memorizar a partir de dados de treinamento): análises independentes colocam o Claude Opus 4.6 em cerca de 68-69%, contra 52-54% do GPT-5.2.

- Humanity's Last Exam (síntese de nível especialista): O Claude lidera com base nas comparações disponíveis.

Com base nos resultados dos benchmarks, a OpenAI parece ter um desempenho melhor em lógica determinística e recuperação factual, enquanto a Anthropic tende a ter um desempenho melhor em síntese contextual e análise qualitativa. Nenhuma das abordagens é universalmente melhor. Depende do que você precisa que o modelo faça.

Para uma análise mais detalhada de como o GPT-5.4 e o Claude Opus 4.6 se comparam especificamente nesses benchmarks, veja nosso detalhamento GPT-5.4 vs. Claude Opus 4.6.

Codificação e uso por desenvolvedores

Ambas as empresas foram muito além da simples geração de código para ferramentas de codificação agentica, mas adotam abordagens muito diferentes.

O Claude Code roda localmente, indexa sua base de código e pede aprovação antes de modificar arquivos. O Claude Opus 4.5 pontuou 80,9% no SWE-bench Verified, colocando-o à frente dos modelos da série GPT-5 na maioria das análises independentes.

OpenAI Codex roda na nuvem, clona seu repositório em um sandbox e trabalha de forma autônoma. Ele pontua 77,3% no Terminal-Bench 2.0 em comparação com os 65,4% do Claude e, segundo a OpenAI, usa significativamente menos tokens para tarefas comparáveis.

Na prática, o Claude Code tende a ser preferido para refatoração complexa e saída com qualidade de produção. O Codex tende a ser preferido para prototipagem rápida e tarefas delegadas em segundo plano. O GPT-5.4 mini e o nano estendem isso ainda mais, atuando como subagentes que lidam com tarefas mais restritas enquanto um modelo maior cuida do planejamento e da revisão.

Sobre o ajuste fino (fine-tuning), a OpenAI suporta vários métodos (SFT, DPO, RFT) para a família GPT-4.1. O ajuste fino da Anthropic é limitado ao Claude 3 Haiku no Bedrock, sem nada disponível para os modelos Claude 4.x no início de 2026.

Manuseio de contexto longo

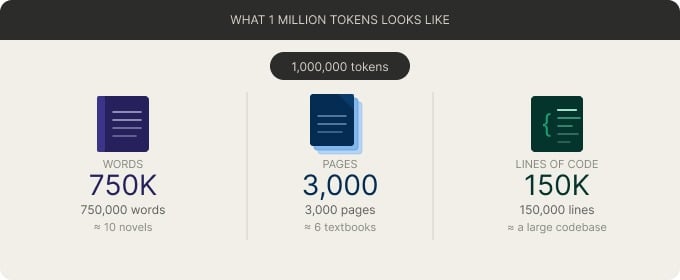

Ambas as plataformas agora suportam janelas de contexto na faixa de 1 milhão de tokens, o que equivale a aproximadamente 750.000 palavras ou 150.000 linhas de código.

O Claude Opus 4.6 e o Sonnet 4.6 oferecem janelas de contexto de 1M de tokens com preços fixos, o que significa que não há sobretaxa por usar a janela completa. O GPT-5.4 suporta uma janela de contexto de 1,05M de tokens, mas aplica uma sobretaxa (2x entrada, 1,5x saída) para prompts que excedem 272K tokens. O GPT-5.2 mais antigo tem uma janela menor de 400K tokens.

Sobre a qualidade de contexto longo, o Claude Opus 4.6 pontuou 78,3% no MRCR v2 (um benchmark de recuperação de múltiplas agulhas em 1M de tokens), colocando-o no topo entre os modelos testados nesse benchmark. Para fluxos de trabalho envolvendo documentos grandes, bases de código inteiras ou revisão jurídica ou de pesquisa de múltiplos documentos, o tamanho da janela de contexto e a precisão da recuperação são importantes, e a Anthropic atualmente tem uma vantagem aqui.

Como é um milhão de tokens. Imagem do autor.

Capacidades multimodais

É aqui que a diferença entre as duas plataformas é mais óbvia. A OpenAI suporta texto, imagens, áudio e vídeo nativamente em toda a sua família de modelos. O ecossistema inclui geração de imagens (GPT Image 1), geração de vídeo (Sora 2), uma API de voz em tempo real e modo de voz avançado para áudio conversacional. O GPT-5.4 também inclui capacidades de uso de computador por meio de um recurso de visualização.

O Claude lida com entradas de texto e imagem e cobre a análise de documentos (PDFs, gráficos, tabelas) razoavelmente bem. Ele também suporta o uso de computador por meio de uma abordagem baseada em visão (captura de tela, depois ação), com o Claude Opus 4.6 e o Sonnet 4.6 suportando isso. O Claude não gera imagens, áudio ou vídeo.

Uma coisa que vale a pena notar: a partir de 12 de março de 2026, o Claude pode criar gráficos, diagramas e visualizações interativas diretamente no chat. Não são imagens estáticas, mas visuais dinâmicos que se atualizam conforme a conversa se desenvolve. O recurso está disponível em todos os tipos de plano, incluindo o gratuito. Isso é diferente da geração de imagens e não fecha a lacuna com a OpenAI nessa frente, mas é uma adição significativa para fluxos de trabalho de dados e análise.

Se o seu trabalho exige geração de imagens, áudio ou vídeo, a OpenAI ainda é a única opção aqui. Se suas necessidades são principalmente texto, documentos e análise de dados, o Claude agora cobre mais terreno do que antes.

Anthropic vs. OpenAI: Filosofia de segurança e alinhamento

A segurança é uma das diferenças mais claras entre essas duas empresas, e vale a pena observar o que cada uma realmente fez, em vez de apenas o que dizem.

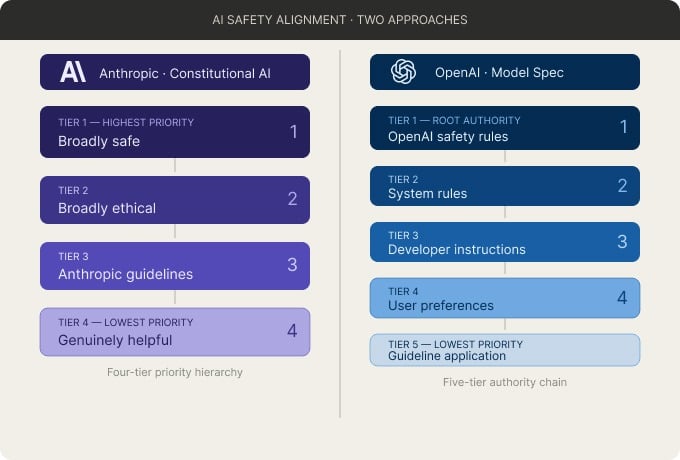

Duas abordagens para o alinhamento de segurança da IA. Imagem do autor.

Como cada empresa aborda a segurança

O método principal da Anthropic é a IA Constitucional com Aprendizado por Reforço a partir de Feedback de IA (RLAIF): o modelo autocritica suas saídas em relação a um conjunto escrito de princípios extraídos de fontes como a Declaração Universal dos Direitos Humanos e pesquisas acadêmicas de segurança. A revisão de janeiro de 2026 introduziu uma hierarquia de prioridade de quatro níveis (amplamente seguro, amplamente ético, em conformidade com as diretrizes da Anthropic e, então, genuinamente útil) e reconheceu formalmente a possibilidade de consciência da IA, o que foi notável na época.

A OpenAI usa Aprendizado por Reforço a partir de Feedback Humano (RLHF) juntamente com um documento de governança chamado Model Spec, atualizado pela última vez em dezembro de 2025. Ele estabelece uma cadeia de autoridade desde as regras raiz da OpenAI até as preferências do usuário. O GPT-5 introduziu "conclusões seguras", que visam dar respostas de alto nível a consultas sensíveis em vez de recusar diretamente, e o modelo foi treinado para ser menos concordante e mais disposto a contestar.

A diferença mais clara entre as duas é a transparência. A OpenAI esconde a cadeia de pensamento interna do modelo dos usuários, argumentando que expô-la poderia ser mal utilizada. A Anthropic publica pesquisas de interpretabilidade e gráficos de atribuição que mapeiam o raciocínio interno. No lado prático, os Classificadores Constitucionais da Anthropic resistiram a mais de 3.000 horas de red teaming sem um jailbreak universal. Testes independentes colocam a taxa de sucesso de injeção de prompt do Claude Opus 4.5 em cerca de 4,7%, o que é menor do que o que outras plataformas relataram.

Ambas as empresas também revisaram seus compromissos de segurança em 2025 e 2026. Críticos argumentam que as mudanças enfraquecem promessas anteriores. A Política de Escalonamento Responsável v3.0 da Anthropic substituiu compromissos de pausa rígida por metas públicas abertamente graduadas. Análises da Estrutura de Preparação v2.0 da OpenAI argumentam que algumas categorias de risco recebem menos foco explícito pré-implantação do que antes. O posicionamento de segurança ainda está evoluindo em ambas, então vale a pena verificar seus documentos de política mais recentes em vez de confiar apenas na reputação.

Mudanças na política de segurança que vale a pena conhecer

Ambas as empresas ajustaram seus compromissos de segurança em 2025 e 2026. Críticos argumentam que essas revisões enfraquecem promessas anteriores. A Política de Escalonamento Responsável v3.0 da Anthropic (fevereiro de 2026) substituiu compromissos de pausa rígida por metas públicas graduadas abertamente, abandonando o que versões anteriores tratavam como salvaguardas de implantação incondicionais. Análises da Estrutura de Preparação v2.0 da OpenAI (abril de 2025) argumentam que algumas categorias de risco, como manipulação em massa e desinformação, recebem menos foco explícito pré-implantação do que antes.

Essas mudanças atraíram críticas da comunidade de segurança de IA. Ambas as empresas citam a pressão competitiva como um fator. O posicionamento de segurança está evoluindo em ambas, então vale a pena verificar seus documentos de política mais recentes em vez de confiar apenas na reputação.

Ecossistema de API e experiência do desenvolvedor

A Anthropic oferece uma superfície de API focada por meio da Messages API. SDKs estão disponíveis em sete linguagens (Python, TypeScript, Java, Go, Ruby, C# e PHP). A API suporta uso de ferramentas e chamada de função, saída JSON estruturada, entradas de visão, pensamento estendido com um orçamento de token configurável e streaming. A Anthropic também originou o Model Context Protocol (MCP), um padrão aberto para conectar agentes de IA a ferramentas externas e fontes de dados que foi adotado por um número crescente de ferramentas e plataformas.

A API da OpenAI é mais ampla. Inclui a Responses API (que substituiu a Assistants API), a Chat Completions API, uma Realtime API para áudio e voz, e SDKs para Python, TypeScript, Go e Java. Além dos recursos padrão (chamada de função, saídas estruturadas, streaming, modo em lote), a OpenAI também oferece uma API de geração de imagens, conversão de texto em fala, transcrição e embeddings.

|

Recurso |

Claude |

OpenAI |

|

Chamada de ferramentas e funções |

Sim |

Sim |

|

Saída JSON estruturada |

Sim |

Sim |

|

Streaming |

Sim |

Sim |

|

Batch API (50% de desconto) |

Sim |

Sim |

|

Cache de prompt |

Sim |

Sim |

|

Pesquisa web integrada |

Sim |

Sim |

|

Execução de código |

Sim |

Sim |

|

Uso de computador |

Sim (Opus 4.6, Sonnet 4.6) |

Sim (visualização) |

|

Ajuste fino (Fine-tuning) |

Limitado (apenas Haiku 3 no Bedrock) |

Sim (SFT, DPO, RFT para a família GPT-4.1) |

|

Geração de imagens |

Não |

Sim |

|

Entrada e saída de áudio |

Não |

Sim (Realtime API, TTS) |

|

SDK de agente |

Sim (Python, TypeScript) |

Sim (código aberto, Python, TypeScript) |

Como mencionei na seção de codificação, a lacuna de ajuste fino vale a pena notar. A OpenAI suporta vários métodos de ajuste fino em vários níveis de modelo por meio de sua API direta e Azure. A Anthropic limita o ajuste fino a um único modelo em uma única plataforma de nuvem.

Adoção corporativa e parcerias

As especificações da API são uma coisa. Como as empresas estão realmente usando essas plataformas é outra.

OpenAI e Microsoft

A OpenAI detém a maior pegada corporativa, com cerca de 78% de penetração na produção e cerca de 56% do gasto total corporativo em LLM, de acordo com pesquisas do setor.

A integração com a Microsoft é profunda. O Azure OpenAI Service fornece acesso direto a todos os modelos GPT-5.x. O Microsoft 365 Copilot (alimentado por modelos da OpenAI) foi adotado pela grande maioria das licenças corporativas pagas nas organizações pesquisadas, e o GitHub Copilot detém cerca de 70% de participação de mercado em ferramentas de codificação corporativa.

A OpenAI lidera na implantação de chatbots, gestão de conhecimento corporativo e casos de uso de suporte ao cliente.

Anthropic e Amazon

A penetração corporativa da Anthropic está em 44%, um aumento de 25 pontos percentuais desde maio de 2025, o que, de acordo com dados de pesquisa, foi o maior ganho de qualquer provedor de IA nesse período. A empresa gera cerca de 80% de sua receita de clientes corporativos e conta com 8 das Fortune 10 como clientes do Claude. Implantações notáveis incluem a Deloitte (470.000 funcionários) e a Cognizant (350.000 funcionários).

A parceria com a AWS dá à Anthropic acesso a chips personalizados Amazon Trainium e Inferentia para treinamento e inferência, que oferecem vantagens de custo na camada de hardware. O Claude também está disponível no Google Cloud Vertex AI e, a partir de março de 2026, no Microsoft Foundry.

A Anthropic lidera em casos de uso corporativo de desenvolvimento de software e análise de dados. Uma pesquisa com CIOs corporativos descobriu que a maioria das empresas agora usa três ou mais famílias de modelos, sugerindo que a implantação de múltiplos modelos está se tornando uma prática comum.

Preços e acessibilidade

As estruturas de preços diferem entre os produtos de chat ao consumidor e as APIs. Vou cobrir ambos, mas como os preços mudam com frequência, vou focar na estrutura em vez de números exatos. Verifique a página de preços da Anthropic e a página de preços da OpenAI para os números mais recentes.

Planos de consumidor

Ambas as empresas oferecem níveis gratuitos com acesso limitado. O nível gratuito do ChatGPT inclui acesso a modelos GPT com um limite rotativo de cerca de 10 mensagens a cada 5 horas, após o qual ele retorna a um modelo de qualidade inferior. O nível gratuito do Claude fornece acesso ao Sonnet 4.6 com limites diários de mensagens, mas sem pensamento estendido.

A OpenAI introduziu um novo nível de entrada em janeiro de 2026: o ChatGPT Go a US$ 8 por mês, que fica entre os planos gratuito e Plus (US$ 20 por mês). Notavelmente, o plano Go é suportado por anúncios, tornando a OpenAI um dos primeiros grandes laboratórios de IA a introduzir publicidade em seu produto de consumo. O Claude Pro custa US$ 20 por mês e inclui acesso a todos os modelos, Claude Code e pensamento estendido.

No nível mais alto, o plano Pro da OpenAI custa US$ 200 por mês para acesso ilimitado. Os planos Max da Anthropic variam de US$ 100 a US$ 200 por mês com 5x a 20x o uso do Pro.

Estrutura de preços da API

A OpenAI tem uma clara vantagem de preço no nível econômico. O GPT-4.1 nano começa em US$ 0,10 por milhão de tokens de entrada, em comparação com US$ 1,00 para o Claude Haiku 4.5. Mesmo o GPT-4.1 mini a US$ 0,40 é notavelmente mais barato que o Haiku.

No nível de carro-chefe, a lacuna diminui. O Claude Sonnet 4.6 fica em US$ 3/US$ 15 (entrada/saída por milhão de tokens) versus o GPT-5.2 a US$ 1,75/US$ 14. O Claude Opus 4.6 custa US$ 5/US$ 25 versus o GPT-5.4 a US$ 2,50/US$ 15. A OpenAI ainda é geralmente mais barata por token em cada nível comparável, mas a Anthropic compensa isso para usuários de contexto pesado removendo sobretaxas de contexto longo em seus modelos mais recentes. O GPT-5.4, por outro lado, cobra um prêmio por prompts que excedem 272K tokens.

Ambos os provedores oferecem descontos de API em lote e cache de prompt para reduzir custos para cargas de trabalho de produção.

Anthropic vs. OpenAI: Prós e contras

Veja como as duas plataformas se comparam em relação aos fatores que mais importam.

|

Fator |

OpenAI |

Anthropic |

|

Multimodal |

Texto, imagem, vídeo e voz |

Apenas texto e imagem |

|

Preços econômicos |

GPT-4.1 nano a US$ 0,10/M tokens de entrada |

Haiku 4.5 a US$ 1,00/M tokens de entrada |

|

Janela de contexto |

1,05M tokens; sobretaxa acima de 272K |

1M tokens com preço fixo |

|

Ajuste fino (Fine-tuning) |

SFT, DPO, RFT para a família GPT-4.1 |

Limitado apenas ao Claude 3 Haiku no Bedrock |

|

Ferramentas de codificação |

Codex para tarefas autônomas baseadas em nuvem |

Claude Code para refatoração complexa e saída de produção |

|

Alcance corporativo |

~78% de penetração na produção |

~44%, aumento de 25 pontos desde maio de 2025 |

|

Ecossistema |

Azure, GitHub Copilot, GPT Store |

AWS Bedrock, Google Vertex AI, Microsoft Foundry |

|

Transparência de segurança |

Model Spec público; raciocínio interno oculto |

IA Constitucional e constituição publicadas |

|

Cadência de lançamento |

Movimentação rápida; descontinuação frequente de modelos |

Mais estável, menos mudanças disruptivas |

Quando escolher Anthropic vs. OpenAI

A escolha certa depende do seu caso de uso específico. Aqui estão os cenários onde cada plataforma tende a ser a melhor opção.

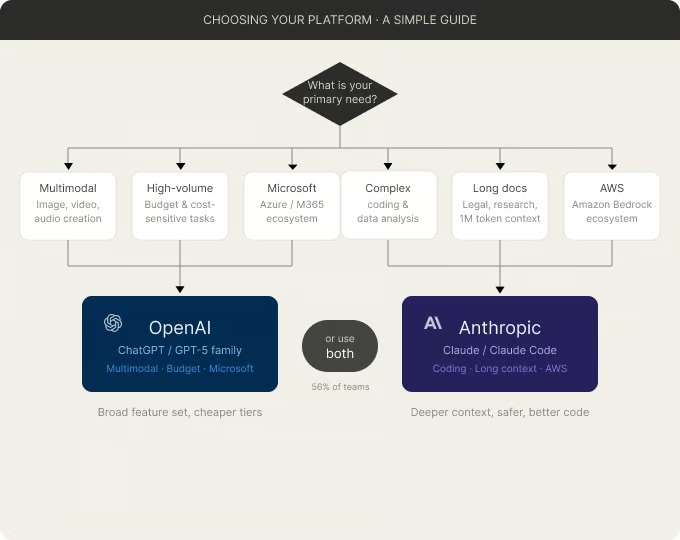

Um guia simples para escolher sua plataforma. Imagem do autor.

Escolha a OpenAI se você precisa de suporte multimodal em texto, imagem, áudio e vídeo. Se sua organização opera com Microsoft e Azure, a integração da OpenAI está bem estabelecida. Para processamento de alto volume e sensível a custos, os modelos econômicos da OpenAI são muito mais baratos que os equivalentes da Anthropic. Se o ajuste fino em dados proprietários for um requisito, a OpenAI está à frente aqui.

Escolha a Anthropic se seu trabalho envolve desenvolvimento de software complexo ou análise de dados. Se você precisa processar documentos longos como revisões jurídicas, artigos de pesquisa ou auditorias completas de base de código, a janela de contexto de 1M de tokens com preço fixo da Anthropic é prática. Para implantações críticas de segurança, a abordagem de IA Constitucional da Anthropic tem um registro público mais detalhado. Se você está construindo na AWS, o Claude é integrado nativamente por meio do Bedrock.

Para muitas equipes, a resposta é ambos. Dados de mercado mostram que a maioria das empresas agora usa três ou mais famílias de modelos, e uma grande parcela de usuários pagantes da OpenAI também paga pela Anthropic. Rotear tarefas diferentes para modelos diferentes com base em seus pontos fortes é uma prática cada vez mais comum.

Conclusão: Anthropic vs. OpenAI em 2026

A OpenAI tem maior alcance, suporte multimodal mais profundo e preços de nível econômico mais baratos. A Anthropic tem um desempenho de contexto longo mais forte, um registro de segurança mais transparente e ferramentas construídas em torno de codificação complexa e trabalho analítico.

A escolha certa depende do que você está construindo e em qual ecossistema você já está. O ciclo rápido de descontinuação da OpenAI significa que vale a pena verificar ambas as páginas de preços e listas de modelos antes de se comprometer.

Se você está interessado em como as ferramentas de codificação das duas empresas se comparam especificamente, confira nosso artigo Codex vs. Claude Code para uma análise mais profunda dessa dimensão.

Além disso, acompanhe nossos recursos recomendados:

- Nosso curso Understanding ChatGPT percorre como escrever prompts eficazes.

- Nossa trilha ChatGPT Fundamentals combina o ChatGPT com Python e análise de dados.

- Nosso curso Introduction to Claude Models ensina como usar a API da Anthropic.

Sou engenheiro de dados e criador de comunidades que trabalha com pipelines de dados, nuvem e ferramentas de IA, além de escrever tutoriais práticos e de alto impacto para o DataCamp e desenvolvedores iniciantes.

FAQs

Posso usar o Claude e o ChatGPT ao mesmo tempo?

Sim, e muitos profissionais fazem isso. Muitos relatam usar o Claude e o ChatGPT em paralelo, roteando tarefas diferentes para cada um. As duas plataformas atendem a pontos fortes diferentes, então usar ambas é comum na prática, mesmo que o custo da assinatura dupla se acumule.

Qual IA é melhor para aprender ciência de dados?

Ambos funcionam bem, mas têm estilos diferentes. O Claude tende a produzir explicações mais estruturadas, passo a passo, e lida bem com documentos longos, por isso é útil para trabalhar com livros didáticos ou artigos de pesquisa. O ChatGPT tem um ecossistema mais amplo com um nível gratuito que dá acesso rápido a modelos capazes. Eu começaria com o nível gratuito que você achar mais confortável e, em seguida, faria o upgrade com base no que você mais usa.

A Anthropic é mais "segura" que a OpenAI?

A Anthropic construiu sua marca em torno da IA com foco em segurança, e sua abordagem de IA Constitucional é mais transparente do que a maioria. Mas ambas as empresas ajustaram seus compromissos de segurança em 2025 e 2026 em resposta à pressão competitiva. Segurança é menos um binário e mais um alvo em movimento. O artigo cobre as mudanças específicas de política para ambos.

O Claude suporta geração de imagem e vídeo?

Não. No início de 2026, o Claude lida com entradas de texto e imagem, mas não gera imagens, vídeo ou áudio. A OpenAI tem uma pilha multimodal mais ampla que inclui geração de imagens, vídeo por meio do Sora e uma API de voz em tempo real. Se o seu fluxo de trabalho depende da geração de conteúdo visual ou de áudio, a OpenAI é a melhor opção.

Qual é mais barato para uso de API?

Depende do nível. A OpenAI tem modelos econômicos muito mais baratos, com o GPT-4.1 nano começando em US$ 0,10 por milhão de tokens de entrada versus US$ 1,00 para o Claude Haiku 4.5. No nível de carro-chefe, o preço é mais próximo, e a Anthropic removeu sobretaxas de contexto longo para seus modelos mais recentes. A resposta certa depende do seu volume e de qual nível de modelo você realmente precisa.