Corso

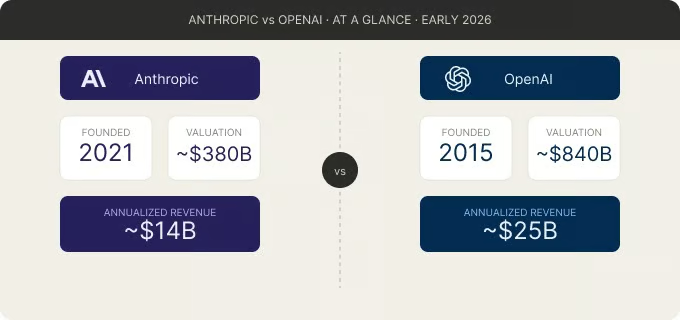

Se lavori con i grandi modelli linguistici (LLM), quasi certamente hai usato un prodotto di OpenAI o Anthropic, o entrambi. OpenAI ha reso popolare la categoria con ChatGPT, che secondo numerose fonti conta centinaia di milioni di utenti attivi settimanali. Anthropic, fondata nel 2021 da ex ricercatori di OpenAI, è cresciuta fino a diventare la seconda azienda di IA per ricavi, con analisti che stimano un fatturato annualizzato nell’ordine delle decine di miliardi.

Ma non si tratta solo di un confronto tra modelli. Anthropic e OpenAI rappresentano due approcci diversi alla costruzione dell’IA. OpenAI si è concentrata su un’ampia diffusione consumer e sull’integrazione multimodale. Anthropic ha puntato sulla fiducia delle aziende, sulla ricerca in ambito sicurezza e sulla gestione di contesti molto ampi.

Che cos’è OpenAI?

OpenAI è l’azienda dietro ChatGPT, la famiglia di modelli GPT, DALL-E e Sora. È stata fondata nel 2015 a San Francisco, inizialmente come organizzazione non profit. Nell’ottobre 2025 ha completato una ristrutturazione in Public Benefit Corporation (PBC), sciogliendo il precedente modello a profitto limitato. Il ramo non profit è stato rinominato OpenAI Foundation, che mantiene il potere di nominare membri del consiglio e circa il 26% dell’equity.

La partnership di OpenAI con Microsoft è centrale per il suo funzionamento. Azure è il cloud provider esclusivo per le chiamate API di OpenAI, e OpenAI si è impegnata a 250 miliardi di dollari in servizi Azure per la durata dell’accordo. La partnership è stata pubblicamente riaffermata a febbraio 2026, mentre OpenAI raccoglieva 110 miliardi di dollari nel suo ultimo round di finanziamento, riportato come uno dei più grandi round privati di sempre.

Sul fronte prodotto, OpenAI ha perseguito una strategia di iterazione rapida e di forte deprecazione dei modelli. A febbraio 2026 l’azienda ha ritirato diversi modelli legacy da ChatGPT, tra cui GPT-4o e GPT-4.1. A marzo 2026 è stata ritirata anche la serie intermedia GPT-5.1. Questo mantiene la linea prodotti focalizzata ma richiede agli sviluppatori di seguire da vicino le tempistiche di migrazione.

La famiglia GPT-5 è l’attuale generazione di OpenAI. È stata lanciata nell’agosto 2025 con un’architettura "router" che seleziona automaticamente tra modalità di ragionamento veloce (Instant) e profondo (Thinking) a seconda della complessità della richiesta. I modelli chiave da conoscere sono:

- GPT-5.4 (rilasciato a marzo 2026, l’ultimo flagship con finestra di contesto da 1,05 milioni di token),

- GPT-5.3 Codex (lo specialista di coding agentico), e

- GPT-5.2 (il precedente flagship, ora in fase di ritiro).

- Sempre a marzo 2026 sono stati rilasciati GPT-5.4 mini e GPT-5.4 nano, varianti più piccole pensate per velocità e costi inferiori. GPT-5.4 mini conserva gran parte dei punti di forza di GPT-5.4 in coding, uso di strumenti e multimodalità, ma gira oltre il doppio più veloce. GPT-5.4 nano è pensato per attività semplici ad alto volume.

- OpenAI ha inoltre rilasciato modelli open-weight (gpt-oss-120b e gpt-oss-20b sotto licenza Apache 2.0), un cambiamento notevole rispetto all’approccio storicamente chiuso.

Che cos’è Anthropic?

Anthropic è l’azienda dietro la famiglia di modelli Claude. È stata fondata nel 2021 da Dario Amodei (CEO), Daniela Amodei (President) e da circa altri dieci ex ricercatori di OpenAI, che hanno lasciato per divergenze su priorità di sicurezza e commercializzazione.

L’identità tecnica dell’azienda ruota attorno alla Constitutional AI, un approccio di training in cui il modello autocritica i propri output rispetto a un insieme scritto di principi etici, invece di affidarsi esclusivamente al feedback umano. Anthropic ha pubblicato una revisione della Costituzione di Claude a gennaio 2026, passando da un allineamento basato su regole a uno basato sulle ragioni: invece di dire semplicemente al modello cosa seguire, la costituzione spiega perché esistono le regole, con l’obiettivo di consentire un giudizio più sfumato in situazioni nuove.

Il principale partner cloud e di training dell’azienda è Amazon Web Services (AWS), con un investimento totale di Amazon di 8 miliardi di dollari. I modelli Claude sono disponibili anche su Google Cloud Vertex AI (Google detiene circa il 14% di Anthropic) e, da marzo 2026, anche su Microsoft Foundry.

La famiglia Claude 4 è l’attuale generazione. La convenzione di naming usa tre livelli: Opus (flagship, il più capace), Sonnet (equilibrato) e Haiku (veloce ed economico). I modelli più recenti sono:

- Claude Opus 4.6 (rilasciato a febbraio 2026, il modello di ragionamento di fascia alta con finestra di contesto da 1 milione di token e output massimo 128K)

- Claude Sonnet 4.6 (sempre febbraio 2026, predefinito per utenti free e a pagamento con finestra 1M), e

- Claude Haiku 4.5 (rilasciato a ottobre 2025, l’opzione economica).

Oltre ai modelli core, Anthropic ha rilasciato Claude Code (un agente di coding via terminale), agent desktop-style per il lavoro di conoscenza non tecnico e SDK di agent per Python e TypeScript per creare workflow agentici personalizzati.

Anthropic vs OpenAI: confronto delle capacità dei modelli

Entrambe le piattaforme sono capaci su un’ampia gamma di attività, ma con punti di forza diversi. Non esiste un unico modello migliore per tutto. Ecco un’analisi per categoria.

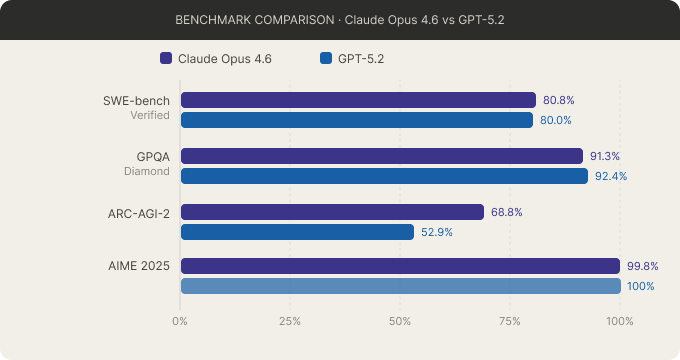

Punteggi di benchmark su quattro test chiave. Immagine dell’autore.

Ragionamento e problem solving

Entrambe le aziende ora offrono ragionamento ibrido, in cui un singolo modello può passare tra risposte rapide ed esteso chain-of-thought. Claude l’ha introdotto per primo con Claude 3.7 Sonnet a febbraio 2025. OpenAI ha seguito con il router unificato di GPT-5 nell’agosto 2025.

Sui benchmark, il quadro è misto:

- AIME 2025 (gara di matematica): GPT-5.2 è in testa, con punteggio perfetto in alcune configurazioni di test.

- GPQA Diamond (scienze a livello graduate): GPT-5.2 supera Claude di poco.

- ARC-AGI-2 (logica visiva nuova, difficile da memorizzare dai dati di training): analisi indipendenti collocano Claude Opus 4.6 intorno al 68-69% contro GPT-5.2 circa 52-54%.

- Humanity's Last Exam (sintesi a livello esperto): Claude è in vantaggio in base ai confronti disponibili.

In base ai risultati dei benchmark, OpenAI sembra andare meglio su logica deterministica e recupero di fatti, mentre Anthropic tende a fare meglio su sintesi contestuale e analisi qualitative. Nessuno dei due approcci è universalmente superiore: dipende da cosa ti serve che il modello faccia.

Per uno sguardo più da vicino su come GPT-5.4 e Claude Opus 4.6 si confrontano specificamente su questi benchmark, vedi il nostro approfondimento GPT-5.4 vs. Claude Opus 4.6.

Coding e uso per sviluppatori

Entrambe le aziende sono andate ben oltre la semplice generazione di codice, verso strumenti di coding agentico, ma con approcci molto diversi.

Claude Code gira in locale, indicizza il tuo codebase e chiede approvazione prima di modificare i file. Claude Opus 4.5 ha ottenuto l’80,9% su SWE-bench Verified, posizionandosi davanti alla serie GPT-5 nella maggior parte delle analisi indipendenti.

OpenAI Codex gira nel cloud, clona il tuo repo in un sandbox e lavora in autonomia. Ottiene il 77,3% su Terminal-Bench 2.0 rispetto al 65,4% di Claude e, secondo OpenAI, usa significativamente meno token per compiti comparabili.

In pratica, Claude Code è spesso preferito per refactoring complessi e output di qualità produttiva. Codex è preferito per prototipazione rapida e compiti delegati in background. GPT-5.4 mini e nano spingono oltre, agendo da subagent che gestiscono compiti più ristretti mentre un modello più grande cura pianificazione e revisione.

Sul fine-tuning, OpenAI supporta più metodi (SFT, DPO, RFT) per la famiglia GPT-4.1. Il fine-tuning di Anthropic è limitato a Claude 3 Haiku su Bedrock, senza opzioni per i modelli Claude 4.x a inizio 2026.

Gestione di contesti lunghi

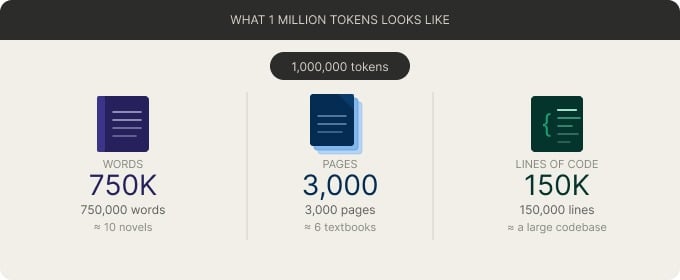

Entrambe le piattaforme supportano ormai finestre di contesto nell’ordine di 1 milione di token, pari a circa 750.000 parole o 150.000 righe di codice.

Claude Opus 4.6 e Sonnet 4.6 offrono finestre da 1M token con tariffazione flat, cioè senza sovrapprezzo per usare l’intera finestra. GPT-5.4 supporta una finestra da 1,05M token, ma applica un sovrapprezzo (2x input, 1,5x output) per prompt oltre 272K token. Il vecchio GPT-5.2 ha una finestra più piccola, da 400K token.

Sulla qualità nel lungo contesto, Claude Opus 4.6 ha ottenuto il 78,3% su MRCR v2 (benchmark di recupero multi-needle a 1M token), collocandosi al top tra i modelli testati in quel benchmark. Per workflow che coinvolgono grandi documenti, interi codebase o revisioni legali/di ricerca multi-documento, contano sia dimensione della finestra sia accuratezza di retrieval, e al momento Anthropic ha un vantaggio.

Cosa rappresenta un milione di token. Immagine dell’autore.

Capacità multimodali

Qui la differenza tra le due piattaforme è più evidente. OpenAI supporta nativamente testo, immagini, audio e video su tutta la famiglia di modelli. L’ecosistema include generazione di immagini (GPT Image 1), generazione video (Sora 2), una Realtime API per la voce e una modalità voce avanzata per audio conversazionale. GPT-5.4 include anche capacità di uso del computer tramite una funzionalità in anteprima.

Claude gestisce input testuali e di immagini e copre abbastanza bene l’analisi di documenti (PDF, grafici, tabelle). Supporta anche l’uso del computer con un approccio basato sulla visione (screenshot, poi azione), con supporto sia in Claude Opus 4.6 sia in Sonnet 4.6. Claude non genera immagini, audio o video.

Una cosa da notare: dal 12 marzo 2026 Claude può creare grafici, diagrammi e visualizzazioni interattive direttamente in chat. Non sono immagini statiche ma visual dinamici che si aggiornano man mano che la conversazione procede. La funzionalità è disponibile in tutti i piani, anche gratuiti. È diversa dalla generazione di immagini e non colma il divario con OpenAI su quel fronte, ma è un’aggiunta significativa per workflow di dati e analisi

Se il tuo lavoro richiede generazione di immagini, audio o video, OpenAI è ancora l’unica opzione qui. Se le tue esigenze sono principalmente testo, documenti e analisi dei dati, Claude oggi copre più ambiti di prima.

Anthropic vs OpenAI: filosofia di sicurezza e allineamento

La sicurezza è una delle differenze più nette tra le due aziende, e vale la pena guardare a ciò che hanno effettivamente fatto, non solo a ciò che dichiarano.

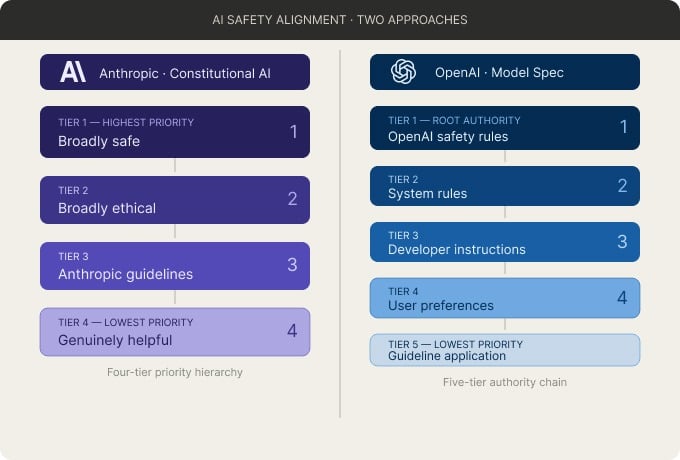

Due approcci all’allineamento sulla sicurezza dell’IA. Immagine dell’autore.

Come ciascuna azienda affronta la sicurezza

Il metodo centrale di Anthropic è la Constitutional AI con Reinforcement Learning from AI Feedback (RLAIF): il modello autocritica i propri output rispetto a un set scritto di principi tratti da fonti come la Dichiarazione Universale dei Diritti Umani dell’ONU e la ricerca accademica sulla sicurezza. La revisione di gennaio 2026 ha introdotto una gerarchia di priorità a quattro livelli (ampiamente sicuro, ampiamente etico, conforme alle linee guida di Anthropic, quindi genuinamente utile) e ha riconosciuto formalmente la possibilità di coscienza dell’IA, fatto degno di nota all’epoca.

OpenAI usa il Reinforcement Learning from Human Feedback (RLHF) insieme a un documento di governance chiamato Model Spec, aggiornato a dicembre 2025. Stabilisce una catena di autorità dalle regole di base di OpenAI fino alle preferenze dell’utente. GPT-5 ha introdotto le "safe completions", che puntano a dare risposte di alto livello a richieste sensibili invece di rifiutare in toto, e il modello è stato addestrato a essere meno accondiscendente e più incline a opporsi quando opportuno.

La differenza più chiara tra i due sta nella trasparenza. OpenAI nasconde all’utente la catena di pensiero interna del modello, sostenendo che esporla potrebbe essere usato in modo improprio. Anthropic pubblica ricerca sull’interpretabilità e grafi di attribuzione che mappano il ragionamento interno. Sul piano pratico, i Constitutional Classifier di Anthropic hanno retto oltre 3.000 ore di red teaming senza un jailbreak universale. Test indipendenti collocano il tasso di successo delle prompt injection di Claude Opus 4.5 intorno al 4,7%, più basso di quanto riportato da altre piattaforme.

Entrambe le aziende hanno inoltre rivisto i loro impegni sulla sicurezza tra 2025 e 2026. I critici sostengono che i cambiamenti abbiano indebolito promesse precedenti. La Responsible Scaling Policy v3.0 di Anthropic ha sostituito gli impegni di pausa rigida con obiettivi pubblici valutati apertamente. Analisi del Preparedness Framework v2.0 di OpenAI sostengono che alcune categorie di rischio ricevono meno attenzione esplicita pre-deployment rispetto a prima. Il posizionamento sulla sicurezza è ancora in evoluzione per entrambe, quindi vale la pena consultare i documenti di policy più recenti invece di affidarsi solo alla reputazione.

Modifiche alle policy di sicurezza da conoscere

Entrambe le aziende hanno adattato i propri impegni sulla sicurezza nel 2025 e 2026. I critici sostengono che queste revisioni indeboliscano promesse precedenti. La Responsible Scaling Policy v3.0 di Anthropic (febbraio 2026) ha sostituito gli impegni di pausa rigida con obiettivi pubblici valutati apertamente, rimuovendo ciò che le versioni precedenti trattavano come salvaguardie di distribuzione incondizionate. Analisi del Preparedness Framework v2.0 di OpenAI (aprile 2025) sostengono che alcune categorie di rischio, come manipolazione di massa e disinformazione, ricevano meno attenzione esplicita pre-deployment di prima.

Questi spostamenti hanno attirato critiche dalla comunità sulla sicurezza dell’IA. Entrambe le aziende citano la pressione competitiva come fattore. Il posizionamento sulla sicurezza è in evoluzione in entrambe, quindi vale la pena controllare i loro documenti di policy più recenti anziché affidarsi alla sola reputazione.

Ecosistema API ed esperienza per sviluppatori

Anthropic offre una superficie API focalizzata tramite la Messages API. Gli SDK sono disponibili in sette linguaggi (Python, TypeScript, Java, Go, Ruby, C# e PHP). L’API supporta l’uso di strumenti e function calling, output JSON strutturati, input di visione, extended thinking con budget di token configurabile e streaming. Anthropic ha inoltre originato il Model Context Protocol (MCP), uno standard aperto per connettere agent di IA a strumenti e fonti dati esterni, adottato da un numero crescente di tool e piattaforme.

L’API di OpenAI è più ampia. Include la Responses API (che ha sostituito la Assistants API), la Chat Completions API, una Realtime API per audio e voce e SDK per Python, TypeScript, Go e Java. Oltre alle funzionalità standard (function calling, output strutturati, streaming, modalità batch), OpenAI offre anche un’API per generazione di immagini, text-to-speech, trascrizione ed embeddings.

|

Funzionalità |

Claude |

OpenAI |

|

Tool e function calling |

Sì |

Sì |

|

Output JSON strutturato |

Sì |

Sì |

|

Streaming |

Sì |

Sì |

|

Batch API (sconto 50%) |

Sì |

Sì |

|

Prompt caching |

Sì |

Sì |

|

Ricerca web integrata |

Sì |

Sì |

|

Esecuzione di codice |

Sì |

Sì |

|

Uso del computer |

Sì (Opus 4.6, Sonnet 4.6) |

Sì (anteprima) |

|

Fine-tuning |

Limitato (solo Haiku 3 su Bedrock) |

Sì (SFT, DPO, RFT per famiglia GPT-4.1) |

|

Generazione di immagini |

No |

Sì |

|

Input e output audio |

No |

Sì (Realtime API, TTS) |

|

Agent SDK |

Sì (Python, TypeScript) |

Sì (open-source, Python, TypeScript) |

Come accennato nella sezione sul coding, il divario nel fine-tuning è da notare. OpenAI supporta più metodi di fine-tuning su più livelli di modelli tramite API diretta e Azure. Anthropic limita il fine-tuning a un solo modello su un’unica piattaforma cloud.

Adozione enterprise e partnership

Le specifiche API sono una cosa. Come le aziende usano davvero queste piattaforme è un’altra.

OpenAI e Microsoft

OpenAI detiene l’impronta enterprise più ampia, con circa il 78% di penetrazione in produzione e circa il 56% della spesa totale enterprise per LLM, secondo sondaggi di settore.

L’integrazione con Microsoft è profonda. Azure OpenAI Service offre accesso diretto a tutti i modelli GPT-5.x. Microsoft 365 Copilot (alimentato da modelli OpenAI) è stato adottato dalla grande maggioranza delle licenze enterprise a pagamento nelle organizzazioni intervistate, e GitHub Copilot detiene circa il 70% di quota nel mercato degli strumenti di coding enterprise.

OpenAI è in testa nei deployment di chatbot, nella gestione della conoscenza aziendale e nei casi d’uso di supporto clienti.

Anthropic e Amazon

La penetrazione enterprise di Anthropic è al 44%, in aumento di 25 punti percentuali da maggio 2025, il guadagno più ampio tra i provider di IA in quel periodo secondo i sondaggi. L’azienda genera circa l’80% dei ricavi da clienti enterprise e conta 8 delle Fortune 10 come clienti di Claude. Deployment di rilievo includono Deloitte (470.000 dipendenti) e Cognizant (350.000 dipendenti).

La partnership con AWS dà ad Anthropic accesso a chip personalizzati Amazon Trainium e Inferentia per training e inferenza, che offrono vantaggi di costo a livello hardware. Claude è disponibile anche su Google Cloud Vertex AI e, da marzo 2026, su Microsoft Foundry.

Anthropic è in testa nei casi d’uso enterprise di sviluppo software e analisi dei dati. Un sondaggio tra CIO enterprise ha rilevato che la maggioranza delle aziende ora usa tre o più famiglie di modelli, segno che il deployment multi-modello sta diventando prassi comune.

Prezzi e accessibilità

Le strutture di prezzo differiscono tra i prodotti chat consumer e le API. Coprirò entrambi, ma poiché i prezzi cambiano spesso, mi concentrerò sulla struttura più che sui numeri esatti. Controlla la pagina prezzi di Anthropic e la pagina prezzi di OpenAI per le cifre più aggiornate.

Piani consumer

Entrambe le aziende offrono livelli gratuiti con accesso limitato. Il livello gratuito di ChatGPT include l’accesso ai modelli GPT con un limite mobile di circa 10 messaggi ogni 5 ore, dopodiché passa a un modello di qualità inferiore. Il livello gratuito di Claude offre accesso a Sonnet 4.6 con limiti giornalieri sui messaggi ma senza extended thinking.

OpenAI ha introdotto un nuovo livello d’ingresso a gennaio 2026: ChatGPT Go a 8 $ al mese, a metà tra i piani free e Plus (20 $ al mese). Degno di nota, il piano Go è supportato da pubblicità, rendendo OpenAI uno dei primi grandi laboratori di IA a introdurre advertising nel prodotto consumer. Claude Pro costa 20 $ al mese e include accesso a tutti i modelli, Claude Code ed extended thinking.

Nella fascia alta, il piano Pro di OpenAI costa 200 $ al mese per accesso illimitato. I piani Max di Anthropic vanno da 100 a 200 $ al mese con 5x fino a 20x l’uso del Pro.

Struttura dei prezzi API

OpenAI ha un chiaro vantaggio di prezzo in fascia budget. GPT-4.1 nano parte da 0,10 $ per milione di token in input, contro 1,00 $ per Claude Haiku 4.5. Anche GPT-4.1 mini a 0,40 $ è sensibilmente più economico di Haiku.

Al livello flagship, il divario si riduce. Claude Sonnet 4.6 è a 3$/15$ (input/output per milione di token) contro GPT-5.2 a 1,75$/14$. Claude Opus 4.6 costa 5$/25$ contro GPT-5.4 a 2,50$/15$. OpenAI resta generalmente più economica per token a ogni livello comparabile, ma Anthropic compensa per chi usa contesti lunghi rimuovendo i sovrapprezzi long-context nei modelli più recenti. GPT-5.4, al contrario, applica un premio per prompt oltre i 272K token.

Entrambi i provider offrono sconti per API batch e prompt caching per ridurre i costi in produzione.

Anthropic vs OpenAI: pro e contro

Ecco come le due piattaforme si confrontano sui fattori che contano di più.

|

Fattore |

OpenAI |

Anthropic |

|

Multimodale |

Testo, immagine, video e voce |

Solo testo e immagine |

|

Prezzi budget |

GPT-4.1 nano a 0,10 $/M token input |

Haiku 4.5 a 1,00 $/M token input |

|

Finestra di contesto |

1,05M token; sovrapprezzo oltre 272K |

1M token a prezzo flat |

|

Fine-tuning |

SFT, DPO, RFT per famiglia GPT-4.1 |

Limitato a Claude 3 Haiku solo su Bedrock |

|

Strumenti di coding |

Codex per compiti autonomi cloud-based |

Claude Code per refactoring complessi e output di produzione |

|

Portata enterprise |

~78% penetrazione in produzione |

~44%, +25 punti da maggio 2025 |

|

Ecosistema |

Azure, GitHub Copilot, GPT Store |

AWS Bedrock, Google Vertex AI, Microsoft Foundry |

|

Trasparenza sulla sicurezza |

Model Spec pubblico; ragionamento interno nascosto |

Constitutional AI e costituzione entrambe pubblicate |

|

Cadenza di rilascio |

Molto rapida; frequente deprecazione dei modelli |

Più stabile, meno breaking changes |

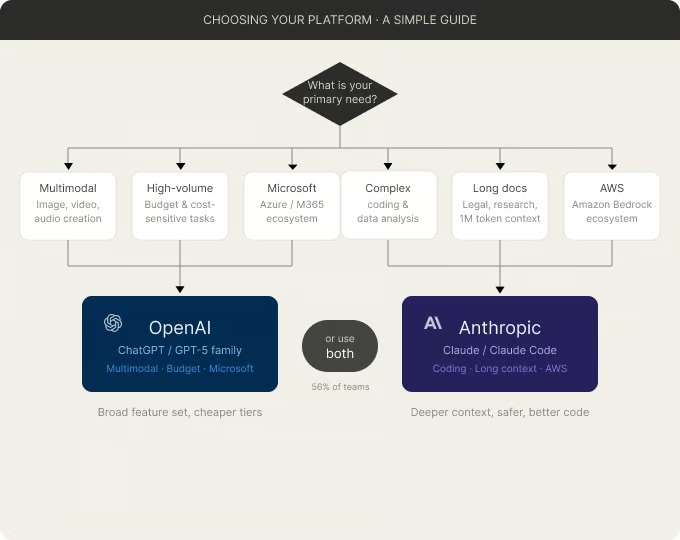

Quando scegliere Anthropic vs OpenAI

La scelta giusta dipende dal tuo caso d’uso specifico. Ecco gli scenari in cui ciascuna piattaforma tende a essere più adatta.

Una guida semplice per scegliere la tua piattaforma. Immagine dell’autore.

Scegli OpenAI se ti serve supporto multimodale su testo, immagine, audio e video. Se la tua organizzazione usa Microsoft e Azure, l’integrazione di OpenAI è ben collaudata. Per elaborazioni ad alto volume e sensibili ai costi, i modelli budget di OpenAI sono molto più economici degli equivalenti di Anthropic. Se è richiesto il fine-tuning su dati proprietari, OpenAI è avanti.

Scegli Anthropic se il tuo lavoro coinvolge sviluppo software complesso o analisi dei dati. Se devi processare documenti lunghi come revisioni legali, paper di ricerca o audit di interi codebase, la finestra di contesto da 1M token a tariffa flat di Anthropic è pratica. Per deployment sensibili alla sicurezza, l’approccio di Constitutional AI di Anthropic ha una traccia pubblica più dettagliata. Se costruisci su AWS, Claude è integrato nativamente tramite Bedrock.

Per molti team, la risposta è: entrambi. I dati di mercato mostrano che la maggioranza delle enterprise ora usa tre o più famiglie di modelli, e una larga quota di utenti paganti OpenAI paga anche per Anthropic. Instradare compiti diversi a modelli diversi in base ai loro punti di forza è una pratica sempre più comune.

Conclusione: Anthropic vs OpenAI nel 2026

OpenAI ha una portata più ampia, supporto multimodale più profondo e prezzi più bassi in fascia budget. Anthropic ha prestazioni migliori sui contesti lunghi, una traccia di sicurezza più trasparente e strumenti pensati per coding complesso e lavoro analitico.

La scelta giusta dipende da cosa stai costruendo e da quale ecosistema usi già. Il ciclo di deprecazione rapido di OpenAI significa che vale la pena controllare sia le pagine prezzi sia le liste dei modelli prima di impegnarti.

Se ti interessa un confronto specifico degli strumenti di coding delle due aziende, dai un’occhiata al nostro articolo Codex vs. Claude Code per un approfondimento su quella dimensione.

Inoltre, recupera con le nostre risorse consigliate:

- Il nostro corso Understanding ChatGPT spiega come scrivere prompt efficaci.

- Il nostro percorso ChatGPT Fundamentals combina ChatGPT con Python e analisi dei dati.

- Il nostro corso Introduction to Claude Models ti insegna a usare l’API di Anthropic.

Sono un data engineer e community builder: lavoro su pipeline dati, cloud e strumenti di AI, e scrivo tutorial pratici e ad alto impatto per DataCamp e per sviluppatori alle prime armi.

FAQ

Posso usare Claude e ChatGPT contemporaneamente?

Sì, e molti professionisti lo fanno. Molti riferiscono di usare in parallelo sia Claude sia ChatGPT, instradando compiti diversi a ciascuno. Le due piattaforme hanno punti di forza diversi, quindi usarle entrambe è comune nella pratica, anche se il costo delle due sottoscrizioni si somma.

Quale IA è migliore per imparare data science?

Entrambe funzionano bene, ma hanno stili diversi. Claude tende a produrre spiegazioni più strutturate, passo dopo passo, e gestisce bene documenti lunghi, quindi è utile per lavorare su manuali o paper di ricerca. ChatGPT ha un ecosistema più ampio, con un livello gratuito che offre accesso rapido a modelli capaci. Inizierei con il livello gratuito che trovi più comodo, poi farei l’upgrade in base a ciò che usi di più.

Anthropic è più "sicura" di OpenAI?

Anthropic ha costruito il proprio brand su un’IA con priorità alla sicurezza e il suo approccio di Constitutional AI è più trasparente della media. Ma entrambe le aziende hanno adattato i propri impegni sulla sicurezza nel 2025 e 2026 in risposta alla pressione competitiva. La sicurezza è meno binaria e più un obiettivo mobile. L’articolo copre le modifiche specifiche di policy per entrambe.

Claude supporta la generazione di immagini e video?

No. All’inizio del 2026, Claude gestisce input di testo e immagini, ma non genera immagini, video o audio. OpenAI ha uno stack multimodale più ampio che include generazione di immagini, video tramite Sora e una Realtime API per la voce. Se il tuo workflow dipende dalla generazione di contenuti visivi o audio, OpenAI è più adatta.

Quale è più economico per l’uso API?

Dipende dal livello. OpenAI ha modelli budget molto più economici, con GPT-4.1 nano che parte da 0,10 $ per milione di token in input contro 1,00 $ per Claude Haiku 4.5. Al livello flagship, i prezzi sono più vicini e Anthropic ha rimosso i sovrapprezzi per contesti lunghi nei modelli più recenti. La risposta giusta dipende dal tuo volume e da quale livello di modello ti serve davvero.