Kurs

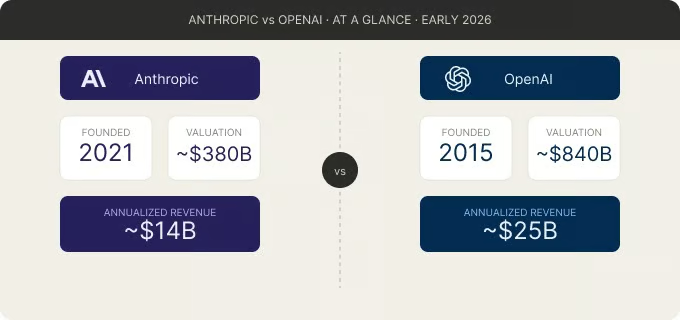

Wenn Sie mit großen Sprachmodellen (LLMs) arbeiten, haben Sie mit Sicherheit bereits ein Produkt von OpenAI oder Anthropic – oder von beiden – genutzt. OpenAI hat diese Kategorie mit ChatGPT populär gemacht, das Berichten zufolge Hunderte Millionen wöchentlich aktive Nutzer hat. Anthropic, 2021 von ehemaligen OpenAI-Forschern gegründet, hat sich zum zweitgrößten KI-Unternehmen nach Umsatz entwickelt, wobei Analysten den annualisierten Umsatz auf zweistellige Milliardenbeträge schätzen.

Doch dies ist nicht nur ein Modellvergleich. Anthropic und OpenAI stehen für zwei unterschiedliche Ansätze bei der Entwicklung von KI. OpenAI konzentriert sich auf eine breite Verbraucherbasis und multimodale Integration. Anthropic setzt auf Vertrauen im Unternehmensumfeld, Sicherheitsforschung und die Verarbeitung tiefgreifender Kontexte.

Was ist OpenAI?

OpenAI ist das Unternehmen hinter ChatGPT, der GPT-Modellfamilie, DALL-E und Sora. Es wurde 2015 in San Francisco ursprünglich als gemeinnützige Organisation gegründet. Im Oktober 2025 schloss das Unternehmen eine Umstrukturierung in eine Public Benefit Corporation (PBC) ab und löste das alte Modell mit Gewinnbegrenzung auf. Der gemeinnützige Arm wurde in OpenAI Foundation umbenannt, die weiterhin das Recht zur Ernennung des Vorstands behält und etwa 26 % der Anteile hält.

Die Partnerschaft von OpenAI mit Microsoft ist zentral für die Arbeitsweise des Unternehmens. Azure ist der exklusive Cloud-Anbieter für die API-Aufrufe von OpenAI, und OpenAI hat sich verpflichtet, über die Laufzeit der Vereinbarung 250 Milliarden US-Dollar für Azure-Dienste auszugeben. Die Partnerschaft wurde im Februar 2026 öffentlich bekräftigt, selbst als OpenAI in seiner jüngsten Finanzierungsrunde 110 Milliarden US-Dollar aufnahm – eine der größten privaten Finanzierungsrunden, die jemals verzeichnet wurden.

Auf der Produktseite verfolgt OpenAI eine Strategie der schnellen Iteration und aggressiven Modell-Deprecation. Im Februar 2026 nahm das Unternehmen mehrere ältere Modelle aus ChatGPT, darunter GPT-4o und GPT-4.1. Bis März 2026 wurde auch die Zwischenserie GPT-5.1 eingestellt. Dies hält die Produktlinie fokussiert, erfordert jedoch von Entwicklern, bei Migrationszeitplänen auf dem Laufenden zu bleiben.

Die GPT-5-Familie ist die aktuelle Generation von OpenAI. Sie wurde im August 2025 mit einer „Router“-Architektur eingeführt, die je nach Komplexität der Anfrage automatisch zwischen schnellen (Instant) und tiefgehenden (Thinking) Argumentationsmodi wählt. Die wichtigsten Modelle sind:

- GPT-5.4 (veröffentlicht im März 2026, das neueste Flaggschiff mit einem Kontextfenster von 1,05 Millionen Token),

- GPT-5.3 Codex (der spezialisierte Agent für Programmierung) und

- GPT-5.2 (das vorherige Flaggschiff, das nun eingestellt wird).

- Ebenfalls im März 2026 wurden GPT-5.4 mini und GPT-5.4 nano veröffentlicht, kleinere Varianten, die auf Geschwindigkeit und geringere Kosten ausgelegt sind. GPT-5.4 mini behält die meisten Stärken von GPT-5.4 in Bezug auf Programmierung, Werkzeugnutzung und Multimodalität bei, während es mehr als doppelt so schnell läuft. GPT-5.4 nano ist für einfachere Aufgaben mit hohem Volumen gedacht.

- OpenAI hat zudem Open-Weight-Modelle veröffentlicht (gpt-oss-120b und gpt-oss-20b unter der Apache 2.0-Lizenz), eine bemerkenswerte Abkehr von seinem historisch geschlossenen Ansatz.

Was ist Anthropic?

Anthropic ist das Unternehmen hinter der Claude-Modellfamilie. Es wurde 2021 von Dario Amodei (CEO), Daniela Amodei (Präsidentin) und etwa zehn weiteren ehemaligen OpenAI-Forschern gegründet, die das Unternehmen aufgrund von Meinungsverschiedenheiten über Sicherheits- und Kommerzialisierungsprioritäten verließen.

Die technische Identität des Unternehmens konzentriert sich auf Constitutional AI, einen Trainingsansatz, bei dem das Modell seine Ausgaben anhand eines schriftlichen Satzes ethischer Prinzipien selbst kritisiert, anstatt sich ausschließlich auf menschliches Feedback zu verlassen. Anthropic veröffentlichte im Januar 2026 eine Überarbeitung der Claude-Verfassung und vollzog einen Wechsel von einem regelbasierten zu einem begründungsbasierten Alignment-Ansatz: Anstatt dem Modell nur zu sagen, was es befolgen soll, erklärt die Verfassung, warum Regeln existieren, mit dem Ziel, in neuen Situationen ein nuancierteres Urteilsvermögen zu ermöglichen.

Der primäre Cloud- und Trainingspartner von Anthropic ist Amazon Web Services (AWS), wobei Amazon insgesamt 8 Milliarden US-Dollar investiert hat. Claude-Modelle sind auch auf Google Cloud Vertex AI (Google hält etwa 14 % an Anthropic) und seit März 2026 auch auf Microsoft Foundry verfügbar.

Die Claude 4 Familie ist die aktuelle Generation. Die Namenskonvention verwendet drei Stufen: Opus (Flaggschiff, leistungsfähigstes Modell), Sonnet (ausgewogen) und Haiku (schnell und kosteneffizient). Die neuesten Modelle sind:

- Claude Opus 4.6 (veröffentlicht im Februar 2026, das erstklassige Argumentationsmodell mit einem Kontextfenster von 1 Million Token und 128K maximaler Ausgabe)

- Claude Sonnet 4.6 (ebenfalls Februar 2026, der Standard für kostenlose und zahlende Nutzer mit einem 1M-Kontextfenster) und

- Claude Haiku 4.5 (veröffentlicht im Oktober 2025, die Budget-Option).

Über die Kernmodelle hinaus hat Anthropic Claude Code (einen terminalbasierten Coding-Agenten), Desktop-Agenten für nicht-technische Wissensarbeit sowie Agent-SDKs für Python und TypeScript zum Aufbau benutzerdefinierter agentischer Workflows veröffentlicht.

Anthropic vs. OpenAI: Vergleich der Modellfähigkeiten

Beide Plattformen sind für eine Vielzahl von Aufgaben geeignet, aber ihre Stärken unterscheiden sich. Es gibt kein einzelnes bestes Modell für alles. Lassen Sie mich dies nach Kategorien aufschlüsseln.

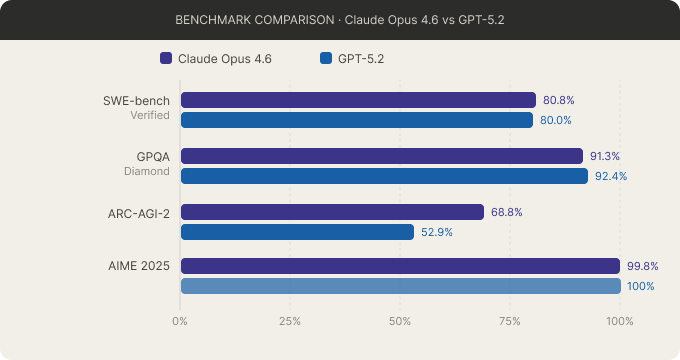

Benchmark-Ergebnisse in vier Schlüsseltests. Bild vom Autor.

Argumentation und Problemlösung

Beide Unternehmen bieten jetzt hybride Argumentation an, bei der ein einzelnes Modell zwischen schnellen Antworten und erweitertem „Chain-of-Thought“-Denken wechseln kann. Claude führte dies erstmals mit Claude 3.7 Sonnet im Februar 2025 ein. OpenAI folgte mit dem einheitlichen Router von GPT-5 im August 2025.

Bei den Benchmarks ist das Bild gemischt:

- AIME 2025 (Mathematikwettbewerb): GPT-5.2 führt, einschließlich eines perfekten Ergebnisses in einigen Testkonfigurationen.

- GPQA Diamond (Wissenschaft auf Hochschulniveau): GPT-5.2 übertrifft Claude knapp.

- ARC-AGI-2 (neuartige visuelle Logik, schwer aus Trainingsdaten auswendig zu lernen): Unabhängige Analysen sehen Claude Opus 4.6 bei etwa 68-69 % gegenüber GPT-5.2 bei etwa 52-54 %.

- Humanity's Last Exam (Synthese auf Expertenniveau): Claude führt basierend auf verfügbaren Vergleichen.

Basierend auf den Benchmark-Ergebnissen scheint OpenAI bei deterministischer Logik und faktischem Abruf besser abzuschneiden, während Anthropic bei kontextueller Synthese und qualitativer Analyse tendenziell besser ist. Keiner der Ansätze ist universell besser. Es hängt davon ab, was das Modell leisten soll.

Für einen genaueren Blick darauf, wie GPT-5.4 und Claude Opus 4.6 bei diesen Benchmarks im Vergleich abschneiden, lesen Sie unsere GPT-5.4 vs. Claude Opus 4.6 Aufschlüsselung.

Programmierung und Entwicklernutzung

Beide Unternehmen sind weit über die einfache Codegenerierung hinaus zu agentischen Coding-Tools übergegangen, verfolgen dabei jedoch sehr unterschiedliche Ansätze.

Claude Code läuft lokal, indiziert Ihre Codebasis und bittet um Genehmigung, bevor Dateien geändert werden. Claude Opus 4.5 erzielte 80,9 % bei SWE-bench Verified und liegt damit in den meisten unabhängigen Analysen vor den Modellen der GPT-5-Serie.

OpenAI Codex läuft in der Cloud, klont Ihr Repository in eine Sandbox und arbeitet autonom. Es erzielt 77,3 % bei Terminal-Bench 2.0 im Vergleich zu Claudes 65,4 % und verbraucht laut OpenAI für vergleichbare Aufgaben deutlich weniger Token.

In der Praxis wird Claude Code tendenziell für komplexes Refactoring und Ausgaben in Produktionsqualität bevorzugt. Codex wird eher für schnelles Prototyping und delegierte Hintergrundaufgaben bevorzugt. GPT-5.4 mini und nano erweitern dies weiter und fungieren als Unteragenten, die engere Aufgaben übernehmen, während ein größeres Modell die Planung und Überprüfung übernimmt.

Beim Fine-Tuning unterstützt OpenAI mehrere Methoden (SFT, DPO, RFT) für die GPT-4.1-Familie. Das Fine-Tuning von Anthropic ist auf Claude 3 Haiku auf Bedrock beschränkt, für Claude 4.x-Modelle ist Anfang 2026 nichts verfügbar.

Umgang mit langem Kontext

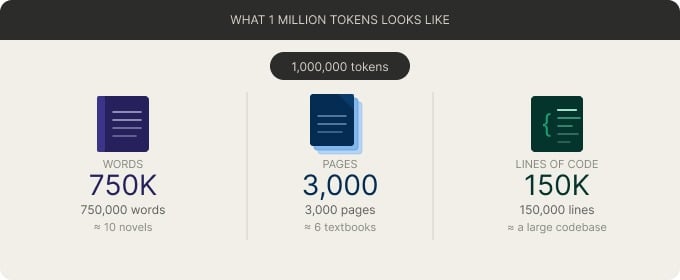

Beide Plattformen unterstützen jetzt Kontextfenster im Bereich von 1 Million Token, was etwa 750.000 Wörtern oder 150.000 Zeilen Code entspricht.

Claude Opus 4.6 und Sonnet 4.6 bieten 1M-Token-Kontextfenster mit Pauschalpreisen, was bedeutet, dass kein Aufpreis für die Nutzung des vollen Fensters anfällt. GPT-5.4 unterstützt ein 1,05M-Token-Kontextfenster, erhebt jedoch einen Aufschlag (2x Eingabe, 1,5x Ausgabe) für Prompts, die 272K Token überschreiten. Das ältere GPT-5.2 hat ein kleineres 400K-Token-Fenster.

Bei der Qualität des langen Kontexts erzielte Claude Opus 4.6 78,3 % bei MRCR v2 (einem Multi-Needle-Retrieval-Benchmark bei 1M Token) und liegt damit an der Spitze der in diesem Benchmark getesteten Modelle. Bei Workflows mit großen Dokumenten, ganzen Codebasen oder rechtlichen oder Forschungsüberprüfungen mehrerer Dokumente sind sowohl die Größe des Kontextfensters als auch die Abrufgenauigkeit wichtig, und Anthropic hat hier derzeit die Nase vorn.

Wie eine Million Token aussehen. Bild vom Autor.

Multimodale Fähigkeiten

Hier ist der Unterschied zwischen den beiden Plattformen am deutlichsten. OpenAI unterstützt nativ Text, Bilder, Audio und Video über seine gesamte Modellfamilie hinweg. Das Ökosystem umfasst Bildgenerierung (GPT Image 1), Videogenerierung (Sora 2), eine Echtzeit-Sprach-API und einen erweiterten Sprachmodus für konversationelles Audio. GPT-5.4 enthält auch Computer-Nutzungsfunktionen durch eine Vorschaufunktion.

Claude verarbeitet Text- und Bildeingaben und deckt die Dokumentenanalyse (PDFs, Diagramme, Tabellen) recht gut ab. Es unterstützt auch die Computernutzung durch einen vision-basierten Ansatz (Screenshot, dann Aktion), wobei sowohl Claude Opus 4.6 als auch Sonnet 4.6 dies unterstützen. Claude generiert keine Bilder, Audio oder Video.

Eine Sache, die erwähnenswert ist: Seit dem 12. März 2026 kann Claude interaktive Diagramme, Grafiken und Visualisierungen direkt im Chat erstellen. Dies sind keine statischen Bilder, sondern dynamische Visualisierungen, die sich aktualisieren, während sich das Gespräch entwickelt. Die Funktion ist für alle Plantypen verfügbar, einschließlich der kostenlosen Version. Dies unterscheidet sich von der Bildgenerierung und schließt die Lücke zu OpenAI an dieser Front nicht, ist aber eine sinnvolle Ergänzung für Daten- und Analyse-Workflows.

Wenn Ihre Arbeit Bildgenerierung, Audio oder Video erfordert, ist OpenAI immer noch die einzige Option hier. Wenn Ihre Bedürfnisse hauptsächlich Text, Dokumente und Datenanalyse sind, deckt Claude jetzt mehr ab als zuvor.

Anthropic vs. OpenAI: Sicherheits- und Alignment-Philosophie

Sicherheit ist einer der deutlichsten Unterschiede zwischen diesen beiden Unternehmen, und es lohnt sich, darauf zu schauen, was jedes tatsächlich getan hat, anstatt nur darauf, was sie sagen.

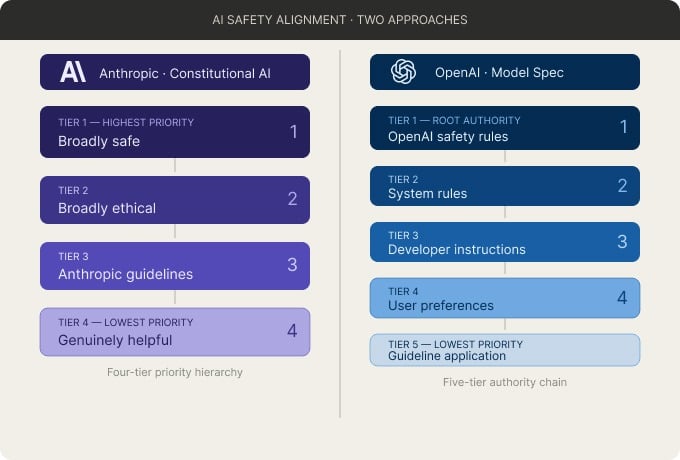

Zwei Ansätze für KI-Sicherheits-Alignment. Bild vom Autor.

Wie jedes Unternehmen Sicherheit angeht

Die Kernmethode von Anthropic ist Constitutional AI mit Reinforcement Learning from AI Feedback (RLAIF): Das Modell kritisiert seine Ausgaben selbst anhand eines schriftlichen Satzes von Prinzipien, die aus Quellen wie der UN-Menschenrechtscharta und akademischer Sicherheitsforschung stammen. Die Überarbeitung vom Januar 2026 führte eine vierstufige Prioritätshierarchie ein (allgemein sicher, allgemein ethisch, konform mit den Richtlinien von Anthropic, dann wirklich hilfreich) und erkannte offiziell die Möglichkeit von KI-Bewusstsein an, was zu der Zeit bemerkenswert war.

OpenAI verwendet Reinforcement Learning from Human Feedback (RLHF) zusammen mit einem Governance-Dokument namens Model Spec, das zuletzt im Dezember 2025 aktualisiert wurde. Es etabliert eine Autoritätskette von den Grundregeln von OpenAI bis hin zu den Benutzerpräferenzen. GPT-5 führte „sichere Vervollständigungen“ ein, die darauf abzielen, auf sensible Anfragen Antworten auf hohem Niveau zu geben, anstatt sie rundweg abzulehnen, und das Modell wurde darauf trainiert, weniger zustimmend und eher bereit zu sein, Widerstand zu leisten.

Der deutlichste Unterschied zwischen den beiden ist die Transparenz. OpenAI verbirgt die interne Gedankenkette des Modells vor den Benutzern mit dem Argument, dass eine Offenlegung missbraucht werden könnte. Anthropic veröffentlicht Interpretierbarkeitsforschung und Attributionsgraphen, die das interne Denken abbilden. Auf der praktischen Seite hielten die Constitutional Classifiers von Anthropic über 3.000 Stunden Red Teaming ohne einen universellen Jailbreak stand. Unabhängige Tests beziffern die Erfolgsrate von Prompt-Injection bei Claude Opus 4.5 auf etwa 4,7 %, was niedriger ist als das, was andere Plattformen gemeldet haben.

Beide Unternehmen haben ihre Sicherheitsverpflichtungen in den Jahren 2025 und 2026 ebenfalls überarbeitet. Kritiker argumentieren, dass die Änderungen frühere Versprechen abschwächen. Die Responsible Scaling Policy v3.0 von Anthropic ersetzte harte Pausenverpflichtungen durch offen bewertete öffentliche Ziele. Analysen des Preparedness Framework v2.0 von OpenAI argumentieren, dass einige Risikokategorien weniger expliziten Fokus vor der Bereitstellung erhalten als zuvor. Die Sicherheitspositionierung entwickelt sich bei beiden noch, daher lohnt es sich, ihre neuesten Richtliniendokumente zu prüfen, anstatt sich nur auf den Ruf zu verlassen.

Sicherheitsrichtlinienänderungen, die man kennen sollte

Beide Unternehmen haben ihre Sicherheitsverpflichtungen in den Jahren 2025 und 2026 angepasst. Kritiker argumentieren, dass diese Überarbeitungen frühere Versprechen abschwächen. Die Responsible Scaling Policy v3.0 von Anthropic (Februar 2026) ersetzte harte Pausenverpflichtungen durch öffentliche Ziele, die offen bewertet werden, und ließ das fallen, was frühere Versionen als bedingungslose Bereitstellungsschutzmaßnahmen behandelten. Analysen des Preparedness Framework v2.0 von OpenAI (April 2025) argumentieren, dass einige Risikokategorien, wie Massenmanipulation und Desinformation, weniger expliziten Fokus vor der Bereitstellung erhalten als zuvor.

Diese Verschiebungen haben Kritik aus der KI-Sicherheits-Community auf sich gezogen. Beide Unternehmen nennen Wettbewerbsdruck als Faktor. Die Sicherheitspositionierung entwickelt sich bei beiden, daher lohnt es sich, ihre neuesten Richtliniendokumente zu prüfen, anstatt sich nur auf den Ruf zu verlassen.

API-Ökosystem und Entwicklererfahrung

Anthropic bietet eine fokussierte API-Oberfläche durch die Messages API. SDKs sind in sieben Sprachen verfügbar (Python, TypeScript, Java, Go, Ruby, C# und PHP). Die API unterstützt Werkzeugnutzung und Funktionsaufrufe, strukturierte JSON-Ausgabe, Vision-Eingaben, erweitertes Denken mit einem konfigurierbaren Token-Budget und Streaming. Anthropic hat auch das Model Context Protocol (MCP) initiiert, einen offenen Standard für die Verbindung von KI-Agenten mit externen Werkzeugen und Datenquellen, der von einer wachsenden Anzahl von Werkzeugen und Plattformen übernommen wurde.

Die API von OpenAI ist breiter gefächert. Sie umfasst die Responses API (die die Assistants API ersetzte), die Chat Completions API, eine Realtime API für Audio und Sprache sowie SDKs für Python, TypeScript, Go und Java. Über die Standardfunktionen hinaus (Funktionsaufrufe, strukturierte Ausgaben, Streaming, Batch-Modus) bietet OpenAI auch eine API zur Bildgenerierung, Text-zu-Sprache, Transkription und Embeddings.

|

Funktion |

Claude |

OpenAI |

|

Werkzeug- und Funktionsaufrufe |

Ja |

Ja |

|

Strukturierte JSON-Ausgabe |

Ja |

Ja |

|

Streaming |

Ja |

Ja |

|

Batch API (50 % Rabatt) |

Ja |

Ja |

|

Prompt-Caching |

Ja |

Ja |

|

Integrierte Websuche |

Ja |

Ja |

|

Codeausführung |

Ja |

Ja |

|

Computernutzung |

Ja (Opus 4.6, Sonnet 4.6) |

Ja (Vorschau) |

|

Fine-Tuning |

Begrenzt (nur Haiku 3 auf Bedrock) |

Ja (SFT, DPO, RFT für GPT-4.1-Familie) |

|

Bildgenerierung |

Nein |

Ja |

|

Audio-Eingabe und -Ausgabe |

Nein |

Ja (Realtime API, TTS) |

|

Agent-SDK |

Ja (Python, TypeScript) |

Ja (Open-Source, Python, TypeScript) |

Wie ich im Coding-Abschnitt erwähnte, ist die Fine-Tuning-Lücke erwähnenswert. OpenAI unterstützt mehrere Fine-Tuning-Methoden über mehrere Modellstufen hinweg durch seine direkte API und Azure. Anthropic beschränkt das Fine-Tuning auf ein einzelnes Modell auf einer einzigen Cloud-Plattform.

Unternehmenseinsatz und Partnerschaften

Die API-Spezifikationen sind eine Sache. Wie Unternehmen diese Plattformen tatsächlich nutzen, ist eine andere.

OpenAI und Microsoft

OpenAI hält den größeren Unternehmensanteil mit etwa 78 % Produktionsdurchdringung und etwa 56 % der gesamten LLM-Ausgaben von Unternehmen, laut Branchenumfragen.

Die Microsoft-Integration ist tiefgreifend. Der Azure OpenAI Service bietet direkten Zugriff auf alle GPT-5.x-Modelle. Microsoft 365 Copilot (betrieben von OpenAI-Modellen) wurde von der überwiegenden Mehrheit der zahlenden Unternehmenslizenzen in den befragten Organisationen übernommen, und GitHub Copilot hält etwa 70 % Marktanteil bei Coding-Tools für Unternehmen.

OpenAI führt bei Chatbot-Bereitstellung, Wissensmanagement in Unternehmen und Kundensupport-Anwendungsfällen.

Anthropic und Amazon

Die Unternehmensdurchdringung von Anthropic liegt bei 44 %, ein Anstieg um 25 Prozentpunkte seit Mai 2025, was laut Umfragedaten der größte Zuwachs eines KI-Anbieters in diesem Zeitraum war. Das Unternehmen generiert etwa 80 % seines Umsatzes mit Unternehmenskunden und zählt 8 der Fortune 10 zu den Claude-Kunden. Zu den bemerkenswerten Bereitstellungen gehören Deloitte (470.000 Mitarbeiter) und Cognizant (350.000 Mitarbeiter).

Die AWS-Partnerschaft gibt Anthropic Zugriff auf benutzerdefinierte Amazon Trainium- und Inferentia-Chips für Training und Inferenz, die Kostenvorteile auf Hardware-Ebene bieten. Claude ist auch auf Google Cloud Vertex AI und seit März 2026 auf Microsoft Foundry verfügbar.

Anthropic führt bei Anwendungsfällen für Softwareentwicklung und Datenanalyse in Unternehmen. Eine Umfrage unter CIOs von Unternehmen ergab, dass die Mehrheit der Unternehmen jetzt drei oder mehr Modellfamilien verwendet, was darauf hindeutet, dass die Bereitstellung mehrerer Modelle zur gängigen Praxis wird.

Preisgestaltung und Zugänglichkeit

Die Preisstrukturen unterscheiden sich zwischen den Chat-Produkten für Verbraucher und den APIs. Ich werde beides behandeln, aber da sich die Preise häufig ändern, werde ich mich auf die Struktur konzentrieren, nicht auf exakte Zahlen. Überprüfen Sie die Preisseite von Anthropic und die Preisseite von OpenAI für die neuesten Zahlen.

Verbrauchertarife

Beide Unternehmen bieten kostenlose Stufen mit begrenztem Zugriff an. Die kostenlose Stufe von ChatGPT beinhaltet den Zugriff auf GPT-Modelle mit einem rollierenden Limit von etwa 10 Nachrichten alle 5 Stunden, wonach auf ein Modell geringerer Qualität zurückgegriffen wird. Die kostenlose Stufe von Claude bietet Zugriff auf Sonnet 4.6 mit täglichen Nachrichtenlimits, aber ohne erweitertes Denken.

OpenAI führte im Januar 2026 eine neue Einstiegsstufe ein: ChatGPT Go für 8 US-Dollar pro Monat, die zwischen den kostenlosen und den Plus-Plänen (20 US-Dollar pro Monat) liegt. Bemerkenswert ist, dass der Go-Plan werbefinanziert ist, was OpenAI zu einem der ersten großen KI-Labore macht, das Werbung in seinem Verbraucherprodukt einführt. Claude Pro kostet 20 US-Dollar pro Monat und beinhaltet Zugriff auf alle Modelle, Claude Code und erweitertes Denken.

Am oberen Ende kostet der Pro-Plan von OpenAI 200 US-Dollar pro Monat für unbegrenzten Zugriff. Die Max-Pläne von Anthropic reichen von 100 bis 200 US-Dollar pro Monat mit 5- bis 20-facher Pro-Nutzung.

API-Preisstruktur

OpenAI hat einen klaren Preisvorteil am Budget-Ende. GPT-4.1 nano beginnt bei 0,10 US-Dollar pro Million Eingabe-Token, verglichen mit 1,00 US-Dollar für Claude Haiku 4.5. Selbst GPT-4.1 mini für 0,40 US-Dollar ist deutlich günstiger als Haiku.

Auf der Flaggschiff-Ebene verringert sich die Lücke. Claude Sonnet 4.6 liegt bei 3 US-Dollar/15 US-Dollar (Eingabe/Ausgabe pro Million Token) gegenüber GPT-5.2 bei 1,75 US-Dollar/14 US-Dollar. Claude Opus 4.6 kostet 5 US-Dollar/25 US-Dollar gegenüber GPT-5.4 bei 2,50 US-Dollar/15 US-Dollar. OpenAI ist pro Token auf jeder vergleichbaren Stufe im Allgemeinen immer noch günstiger, aber Anthropic gleicht dies für Nutzer mit großem Kontext aus, indem es die Aufschläge für langen Kontext bei seinen neuesten Modellen entfernt. GPT-5.4 hingegen erhebt eine Prämie für Prompts, die 272K Token überschreiten.

Beide Anbieter bieten Batch-API-Rabatte und Prompt-Caching an, um die Kosten für Produktions-Workloads zu senken.

Anthropic vs. OpenAI: Vor- und Nachteile

Hier ist der Vergleich der beiden Plattformen anhand der Faktoren, die am wichtigsten sind.

|

Faktor |

OpenAI |

Anthropic |

|

Multimodal |

Text, Bild, Video und Sprache |

Nur Text und Bild |

|

Budget-Preisgestaltung |

GPT-4.1 nano für 0,10 $/M Eingabe-Token |

Haiku 4.5 für 1,00 $/M Eingabe-Token |

|

Kontextfenster |

1,05M Token; Aufschlag über 272K |

1M Token bei Pauschalpreisen |

|

Fine-Tuning |

SFT, DPO, RFT für GPT-4.1-Familie |

Begrenzt auf nur Claude 3 Haiku auf Bedrock |

|

Coding-Tools |

Codex für cloudbasierte autonome Aufgaben |

Claude Code für komplexes Refactoring und Produktionsausgabe |

|

Unternehmensreichweite |

~78 % Produktionsdurchdringung |

~44 %, Anstieg um 25 Punkte seit Mai 2025 |

|

Ökosystem |

Azure, GitHub Copilot, GPT Store |

AWS Bedrock, Google Vertex AI, Microsoft Foundry |

|

Sicherheitstransparenz |

Model Spec öffentlich; internes Denken verborgen |

Constitutional AI und Verfassung beide veröffentlicht |

|

Veröffentlichungsrhythmus |

Schnelllebig; häufige Modell-Deprecation |

Stabiler, weniger Breaking Changes |

Wann man Anthropic vs. OpenAI wählen sollte

Die richtige Wahl hängt von Ihrem spezifischen Anwendungsfall ab. Hier sind die Szenarien, in denen jede Plattform tendenziell besser passt.

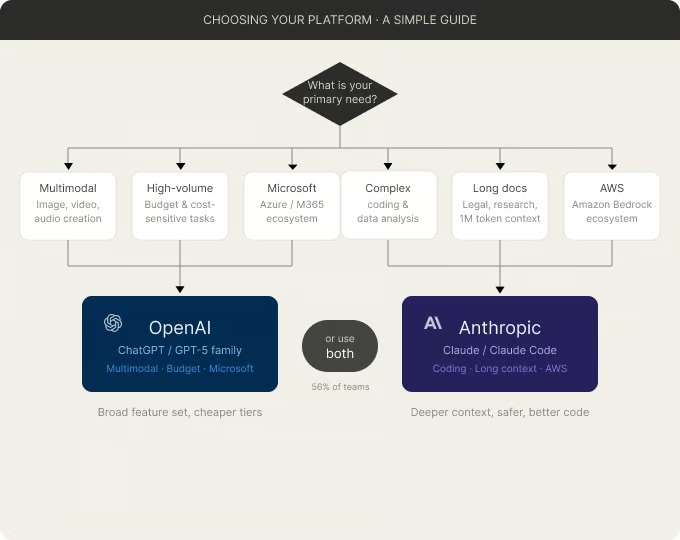

Ein einfacher Leitfaden zur Wahl Ihrer Plattform. Bild vom Autor.

Wählen Sie OpenAI, wenn Sie multimodale Unterstützung für Text, Bild, Audio und Video benötigen. Wenn Ihr Unternehmen auf Microsoft und Azure läuft, ist die Integration von OpenAI gut etabliert. Für die Verarbeitung mit hohem Volumen und Kostenempfindlichkeit sind die Budget-Modelle von OpenAI viel günstiger als die Äquivalente von Anthropic. Wenn Fine-Tuning auf proprietären Daten eine Anforderung ist, hat OpenAI hier die Nase vorn.

Wählen Sie Anthropic, wenn Ihre Arbeit komplexe Softwareentwicklung oder Datenanalyse beinhaltet. Wenn Sie lange Dokumente wie rechtliche Überprüfungen, Forschungspapiere oder vollständige Codebasis-Audits verarbeiten müssen, ist das 1M-Token-Kontextfenster mit Pauschalpreis von Anthropic praktisch. Für sicherheitskritische Bereitstellungen hat der Constitutional AI-Ansatz von Anthropic eine detailliertere öffentliche Aufzeichnung. Wenn Sie auf AWS aufbauen, ist Claude nativ durch Bedrock integriert.

Für viele Teams lautet die Antwort: beides. Marktdaten zeigen, dass die Mehrheit der Unternehmen jetzt drei oder mehr Modellfamilien verwendet und ein großer Teil der zahlenden OpenAI-Nutzer auch für Anthropic zahlt. Das Routing verschiedener Aufgaben an verschiedene Modelle basierend auf ihren Stärken wird zunehmend zur gängigen Praxis.

Fazit: Anthropic vs. OpenAI im Jahr 2026

OpenAI hat eine breitere Reichweite, tiefere multimodale Unterstützung und günstigere Preise in der Budget-Stufe. Anthropic hat eine stärkere Leistung bei langem Kontext, eine transparentere Sicherheitsbilanz und Werkzeuge, die auf komplexe Coding- und analytische Arbeit ausgerichtet sind.

Die richtige Wahl hängt davon ab, was Sie bauen und in welchem Ökosystem Sie sich bereits befinden. Der schnelle Deprecation-Zyklus von OpenAI bedeutet, dass es sich lohnt, beide Preisseiten und Modelllisten zu prüfen, bevor man sich festlegt.

Wenn Sie daran interessiert sind, wie die Coding-Tools der beiden Unternehmen im Vergleich abschneiden, lesen Sie unseren Codex vs. Claude Code Artikel für einen tieferen Einblick in diese Dimension.

Informieren Sie sich auch über unsere empfohlenen Ressourcen:

- Unser Understanding ChatGPT Kurs führt Sie durch das Schreiben effektiver Prompts.

- Unser ChatGPT Fundamentals Track kombiniert ChatGPT mit Python und Datenanalyse.

- Unser Introduction to Claude Models Kurs lehrt Sie, wie Sie die Anthropic API verwenden.

Ich bin Dateningenieur und Community-Builder und arbeite mit Datenpipelines, Cloud- und KI-Tools. Außerdem schreibe ich praktische, super nützliche Tutorials für DataCamp und angehende Entwickler.

FAQs

Kann ich Claude und ChatGPT gleichzeitig verwenden?

Ja, und viele Fachleute tun dies. Viele berichten, dass sie Claude und ChatGPT parallel nutzen und verschiedene Aufgaben an jedes der beiden Modelle weiterleiten. Die beiden Plattformen bedienen unterschiedliche Stärken, daher ist die gleichzeitige Nutzung in der Praxis üblich, auch wenn sich die Kosten für das doppelte Abonnement summieren.

Welche KI ist besser, um Data Science zu lernen?

Beide funktionieren gut, haben aber unterschiedliche Stile. Claude neigt dazu, strukturiertere, schrittweise Erklärungen zu produzieren und geht gut mit langen Dokumenten um, daher ist es nützlich, um Lehrbücher oder Forschungspapiere durchzuarbeiten. ChatGPT hat ein breiteres Ökosystem mit einer kostenlosen Stufe, die schnellen Zugriff auf leistungsfähige Modelle bietet. Ich würde mit der kostenlosen Stufe beginnen, die Sie angenehmer finden, und dann basierend auf dem, was Sie am meisten nutzen, ein Upgrade durchführen.

Ist Anthropic „sicherer“ als OpenAI?

Anthropic hat seine Marke um sicherheitsorientierte KI herum aufgebaut, und sein Constitutional AI-Ansatz ist transparenter als die meisten anderen. Aber beide Unternehmen haben ihre Sicherheitsverpflichtungen in den Jahren 2025 und 2026 als Reaktion auf den Wettbewerbsdruck angepasst. Sicherheit ist weniger ein binäres Ziel als vielmehr ein bewegliches Ziel. Der Artikel behandelt die spezifischen Richtlinienänderungen für beide.

Unterstützt Claude Bild- und Videogenerierung?

Nein. Anfang 2026 verarbeitet Claude Text- und Bildeingaben, generiert aber keine Bilder, Videos oder Audio. OpenAI verfügt über einen breiteren multimodalen Stack, der Bildgenerierung, Video durch Sora und eine Echtzeit-Sprach-API umfasst. Wenn Ihr Workflow von der Generierung visueller oder akustischer Inhalte abhängt, ist OpenAI die bessere Wahl.

Welche ist günstiger für die API-Nutzung?

Es hängt von der Stufe ab. OpenAI hat viel günstigere Budget-Modelle, wobei GPT-4.1 nano bei 0,10 US-Dollar pro Million Eingabe-Token beginnt, gegenüber 1,00 US-Dollar für Claude Haiku 4.5. Auf der Flaggschiff-Ebene ist die Preisgestaltung näher beieinander, und Anthropic hat die Aufschläge für langen Kontext für seine neuesten Modelle entfernt. Die richtige Antwort hängt von Ihrem Volumen und der Modellstufe ab, die Sie tatsächlich benötigen.