Curso

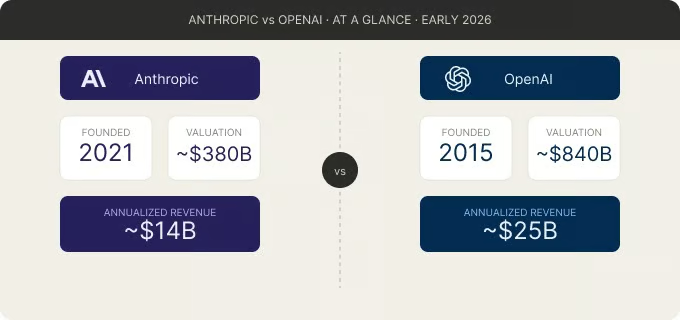

Si trabajas con modelos de lenguaje extensos (LLM), es casi seguro que has utilizado un producto de OpenAI o de Anthropic, o de ambos. OpenAI popularizó la categoría con ChatGPT, que según se informa cuenta con cientos de millones de usuarios activos semanales. Anthropic, fundada en 2021 por antiguos investigadores de OpenAI, se ha convertido en la segunda empresa de IA más grande por ingresos, con analistas que estiman sus ingresos anualizados en decenas de miles de millones.

Pero esto no es solo una comparación de modelos. Anthropic y OpenAI representan dos enfoques diferentes para construir IA. OpenAI se ha centrado en un alcance de consumo masivo y en la integración multimodal. Anthropic se ha centrado en la confianza empresarial, la investigación en seguridad y el manejo de contextos profundos.

¿Qué es OpenAI?

OpenAI es la empresa detrás de ChatGPT, la familia de modelos GPT, DALL-E y Sora. Fue fundada en 2015 en San Francisco, originalmente como una organización sin ánimo de lucro. En octubre de 2025, completó una reestructuración para convertirse en una Corporación de Beneficio Público (PBC), disolviendo el antiguo modelo de beneficios limitados. La rama sin ánimo de lucro pasó a llamarse OpenAI Foundation, que conserva el poder de nombramiento de la junta y aproximadamente el 26% del capital.

La asociación de OpenAI con Microsoft es fundamental para su funcionamiento. Azure es el proveedor de nube exclusivo para las llamadas a la API de OpenAI, y OpenAI se ha comprometido a invertir 250.000 millones de dólares en servicios de Azure durante la vigencia del acuerdo. La asociación fue reafirmada públicamente en febrero de 2026, incluso cuando OpenAI recaudó 110.000 millones de dólares en su ronda de financiación más reciente, reportada como una de las mayores rondas de financiación privada registradas.

En cuanto al producto, OpenAI ha seguido una estrategia de iteración rápida y una agresiva retirada de modelos. En febrero de 2026, la empresa retiró varios modelos antiguos de ChatGPT, incluidos GPT-4o y GPT-4.1. Para marzo de 2026, la serie intermedia GPT-5.1 también fue retirada. Esto mantiene la línea de productos enfocada, pero exige a los desarrolladores estar al tanto de los plazos de migración.

La familia GPT-5 es la generación actual de OpenAI. Se lanzó en agosto de 2025 con una arquitectura de "enrutador" que selecciona automáticamente entre modos de razonamiento rápido (Instant) y profundo (Thinking) según la complejidad de la consulta. Los modelos clave a conocer son:

- GPT-5.4 (lanzado en marzo de 2026, el buque insignia más reciente con una ventana de contexto de 1,05 millones de tokens),

- GPT-5.3 Codex (el especialista en codificación agentica), y

- GPT-5.2 (el buque insignia anterior, ahora en proceso de retirada).

- También lanzados en marzo de 2026 están GPT-5.4 mini y GPT-5.4 nano, variantes más pequeñas diseñadas para mayor velocidad y menor coste. GPT-5.4 mini mantiene la mayoría de las fortalezas de codificación, uso de herramientas y multimodalidad de GPT-5.4 mientras funciona más del doble de rápido. GPT-5.4 nano está dirigido a tareas más sencillas de alto volumen.

- OpenAI también lanzó modelos de pesos abiertos (gpt-oss-120b y gpt-oss-20b bajo la licencia Apache 2.0), un cambio notable respecto a su enfoque históricamente cerrado.

¿Qué es Anthropic?

Anthropic es la empresa detrás de la familia de modelos Claude. Fue fundada en 2021 por Dario Amodei (CEO), Daniela Amodei (Presidenta) y aproximadamente otros diez antiguos investigadores de OpenAI que se marcharon por desacuerdos sobre las prioridades de seguridad y comercialización.

La identidad técnica de la empresa se centra en la IA Constitucional, un enfoque de entrenamiento donde el modelo autocritica sus resultados frente a un conjunto escrito de principios éticos, en lugar de depender únicamente de la retroalimentación humana. Anthropic publicó una revisión de la Constitución de Claude en enero de 2026, cambiando de un enfoque de alineación basado en reglas a uno basado en el razonamiento: en lugar de simplemente decirle al modelo qué seguir, la constitución explica por qué existen las reglas, con el objetivo de permitir un juicio más matizado en situaciones novedosas.

El principal socio de nube y entrenamiento de Anthropic es Amazon Web Services (AWS), con una inversión total de 8.000 millones de dólares por parte de Amazon. Los modelos Claude también están disponibles en Google Cloud Vertex AI (Google posee aproximadamente el 14% de Anthropic), y desde marzo de 2026, también en Microsoft Foundry.

La familia Claude 4 es la generación actual. La convención de nombres utiliza tres niveles: Opus (buque insignia, el más capaz), Sonnet (equilibrado) y Haiku (rápido y eficiente en costes). Los modelos más recientes son:

- Claude Opus 4.6 (lanzado en febrero de 2026, el modelo de razonamiento de nivel superior con una ventana de contexto de 1 millón de tokens y 128K de salida máxima)

- Claude Sonnet 4.6 (también de febrero de 2026, el predeterminado para usuarios gratuitos y de pago con una ventana de contexto de 1M), y

- Claude Haiku 4.5 (lanzado en octubre de 2025, la opción económica).

Más allá de los modelos principales, Anthropic ha lanzado Claude Code (un agente de codificación basado en terminal), agentes de estilo escritorio para trabajo de conocimiento no técnico, y SDKs de agentes para Python y TypeScript para construir flujos de trabajo agenticos personalizados.

Anthropic frente a OpenAI: Comparativa de capacidades de los modelos

Ambas plataformas son capaces en una amplia gama de tareas, pero sus fortalezas difieren. No existe un único mejor modelo para todo. Permíteme desglosarlo por categoría.

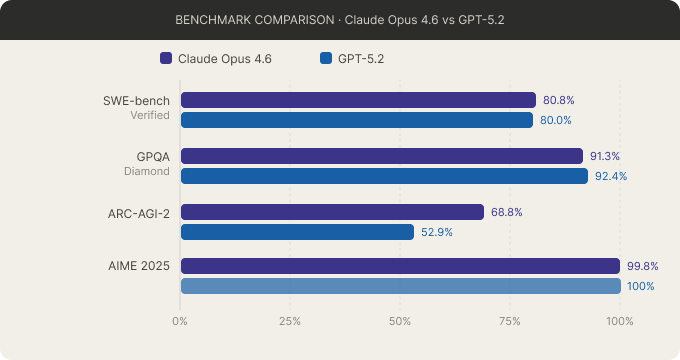

Puntuaciones de los benchmarks en cuatro pruebas clave. Imagen del autor.

Razonamiento y resolución de problemas

Ambas empresas ofrecen ahora razonamiento híbrido, donde un solo modelo puede cambiar entre respuestas rápidas y un pensamiento extendido paso a paso. Claude introdujo esto por primera vez con Claude 3.7 Sonnet en febrero de 2025. OpenAI le siguió con el enrutador unificado de GPT-5 en agosto de 2025.

En los benchmarks, el panorama es mixto:

- AIME 2025 (competición de matemáticas): GPT-5.2 lidera, incluyendo una puntuación perfecta en algunas configuraciones de prueba.

- GPQA Diamond (ciencia de nivel de posgrado): GPT-5.2 supera a Claude por un estrecho margen.

- ARC-AGI-2 (lógica visual novedosa, difícil de memorizar a partir de datos de entrenamiento): análisis independientes sitúan a Claude Opus 4.6 en aproximadamente un 68-69% frente a GPT-5.2 en aproximadamente un 52-54%.

- Humanity's Last Exam (síntesis de nivel experto): Claude lidera según las comparaciones disponibles.

Basándose en los resultados de los benchmarks, OpenAI parece funcionar mejor en lógica determinista y recuperación de hechos, mientras que Anthropic tiende a funcionar mejor en síntesis contextual y análisis cualitativo. Ningún enfoque es universalmente mejor. Depende de lo que necesites que haga el modelo.

Para un análisis más detallado de cómo se comparan GPT-5.4 y Claude Opus 4.6 específicamente en estos benchmarks, consulta nuestro desglose GPT-5.4 frente a Claude Opus 4.6.

Codificación y uso para desarrolladores

Ambas empresas han ido mucho más allá de la simple generación de código hacia herramientas de codificación agentica, pero adoptan enfoques muy diferentes.

Claude Code se ejecuta localmente, indexa tu base de código y solicita aprobación antes de modificar archivos. Claude Opus 4.5 obtuvo un 80,9% en SWE-bench Verified, situándose por delante de los modelos de la serie GPT-5 en la mayoría de los análisis independientes.

OpenAI Codex se ejecuta en la nube, clona tu repositorio en un entorno aislado (sandbox) y trabaja de forma autónoma. Obtiene un 77,3% en Terminal-Bench 2.0 en comparación con el 65,4% de Claude y, según OpenAI, utiliza significativamente menos tokens para tareas comparables.

En la práctica, Claude Code tiende a ser preferido para refactorizaciones complejas y resultados de calidad de producción. Codex tiende a ser preferido para prototipado rápido y tareas delegadas en segundo plano. GPT-5.4 mini y nano extienden esto aún más, actuando como subagentes que manejan tareas más estrechas mientras un modelo más grande se encarga de la planificación y revisión.

En cuanto al ajuste fino (fine-tuning), OpenAI admite múltiples métodos (SFT, DPO, RFT) para la familia GPT-4.1. El ajuste fino de Anthropic se limita a Claude 3 Haiku en Bedrock, sin nada disponible para los modelos Claude 4.x a principios de 2026.

Manejo de contexto largo

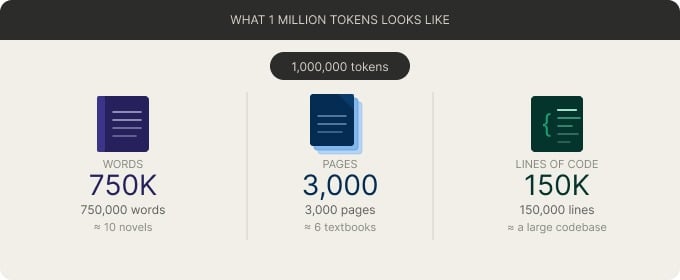

Ambas plataformas admiten ahora ventanas de contexto en el rango de 1 millón de tokens, lo que equivale aproximadamente a 750.000 palabras o 150.000 líneas de código.

Claude Opus 4.6 y Sonnet 4.6 ofrecen ventanas de contexto de 1M de tokens con precios fijos, lo que significa que no hay recargo por utilizar la ventana completa. GPT-5.4 admite una ventana de contexto de 1,05M de tokens, pero aplica un recargo (2x entrada, 1,5x salida) para prompts que superen los 272K tokens. El GPT-5.2 más antiguo tiene una ventana más pequeña de 400K tokens.

En cuanto a la calidad del contexto largo, Claude Opus 4.6 obtuvo un 78,3% en MRCR v2 (un benchmark de recuperación de múltiples agujas a 1M de tokens), situándolo en la cima entre los modelos probados en ese benchmark. Para flujos de trabajo que involucran documentos grandes, bases de código completas o revisiones legales o de investigación de múltiples documentos, tanto el tamaño de la ventana de contexto como la precisión de la recuperación son importantes, y Anthropic tiene actualmente una ventaja aquí.

Cómo se ve un millón de tokens. Imagen del autor.

Capacidades multimodales

Aquí es donde la diferencia entre las dos plataformas es más obvia. OpenAI admite texto, imágenes, audio y vídeo de forma nativa en toda su familia de modelos. El ecosistema incluye generación de imágenes (GPT Image 1), generación de vídeo (Sora 2), una API de voz en tiempo real y un modo de voz avanzado para audio conversacional. GPT-5.4 también incluye capacidades de uso de ordenador a través de una función de vista previa.

Claude maneja entradas de texto e imagen y cubre el análisis de documentos (PDFs, gráficos, tablas) razonablemente bien. También admite el uso de ordenador a través de un enfoque basado en visión (captura de pantalla, luego acción), con Claude Opus 4.6 y Sonnet 4.6 admitiendo esto. Claude no genera imágenes, audio ni vídeo.

Una cosa a destacar: a fecha de 12 de marzo de 2026, Claude puede crear gráficos, diagramas y visualizaciones interactivas directamente en el chat. No son imágenes estáticas, sino visuales dinámicos que se actualizan a medida que se desarrolla la conversación. La función está disponible en todos los tipos de planes, incluido el gratuito. Esto es diferente de la generación de imágenes y no cierra la brecha con OpenAI en ese frente, pero es una adición significativa para los flujos de trabajo de datos y análisis.

Si tu trabajo requiere generación de imágenes, audio o vídeo, OpenAI sigue siendo la única opción aquí. Si tus necesidades son principalmente texto, documentos y análisis de datos, Claude ahora cubre más terreno que antes.

Anthropic frente a OpenAI: Filosofía de seguridad y alineación

La seguridad es una de las diferencias más claras entre estas dos empresas, y vale la pena observar lo que cada una ha hecho realmente en lugar de solo lo que dicen.

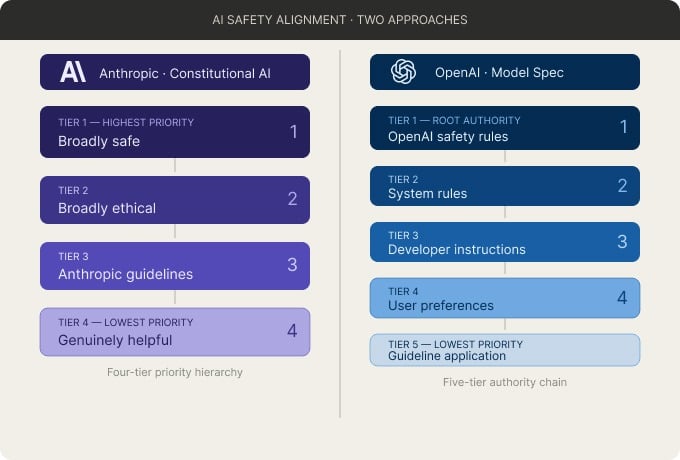

Dos enfoques para la alineación de seguridad de la IA. Imagen del autor.

Cómo aborda cada empresa la seguridad

El método principal de Anthropic es la IA Constitucional con Aprendizaje por Refuerzo a partir de Retroalimentación de IA (RLAIF): el modelo autocritica sus resultados frente a un conjunto escrito de principios extraídos de fuentes como la Declaración Universal de los Derechos Humanos y la investigación académica sobre seguridad. La revisión de enero de 2026 introdujo una jerarquía de prioridades de cuatro niveles (ampliamente seguro, ampliamente ético, conforme a las directrices de Anthropic y, finalmente, genuinamente útil) y reconoció formalmente la posibilidad de la conciencia de la IA, lo cual fue notable en ese momento.

OpenAI utiliza Aprendizaje por Refuerzo a partir de Retroalimentación Humana (RLHF) junto con un documento de gobernanza llamado Model Spec, actualizado por última vez en diciembre de 2025. Establece una cadena de autoridad desde las reglas raíz de OpenAI hasta las preferencias del usuario. GPT-5 introdujo "completados seguros", que tienen como objetivo dar respuestas de alto nivel a consultas sensibles en lugar de negarse directamente, y el modelo fue entrenado para ser menos complaciente y más dispuesto a cuestionar.

La diferencia más clara entre ambos es la transparencia. OpenAI oculta la cadena de pensamiento interna del modelo a los usuarios, argumentando que exponerla podría ser mal utilizada. Anthropic publica investigación de interpretabilidad y gráficos de atribución que mapean el razonamiento interno. En el lado práctico, los Clasificadores Constitucionales de Anthropic resistieron más de 3.000 horas de red teaming sin un jailbreak universal. Las pruebas independientes sitúan la tasa de éxito de inyección de prompts de Claude Opus 4.5 en aproximadamente un 4,7%, lo cual es más bajo de lo que han reportado otras plataformas.

Ambas empresas también revisaron sus compromisos de seguridad en 2025 y 2026. Los críticos argumentan que los cambios debilitan las promesas anteriores. La Política de Escalado Responsable v3.0 de Anthropic reemplazó los compromisos de pausa estricta con objetivos públicos calificados abiertamente. Los análisis del Marco de Preparación v2.0 de OpenAI argumentan que algunas categorías de riesgo reciben menos enfoque explícito previo al despliegue que antes. El posicionamiento de seguridad sigue evolucionando en ambas, por lo que vale la pena consultar sus documentos de política más recientes en lugar de confiar solo en la reputación.

Cambios en la política de seguridad que vale la pena conocer

Ambas empresas ajustaron sus compromisos de seguridad en 2025 y 2026. Los críticos argumentan que estas revisiones debilitan las promesas anteriores. La Política de Escalado Responsable v3.0 de Anthropic (febrero de 2026) reemplazó los compromisos de pausa estricta con objetivos públicos calificados abiertamente, eliminando lo que las versiones anteriores trataban como salvaguardas de despliegue incondicionales. Los análisis del Marco de Preparación v2.0 de OpenAI (abril de 2025) argumentan que algunas categorías de riesgo, como la manipulación masiva y la desinformación, reciben menos enfoque explícito previo al despliegue que antes.

Estos cambios han generado críticas de la comunidad de seguridad de la IA. Ambas empresas citan la presión competitiva como un factor. El posicionamiento de seguridad está evolucionando en ambas, por lo que vale la pena consultar sus documentos de política más recientes en lugar de confiar solo en la reputación.

Ecosistema de API y experiencia del desarrollador

Anthropic ofrece una superficie de API enfocada a través de la API de Mensajes. Los SDKs están disponibles en siete lenguajes (Python, TypeScript, Java, Go, Ruby, C# y PHP). La API admite el uso de herramientas y llamadas a funciones, salida JSON estructurada, entradas de visión, pensamiento extendido con un presupuesto de tokens configurable y streaming. Anthropic también originó el Protocolo de Contexto de Modelo (MCP), un estándar abierto para conectar agentes de IA a herramientas y fuentes de datos externas que ha sido adoptado por un número creciente de herramientas y plataformas.

La API de OpenAI es más amplia. Incluye la API de Respuestas (que reemplazó a la API de Asistentes), la API de Completados de Chat, una API en tiempo real para audio y voz, y SDKs para Python, TypeScript, Go y Java. Más allá de las características estándar (llamadas a funciones, salidas estructuradas, streaming, modo por lotes), OpenAI también ofrece una API de generación de imágenes, texto a voz, transcripción y embeddings.

|

Característica |

Claude |

OpenAI |

|

Llamada a herramientas y funciones |

Sí |

Sí |

|

Salida JSON estructurada |

Sí |

Sí |

|

Streaming |

Sí |

Sí |

|

API por lotes (50% de descuento) |

Sí |

Sí |

|

Almacenamiento en caché de prompts |

Sí |

Sí |

|

Búsqueda web integrada |

Sí |

Sí |

|

Ejecución de código |

Sí |

Sí |

|

Uso de ordenador |

Sí (Opus 4.6, Sonnet 4.6) |

Sí (vista previa) |

|

Ajuste fino (fine-tuning) |

Limitado (solo Haiku 3 en Bedrock) |

Sí (SFT, DPO, RFT para la familia GPT-4.1) |

|

Generación de imágenes |

No |

Sí |

|

Entrada y salida de audio |

No |

Sí (API en tiempo real, TTS) |

|

SDK de agentes |

Sí (Python, TypeScript) |

Sí (código abierto, Python, TypeScript) |

Como mencioné en la sección de codificación, vale la pena señalar la brecha en el ajuste fino. OpenAI admite múltiples métodos de ajuste fino en múltiples niveles de modelos a través de su API directa y Azure. Anthropic limita el ajuste fino a un solo modelo en una sola plataforma en la nube.

Adopción empresarial y asociaciones

Las especificaciones de la API son una cosa. Cómo las empresas están utilizando realmente estas plataformas es otra.

OpenAI y Microsoft

OpenAI tiene la mayor huella empresarial, con aproximadamente un 78% de penetración en producción y alrededor del 56% del gasto total en LLM empresarial, según encuestas de la industria.

La integración con Microsoft es profunda. Azure OpenAI Service proporciona acceso directo a todos los modelos GPT-5.x. Microsoft 365 Copilot (impulsado por modelos de OpenAI) ha sido adoptado por la gran mayoría de las licencias empresariales de pago en las organizaciones encuestadas, y GitHub Copilot tiene aproximadamente un 70% de cuota de mercado en herramientas de codificación empresarial.

OpenAI lidera en despliegue de chatbots, gestión de conocimiento empresarial y casos de uso de atención al cliente.

Anthropic y Amazon

La penetración empresarial de Anthropic se sitúa en el 44%, un aumento de 25 puntos porcentuales desde mayo de 2025, lo que según los datos de la encuesta fue la mayor ganancia de cualquier proveedor de IA en ese período. La empresa genera aproximadamente el 80% de sus ingresos de clientes empresariales y cuenta con 8 de las Fortune 10 como clientes de Claude. Los despliegues notables incluyen Deloitte (470.000 empleados) y Cognizant (350.000 empleados).

La asociación con AWS le da a Anthropic acceso a chips personalizados Amazon Trainium e Inferentia para entrenamiento e inferencia, que proporcionan ventajas de costes a nivel de hardware. Claude también está disponible en Google Cloud Vertex AI y, desde marzo de 2026, en Microsoft Foundry.

Anthropic lidera en casos de uso empresarial de desarrollo de software y análisis de datos. Una encuesta a CIOs empresariales encontró que la mayoría de las empresas ahora utilizan tres o más familias de modelos, lo que sugiere que el despliegue de múltiples modelos se está convirtiendo en una práctica común.

Precios y accesibilidad

Las estructuras de precios difieren entre los productos de chat para consumidores y las APIs. Cubriré ambos, pero como los precios cambian con frecuencia, me centraré en la estructura en lugar de en números exactos. Consulta la página de precios de Anthropic y la página de precios de OpenAI para conocer las cifras más recientes.

Planes de consumo

Ambas empresas ofrecen niveles gratuitos con acceso limitado. El nivel gratuito de ChatGPT incluye acceso a modelos GPT con un límite rotativo de aproximadamente 10 mensajes cada 5 horas, después de lo cual vuelve a un modelo de menor calidad. El nivel gratuito de Claude proporciona acceso a Sonnet 4.6 con límites de mensajes diarios pero sin pensamiento extendido.

OpenAI introdujo un nuevo nivel de entrada en enero de 2026: ChatGPT Go a 8 dólares al mes, que se sitúa entre los planes gratuito y Plus (20 dólares al mes). Cabe destacar que el plan Go está respaldado por publicidad, lo que convierte a OpenAI en uno de los primeros laboratorios de IA importantes en introducir publicidad en su producto de consumo. Claude Pro cuesta 20 dólares al mes e incluye acceso a todos los modelos, Claude Code y pensamiento extendido.

En el extremo superior, el plan Pro de OpenAI cuesta 200 dólares al mes por acceso ilimitado. Los planes Max de Anthropic oscilan entre 100 y 200 dólares al mes con 5x a 20x de uso Pro.

Estructura de precios de la API

OpenAI tiene una clara ventaja de precio en el extremo económico. GPT-4.1 nano comienza en 0,10 dólares por millón de tokens de entrada, en comparación con 1,00 dólar para Claude Haiku 4.5. Incluso GPT-4.1 mini a 0,40 dólares es notablemente más barato que Haiku.

En el nivel de buque insignia, la brecha se reduce. Claude Sonnet 4.6 se sitúa en 3 dólares/15 dólares (entrada/salida por millón de tokens) frente a GPT-5.2 a 1,75 dólares/14 dólares. Claude Opus 4.6 cuesta 5 dólares/25 dólares frente a GPT-5.4 a 2,50 dólares/15 dólares. OpenAI sigue siendo generalmente más barato por token en cada nivel comparable, pero Anthropic compensa esto para los usuarios de contexto pesado eliminando los recargos de contexto largo en sus modelos más recientes. GPT-5.4, por el contrario, cobra una prima por prompts que superan los 272K tokens.

Ambos proveedores ofrecen descuentos en la API por lotes y almacenamiento en caché de prompts para reducir los costes de las cargas de trabajo de producción.

Anthropic frente a OpenAI: Pros y contras

Aquí es cómo se comparan las dos plataformas en los factores que más importan.

|

Factor |

OpenAI |

Anthropic |

|

Multimodal |

Texto, imagen, vídeo y voz |

Solo texto e imagen |

|

Precios económicos |

GPT-4.1 nano a 0,10 dólares/M tokens de entrada |

Haiku 4.5 a 1,00 dólar/M tokens de entrada |

|

Ventana de contexto |

1,05M tokens; recargo por encima de 272K |

1M tokens a precio fijo |

|

Ajuste fino (fine-tuning) |

SFT, DPO, RFT para la familia GPT-4.1 |

Limitado solo a Claude 3 Haiku en Bedrock |

|

Herramientas de codificación |

Codex para tareas autónomas basadas en la nube |

Claude Code para refactorización compleja y resultados de producción |

|

Alcance empresarial |

~78% de penetración en producción |

~44%, un aumento de 25 puntos desde mayo de 2025 |

|

Ecosistema |

Azure, GitHub Copilot, GPT Store |

AWS Bedrock, Google Vertex AI, Microsoft Foundry |

|

Transparencia de seguridad |

Model Spec pública; razonamiento interno oculto |

IA Constitucional y constitución publicadas |

|

Cadencia de lanzamiento |

Rápida; retirada frecuente de modelos |

Más estable, menos cambios disruptivos |

Cuándo elegir Anthropic frente a OpenAI

La elección correcta depende de tu caso de uso específico. Aquí están los escenarios donde cada plataforma tiende a ser la mejor opción.

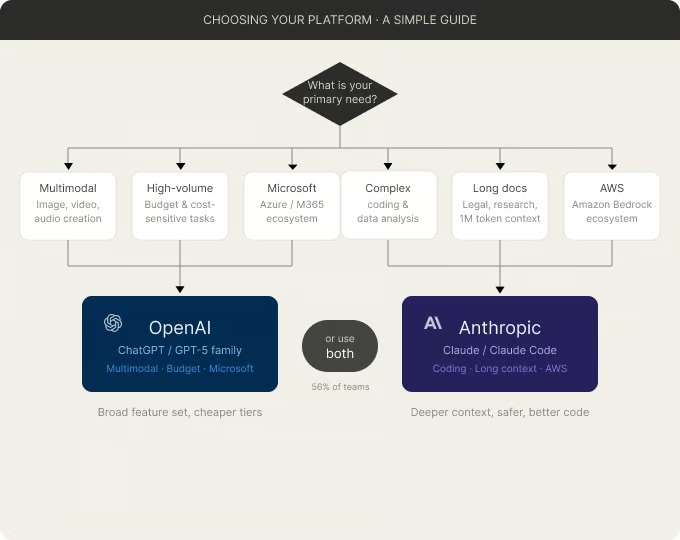

Una guía sencilla para elegir tu plataforma. Imagen del autor.

Elige OpenAI si necesitas soporte multimodal en texto, imagen, audio y vídeo. Si tu organización funciona con Microsoft y Azure, la integración de OpenAI está bien establecida. Para el procesamiento de alto volumen y sensible a los costes, los modelos económicos de OpenAI son mucho más baratos que los equivalentes de Anthropic. Si el ajuste fino en datos propietarios es un requisito, OpenAI está por delante aquí.

Elige Anthropic si tu trabajo implica desarrollo de software complejo o análisis de datos. Si necesitas procesar documentos largos como revisiones legales, trabajos de investigación o auditorías completas de bases de código, la ventana de contexto de 1M de tokens a precio fijo de Anthropic es práctica. Para despliegues críticos de seguridad, el enfoque de IA Constitucional de Anthropic tiene un registro público más detallado. Si estás construyendo sobre AWS, Claude está integrado de forma nativa a través de Bedrock.

Para muchos equipos, la respuesta es ambos. Los datos de mercado muestran que la mayoría de las empresas ahora utilizan tres o más familias de modelos, y una gran parte de los usuarios de pago de OpenAI también pagan por Anthropic. Enrutar diferentes tareas a diferentes modelos según sus fortalezas es una práctica cada vez más común.

Conclusión: Anthropic frente a OpenAI en 2026

OpenAI tiene un alcance más amplio, un soporte multimodal más profundo y precios de nivel económico más baratos. Anthropic tiene un rendimiento de contexto largo más fuerte, un registro de seguridad más transparente y herramientas construidas en torno a la codificación compleja y el trabajo analítico.

La elección correcta depende de lo que estés construyendo y en qué ecosistema ya te encuentres. El ciclo de retirada rápida de OpenAI significa que vale la pena consultar ambas páginas de precios y listas de modelos antes de comprometerse.

Si te interesa cómo se comparan específicamente las herramientas de codificación de las dos empresas, consulta nuestro artículo Codex frente a Claude Code para una mirada más profunda a esa dimensión.

Además, ponte al día con nuestros recursos recomendados:

- Nuestro curso Understanding ChatGPT explica cómo escribir prompts efectivos.

- Nuestro track ChatGPT Fundamentals combina ChatGPT con Python y análisis de datos.

- Nuestro curso Introduction to Claude Models te enseña cómo usar la API de Anthropic.

Soy ingeniero de datos y creador de comunidades. Trabajo con canalizaciones de datos, nube y herramientas de IA, al tiempo que escribo tutoriales prácticos y de gran impacto para DataCamp y programadores emergentes.

Preguntas frecuentes

¿Puedo usar Claude y ChatGPT al mismo tiempo?

Sí, y muchos profesionales lo hacen. Muchos informan que usan tanto Claude como ChatGPT en paralelo, enrutando diferentes tareas a cada uno. Las dos plataformas sirven a diferentes fortalezas, por lo que ejecutar ambas es común en la práctica, incluso si el coste de la suscripción dual se suma.

¿Qué IA es mejor para aprender ciencia de datos?

Ambos funcionan bien, pero tienen estilos diferentes. Claude tiende a producir explicaciones más estructuradas, paso a paso, y maneja bien los documentos largos, por lo que es útil para trabajar con libros de texto o trabajos de investigación. ChatGPT tiene un ecosistema más amplio con un nivel gratuito que da acceso rápido a modelos capaces. Yo empezaría con el nivel gratuito que te resulte más cómodo y luego actualizaría según lo que más uses.

¿Es Anthropic más "seguro" que OpenAI?

Anthropic ha construido su marca en torno a la IA que prioriza la seguridad, y su enfoque de IA Constitucional es más transparente que la mayoría. Pero ambas empresas han ajustado sus compromisos de seguridad en 2025 y 2026 en respuesta a la presión competitiva. La seguridad es menos un binario y más un objetivo en movimiento. El artículo cubre los cambios de política específicos para ambos.

¿Claude admite generación de imágenes y vídeo?

No. A principios de 2026, Claude maneja entradas de texto e imagen, pero no genera imágenes, vídeo ni audio. OpenAI tiene una pila multimodal más amplia que incluye generación de imágenes, vídeo a través de Sora y una API de voz en tiempo real. Si tu flujo de trabajo depende de la generación de contenido visual o de audio, OpenAI es la mejor opción.

¿Cuál es más barato para el uso de la API?

Depende del nivel. OpenAI tiene modelos económicos mucho más baratos, con GPT-4.1 nano comenzando en 0,10 dólares por millón de tokens de entrada frente a 1,00 dólar para Claude Haiku 4.5. En el nivel de buque insignia, los precios están más cerca, y Anthropic eliminó los recargos de contexto largo para sus modelos más recientes. La respuesta correcta depende de tu volumen y de qué nivel de modelo necesites realmente.