Cours

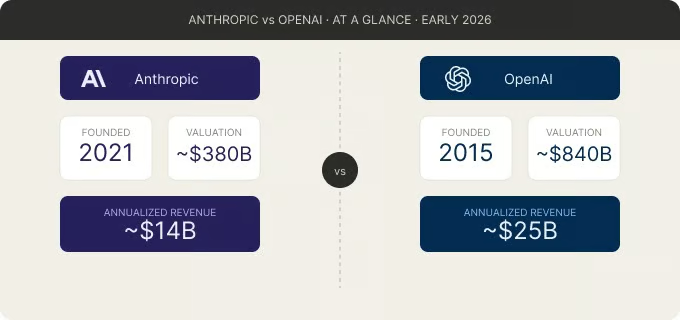

Si vous travaillez avec des grands modèles de langage (LLM), vous avez presque certainement utilisé un produit d'OpenAI ou d'Anthropic, voire les deux. OpenAI a popularisé la catégorie avec ChatGPT, qui compterait des centaines de millions d'utilisateurs actifs hebdomadaires. Anthropic, fondée en 2021 par d'anciens chercheurs d'OpenAI, est devenue la deuxième plus grande entreprise d'IA en termes de revenus, les analystes estimant son chiffre d'affaires annualisé à plusieurs dizaines de milliards de dollars.

Mais il ne s'agit pas seulement d'une comparaison de modèles. Anthropic et OpenAI représentent deux approches différentes de la construction de l'IA. OpenAI s'est concentré sur une large portée grand public et l'intégration multimodale. Anthropic s'est concentré sur la confiance des entreprises, la recherche en sécurité et la gestion de contextes approfondis.

Qu'est-ce qu'OpenAI ?

OpenAI est l'entreprise derrière ChatGPT, la famille de modèles GPT, DALL-E et Sora. Elle a été fondée en 2015 à San Francisco, initialement en tant qu'organisation à but non lucratif. En octobre 2025, elle a finalisé sa restructuration en une Public Benefit Corporation (PBC), dissolvant l'ancien modèle à profit plafonné. La branche à but non lucratif a été renommée OpenAI Foundation, qui conserve le pouvoir de nomination au conseil d'administration et environ 26 % du capital.

Le partenariat d'OpenAI avec Microsoft est au cœur de son fonctionnement. Azure est le fournisseur cloud exclusif pour les appels API d'OpenAI, et OpenAI s'est engagé à hauteur de 250 milliards de dollars en services Azure sur la durée de l'accord. Le partenariat a été publiquement réaffirmé en février 2026, alors même qu'OpenAI levait 110 milliards de dollars lors de son dernier cycle de financement, rapporté comme l'un des plus importants cycles de financement privé jamais enregistrés.

Côté produit, OpenAI a poursuivi une stratégie d'itération rapide et de dépréciation agressive des modèles. En février 2026, l'entreprise a retiré plusieurs anciens modèles de ChatGPT, notamment GPT-4o et GPT-4.1. En mars 2026, la série intermédiaire GPT-5.1 a également été retirée. Cela permet de garder la gamme de produits concentrée, mais oblige les développeurs à rester vigilants sur les délais de migration.

La famille GPT-5 est la génération actuelle d'OpenAI. Elle a été lancée en août 2025 avec une architecture de « routeur » qui sélectionne automatiquement entre des modes de raisonnement rapides (Instant) et approfondis (Thinking) en fonction de la complexité de la requête. Les modèles clés à connaître sont :

- GPT-5.4 (sorti en mars 2026, le dernier fleuron avec une fenêtre de contexte de 1,05 million de jetons),

- GPT-5.3 Codex (le spécialiste du codage agentique), et

- GPT-5.2 (le précédent fleuron, en cours de retrait).

- Également sortis en mars 2026, GPT-5.4 mini et GPT-5.4 nano sont des variantes plus petites conçues pour la vitesse et un coût réduit. GPT-5.4 mini conserve la plupart des atouts de GPT-5.4 en matière de codage, d'utilisation d'outils et de multimodalité tout en étant deux fois plus rapide. GPT-5.4 nano est destiné aux tâches plus simples à haut volume.

- OpenAI a également publié des modèles à poids ouverts (gpt-oss-120b et gpt-oss-20b sous licence Apache 2.0), un changement notable par rapport à son approche historiquement fermée.

Qu'est-ce qu'Anthropic ?

Anthropic est l'entreprise derrière la famille de modèles Claude. Elle a été fondée en 2021 par Dario Amodei (PDG), Daniela Amodei (Présidente) et une dizaine d'autres anciens chercheurs d'OpenAI qui ont quitté l'entreprise en raison de désaccords sur les priorités en matière de sécurité et de commercialisation.

L'identité technique de l'entreprise est centrée sur l'IA Constitutionnelle, une approche d'entraînement où le modèle auto-critique ses résultats par rapport à un ensemble écrit de principes éthiques, plutôt que de s'appuyer uniquement sur le feedback humain. Anthropic a publié une révision de la Constitution de Claude en janvier 2026, passant d'une approche d'alignement basée sur des règles à une approche basée sur le raisonnement : au lieu de simplement dire au modèle ce qu'il doit suivre, la constitution explique pourquoi les règles existent, dans le but de permettre un jugement plus nuancé dans des situations inédites.

Le principal partenaire cloud et d'entraînement d'Anthropic est Amazon Web Services (AWS), Amazon ayant investi un total de 8 milliards de dollars. Les modèles Claude sont également disponibles sur Google Cloud Vertex AI (Google détient environ 14 % d'Anthropic), et depuis mars 2026, sur Microsoft Foundry également.

La famille Claude 4 est la génération actuelle. La convention de nommage utilise trois niveaux : Opus (fleuron, le plus performant), Sonnet (équilibré) et Haiku (rapide et rentable). Les derniers modèles sont :

- Claude Opus 4.6 (sorti en février 2026, le modèle de raisonnement haut de gamme avec une fenêtre de contexte de 1 million de jetons et 128K de sortie max)

- Claude Sonnet 4.6 (également février 2026, le modèle par défaut pour les utilisateurs gratuits et payants avec une fenêtre de contexte de 1M), et

- Claude Haiku 4.5 (sorti en octobre 2025, l'option économique).

Au-delà des modèles principaux, Anthropic a publié Claude Code (un agent de codage basé sur le terminal), des agents de type bureau pour le travail intellectuel non technique, et des SDK d'agents pour Python et TypeScript afin de créer des flux de travail agentiques personnalisés.

Anthropic vs. OpenAI : Comparaison des capacités des modèles

Les deux plateformes sont performantes sur un large éventail de tâches, mais leurs forces diffèrent. Il n'existe pas de modèle unique idéal pour tout. Laissez-moi vous expliquer par catégorie.

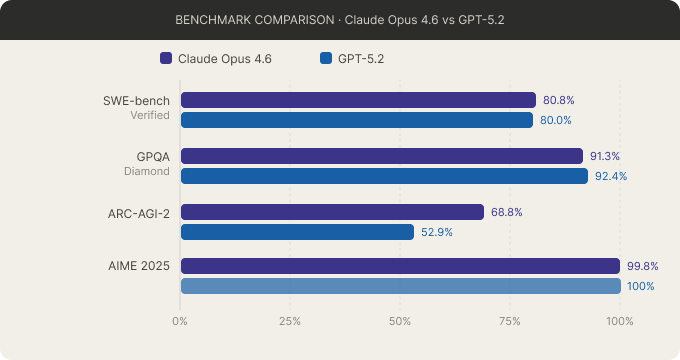

Scores de benchmark sur quatre tests clés. Image de l'auteur.

Raisonnement et résolution de problèmes

Les deux entreprises proposent désormais un raisonnement hybride, où un seul modèle peut basculer entre des réponses rapides et une réflexion approfondie (chaîne de pensée). Claude a introduit cela pour la première fois avec Claude 3.7 Sonnet en février 2025. OpenAI a suivi avec le routeur unifié de GPT-5 en août 2025.

Sur les benchmarks, le tableau est mitigé :

- AIME 2025 (concours de mathématiques) : GPT-5.2 est en tête, incluant un score parfait dans certaines configurations de test.

- GPQA Diamond (science de niveau universitaire) : GPT-5.2 devance Claude d'une courte tête.

- ARC-AGI-2 (logique visuelle inédite, difficile à mémoriser à partir des données d'entraînement) : des analyses indépendantes placent Claude Opus 4.6 à environ 68-69 % contre 52-54 % pour GPT-5.2.

- Humanity's Last Exam (synthèse de niveau expert) : Claude est en tête selon les comparaisons disponibles.

D'après les résultats des benchmarks, OpenAI semble plus performant sur la logique déterministe et la récupération factuelle, tandis qu'Anthropic a tendance à être meilleur sur la synthèse contextuelle et l'analyse qualitative. Aucune approche n'est universellement meilleure. Cela dépend de ce que vous attendez du modèle.

Pour un examen plus approfondi de la comparaison entre GPT-5.4 et Claude Opus 4.6 sur ces benchmarks spécifiques, consultez notre analyse GPT-5.4 vs. Claude Opus 4.6.

Codage et utilisation par les développeurs

Les deux entreprises sont allées bien au-delà de la simple génération de code pour proposer des outils de codage agentiques, mais elles adoptent des approches très différentes.

Claude Code s'exécute localement, indexe votre base de code et demande une approbation avant de modifier des fichiers. Claude Opus 4.5 a obtenu un score de 80,9 % sur SWE-bench Verified, le plaçant devant les modèles de la série GPT-5 dans la plupart des analyses indépendantes.

OpenAI Codex s'exécute dans le cloud, clone votre dépôt dans un bac à sable et travaille de manière autonome. Il obtient un score de 77,3 % sur Terminal-Bench 2.0 contre 65,4 % pour Claude, et selon OpenAI, utilise beaucoup moins de jetons pour des tâches comparables.

En pratique, Claude Code a tendance à être préféré pour le refactoring complexe et les résultats de qualité production. Codex a tendance à être préféré pour le prototypage rapide et les tâches d'arrière-plan déléguées. GPT-5.4 mini et nano étendent cela davantage, agissant comme des sous-agents qui gèrent des tâches plus étroites tandis qu'un modèle plus grand gère la planification et la révision.

Concernant le fine-tuning, OpenAI prend en charge plusieurs méthodes (SFT, DPO, RFT) pour la famille GPT-4.1. Le fine-tuning d'Anthropic est limité à Claude 3 Haiku sur Bedrock, sans rien de disponible pour les modèles Claude 4.x début 2026.

Gestion de contexte long

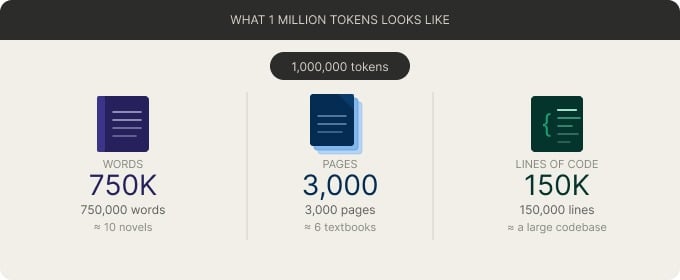

Les deux plateformes prennent désormais en charge des fenêtres de contexte de l'ordre du million de jetons, ce qui représente environ 750 000 mots ou 150 000 lignes de code.

Claude Opus 4.6 et Sonnet 4.6 offrent des fenêtres de contexte de 1M de jetons avec une tarification forfaitaire, ce qui signifie aucun supplément pour l'utilisation de la fenêtre complète. GPT-5.4 prend en charge une fenêtre de contexte de 1,05M de jetons, mais applique un supplément (2x entrée, 1,5x sortie) pour les invites dépassant 272K jetons. L'ancien GPT-5.2 a une fenêtre plus petite de 400K jetons.

Sur la qualité du contexte long, Claude Opus 4.6 a obtenu 78,3 % sur MRCR v2 (un benchmark de récupération multi-aiguilles à 1M de jetons), le plaçant en tête parmi les modèles testés dans ce benchmark. Pour les flux de travail impliquant de grands documents, des bases de code entières ou des révisions juridiques ou de recherche multi-documents, la taille de la fenêtre de contexte et la précision de la récupération comptent toutes deux, et Anthropic a actuellement un avantage ici.

À quoi ressemble un million de jetons. Image de l'auteur.

Capacités multimodales

C'est là que la différence entre les deux plateformes est la plus évidente. OpenAI prend en charge nativement le texte, les images, l'audio et la vidéo dans toute sa famille de modèles. L'écosystème comprend la génération d'images (GPT Image 1), la génération de vidéo (Sora 2), une API vocale en temps réel et un mode vocal avancé pour l'audio conversationnel. GPT-5.4 inclut également des capacités d'utilisation de l'ordinateur via une fonctionnalité en avant-première.

Claude gère les entrées de texte et d'images et couvre assez bien l'analyse de documents (PDF, graphiques, tableaux). Il prend également en charge l'utilisation de l'ordinateur via une approche basée sur la vision (capture d'écran, puis action), avec Claude Opus 4.6 et Sonnet 4.6 prenant tous deux en charge cela. Claude ne génère pas d'images, d'audio ou de vidéo.

Une chose à noter : au 12 mars 2026, Claude peut créer des graphiques, des diagrammes et des visualisations interactifs directement dans le chat. Ce ne sont pas des images statiques mais des visuels dynamiques qui se mettent à jour au fur et à mesure que la conversation se développe. La fonctionnalité est disponible sur tous les types de plans, y compris le gratuit. C'est différent de la génération d'images et cela ne comble pas l'écart avec OpenAI sur ce front, mais c'est un ajout significatif pour les flux de travail de données et d'analyse.

Si votre travail nécessite la génération d'images, d'audio ou de vidéo, OpenAI reste la seule option ici. Si vos besoins concernent principalement le texte, les documents et l'analyse de données, Claude couvre désormais plus de terrain qu'auparavant.

Anthropic vs. OpenAI : Philosophie de sécurité et d'alignement

La sécurité est l'une des différences les plus claires entre ces deux entreprises, et il vaut la peine d'examiner ce que chacune a réellement fait plutôt que ce qu'elles disent.

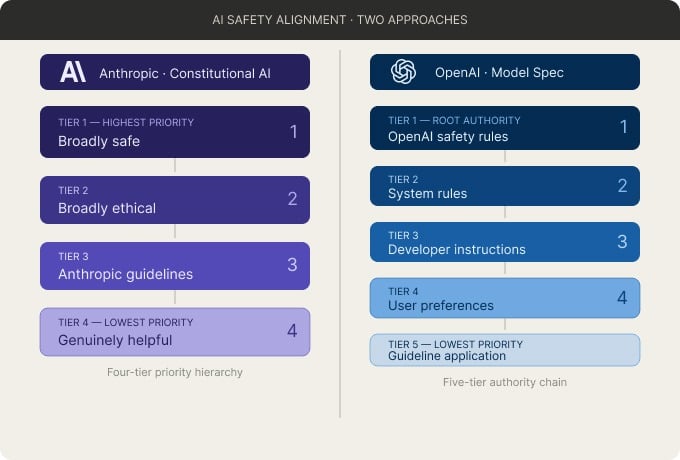

Deux approches de l'alignement de la sécurité de l'IA. Image de l'auteur.

Comment chaque entreprise aborde la sécurité

La méthode principale d'Anthropic est l'IA Constitutionnelle avec Reinforcement Learning from AI Feedback (RLAIF) : le modèle auto-critique ses résultats par rapport à un ensemble écrit de principes tirés de sources comme la Déclaration universelle des droits de l'homme et la recherche académique sur la sécurité. La révision de janvier 2026 a introduit une hiérarchie de priorités à quatre niveaux (globalement sûr, globalement éthique, conforme aux directives d'Anthropic, puis réellement utile) et a formellement reconnu la possibilité d'une conscience de l'IA, ce qui était notable à l'époque.

OpenAI utilise le Reinforcement Learning from Human Feedback (RLHF) parallèlement à un document de gouvernance appelé Model Spec, mis à jour pour la dernière fois en décembre 2025. Il établit une chaîne d'autorité allant des règles racines d'OpenAI jusqu'aux préférences des utilisateurs. GPT-5 a introduit des « complétions sûres », qui visent à donner des réponses de haut niveau aux requêtes sensibles plutôt que de refuser purement et simplement, et le modèle a été entraîné à être moins complaisant et plus disposé à contester.

La différence la plus claire entre les deux est la transparence. OpenAI cache la chaîne de pensée interne du modèle aux utilisateurs, arguant que l'exposer pourrait être utilisé à mauvais escient. Anthropic publie des recherches sur l'interprétabilité et des graphiques d'attribution qui cartographient le raisonnement interne. Sur le plan pratique, les classificateurs constitutionnels d'Anthropic ont résisté à plus de 3 000 heures de red teaming sans jailbreak universel. Des tests indépendants placent le taux de succès de l'injection d'invites de Claude Opus 4.5 à environ 4,7 %, ce qui est inférieur à ce que d'autres plateformes ont rapporté.

Les deux entreprises ont également révisé leurs engagements en matière de sécurité en 2025 et 2026. Les critiques soutiennent que les changements affaiblissent les engagements antérieurs. La politique de mise à l'échelle responsable v3.0 d'Anthropic a remplacé les engagements de pause ferme par des objectifs publics ouvertement notés. Les analyses du cadre de préparation v2.0 d'OpenAI soutiennent que certaines catégories de risques reçoivent moins d'attention explicite avant le déploiement qu'auparavant. Le positionnement en matière de sécurité évolue encore chez les deux, il vaut donc la peine de vérifier leurs derniers documents de politique plutôt que de se fier uniquement à la réputation.

Changements de politique de sécurité à connaître

Les deux entreprises ont ajusté leurs engagements en matière de sécurité en 2025 et 2026. Les critiques soutiennent que ces révisions affaiblissent les engagements antérieurs. La politique de mise à l'échelle responsable v3.0 d'Anthropic (février 2026) a remplacé les engagements de pause ferme par des objectifs publics notés ouvertement, abandonnant ce que les versions précédentes traitaient comme des garanties de déploiement inconditionnelles. Les analyses du cadre de préparation v2.0 d'OpenAI (avril 2025) soutiennent que certaines catégories de risques, telles que la manipulation de masse et la désinformation, reçoivent moins d'attention explicite avant le déploiement qu'auparavant.

Ces changements ont suscité des critiques de la part de la communauté de la sécurité de l'IA. Les deux entreprises citent la pression concurrentielle comme facteur. Le positionnement en matière de sécurité évolue chez les deux, il vaut donc la peine de vérifier leurs derniers documents de politique plutôt que de se fier uniquement à la réputation.

Écosystème API et expérience développeur

Anthropic offre une surface API ciblée via l'API Messages. Des SDK sont disponibles dans sept langages (Python, TypeScript, Java, Go, Ruby, C# et PHP). L'API prend en charge l'utilisation d'outils et l'appel de fonctions, la sortie JSON structurée, les entrées de vision, la réflexion étendue avec un budget de jetons configurable et le streaming. Anthropic est également à l'origine du Model Context Protocol (MCP), un standard ouvert pour connecter les agents d'IA à des outils et sources de données externes qui a été adopté par un nombre croissant d'outils et de plateformes.

L'API d'OpenAI est plus large. Elle comprend l'API Responses (qui a remplacé l'API Assistants), l'API Chat Completions, une API Realtime pour l'audio et la voix, et des SDK pour Python, TypeScript, Go et Java. Au-delà des fonctionnalités standard (appel de fonctions, sorties structurées, streaming, mode batch), OpenAI propose également une API de génération d'images, de synthèse vocale, de transcription et d'embeddings.

|

Fonctionnalité |

Claude |

OpenAI |

|

Appel d'outils et de fonctions |

Oui |

Oui |

|

Sortie JSON structurée |

Oui |

Oui |

|

Streaming |

Oui |

Oui |

|

API Batch (50 % de réduction) |

Oui |

Oui |

|

Mise en cache des invites |

Oui |

Oui |

|

Recherche web intégrée |

Oui |

Oui |

|

Exécution de code |

Oui |

Oui |

|

Utilisation de l'ordinateur |

Oui (Opus 4.6, Sonnet 4.6) |

Oui (avant-première) |

|

Fine-tuning |

Limité (Haiku 3 sur Bedrock uniquement) |

Oui (SFT, DPO, RFT pour la famille GPT-4.1) |

|

Génération d'images |

Non |

Oui |

|

Entrée et sortie audio |

Non |

Oui (API Realtime, TTS) |

|

SDK d'agent |

Oui (Python, TypeScript) |

Oui (open-source, Python, TypeScript) |

Comme je l'ai mentionné dans la section codage, l'écart de fine-tuning mérite d'être noté. OpenAI prend en charge plusieurs méthodes de fine-tuning sur plusieurs niveaux de modèles via son API directe et Azure. Anthropic limite le fine-tuning à un seul modèle sur une seule plateforme cloud.

Adoption en entreprise et partenariats

Les spécifications de l'API sont une chose. La façon dont les entreprises utilisent réellement ces plateformes en est une autre.

OpenAI et Microsoft

OpenAI détient la plus grande empreinte en entreprise, avec environ 78 % de pénétration en production et environ 56 % des dépenses totales en LLM d'entreprise, selon les enquêtes de l'industrie.

L'intégration Microsoft est profonde. Azure OpenAI Service fournit un accès direct à tous les modèles GPT-5.x. Microsoft 365 Copilot (propulsé par les modèles OpenAI) a été adopté par la grande majorité des licences d'entreprise payantes dans les organisations interrogées, et GitHub Copilot détient environ 70 % de part de marché dans les outils de codage d'entreprise.

OpenAI est en tête dans le déploiement de chatbots, la gestion des connaissances en entreprise et les cas d'utilisation du support client.

Anthropic et Amazon

La pénétration d'Anthropic en entreprise s'établit à 44 %, en hausse de 25 points de pourcentage depuis mai 2025, ce qui, selon les données d'enquête, constitue le gain le plus important de tout fournisseur d'IA sur cette période. L'entreprise génère environ 80 % de ses revenus auprès de clients entreprises et compte 8 des Fortune 10 comme clients de Claude. Les déploiements notables incluent Deloitte (470 000 employés) et Cognizant (350 000 employés).

Le partenariat AWS donne à Anthropic accès aux puces personnalisées Amazon Trainium et Inferentia pour l'entraînement et l'inférence, qui offrent des avantages de coût au niveau matériel. Claude est également disponible sur Google Cloud Vertex AI, et depuis mars 2026, sur Microsoft Foundry.

Anthropic est en tête dans les cas d'utilisation en entreprise de développement logiciel et d'analyse de données. Une enquête auprès des DSI d'entreprise a révélé que la majorité des entreprises utilisent désormais trois familles de modèles ou plus, ce qui suggère que le déploiement multi-modèles devient une pratique courante.

Tarification et accessibilité

Les structures de tarification diffèrent entre les produits de chat grand public et les API. Je couvrirai les deux, mais comme les prix changent fréquemment, je me concentrerai sur la structure plutôt que sur les chiffres exacts. Consultez la page de tarification d'Anthropic et la page de tarification d'OpenAI pour les derniers chiffres.

Plans grand public

Les deux entreprises proposent des niveaux gratuits avec un accès limité. Le niveau gratuit de ChatGPT inclut l'accès aux modèles GPT avec une limite glissante d'environ 10 messages toutes les 5 heures, après quoi il bascule vers un modèle de moindre qualité. Le niveau gratuit de Claude donne accès à Sonnet 4.6 avec des limites de messages quotidiennes mais sans réflexion étendue.

OpenAI a introduit un nouveau niveau d'entrée en janvier 2026 : ChatGPT Go à 8 $ par mois, qui se situe entre les plans gratuit et Plus (20 $ par mois). Notamment, le plan Go est financé par la publicité, faisant d'OpenAI l'un des premiers grands laboratoires d'IA à introduire la publicité dans son produit grand public. Claude Pro coûte 20 $ par mois et inclut l'accès à tous les modèles, Claude Code et la réflexion étendue.

Sur le haut de gamme, le plan Pro d'OpenAI coûte 200 $ par mois pour un accès illimité. Les plans Max d'Anthropic vont de 100 $ à 200 $ par mois avec 5x à 20x l'utilisation Pro.

Structure de tarification de l'API

OpenAI a un avantage de prix clair sur le segment économique. GPT-4.1 nano commence à 0,10 $ par million de jetons d'entrée, contre 1,00 $ pour Claude Haiku 4.5. Même GPT-4.1 mini à 0,40 $ est nettement moins cher que Haiku.

Au niveau du fleuron, l'écart se réduit. Claude Sonnet 4.6 est à 3 $/15 $ (entrée/sortie par million de jetons) contre GPT-5.2 à 1,75 $/14 $. Claude Opus 4.6 coûte 5 $/25 $ contre GPT-5.4 à 2,50 $/15 $. OpenAI est toujours généralement moins cher par jeton à chaque niveau comparable, mais Anthropic compense cela pour les utilisateurs à contexte lourd en supprimant les suppléments de contexte long sur ses derniers modèles. GPT-5.4, en revanche, facture une prime pour les invites dépassant 272K jetons.

Les deux fournisseurs proposent des remises sur l'API batch et la mise en cache des invites pour réduire les coûts pour les charges de travail de production.

Anthropic vs. OpenAI : Avantages et inconvénients

Voici comment les deux plateformes se comparent sur les facteurs qui comptent le plus.

|

Facteur |

OpenAI |

Anthropic |

|

Multimodal |

Texte, image, vidéo et voix |

Texte et image uniquement |

|

Tarification économique |

GPT-4.1 nano à 0,10 $/M jetons d'entrée |

Haiku 4.5 à 1,00 $/M jetons d'entrée |

|

Fenêtre de contexte |

1,05M jetons ; supplément au-dessus de 272K |

1M jetons à tarification forfaitaire |

|

Fine-tuning |

SFT, DPO, RFT pour la famille GPT-4.1 |

Limité à Claude 3 Haiku sur Bedrock uniquement |

|

Outils de codage |

Codex pour les tâches autonomes basées sur le cloud |

Claude Code pour le refactoring complexe et les résultats de production |

|

Portée en entreprise |

~78 % de pénétration en production |

~44 %, en hausse de 25 points depuis mai 2025 |

|

Écosystème |

Azure, GitHub Copilot, GPT Store |

AWS Bedrock, Google Vertex AI, Microsoft Foundry |

|

Transparence de la sécurité |

Model Spec public ; raisonnement interne caché |

IA Constitutionnelle et constitution toutes deux publiées |

|

Cadence de sortie |

Évolution rapide ; dépréciation fréquente des modèles |

Plus stable, moins de changements cassants |

Quand choisir Anthropic vs. OpenAI

Le bon choix dépend de votre cas d'utilisation spécifique. Voici les scénarios où chaque plateforme a tendance à être la meilleure option.

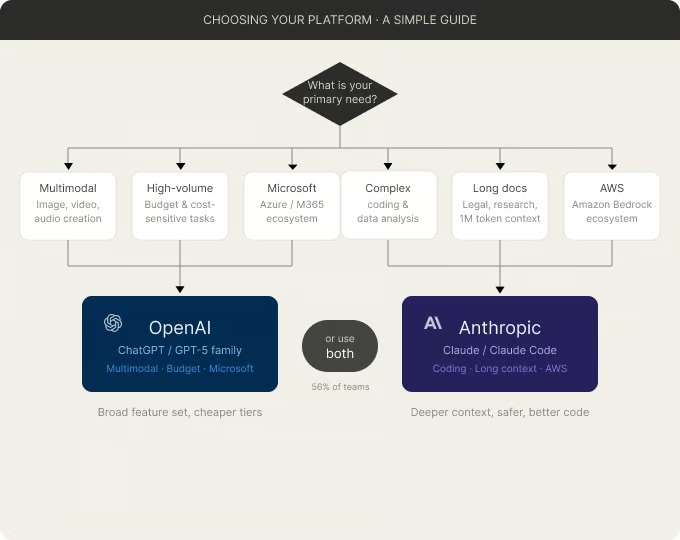

Un guide simple pour choisir votre plateforme. Image de l'auteur.

Choisissez OpenAI si vous avez besoin d'un support multimodal couvrant le texte, l'image, l'audio et la vidéo. Si votre organisation fonctionne sur Microsoft et Azure, l'intégration d'OpenAI est bien établie. Pour un traitement à haut volume et sensible aux coûts, les modèles économiques d'OpenAI sont beaucoup moins chers que les équivalents d'Anthropic. Si le fine-tuning sur des données propriétaires est une exigence, OpenAI est en avance ici.

Choisissez Anthropic si votre travail implique un développement logiciel complexe ou une analyse de données. Si vous devez traiter de longs documents comme des révisions juridiques, des documents de recherche ou des audits complets de bases de code, la fenêtre de contexte de 1M de jetons à tarif forfaitaire d'Anthropic est pratique. Pour les déploiements critiques en matière de sécurité, l'approche d'IA Constitutionnelle d'Anthropic dispose d'un dossier public plus détaillé. Si vous construisez sur AWS, Claude est nativement intégré via Bedrock.

Pour de nombreuses équipes, la réponse est les deux. Les données du marché montrent que la majorité des entreprises utilisent désormais trois familles de modèles ou plus, et une grande partie des utilisateurs payants d'OpenAI paient également pour Anthropic. Router différentes tâches vers différents modèles en fonction de leurs forces est une pratique de plus en plus courante.

Conclusion : Anthropic vs. OpenAI en 2026

OpenAI a une portée plus large, un support multimodal plus profond et une tarification de niveau économique moins chère. Anthropic a de meilleures performances en contexte long, un historique de sécurité plus transparent et des outils construits autour du codage complexe et du travail analytique.

Le bon choix dépend de ce que vous construisez et de l'écosystème dans lequel vous vous trouvez déjà. Le cycle de dépréciation rapide d'OpenAI signifie qu'il vaut la peine de vérifier les deux pages de tarification et les listes de modèles avant de s'engager.

Si vous êtes intéressé par la façon dont les outils de codage des deux entreprises se comparent spécifiquement, consultez notre article Codex vs. Claude Code pour un examen plus approfondi de cette dimension.

Découvrez également nos ressources recommandées :

- Notre cours Comprendre ChatGPT explique comment rédiger des invites efficaces.

- Notre parcours Fondamentaux de ChatGPT combine ChatGPT avec Python et l'analyse de données.

- Notre cours Introduction aux modèles Claude vous apprend à utiliser l'API Anthropic.

Je suis ingénieur de données et créateur de communautés. Je travaille sur les pipelines de données, le cloud et les outils d'IA, tout en rédigeant des tutoriels pratiques et percutants pour DataCamp et les développeurs émergents.

FAQ

Puis-je utiliser Claude et ChatGPT en même temps ?

Oui, et de nombreux professionnels le font. Beaucoup déclarent utiliser Claude et ChatGPT en parallèle, en routant différentes tâches vers chacun. Les deux plateformes servent des forces différentes, donc l'utilisation des deux est courante en pratique, même si le coût de l'abonnement double s'additionne.

Quelle IA est la meilleure pour apprendre la science des données ?

Les deux fonctionnent bien, mais ils ont des styles différents. Claude a tendance à produire des explications plus structurées, étape par étape, et gère bien les longs documents, il est donc utile pour travailler sur des manuels ou des documents de recherche. ChatGPT dispose d'un écosystème plus large avec un niveau gratuit qui donne un accès rapide à des modèles performants. Je commencerais par le niveau gratuit avec lequel vous vous sentez le plus à l'aise, puis je passerais à la version supérieure en fonction de ce que vous utilisez le plus.

Anthropic est-il plus « sûr » qu'OpenAI ?

Anthropic a construit sa marque autour d'une IA axée sur la sécurité, et son approche d'IA Constitutionnelle est plus transparente que la plupart. Mais les deux entreprises ont ajusté leurs engagements en matière de sécurité en 2025 et 2026 en réponse à la pression concurrentielle. La sécurité est moins une question binaire qu'une cible mouvante. L'article couvre les changements de politique spécifiques pour les deux.

Claude prend-il en charge la génération d'images et de vidéos ?

Non. Début 2026, Claude gère les entrées de texte et d'images, mais il ne génère pas d'images, de vidéo ou d'audio. OpenAI dispose d'une pile multimodale plus large qui inclut la génération d'images, la vidéo via Sora et une API vocale en temps réel. Si votre flux de travail dépend de la génération de contenu visuel ou audio, OpenAI est le meilleur choix.

Lequel est le moins cher pour une utilisation API ?

Cela dépend du niveau. OpenAI a des modèles économiques beaucoup moins chers, avec GPT-4.1 nano commençant à 0,10 $ par million de jetons d'entrée contre 1,00 $ pour Claude Haiku 4.5. Au niveau du fleuron, la tarification est plus proche, et Anthropic a supprimé les suppléments de contexte long pour ses derniers modèles. La bonne réponse dépend de votre volume et du niveau de modèle dont vous avez réellement besoin.