Programa

As novidades recentes da OpenAI são especialmente interessantes para quem usa o GPT-5 mini: o novo GPT-5.4 mini é duas vezes mais rápido e traz melhorias de desempenho em todas as áreas. Além disso, a OpenAI lançou a versão mais recente da sua classe de modelos mais eficiente, o GPT-5.4 nano.

Neste artigo, vamos explicar o que são o GPT-5.4 mini e o nano, como eles se saem em comparação com o GPT-5.4 e quem pode se beneficiar dos novos modelos “via rápida” da OpenAI.

Aproveite para conferir também nossa comparação entre GPT-5.4 e Claude Opus e nosso guia sobre o OpenAI Frontier.

O que é o GPT-5.4 mini?

O GPT-5.4 mini é o novo LLM compacto da OpenAI, substituindo o GPT-5 mini. Ele traz várias melhorias importantes em relação ao desempenho do antecessor e é duas vezes mais rápido — um dos grandes diferenciais.

Na API, ele oferece uma ampla gama de recursos:

- Entrada de texto e imagem

- Uso de ferramentas e function calling

- Pesquisa na web

- Uso de computador

- Skills

O que é o GPT-5.4 nano?

O GPT-5.4 nano é a menor versão da nova linha de modelos da OpenAI e substitui o GPT-5 nano. Como o nome sugere, ele é ainda mais eficiente que o modelo mini, com desempenho inferior. Ainda assim, o GPT-5.4 nano supera o antigo modelo mini, o GPT-5 mini, em muitos benchmarks.

Ele não suporta tantos recursos quanto o mini, mas oferece as funcionalidades padrão da API hoje, como entrada de imagem, uso de ferramentas, function calling e saídas estruturadas.

Para quem o GPT-5.4 mini e nano realmente é?

O novo lançamento dá flexibilidade para escolher o modelo certo, considerando o clássico equilíbrio entre desempenho, de um lado, e latência e preço, do outro.

A OpenAI recomenda o mini e o nano para desenvolvedores que estão criando aplicativos em que você não quer travas nem lentidão. Basicamente, casos que precisam parecer responsivos, em que os usuários não toleram atrasos.

Para tarefas que exigem muito raciocínio, com pouca margem para erro, multimodalidade e agentes, o GPT-5.4 continua sendo a primeira escolha.

Benchmarks do GPT-5.4 mini e nano

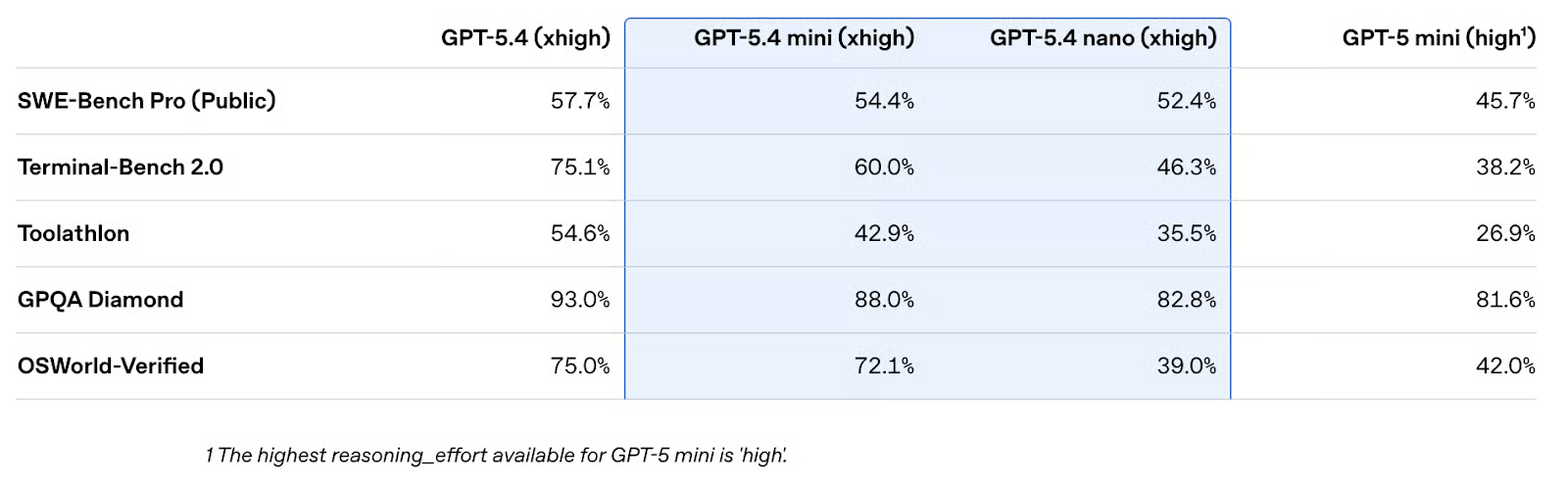

Vamos dar uma olhada nos benchmarks de LLM. Alguns resultados de destaque:

- Code: tanto o 5.4 mini (54,4%) quanto o nano (52,4%) atingem mais de 50% no SWE‑Bench Pro e não ficam muito atrás do GPT-5.4. A melhora em relação ao GPT-5 mini (45,7%) é significativa.

- Agentes de terminal: no Terminal‑Bench 2.0, a distância entre as três variações dos modelos 5.4 fica bem clara. O GPT-5.4 mini (60,0%) consegue competir com modelos carro-chefe anteriores, como o GPT 5.2 (62,2%), e o 5.4 nano (46,3%) com o GPT-5 (49,6%), mas ambos estão longe do desempenho de topo do GPT-5.4.

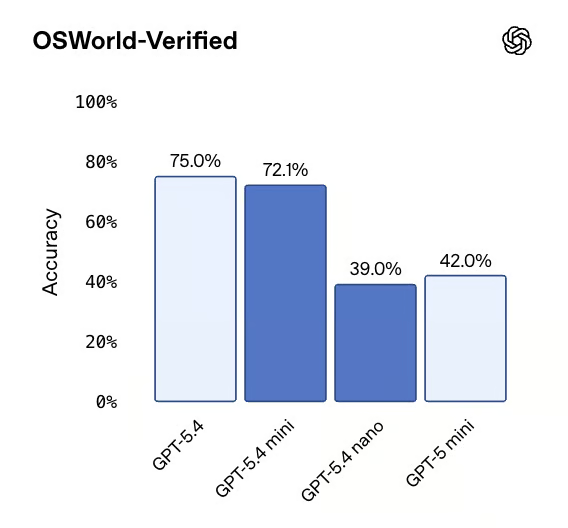

- Uso de computador: enquanto o GPT-5.4 mini alcança impressionantes 72,1% no OSWorld‑Verified, colado no GPT-5.4, o GPT-5.4 nano fica bem atrás (39,0%). Fica claro que ele não foi feito para tarefas de uso de computador.

Outra coisa que chamou nossa atenção de imediato foi que a ordem das pontuações nos benchmarks foi a mesma em (quase) todas as categorias: GPT-5.4 > GPT-5.4 mini > GPT-5.4 nano > GPT-5 mini. Em todas as pontuações publicadas, a única exceção foi que o antigo modelo mini superou o GPT-5.4 nano nos domínios de visão e uso de computador, que não são o foco do nano.

Ainda não está claro qual é o impacto do novo nível de esforço de raciocínio “xhigh”, que não estava disponível para o GPT-5 mini.

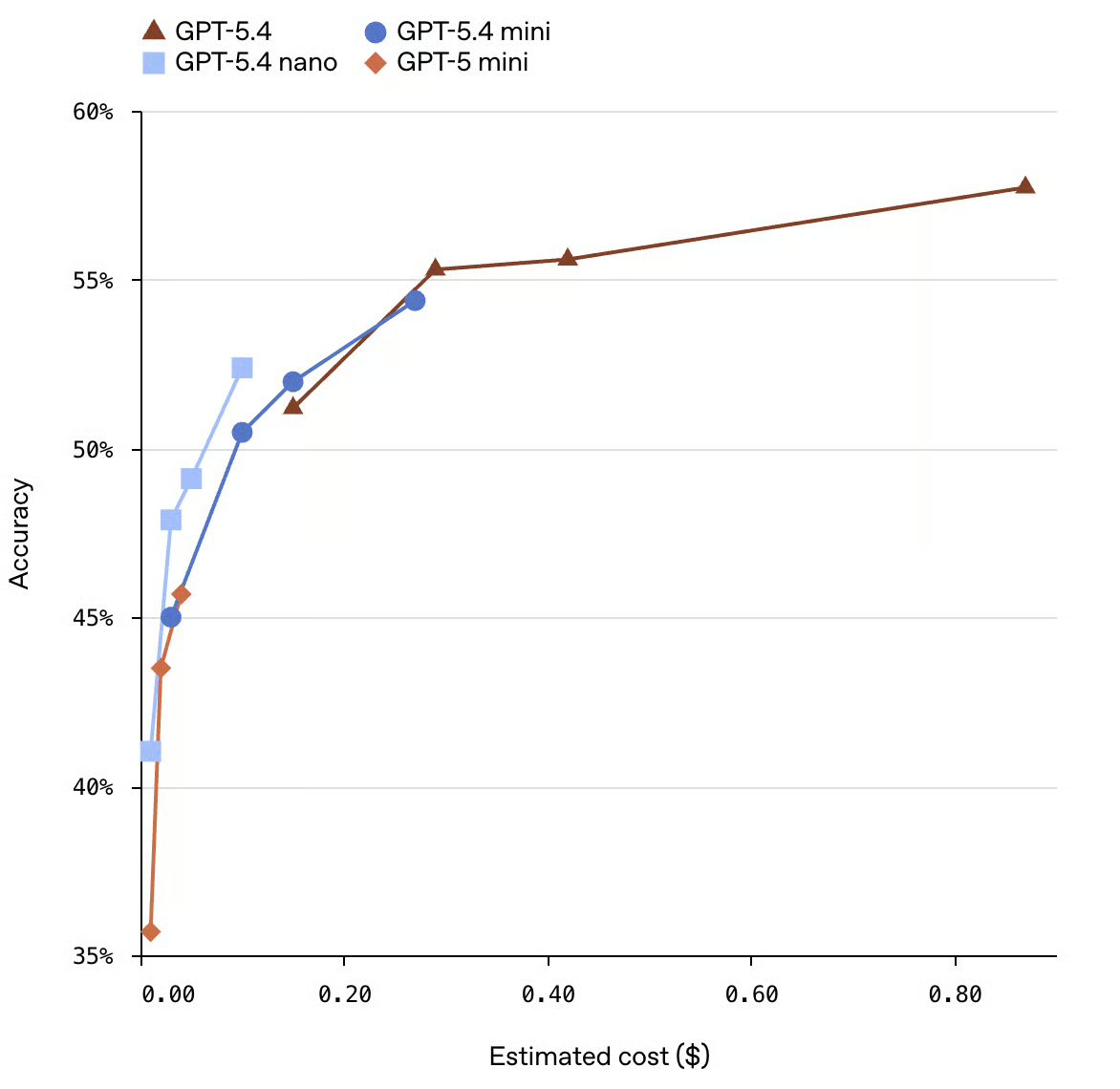

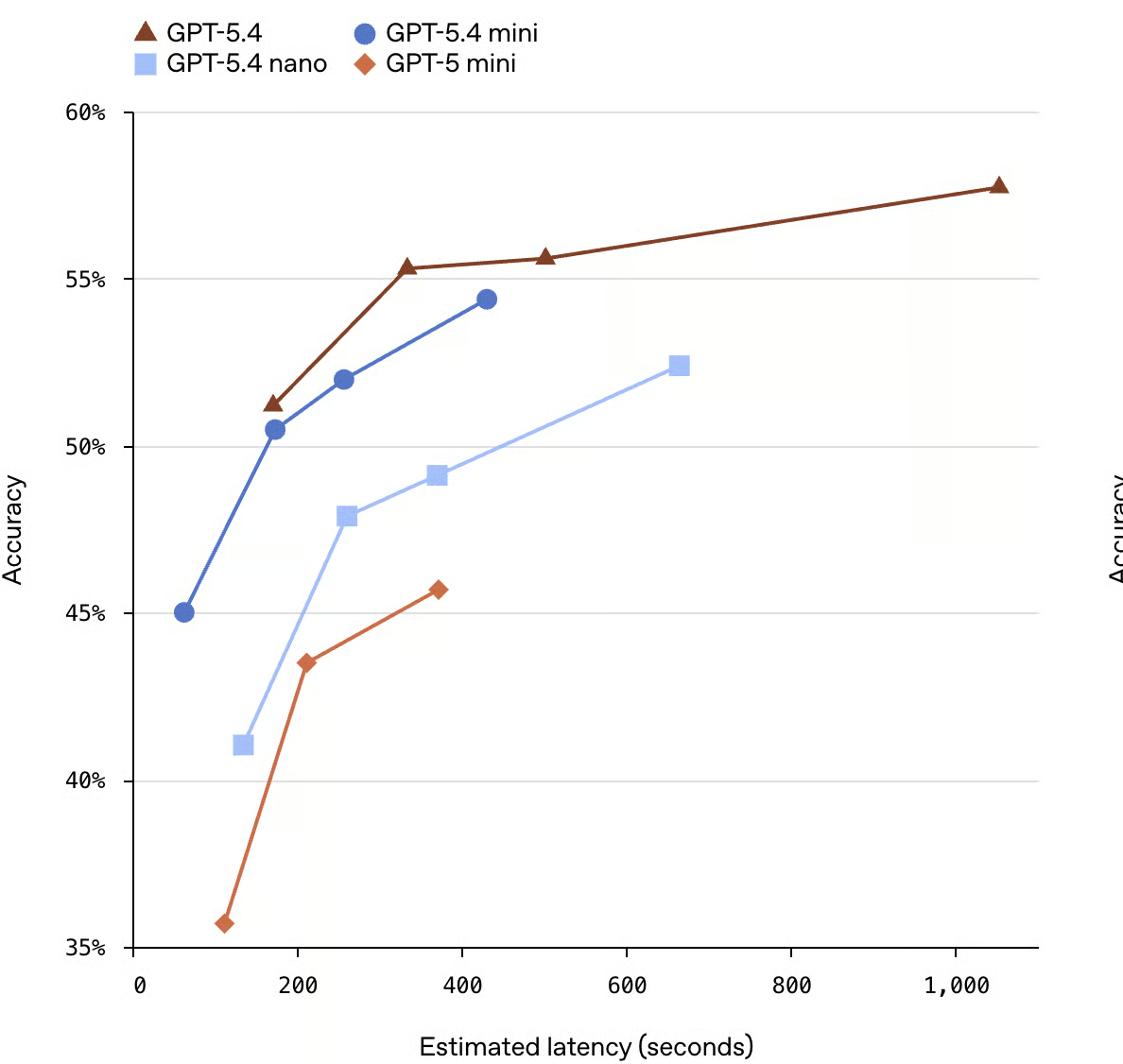

Mas, claro, desempenho não é tudo. A OpenAI quer destacar o tema dos retornos decrescentes, como mostram os gráficos que ela forneceu. Entre os quatro modelos comparados, o GPT-5.4 é o mais lento e o mais caro.

As curvas ilustram os retornos decrescentes: você pode investir mais computação/dinheiro em um modelo e obter ganhos modestos de acurácia, mas os saltos vão diminuindo. Os últimos pontos percentuais do GPT-5.4 custam muito mais do que os primeiros. Esse tipo de gráfico ajuda engenheiros a decidir se vale a pena espremer aqueles 3–4% extras de acurácia para a sua aplicação específica.

Ainda assim, sentimos a obrigação de avaliar o gráfico de forma crítica: o eixo Y começa em 35%, não em 0%. Isso realmente exagera as diferenças visuais entre os modelos. A vantagem do GPT-5.4 sobre o GPT-5 mini parece maior no gráfico que começa em 35% do que pareceria se começasse em zero.

Além disso, a OpenAI aponta que essas cifras de latência não vêm de execuções reais em produção; são estimativas modeladas. Há algo um pouco incongruente nisso. A OpenAI faz várias sugestões sobre decisões de infraestrutura, mas o gráfico traz apenas estimativas de modelagem.

Também achamos estranho olhar para estimativas de modelagem sem barras de erro. Aposto que as barras de erro se sobreporiam bastante, se a OpenAI tivesse optado por incluí-las.

Como acessar o GPT-5.4 mini e nano

Você já deve encontrar o GPT‑5.4 mini na interface do ChatGPT no navegador, no Codex e na API. No ChatGPT, ele é o modelo padrão “Thinking” para usuários dos planos Free e Go, e o modelo de fallback para todos os demais que atingirem o limite de uso do GPT-5.4 Thinking.

O GPT‑5.4 nano, por sua vez, está disponível apenas via API.

Preços do GPT-5.4 mini e nano

O GPT-5.4 mini custa US$ 0,75 por 1M de tokens de entrada e US$ 4,50 por 1M de tokens de saída. O GPT‑5.4 nano, que, novamente, só está disponível na API, custa US$ 0,20 por 1M de tokens de entrada e US$ 1,25 por 1M de tokens de saída. Por esses preços, você tem uma janela de contexto de 400k.

Isso é, obviamente, muito mais barato do que o modelo carro-chefe da OpenAI (US$ 2,50/US$ 15 por 1M de entrada/saída).

GPT-5.4 mini e nano vs. Claude Haiku 4.5

O interessante é que o GPT-5.4 nano tem preço abaixo de muitos modelos compactos e de menor desempenho da concorrência, em especial o Claude Haiku 4.5, que custa US$ 1 por milhão de tokens de entrada e US$ 5 por milhão de tokens de saída. Ou seja, a OpenAI ficou abaixo do preço do Claude Haiku nos dois casos.

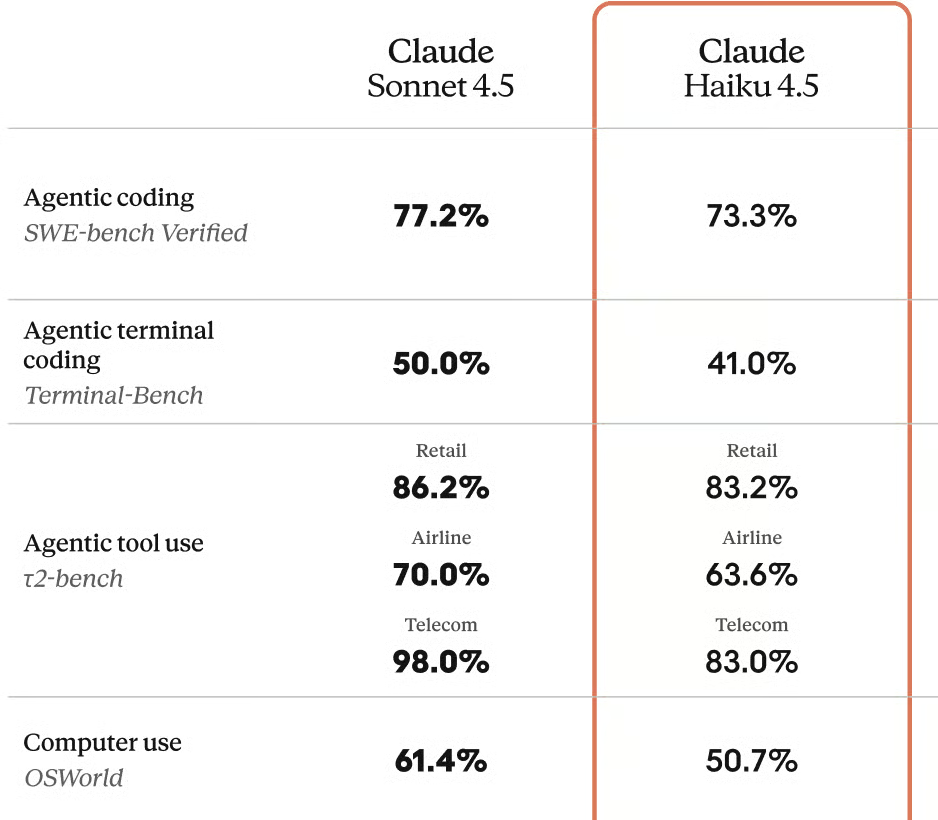

Mas como os modelos se comparam nos testes? A comparação é um pouco complicada porque eles foram avaliados em variantes diferentes. Os resultados de SWE-bench não são comparáveis, já que usam versões distintas. O Claude Haiku 4.5 foi testado no SWE-bench Verified e obteve 73,3%, enquanto o GPT-5.4 nano foi testado no SWE-bench Pro (Public) e marcou 52,4%. O Pro é o teste mais difícil e mais recente.

Pontuação do Claude Haiku 4.5 de 50,7% no OSWorld

Nas duas comparações mais diretas, o GPT-5.4 nano leva vantagem em ambas.

- No GPQA Diamond, o GPT-5.4 nano marca 9,8% a mais, e

- no τ2-bench Telecom, o GPT-5.4 nano marca 9,5% a mais.

No entanto, o Haiku 4.5 pode levar vantagem no uso de computador do OSWorld, embora, de novo, as variantes do benchmark deixem a comparação difícil.

- O Claude Haiku 4.5 foi testado no OSWorld padrão e marcou 50,7%

- O GPT-5.4 nano foi testado no OSWorld-Verified e marcou 39,0%.

O OSWorld-Verified é o teste mais difícil, mas a diferença de quase 12% parece relevante. Estamos mais cautelosos em descartar essa diferença porque, ao contrário do que acontece com SWE-bench Verified e SWE-bench Pro — onde se sabe que modelos que vão bem no Verified costumam ir pior no Pro — há menos evidência de que a mesma lógica se aplique ao OSWorld e ao OSWorld-Verified.

Pontuação do GPT-5.4 nano de 39% no OSWorld-Verified

O que estão dizendo sobre o GPT-5.4 mini e nano

Muitas reações online apontaram um padrão conhecido na tecnologia: o carro-chefe do ano passado vira o plano gratuito do ano seguinte. Tudo isso era esperado, mas a velocidade da mudança impressiona.

Há quem diga que a frontier AI tem a depreciação mais rápida de qualquer produto já feito. Muita gente se pergunta se o modelo pelo qual você paga um prêmio hoje ainda vai valer a pena em seis meses. Às vezes, desenvolvedores podem não querer simplesmente trocar um modelo por outro se já passaram por um processo de fine-tuning ou se fizeram calibrações de custo e desempenho.

Conclusão

Os benchmarks mostram uma escada de desempenho bem definida, do GPT-5.4 ao 5.4 mini e depois ao 5.4 nano. Mas, para muitas tarefas, a escolha prática depende mais de latência e orçamento do que de espremer alguns pontos percentuais extras.

Para muitos apps em produção, o GPT-5.4 mini pode ser um ótimo novo padrão, já que sua qualidade passa a sensação de frontier, ao mesmo tempo em que é barato e rápido o suficiente para uso em grande escala.

O GPT-5.4 nano é mais um especialista para workloads grandes em tempo real que são muito sensíveis à latência. Ele também é ótimo como subagente para fazer o “trabalho de massa” mais simples, delegado por modelos Thinking de alto desempenho.

Num cenário em que o carro-chefe do ano passado vira o “mini” deste ano, projetar sistemas que trocam de modelo com facilidade é melhor do que otimizar para um único lançamento. Recomendo nosso curso Building Scalable Agentic Systems, que aborda essa questão e ensina a usar frameworks de agentes como o Model Context Protocol (MCP).

GPT-5.4 mini e nano: perguntas frequentes

O GPT‑5.4 mini é apenas um GPT‑5 mini mais rápido?

Não. Ele é mais rápido e também bem mais forte em benchmarks como o SWE‑Bench Pro, mantendo uma janela de contexto de 400k.

Qual é a principal troca entre o GPT‑5.4 e o 5.4 mini?

O GPT‑5.4 ainda é o melhor para máxima qualidade; o 5.4 mini abre mão de um pouco de acurácia em troca de latência e custo muito melhores.

Quando devo usar o GPT‑5.4 nano em vez do mini?

Use o nano para workloads ultra sensíveis à latência ou de volume muito alto, onde custo e velocidade importam mais do que a acurácia de ponta.

Os GPT-5.4 mini e nano suportam tools e imagens?

Sim. Ambos suportam entrada de imagem, uso de ferramentas, function calling e saídas estruturadas na API.

Os GPT-5.4 mini e nano são bons para programação e agentes?

Sim. O 5.4 mini, em especial, passa de 50% no SWE‑Bench Pro e tem resultados competitivos no Terminal‑Bench 2.0, o que o torna forte para código e agentes de terminal.

O 5.4 nano é mais fraco, mas ainda dá conta de muitas tarefas de suporte, como roteamento de solicitações, atuar como subagente barato e lidar com fluxos simples de terminal em que velocidade e custo são o que mais importam.

Editor de Ciência de Dados @ DataCamp | Fazer previsões e construir com APIs é a minha paixão.