Program

Ragu mengirim prompt Anda ke server cloud? Keamanan adalah kekhawatiran besar bagi banyak orang—dan itu wajar.

Anda memilih ChatGPT atau Claude, mengetik prompt, lalu permintaan dikirim ke infrastruktur milik pihak lain. Untuk sebagian besar kasus, itu tidak masalah. Namun jika Anda bekerja dengan data sensitif atau kode proprieter, itu bisa menjadi risiko keamanan. Selain itu, antarmuka cloud membatasi Anda pada model tertentu, batas kecepatan, dan paket harga.

Open WebUI adalah antarmuka berbasis browser yang di-host sendiri untuk berinteraksi dengan LLM. Antarmukanya mirip UI ChatGPT, namun berjalan di mesin Anda sendiri. Ia terhubung ke Ollama, API yang kompatibel dengan OpenAI, dan model lokal, sehingga data Anda tetap berada di tempat yang Anda tentukan.

Dalam artikel ini, saya akan memandu Anda memasang Open WebUI dengan Docker, menghubungkannya ke model lokal, dan menggunakannya untuk tugas nyata seperti chat dan pembuatan kode.

Apa Itu Open WebUI dan Cara Kerjanya

Open WebUI adalah antarmuka chat berbasis browser untuk berinteraksi dengan LLM—mirip ChatGPT, tetapi berjalan di mesin Anda sendiri.

Arsitekturnya sesederhana mungkin. Ada UI frontend yang Anda akses di browser, dan backend yang terhubung ke penyedia model seperti Ollama atau API apa pun yang kompatibel dengan OpenAI.

Jadi, Open WebUI tidak menjalankan model—ia hanya berkomunikasi dengan backend mana pun yang Anda arahkan.

Anggap saja ini sebagai pintu depan universal untuk setup AI lokal Anda.

Artinya, Anda bisa mengganti backend model tanpa mengubah antarmuka, dan Anda bisa menjalankan antarmuka di satu mesin sementara model berjalan di mesin lain.

Dengan Open WebUI, Anda mendapatkan:

- Antarmuka chat untuk mengirim prompt dan membaca respons

- Unggah file untuk memasukkan dokumen ke dalam percakapan Anda

- Dukungan multi-model untuk berganti model dalam UI yang sama

- Riwayat percakapan agar Anda dapat meninjau dan melanjutkan sesi sebelumnya

Jika Anda pernah menggunakan ChatGPT atau Claude, antarmukanya akan terasa familiar. Perbedaannya ada pada apa yang berjalan di belakangnya. Mari kita bahas.

Cara Memasang Open WebUI (Metode Docker)

Docker adalah cara tercepat untuk menjalankan Open WebUI, dan juga menjalankannya dalam isolasi penuh.

Prasyarat

Anda perlu menginstal Docker di mesin Anda. Jika belum, unduh dari situs resmi Docker.

Ollama bersifat opsional pada tahap ini. Jika Anda ingin langsung menghubungkan Open WebUI ke model lokal, pasang Ollama terlebih dahulu dan tarik setidaknya satu model. Jika Anda hanya ingin menjalankan antarmuka dan menghubungkannya nanti, lewati langkah ini untuk sekarang.

Langkah instalasi

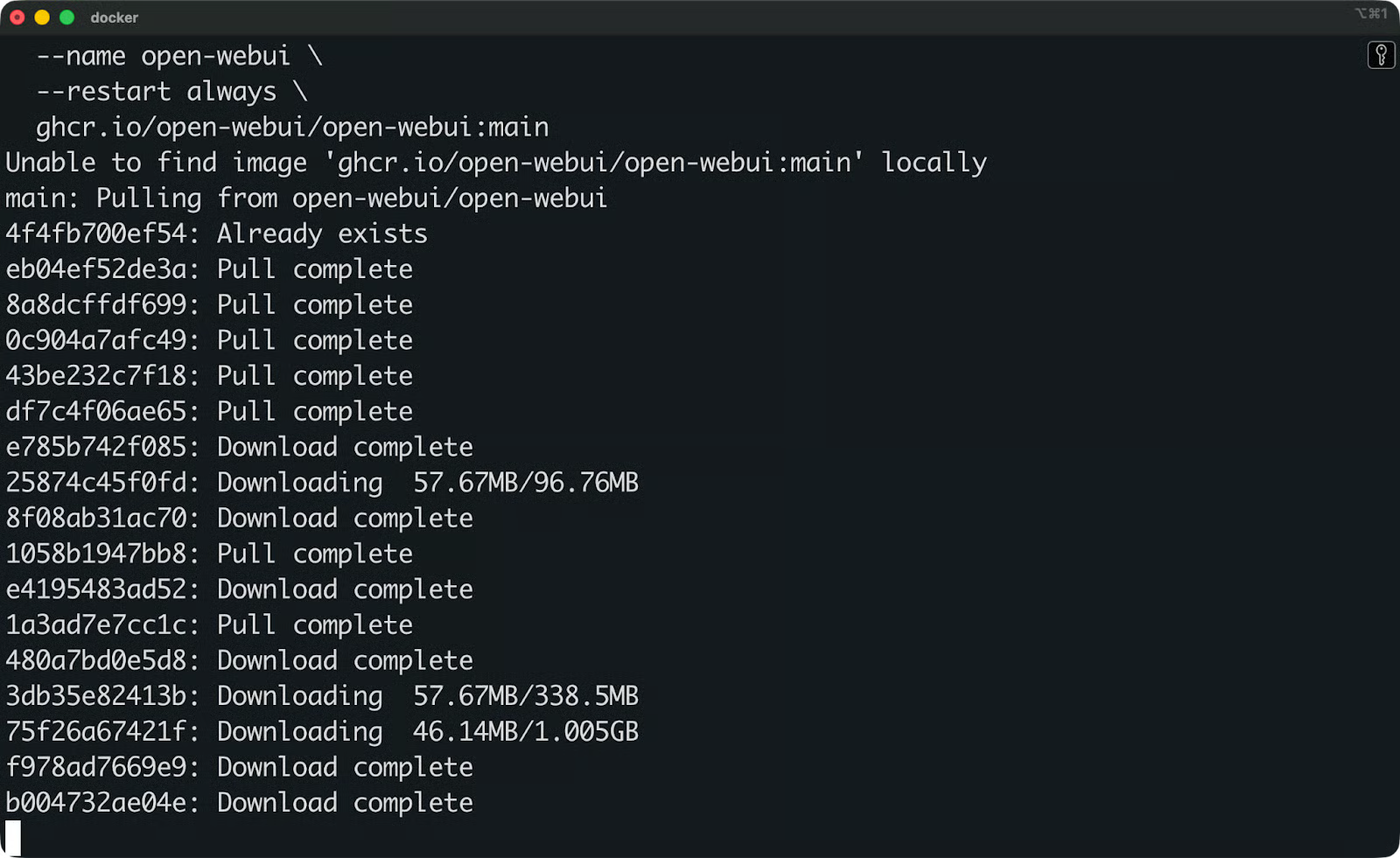

Jalankan perintah ini untuk menarik image Open WebUI dan memulai container:

docker run -d \

-p 3000:8080 \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:main

Image Open WebUI sedang diunduh

Berikut fungsi masing-masing flag:

-

dmenjalankan container di latar belakang -

p 3000:8080memetakan port 8080 di dalam container ke port 3000 di mesin Anda -

v open-webui:/app/backend/datamembuat volume Docker untuk mempertahankan data Anda—percakapan, pengaturan, dan file yang diunggah tetap ada setelah container dimulai ulang -

-restart alwaysmemulai ulang container jika berhenti atau saat mesin Anda reboot -

-name open-webuimemberi nama yang mudah dibaca pada container agar bisa dirujuk nanti

Peluncuran pertama

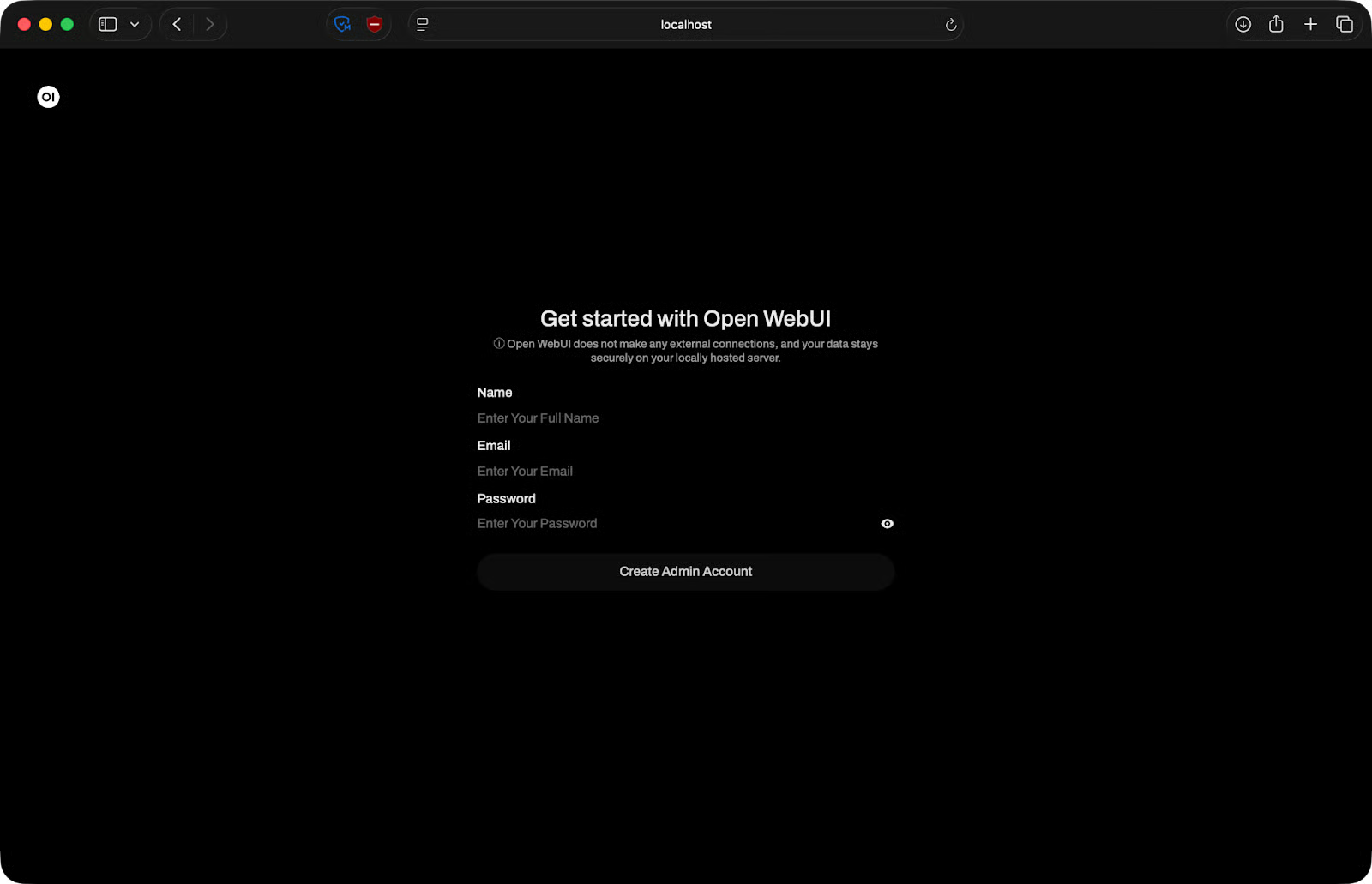

Setelah container berjalan, buka browser Anda dan kunjungi http://localhost:3000.

Pada kunjungan pertama, Open WebUI akan meminta Anda membuat akun admin. Isi nama, email, dan kata sandi Anda.

Halaman setup Open WebUI

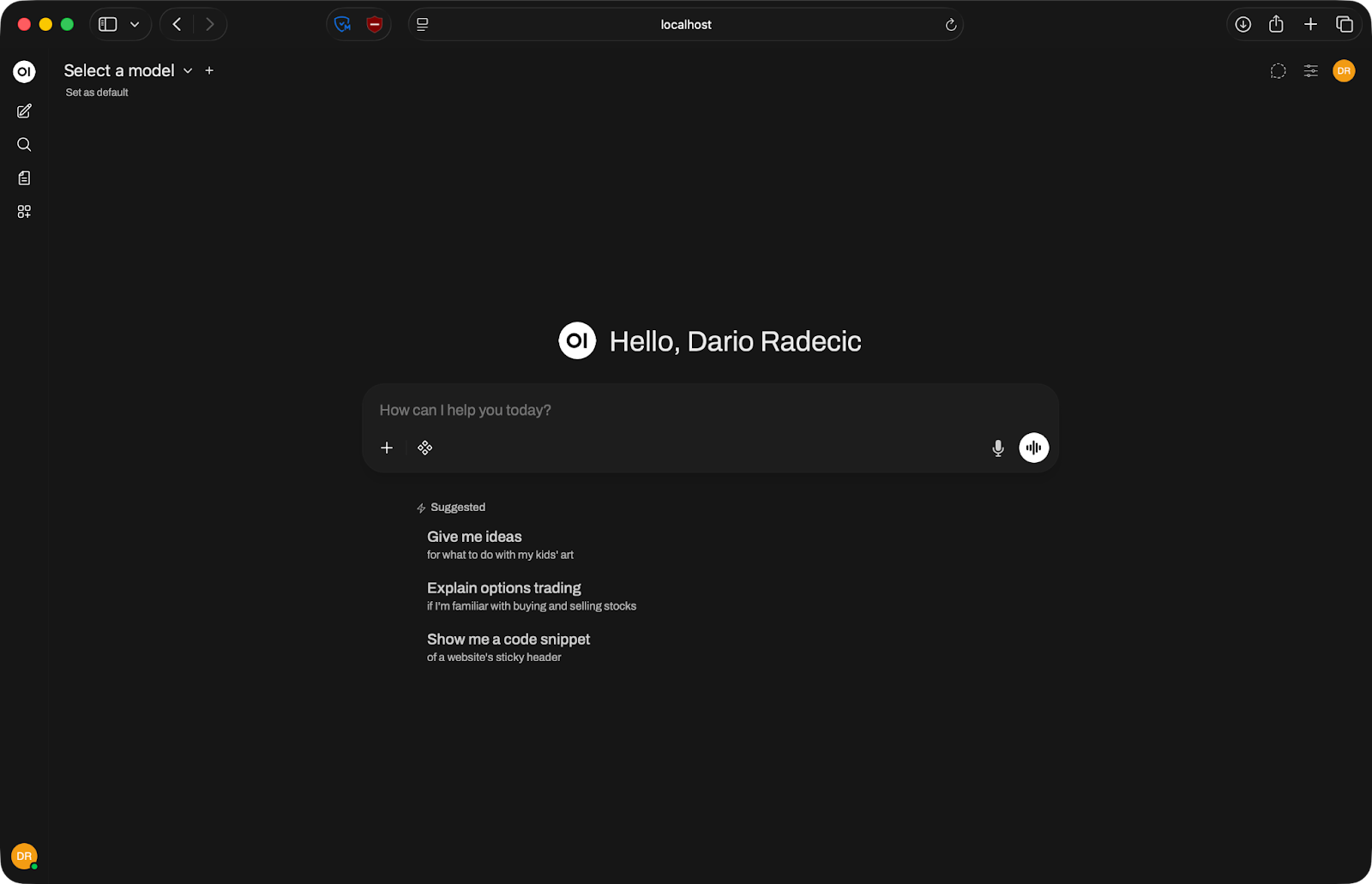

Setelah itu, Anda masuk. Antarmuka akan dimuat dan Anda siap menghubungkan model.

Halaman beranda Open WebUI

Cara Menghubungkan Open WebUI ke Ollama

Ollama adalah backend yang paling umum untuk Open WebUI karena membuat menjalankan model lokal menjadi sangat sederhana—satu perintah untuk menarik model, satu perintah lagi untuk menjalankannya.

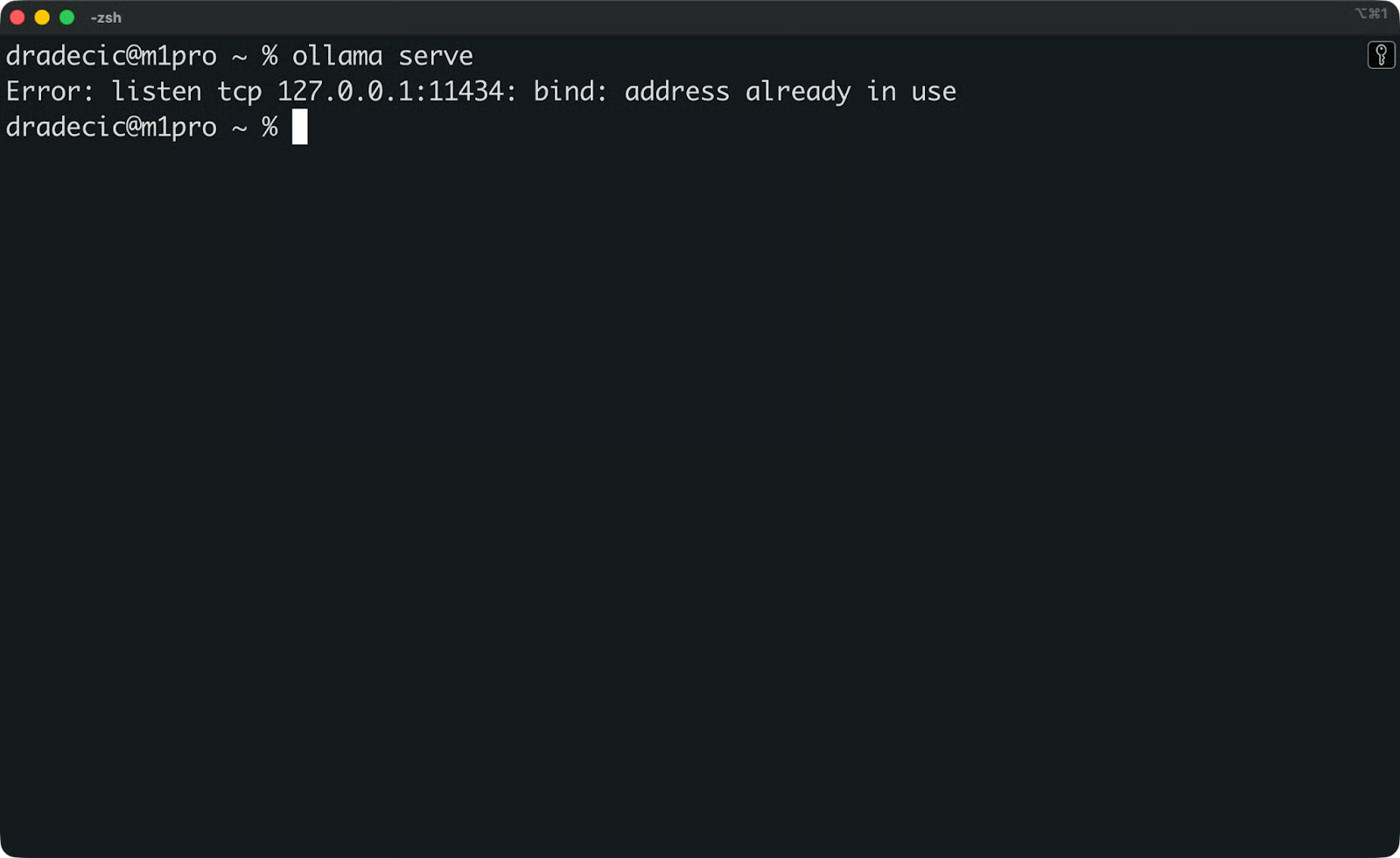

Sebelum menghubungkan apa pun, pastikan Ollama benar-benar berjalan. Buka terminal dan periksa:

ollama serve

Memeriksa apakah Ollama berjalan

Jika Ollama sudah berjalan sebagai layanan latar belakang, Anda akan melihat pesan bahwa alamat sudah digunakan. Tidak masalah—artinya layanan aktif.

Selanjutnya, pastikan Anda sudah menarik setidaknya satu model. Jalankan:

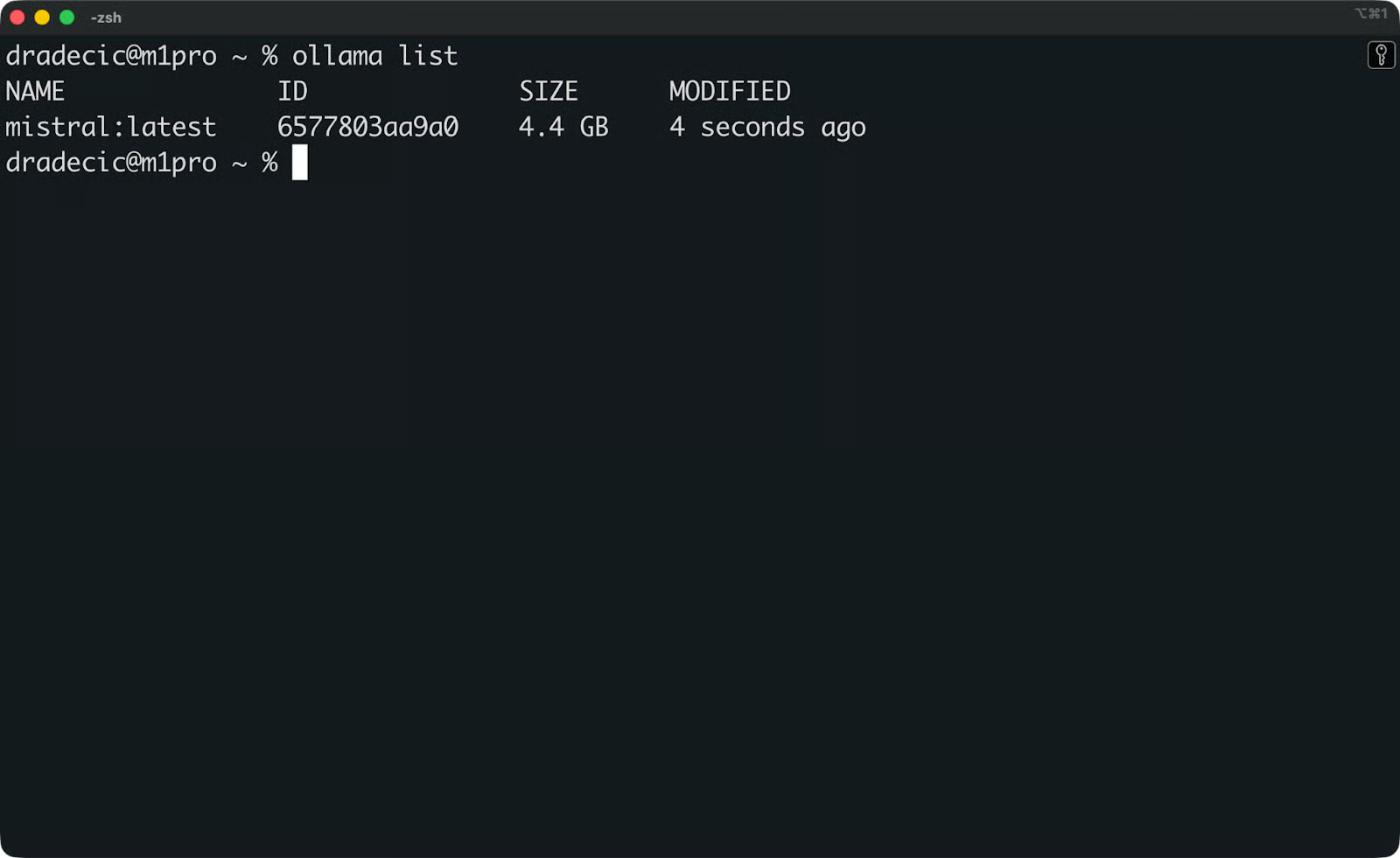

ollama list

Model Ollama yang tersedia

Jika daftarnya kosong, tarik model terlebih dahulu. Mistral adalah titik awal yang baik:

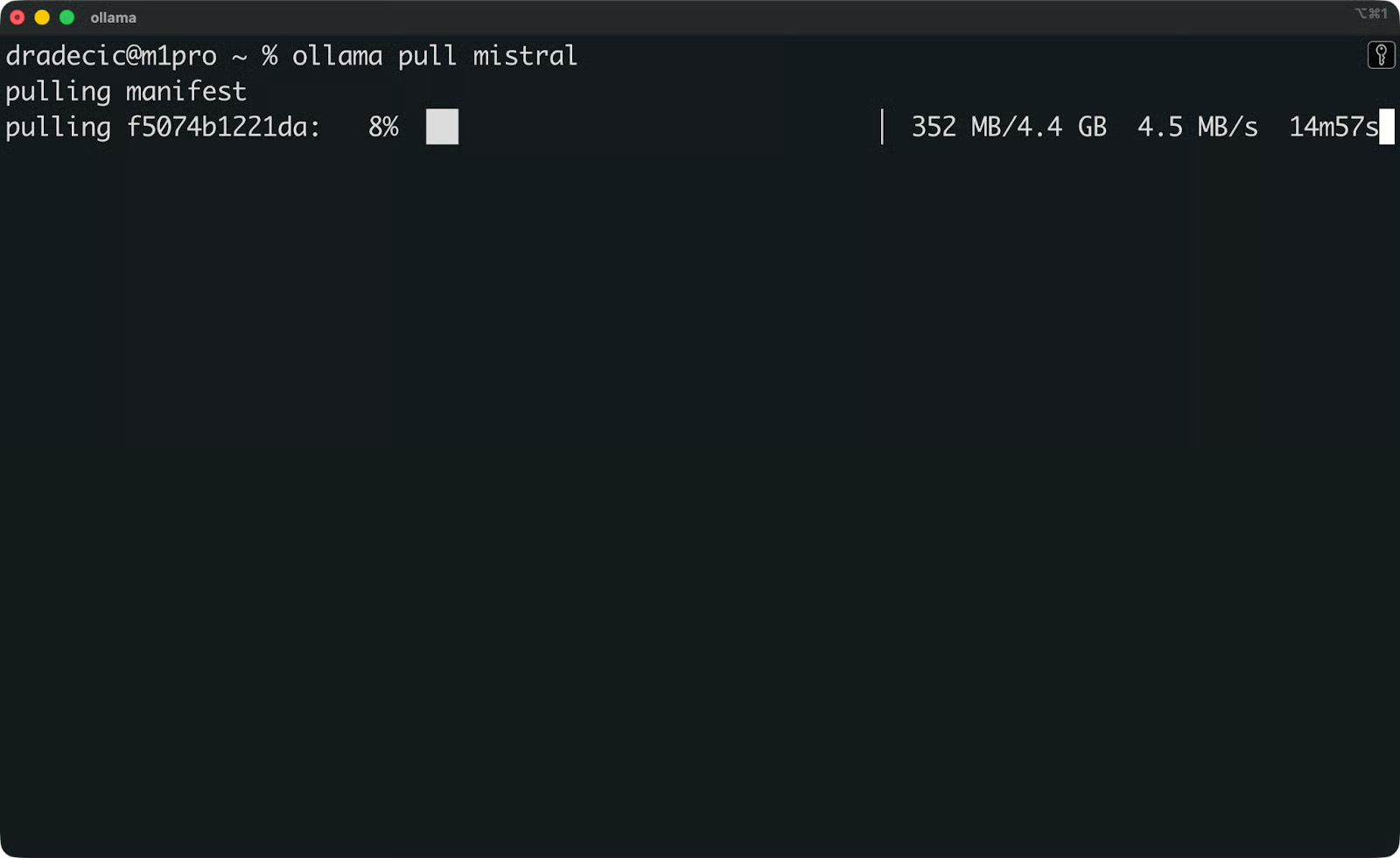

ollama pull mistral

Menarik model Mistral

Mistral adalah model serbaguna yang andal dan berjalan baik pada perangkat keras konsumen.

Menghubungkan Open WebUI ke Ollama

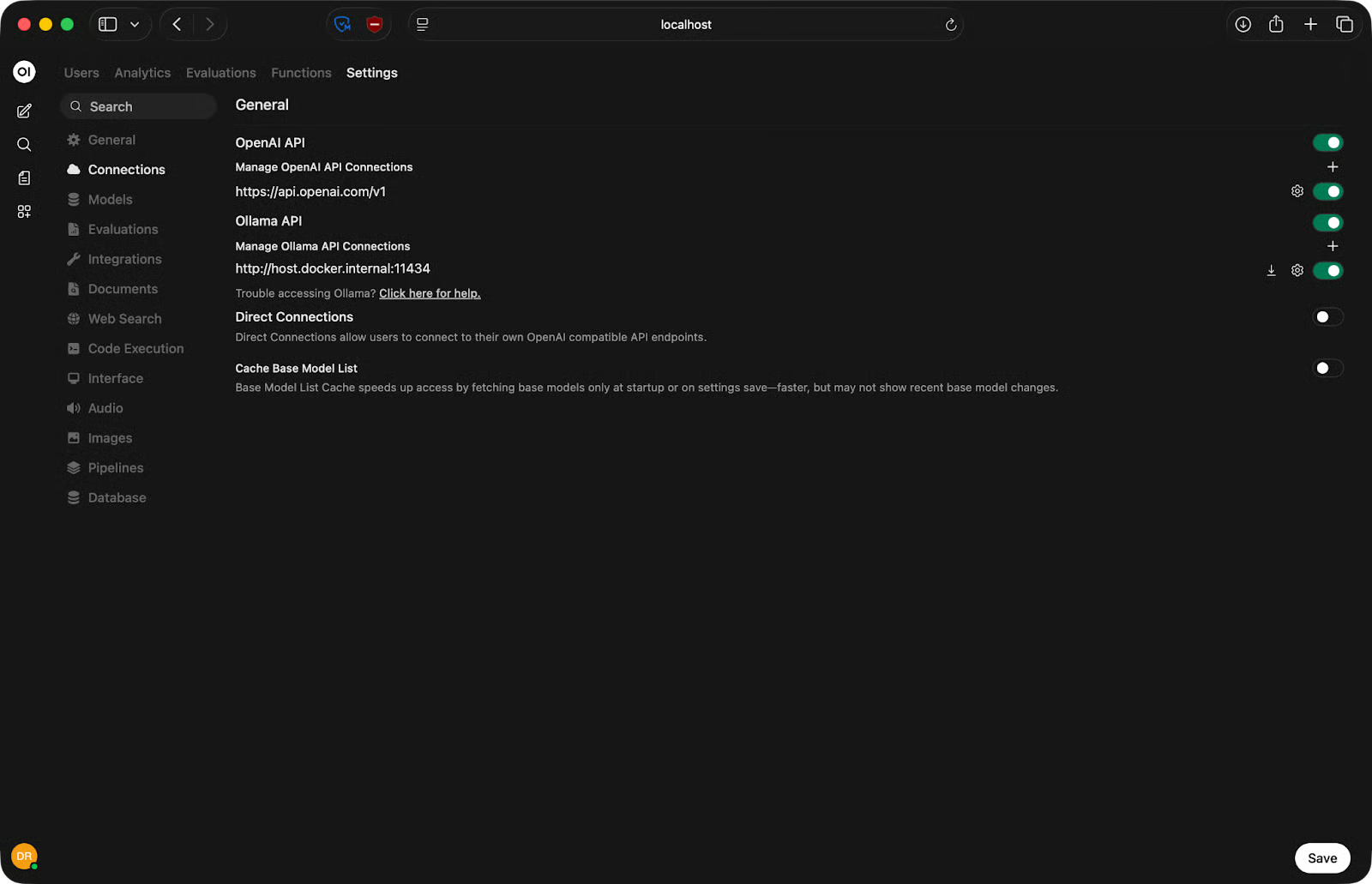

Sekarang buka Open WebUI di browser Anda di http://localhost:3000. Buka Settings - Connections dan periksa URL API Ollama. Secara default disetel ke http://host.docker.internal:11434.

Menyetel URL API Ollama

Ini berfungsi di Mac dan Windows dengan Docker Desktop. Di Linux, ganti host.docker.internal dengan IP host Anda yang sebenarnya:

http://<your-ip-address>:11434Klik Save dan muat ulang halaman. Jika koneksi berhasil, model Ollama Anda akan muncul di pemilih model di bagian atas jendela chat. Pilih salah satu dan Anda siap mulai mengobrol.

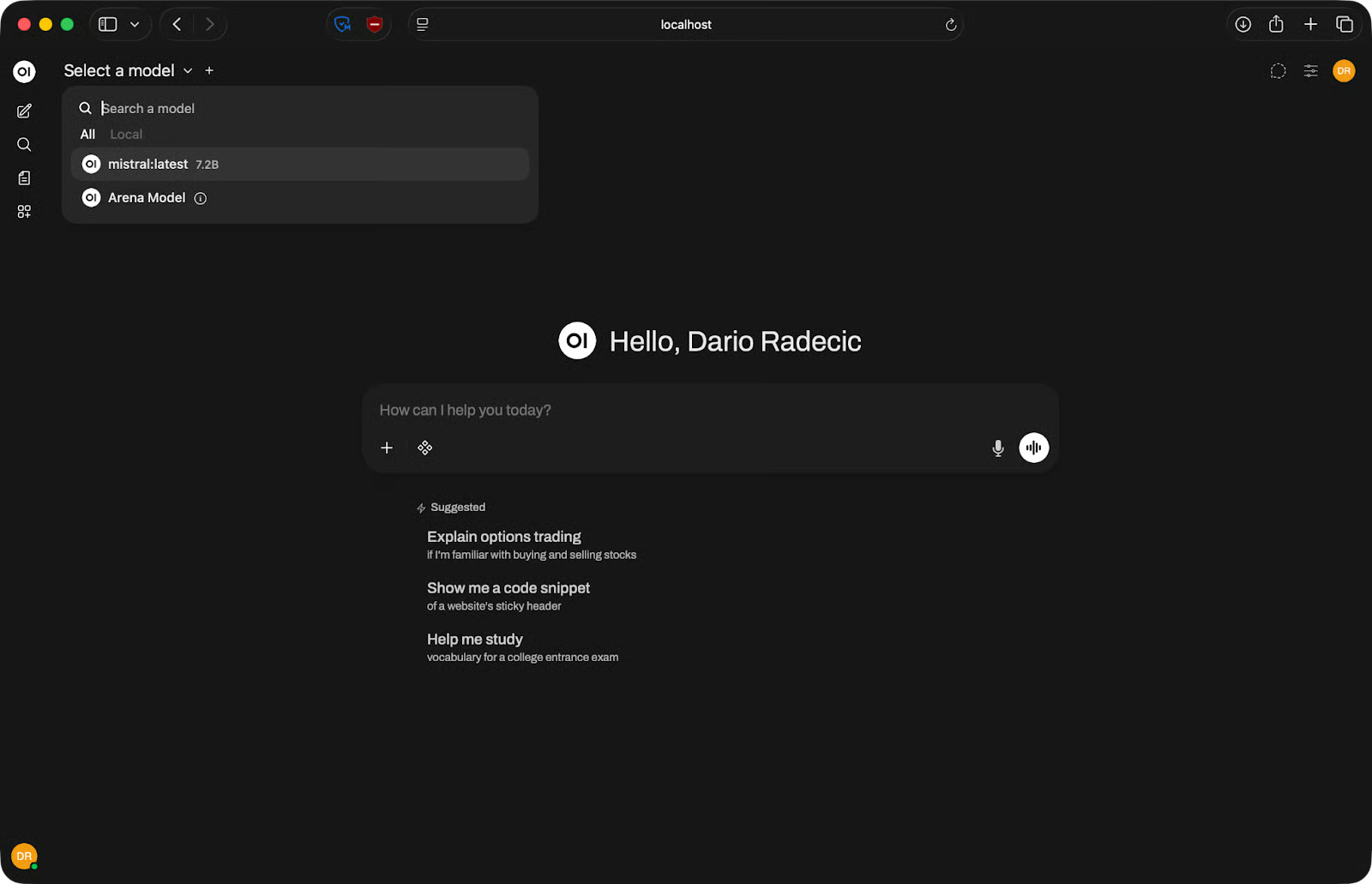

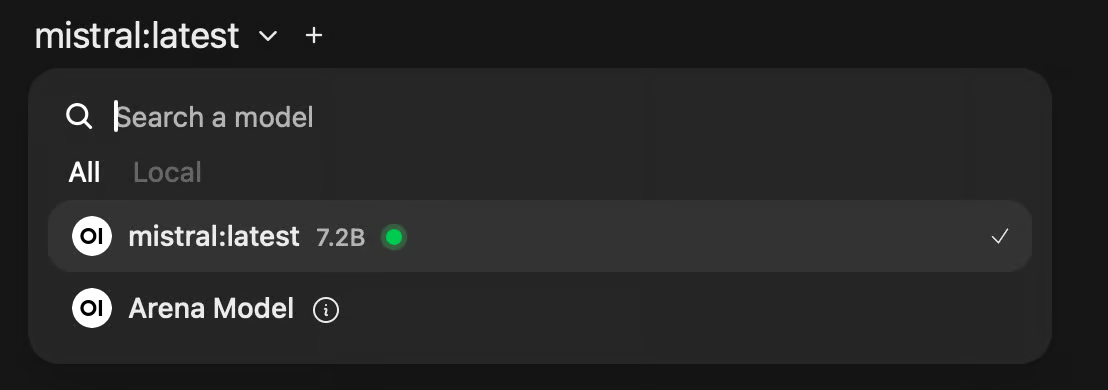

Model yang tersedia

Jika tidak ada model yang muncul, periksa kembali apakah Ollama berjalan dan URL API sudah benar untuk OS Anda.

Cara Menggunakan Open WebUI untuk Chat dan Koding

Setelah model terhubung, menggunakan Open WebUI terasa mirip dengan ChatGPT—tetapi dengan beberapa kontrol tambahan yang perlu diketahui.

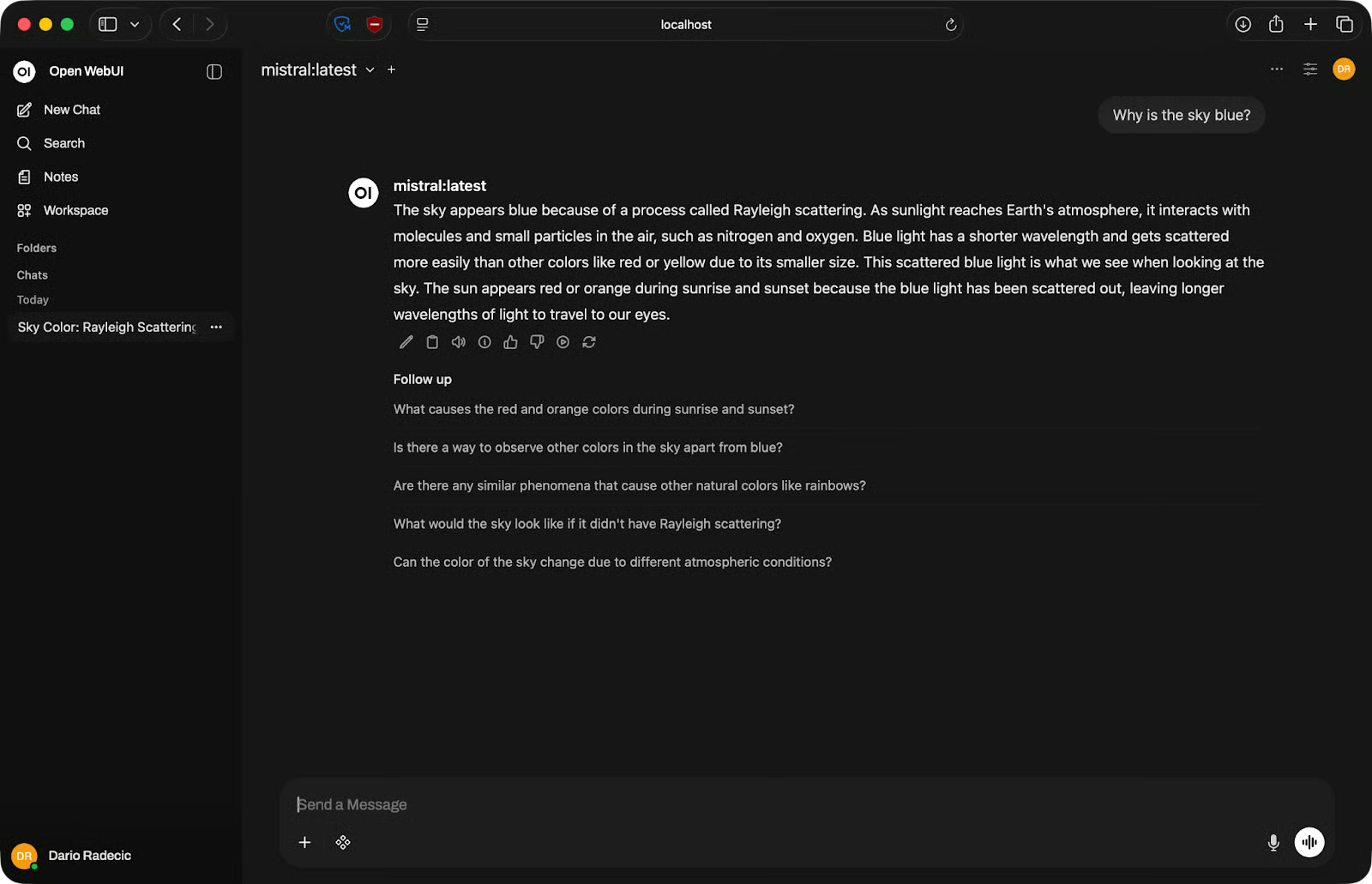

Chat dasar

Di bagian atas jendela chat, Anda akan melihat dropdown pemilih model. Klik dan pilih model yang ingin Anda gunakan. Jika Anda menghubungkan beberapa backend, semua model yang tersedia akan muncul di sini—model Ollama, model API, semuanya dalam satu daftar.

Ketik prompt Anda di kolom input di bagian bawah dan tekan Enter. Respons mengalir secara real time, jadi Anda tidak perlu menunggu keluaran penuh untuk mulai membaca.

Contoh chat dasar

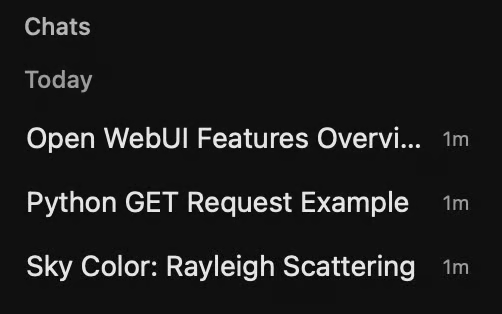

Setiap percakapan disimpan di bilah sisi kiri. Anda dapat mengganti nama percakapan agar tetap rapi, atau menghapus yang tidak diperlukan. Klik percakapan sebelumnya untuk melanjutkan dari titik terakhir.

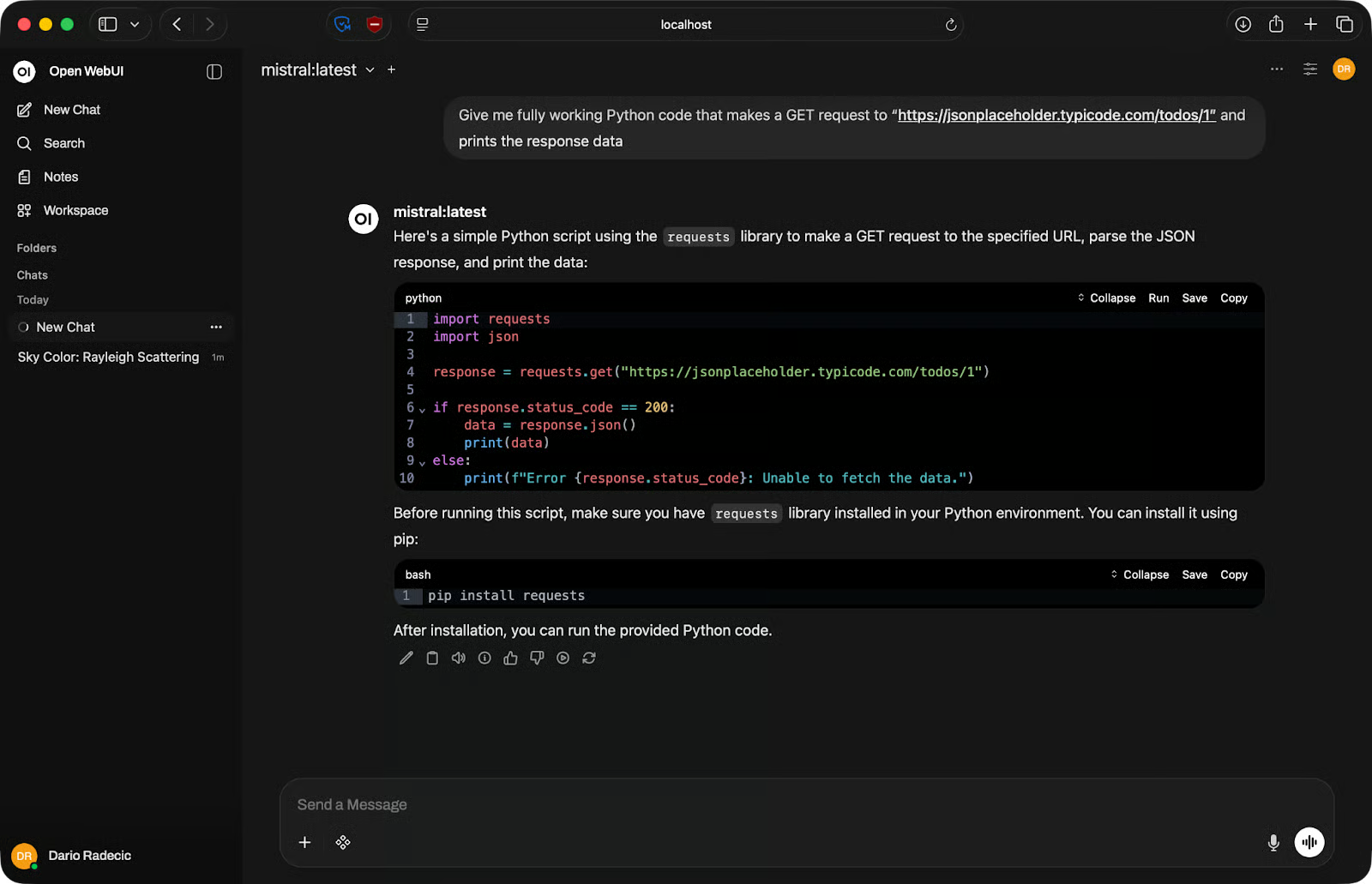

Tugas koding

Open WebUI bekerja baik untuk pembuatan dan debug kode. Cukup jelaskan kebutuhan Anda dengan bahasa natural dan model akan mengembalikan blok kode yang bisa Anda salin.

Contoh koding

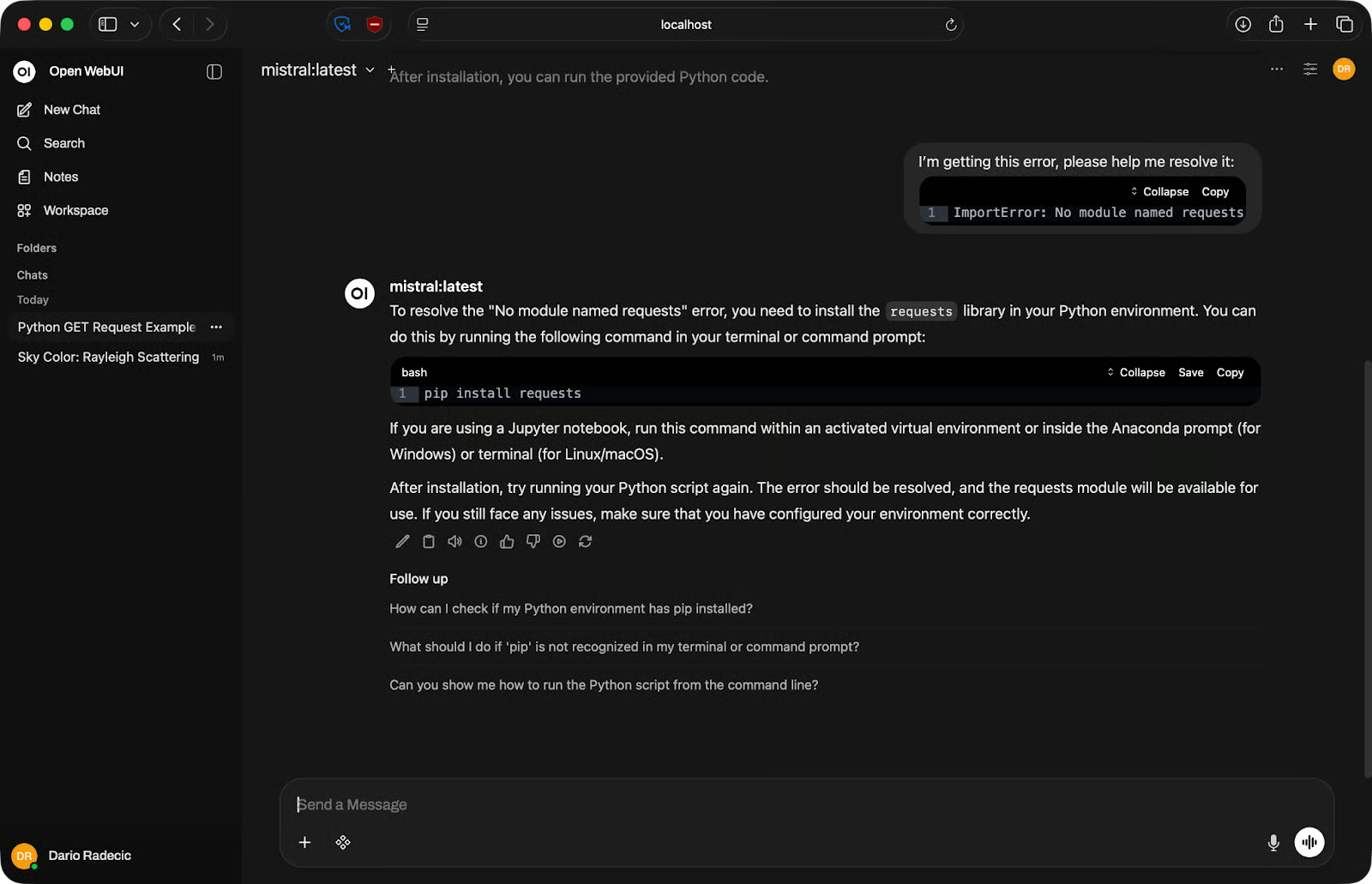

Untuk debugging, tempelkan kode dan pesan error ke prompt. Jadilah spesifik—sertakan keluaran error lengkap, bukan hanya jenis error. Semakin banyak konteks yang Anda berikan, semakin berguna responsnya.

Contoh debugging

Untuk tugas multi-langkah, jangan coba memasukkan semuanya dalam satu prompt. Pecah menjadi beberapa bagian. Minta model menulis fungsi, lalu menambahkan penanganan error, kemudian menulis pengujian. Prompt yang lebih pendek dan fokus memberikan hasil lebih baik daripada prompt panjang yang mencoba melakukan semuanya sekaligus.

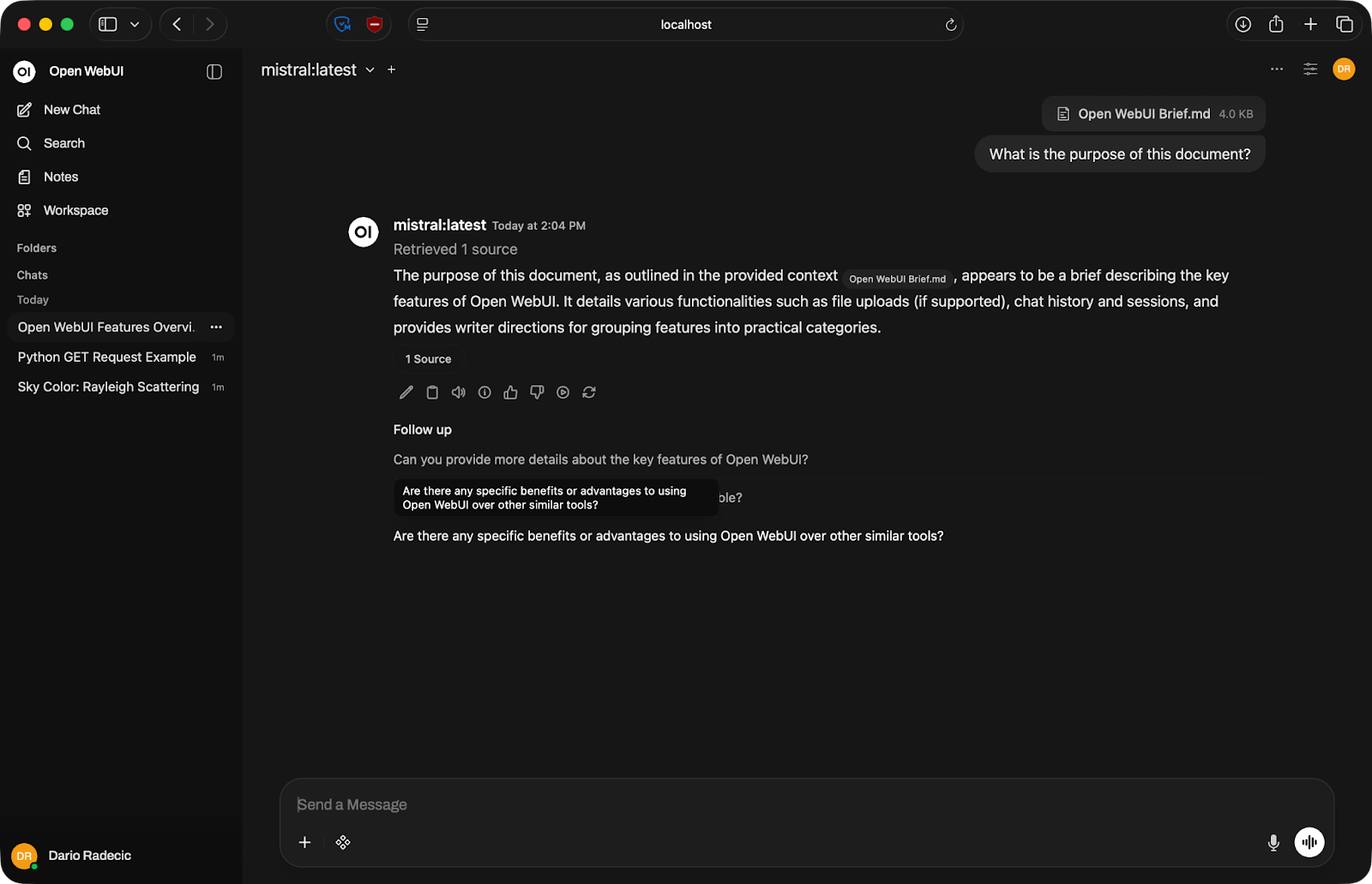

Unggah file

Open WebUI mendukung unggah file dalam chat. Klik ikon plus di area input dan lampirkan dokumen—PDF, berkas teks, atau sejenisnya.

Setelah diunggah, konten file menjadi bagian dari konteks percakapan. Anda bisa meminta model merangkumnya, mengekstrak informasi spesifik, atau menjawab pertanyaan berdasarkan isi dokumen.

Percakapan berbasis dokumen

Satu hal yang perlu diingat adalah model hanya dapat bekerja dengan konten yang muat dalam jendela konteksnya—jumlah teks maksimum yang bisa diproses sekaligus. File yang sangat besar mungkin terpotong, jadi bagi-bagi jika Anda bekerja dengan dokumen panjang.

Fitur Open WebUI yang Penting

Open WebUI memiliki banyak pengaturan, jadi mari saya bahas beberapa yang benar-benar berarti bagi Anda.

Dukungan multi-model

Pemilih model di bagian atas jendela chat memungkinkan Anda mengganti model di tengah sesi tanpa memulai percakapan baru. Ini berguna saat Anda ingin menguji prompt yang sama pada model berbeda—jalankan di Llama, lalu Mistral, dan bandingkan keluarannya berdampingan.

Pemilihan model

Jika Anda mengevaluasi model untuk tugas tertentu, ini menghemat banyak waktu.

Riwayat chat dan sesi

Setiap percakapan disimpan dan ditampilkan di bilah sisi kiri. Anda dapat mengganti nama sesi agar bermakna, sehingga Anda tidak menelusuri daftar entri "New Chat" nantinya.

Sesi chat sebelumnya

Ini membuat Open WebUI berguna untuk pekerjaan berkelanjutan. Anda dapat kembali ke sesi koding, melanjutkan prompt yang setengah jadi, atau menggunakan percakapan sebagai referensi.

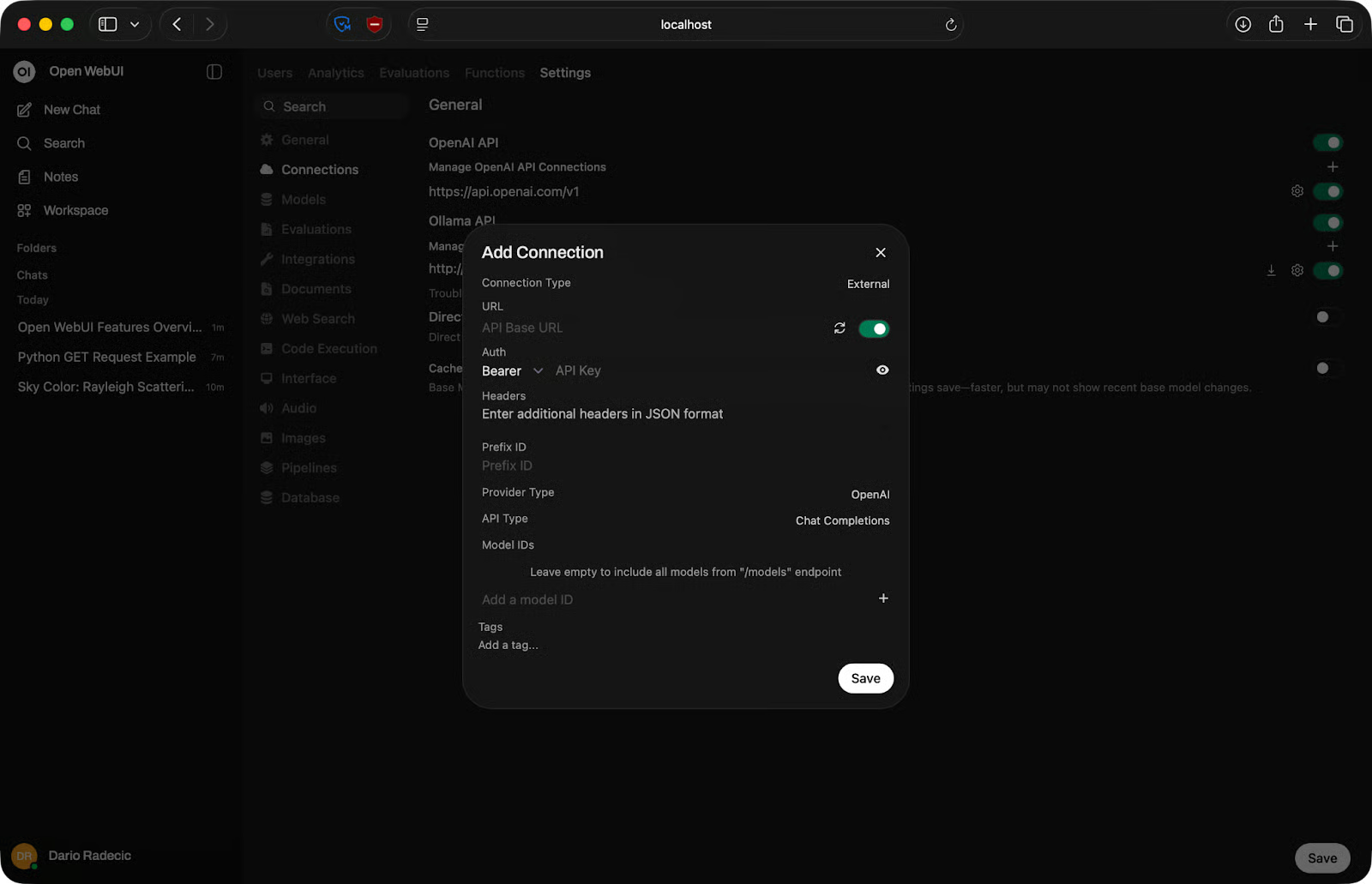

Model lokal vs. API

Open WebUI tidak mempermasalahkan apa yang berjalan di belakangnya. Anda bisa menghubungkan model Ollama lokal untuk pekerjaan privat dan API yang kompatibel dengan OpenAI untuk tugas ketika Anda memerlukan model sumber tertutup yang memang tidak muat di memori Anda sejak awal.

Mengelola koneksi OpenAI

Gunakan model lokal kecil untuk tugas cepat dan model berbasis API yang lebih besar saat pekerjaan membutuhkannya (dan mengizinkannya).

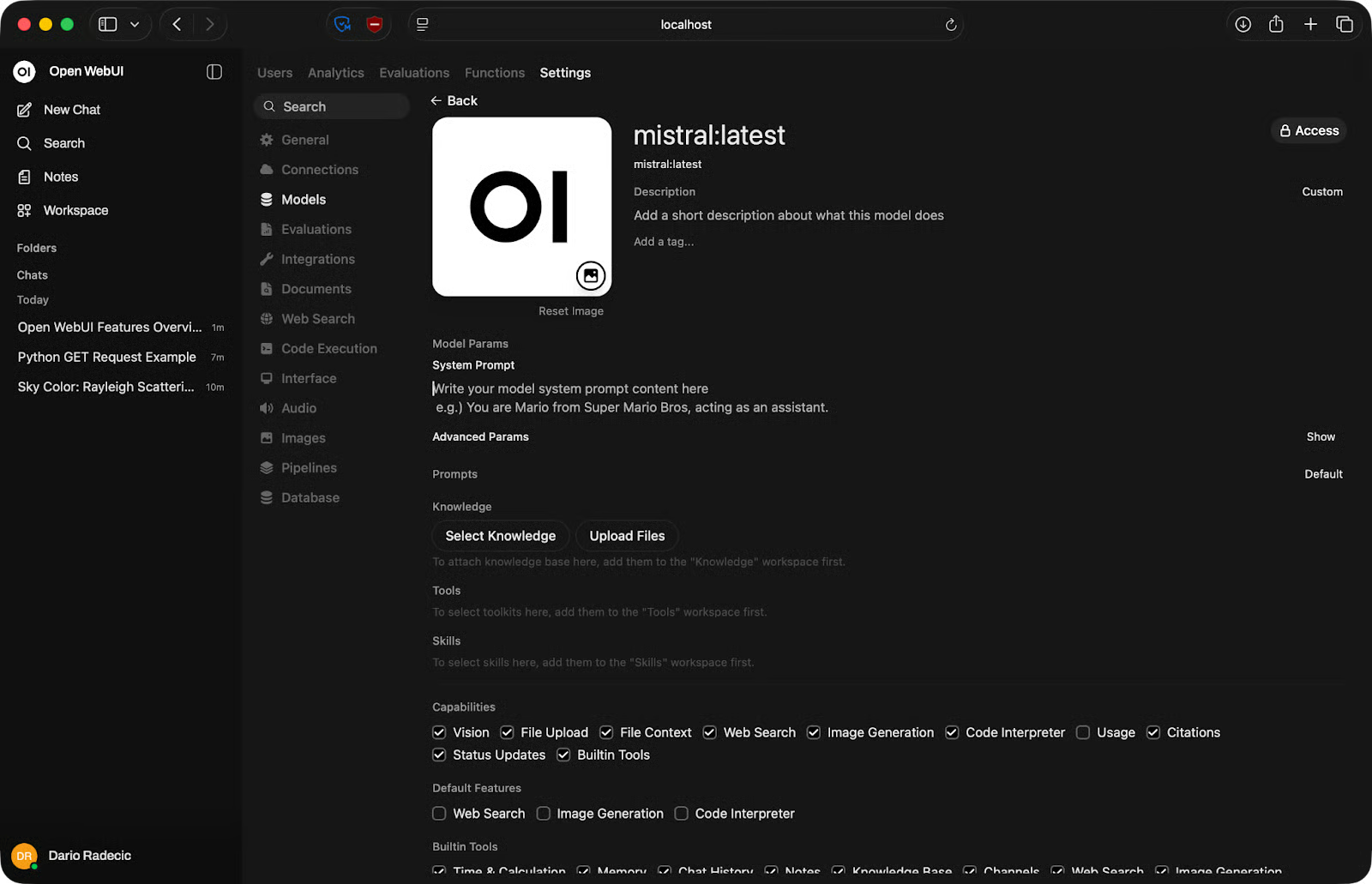

Pengaturan model kustom

Anda bisa menyesuaikan banyak hal untuk masing-masing LLM.

Di pengaturan model, Anda dapat mengubah system prompt, menambahkan basis pengetahuan (dokumen), dan menghubungkan model ke alat serta keterampilan. Anda juga dapat mengatur untuk kemampuan apa saja model akan digunakan, seperti visi, unggah file, dan memilih apakah model harus melakukan tugas seperti penelusuran web:

Mengutak-atik pengaturan model

Open WebUI vs. ChatGPT dan Antarmuka Lain

Open WebUI tidak berusaha menggantikan ChatGPT. Alih-alih, ia digunakan untuk menyelesaikan masalah yang berbeda.

Open WebUI vs. ChatGPT

Perbedaan inti adalah ke mana data Anda pergi. Dengan ChatGPT, setiap prompt dikirim ke server OpenAI. Dengan Open WebUI, semuanya tetap di mesin Anda—antarmuka, model, dan riwayat percakapan.

Komprominya adalah kinerja. GPT-5 dan model cloud serupa lebih mumpuni daripada kebanyakan model yang bisa Anda jalankan secara lokal. Jika kualitas keluaran mentah adalah prioritas, cloud unggul. Jika privasi atau akses offline lebih penting, lokal adalah pilihan yang tepat.

Biaya juga menjadi faktor. ChatGPT Plus memiliki biaya bulanan tetap. Open WebUI gratis, tetapi Anda "membayar" dengan perangkat keras—mesin dengan RAM yang cukup dan idealnya GPU.

Open WebUI vs. Ollama CLI

CLI Ollama cukup untuk uji cepat, tetapi tidak dirancang untuk pekerjaan nyata. Anda mengetik prompt, mendapat respons, dan selesai. Tidak ada riwayat, tidak ada unggah file, dan tidak ada cara membandingkan model tanpa berpindah terminal.

Open WebUI memberikan antarmuka yang layak untuk Ollama. Model dan backend sama—namun dengan manajemen percakapan, kontrol pengaturan, dan UI yang tidak hilang saat Anda menutup terminal.

Jika Anda sudah menggunakan Ollama, menambahkan Open WebUI di atasnya tidak menambah biaya dan membuat pengalaman pengguna jauh lebih baik.

Open WebUI vs. alat lain

LM Studio adalah aplikasi desktop dengan browser model bawaan dan antarmuka chat serupa. Ini pilihan yang baik jika Anda menginginkan GUI mandiri tanpa Docker. Kekurangannya, ia terikat pada desktop Anda—Open WebUI berjalan di browser dan dapat diakses dari perangkat lain di jaringan Anda.

text-generation-webui lebih ditujukan untuk pengguna tingkat lanjut. Ia mendukung lebih banyak format model dan memiliki kontrol yang lebih mendetail, namun setup lebih rumit dan antarmukanya lebih sulit dinavigasi. Open WebUI adalah titik awal yang lebih baik kecuali Anda secara spesifik membutuhkan apa yang ditawarkan text-generation-webui.

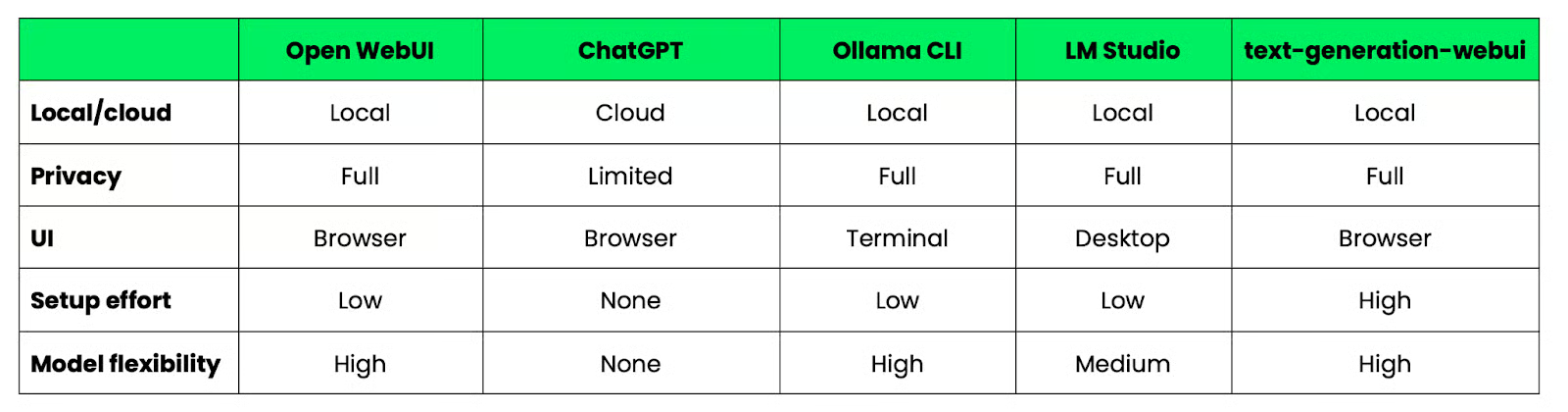

Tabel perbandingan

Anda dapat merujuk tabel ini untuk perbandingan cepat antara Open WebUI dan alternatifnya:

Open WebUI versus alternatif

Masalah Umum dan Pemecahan Masalah

Sebagian besar masalah Open WebUI jatuh ke dalam salah satu dari lima kategori—dan sebagian besar memiliki perbaikan cepat.

Container tidak mau mulai

Jalankan docker logs open-webui tepat setelah gagal start. Log akan memberi tahu apa yang salah. Sembilan dari sepuluh kasus adalah konflik port atau masalah izin volume.

Konflik port

Jika port 3000 sudah digunakan di mesin Anda, container tidak akan mulai. Perbaiki dengan memetakan ke port host yang berbeda:

docker run -d -p 3001:8080 ...Lalu akses Open WebUI di http://localhost:3001 sebagai gantinya.

Tidak dapat terhubung ke Ollama

Pertama, pastikan Ollama benar-benar berjalan:

ollama serveLalu periksa URL API di Settings - Connections. Di Mac dan Windows, seharusnya http://host.docker.internal:11434. Di Linux, gunakan alamat IP mesin host Anda. URL yang salah di sini adalah alasan paling umum kegagalan koneksi.

Model tidak muncul

Jika pemilih model kosong, Open WebUI terhubung ke Ollama tetapi tidak menemukan model. Jalankan ollama list untuk memastikan Anda sudah menarik setidaknya satu model. Jika daftar kosong, tarik satu:

ollama pull mistralMuat ulang halaman Open WebUI setelah menarik model—halaman tidak memperbarui secara otomatis.

Performa lambat

Respons lambat hampir selalu merupakan masalah perangkat keras, bukan masalah Open WebUI. Model terlalu besar untuk RAM yang tersedia atau Anda tidak memiliki GPU. Beralihlah ke model yang lebih kecil—model 7B berjalan cukup baik pada sebagian besar mesin modern dengan RAM 16GB. Jika Anda hanya mengandalkan CPU, harapkan respons lebih lambat terlepas dari ukuran model.

Praktik Terbaik Menggunakan Open WebUI

Beberapa kebiasaan akan sangat meningkatkan kinerja Open WebUI dalam penggunaan harian Anda.

- Gunakan model lebih kecil untuk kecepatan: Model yang lebih besar tidak selalu lebih baik. Model 7B merespons dalam hitungan detik dan menangani sebagian besar tugas sehari-hari dengan cukup baik. Simpan model yang lebih besar untuk tugas yang benar-benar membutuhkannya, seperti penalaran kompleks atau generasi teks panjang

- Perhatikan panjang percakapan: Setiap pesan dalam percakapan menambah konteks yang harus diproses model. Percakapan yang panjang menjadi lebih lambat dan lebih mahal untuk dijalankan seiring pertumbuhannya. Jika percakapan sudah jauh melenceng dari tujuan awal, mulailah yang baru alih-alih menyeret konteks lama

- Organisasikan prompt Anda: Jika Anda sering menggunakan prompt yang sama, simpanlah. Open WebUI memungkinkan Anda menyimpan preset prompt agar tidak perlu mengetik ulang instruksi yang sama setiap sesi. Sedikit upaya di awal akan menghemat banyak waktu

- Pantau sumber daya sistem Anda: Model lokal berjalan di perangkat keras Anda. Jika mesin Anda kewalahan, buka monitor sistem dan periksa penggunaan RAM dan CPU. Menjalankan proses berat lain bersamaan dengan model besar akan memperpanjang waktu respons. Tutup yang tidak diperlukan

- Gabungkan Open WebUI dengan alat yang sudah Anda gunakan: Antarmuka ini hanyalah bagian depan. Anda bisa mengalirkan output ke skrip, memasukkan file dari editor langsung melalui unggah, atau menggunakan Open WebUI bersamaan dengan terminal untuk tugas koding.

Kapan Menggunakan Open WebUI

Open WebUI cocok untuk situasi tertentu—tidak untuk semua situasi. Berikut daftar saat Anda sebaiknya menggunakannya:

- Pengembangan lokal adalah kasus penggunaan paling umum. Jika Anda membangun aplikasi di atas LLM dan ingin menguji prompt tanpa menghabiskan kredit API, Open WebUI memberikan siklus umpan balik yang cepat

- Eksperimen dengan model adalah keunggulan Open WebUI. Anda dapat menarik beberapa model berbeda dengan Ollama dan membandingkan bagaimana mereka menangani prompt yang sama—semua dari antarmuka yang sama, tanpa menulis satu baris kode pun

- Alur kerja sensitif privasi juga sangat cocok. Jika Anda bekerja dengan dokumen internal, data klien, atau apa pun yang tidak ingin Anda kirim ke server pihak ketiga, setup lokal menjaga semuanya tetap di mesin Anda. Tidak ada data yang keluar kecuali Anda memilih menghubungkan API eksternal

- Pembelajaran dan pembuatan prototipe juga merupakan skenario yang bagus. Jika Anda baru mengenal LLM dan ingin memahami perilakunya tanpa berlangganan paket berbayar, Open WebUI memberi cara bereksperimen berbiaya rendah. Ini juga berguna untuk membuat prototipe cepat—model lokal cukup cepat untuk menguji ide sebelum Anda berinvestasi pada setup produksi.

Namun demikian, Open WebUI bukan alat yang tepat jika Anda membutuhkan keluaran model terbaik dan privasi bukan masalah. API cloud akan lebih cocok.

Kesimpulan

Open WebUI memberi Anda antarmuka yang bersih dan praktis untuk bekerja dengan model lokal, dan Anda mengontrol lingkungan sepenuhnya.

Tidak ada data yang meninggalkan mesin Anda, tidak ada batas kecepatan, tidak perlu berlangganan. Anda memilih model, mengelola pengaturan, dan memperluas setup sesuai kebutuhan.

Cara terbaik untuk memulai adalah tetap sederhana. Jalankan container Docker, hubungkan model kecil seperti Llama atau Mistral, dan kirim beberapa prompt. Setelah berhasil, Anda bisa menambah model, mengonfigurasi system prompt, menghubungkan API eksternal, dan membangun dari sana.

Sebagai catatan, Anda juga bisa menjalankan Ollama menggunakan Docker tanpa perlu setup lokal. Baca panduan terbaru kami untuk melihat caranya.

FAQs

Apa itu Open WebUI?

Open WebUI adalah antarmuka berbasis browser yang di-host sendiri untuk berinteraksi dengan large language model. Cara kerjanya seperti ChatGPT, tetapi berjalan sepenuhnya di mesin Anda sendiri. Anda menghubungkannya ke backend model—seperti Ollama atau API yang kompatibel dengan OpenAI—dan semua data Anda tetap lokal.

Apakah saya membutuhkan mesin yang kuat untuk menjalankan Open WebUI?

Open WebUI sendiri ringan—yang membutuhkan sumber daya adalah model yang berjalan di belakangnya. Untuk sebagian besar model lokal, RAM 16GB adalah patokan yang masuk akal. GPU membantu mempercepat respons, tetapi banyak model kecil berjalan cukup baik di mesin hanya-CPU.

Apakah Open WebUI gratis digunakan?

Ya, Open WebUI bersifat open-source dan gratis. Anda tidak membayar untuk antarmukanya. Biaya yang ada hanya perangkat keras Anda sendiri dan, opsional, penggunaan API eksternal jika Anda memilih menghubungkan penyedia model berbayar seperti OpenAI.

Apa perbedaan Open WebUI dan Ollama?

Ollama adalah backend yang mengunduh dan menjalankan model lokal di mesin Anda. Open WebUI adalah frontend—antarmuka yang Anda gunakan untuk mengirim prompt dan membaca respons. Ollama menangani model, Open WebUI menangani pengalaman chat. Anda bisa menggunakan Ollama tanpa Open WebUI melalui CLI-nya, tetapi pengalamannya jauh lebih terbatas.

Bisakah saya menghubungkan Open WebUI ke API OpenAI alih-alih model lokal?

Bisa. Open WebUI mendukung endpoint API apa pun yang kompatibel dengan OpenAI. Buka Settings - Connections, tambahkan kunci API dan URL endpoint Anda, dan model berbasis cloud akan muncul di pemilih model berdampingan dengan model lokal. Ini memungkinkan Anda berganti antara model lokal dan cloud dari antarmuka yang sama.