programa

¿Te incomoda enviar tus prompts a un servidor en la nube? La seguridad preocupa a muchos, y con razón.

Eliges ChatGPT o Claude, escribes un prompt y la solicitud va a la infraestructura de otra empresa. Para la mayoría de casos no pasa nada. Pero si trabajas con datos sensibles o código propietario, puede ser un riesgo. Además, las interfaces en la nube te encasillan en modelos concretos, límites de uso y planes de precios.

Open WebUI es una interfaz autohospedada, basada en navegador, para interactuar con LLM. Es como la UI de ChatGPT, pero ejecutándose en tu propio equipo. Se conecta con Ollama, APIs compatibles con OpenAI y modelos locales, así que tus datos se quedan donde tú quieras.

En este artículo, te guío paso a paso para instalar Open WebUI con Docker, conectarlo a un modelo local y usarlo para tareas reales como chat y generación de código.

Qué es Open WebUI y cómo funciona

Open WebUI es una interfaz de chat en el navegador para interactuar con LLM, similar a ChatGPT, pero ejecutándose en tu máquina.

La arquitectura no puede ser más simple. Hay una interfaz frontal a la que accedes desde el navegador y un backend que se conecta a proveedores de modelos como Ollama o cualquier API compatible con OpenAI.

Así que Open WebUI no ejecuta modelos: se comunica con el backend que le indiques.

Piensa en él como la puerta de entrada universal a tu configuración de IA local.

Esto significa que puedes cambiar el backend del modelo sin tocar la interfaz, y ejecutar la interfaz en una máquina mientras el modelo corre en otra.

Con Open WebUI, obtienes:

- Una interfaz de chat para enviar prompts y leer respuestas

- Carga de archivos para incorporar documentos a tus conversaciones

- Soporte multmodelo para cambiar entre modelos desde la misma UI

- Historial de conversaciones para retomar sesiones anteriores cuando quieras

Si has usado ChatGPT o Claude, la interfaz te resultará familiar. La diferencia está en lo que hay detrás. Vamos a ello.

Cómo instalar Open WebUI (método Docker)

Docker es la forma más rápida de poner Open WebUI en marcha, y además lo ejecuta en completo aislamiento.

Requisitos previos

Necesitas tener Docker instalado en tu equipo. Si aún no lo tienes, descárgalo desde el sitio oficial de Docker.

Ollama es opcional en este punto. Si quieres conectar Open WebUI a un modelo local desde el principio, instala primero Ollama y descarga al menos un modelo. Si solo quieres poner en marcha la interfaz y conectarlo más tarde, puedes saltarte este paso.

Pasos de instalación

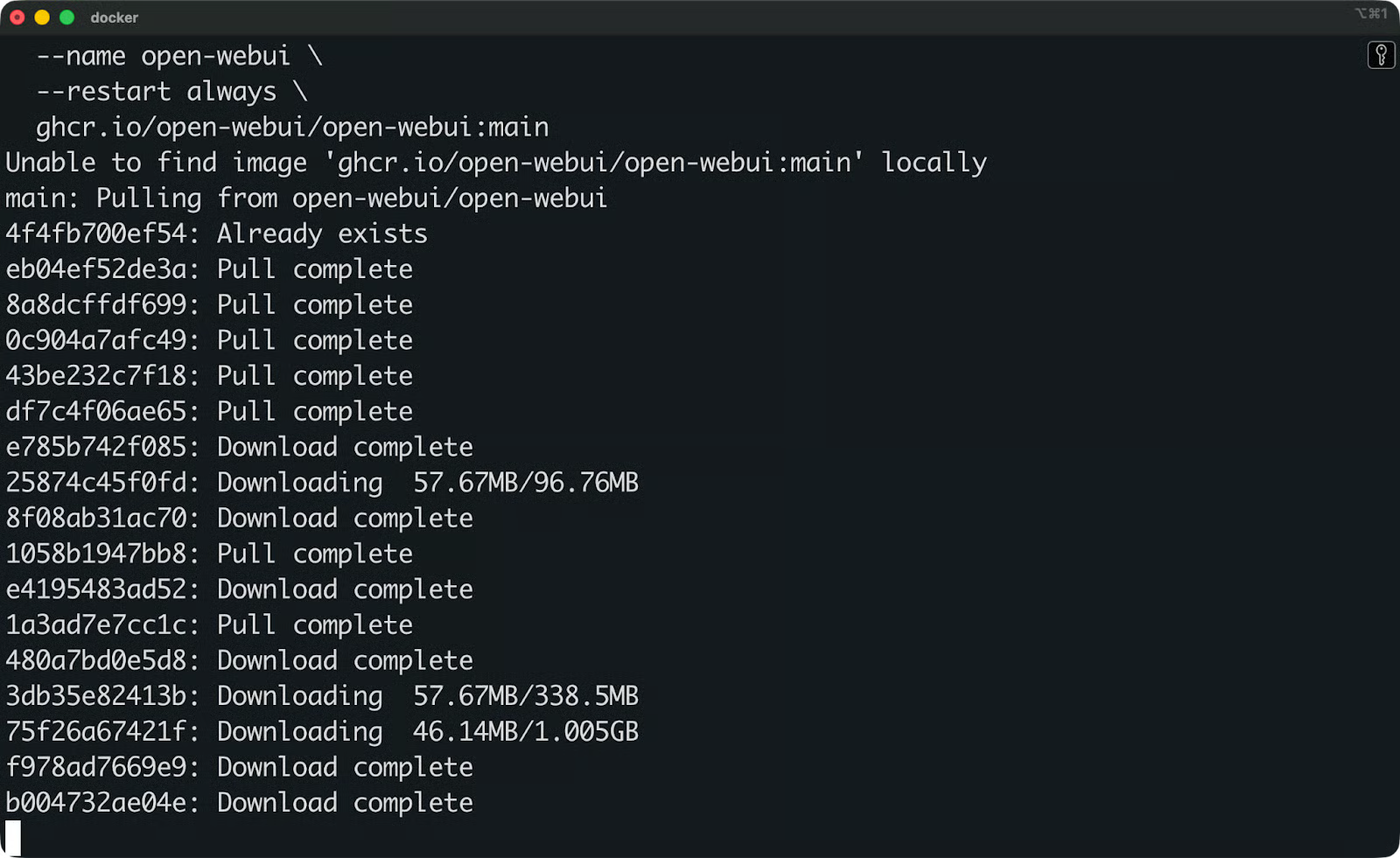

Ejecuta este comando para descargar la imagen de Open WebUI e iniciar el contenedor:

docker run -d \

-p 3000:8080 \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:main

Descarga de la imagen de Open WebUI

Esto es lo que hace cada flag:

-

dejecuta el contenedor en segundo plano -

p 3000:8080mapea el puerto 8080 dentro del contenedor al puerto 3000 de tu máquina -

v open-webui:/app/backend/datacrea un volumen de Docker para persistir tus datos: las conversaciones, la configuración y los archivos subidos se conservarán tras reiniciar el contenedor -

-restart alwaysreinicia el contenedor si se detiene o si tu equipo se reinicia -

-name open-webuile da un nombre legible al contenedor para poder referenciarlo después

Primer inicio

Cuando el contenedor arranque, abre el navegador y ve a http://localhost:3000.

La primera vez, Open WebUI te pedirá crear una cuenta de administrador. Rellena tu nombre, email y contraseña.

Página de configuración de Open WebUI

Después, ya estarás dentro. Se carga la interfaz y podrás conectar un modelo.

Página de inicio de Open WebUI

Cómo conectar Open WebUI a Ollama

Ollama es el backend más habitual para Open WebUI porque facilita al máximo ejecutar modelos locales: un comando para descargar un modelo y otro para ejecutarlo.

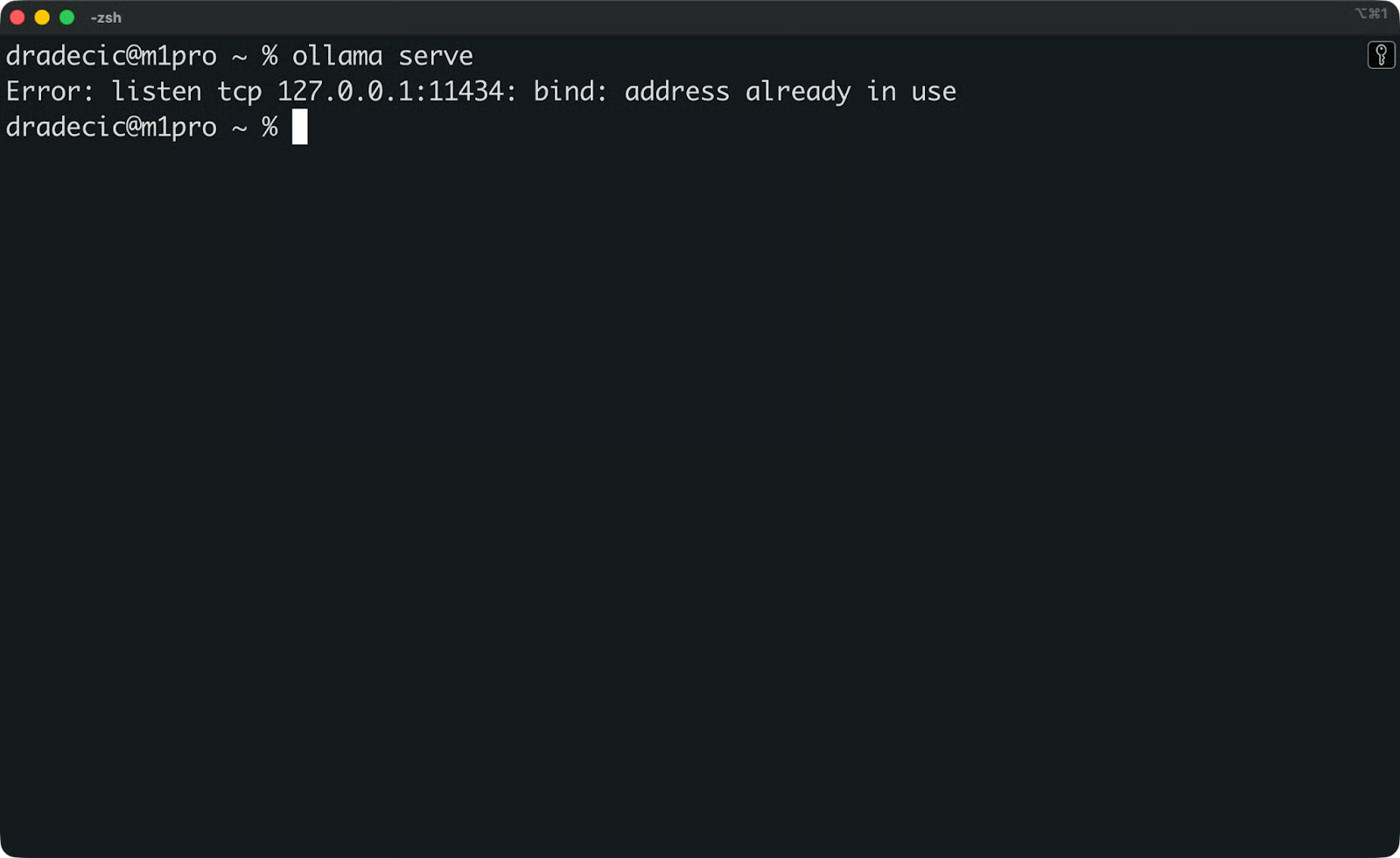

Antes de conectar nada, asegúrate de que Ollama está en ejecución. Abre una terminal y compruébalo:

ollama serve

Comprobación de que Ollama está en ejecución

Si Ollama ya se está ejecutando como servicio en segundo plano, verás un mensaje indicando que la dirección ya está en uso. Perfecto: significa que está activo.

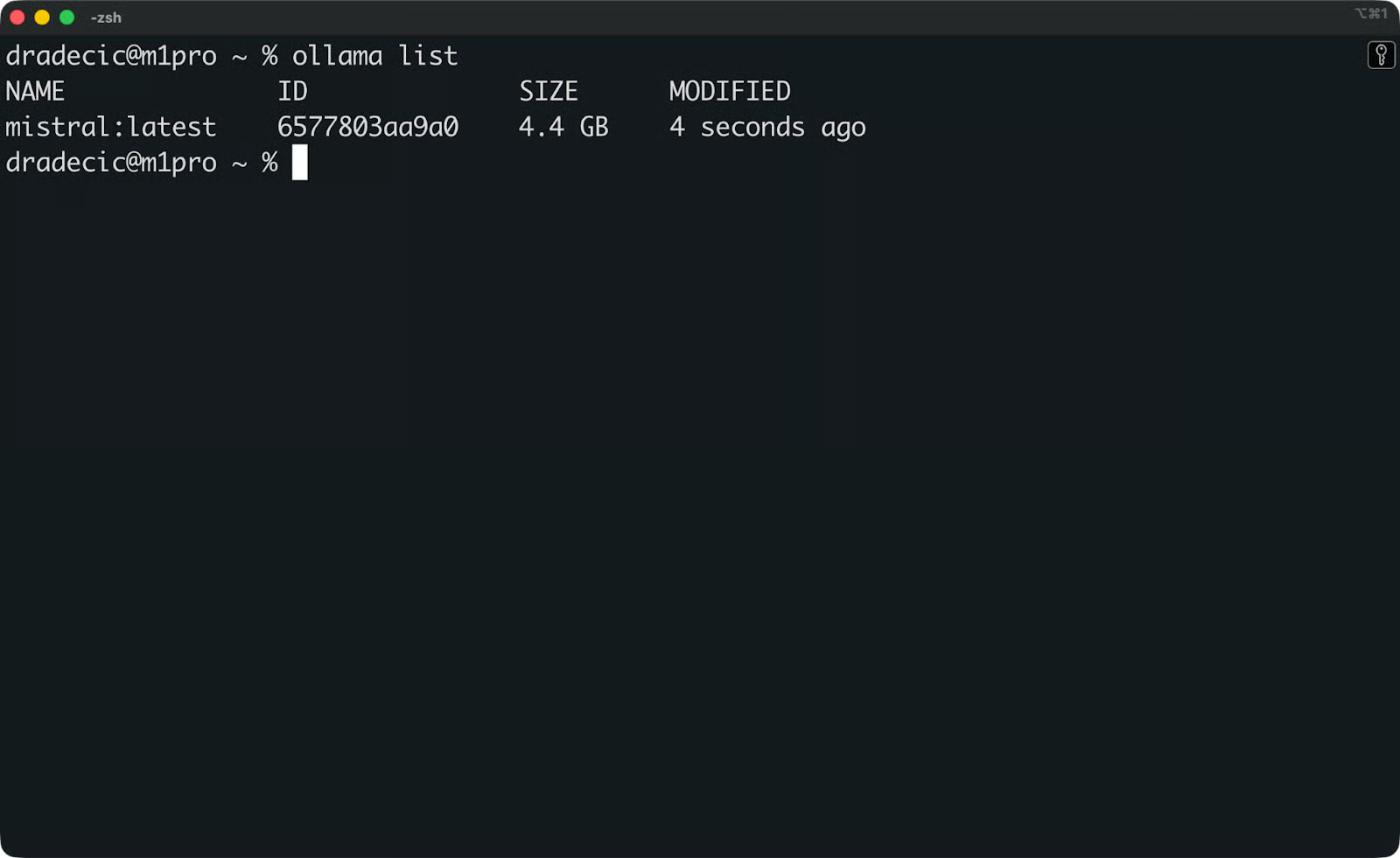

Después, verifica que tienes al menos un modelo descargado. Ejecuta:

ollama list

Modelos disponibles en Ollama

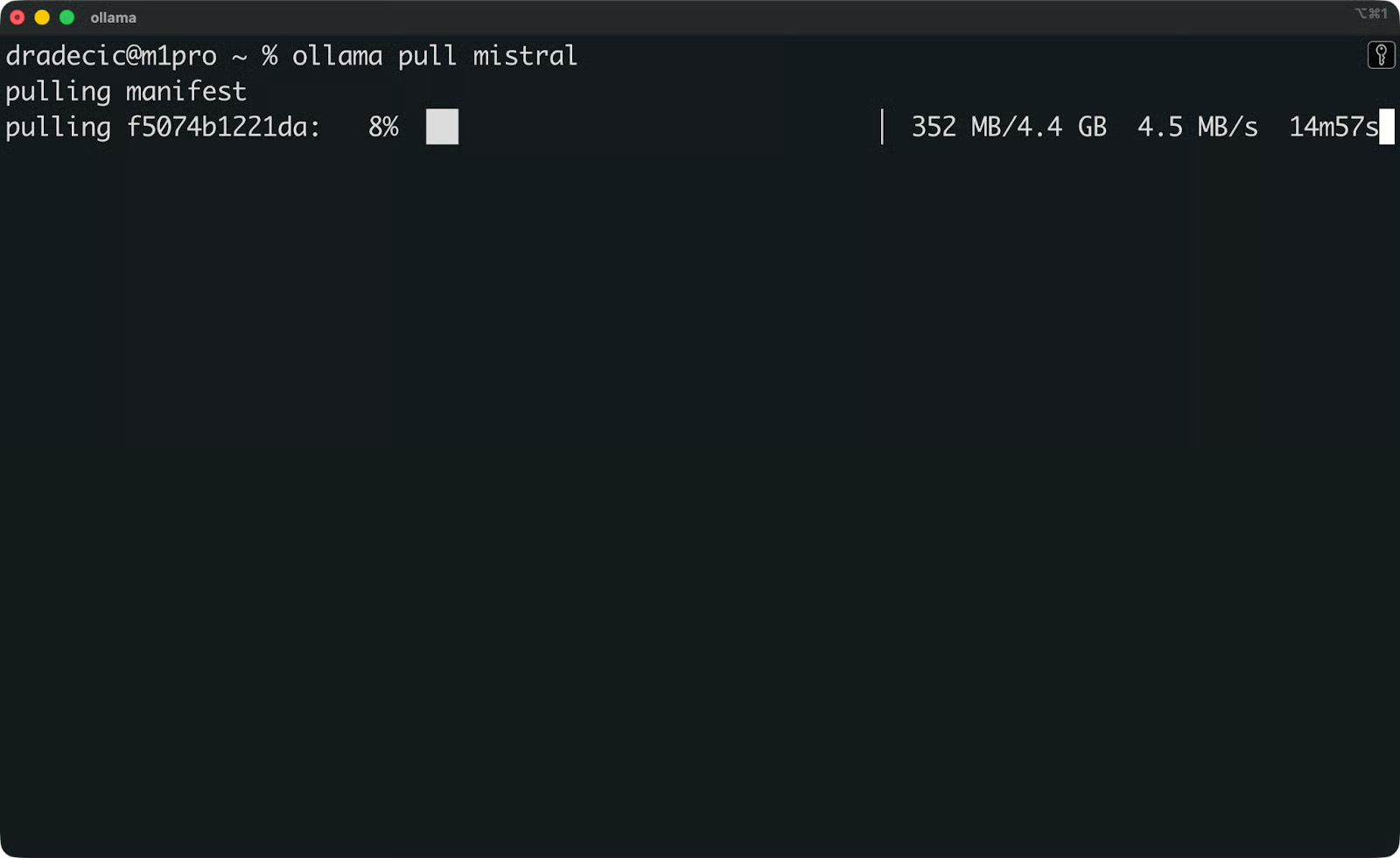

Si la lista está vacía, descarga primero un modelo. Mistral es una buena opción de inicio:

ollama pull mistral

Descargando el modelo Mistral

Mistral es un modelo generalista sólido que funciona bien en hardware de consumo.

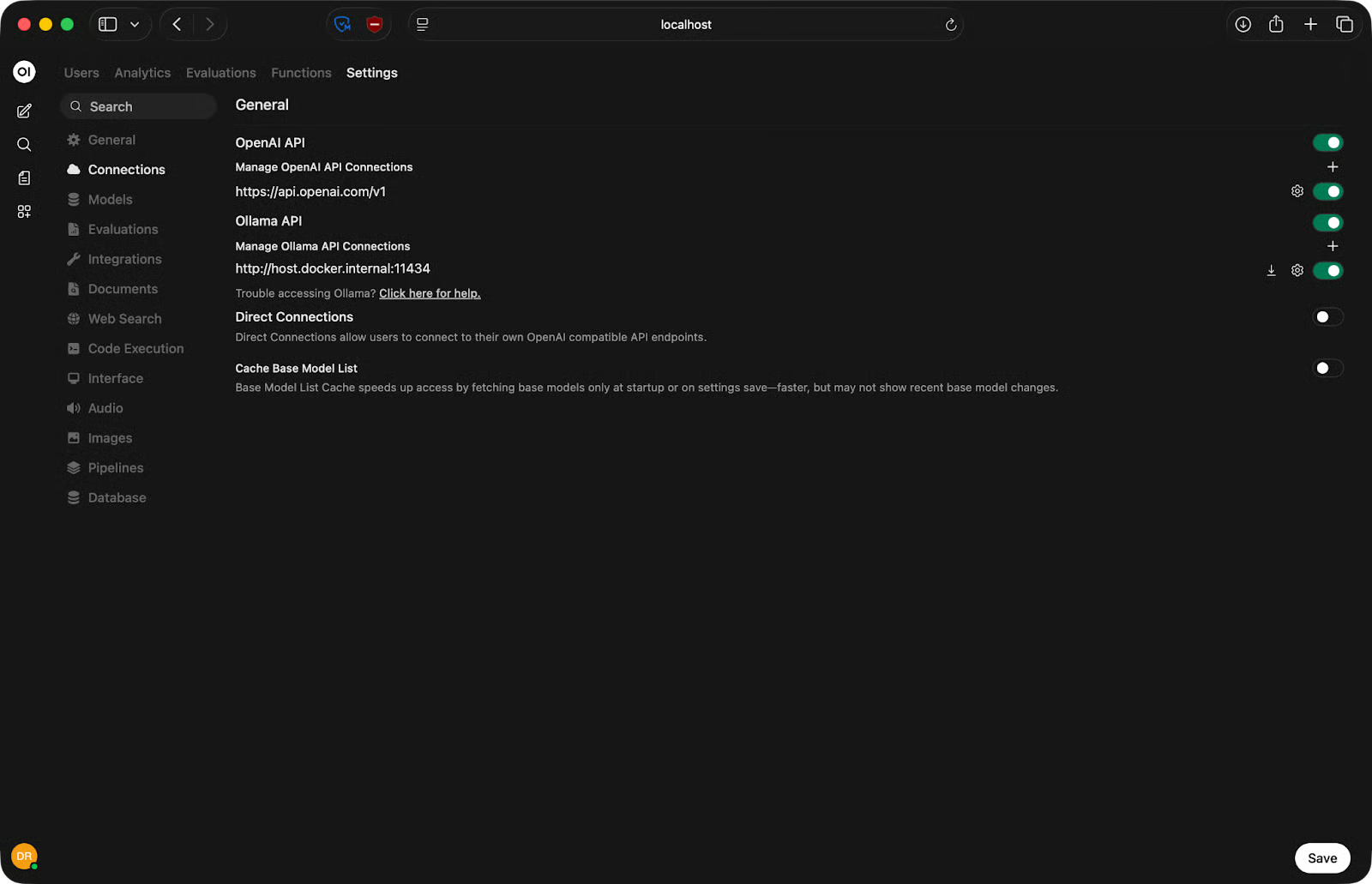

Conecta Open WebUI a Ollama

Ahora abre Open WebUI en el navegador en http://localhost:3000. Ve a Settings - Connections y comprueba la URL de la API de Ollama. De forma predeterminada es http://host.docker.internal:11434.

Configuración de la URL de la API de Ollama

Esto funciona en Mac y Windows con Docker Desktop. En Linux, sustituye host.docker.internal por la IP real de tu host:

http://<your-ip-address>:11434Haz clic en Save y actualiza la página. Si la conexión es correcta, tus modelos de Ollama aparecerán en el selector de modelos en la parte superior de la ventana de chat. Selecciona uno y ya podrás empezar a chatear.

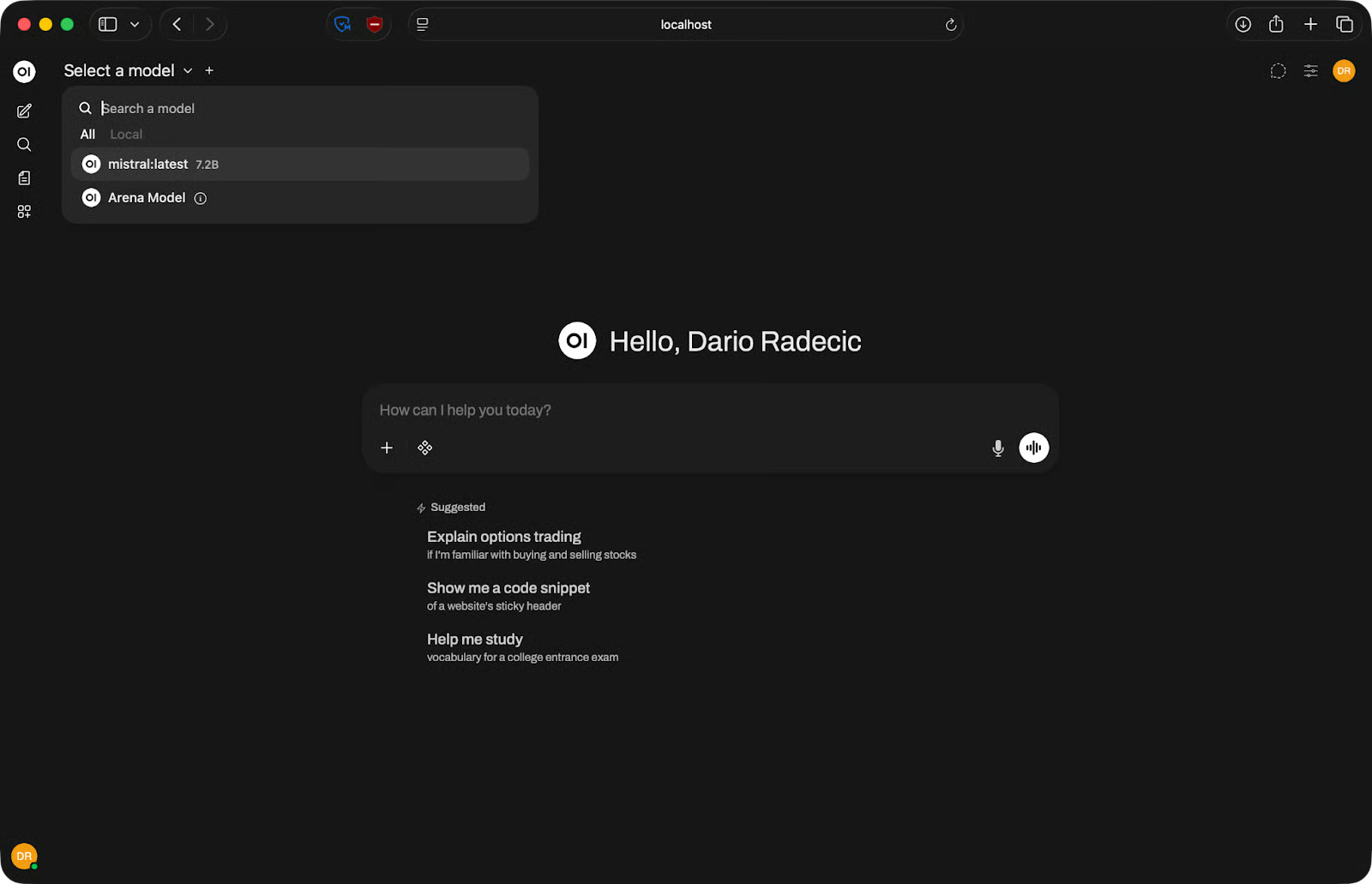

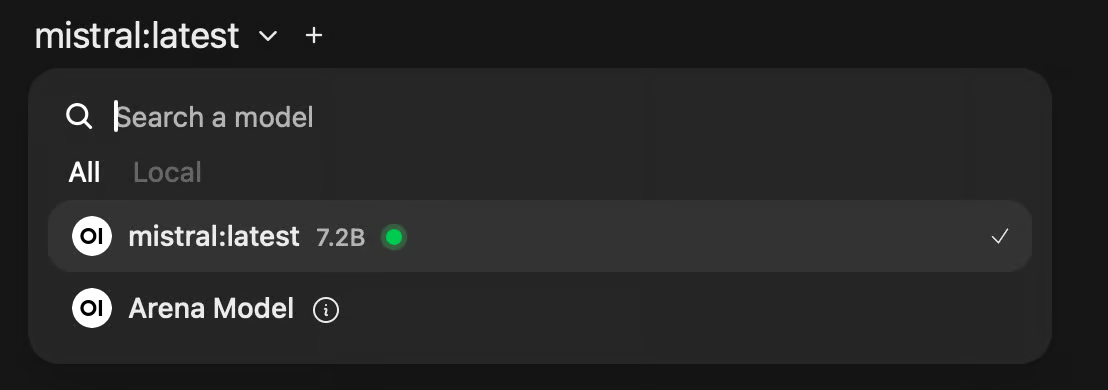

Modelos disponibles

Si no aparece ningún modelo, comprueba que Ollama está en ejecución y que la URL de la API es la correcta para tu sistema operativo.

Cómo usar Open WebUI para chat y programación

Una vez conectado el modelo, usar Open WebUI se siente muy parecido a ChatGPT, con algunos controles extra que conviene conocer.

Chat básico

En la parte superior de la ventana verás un desplegable para seleccionar el modelo. Haz clic y elige el que quieras usar. Si has conectado varios backends, aquí aparecerán todos los modelos disponibles: los de Ollama, los de API… todo en una sola lista.

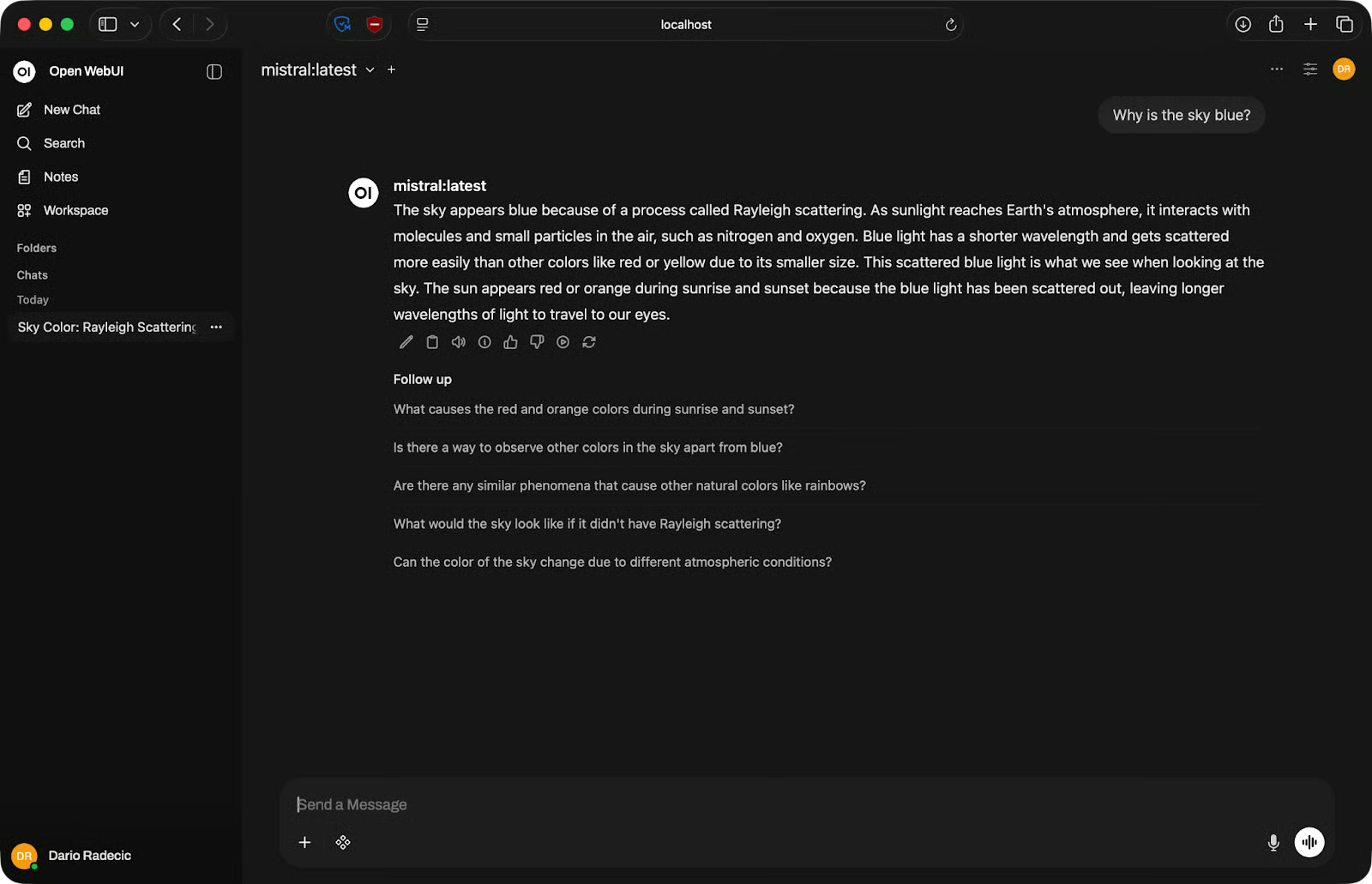

Escribe tu prompt en el campo inferior y pulsa Intro. Las respuestas se muestran en streaming, así que no tienes que esperar a que termine para empezar a leer.

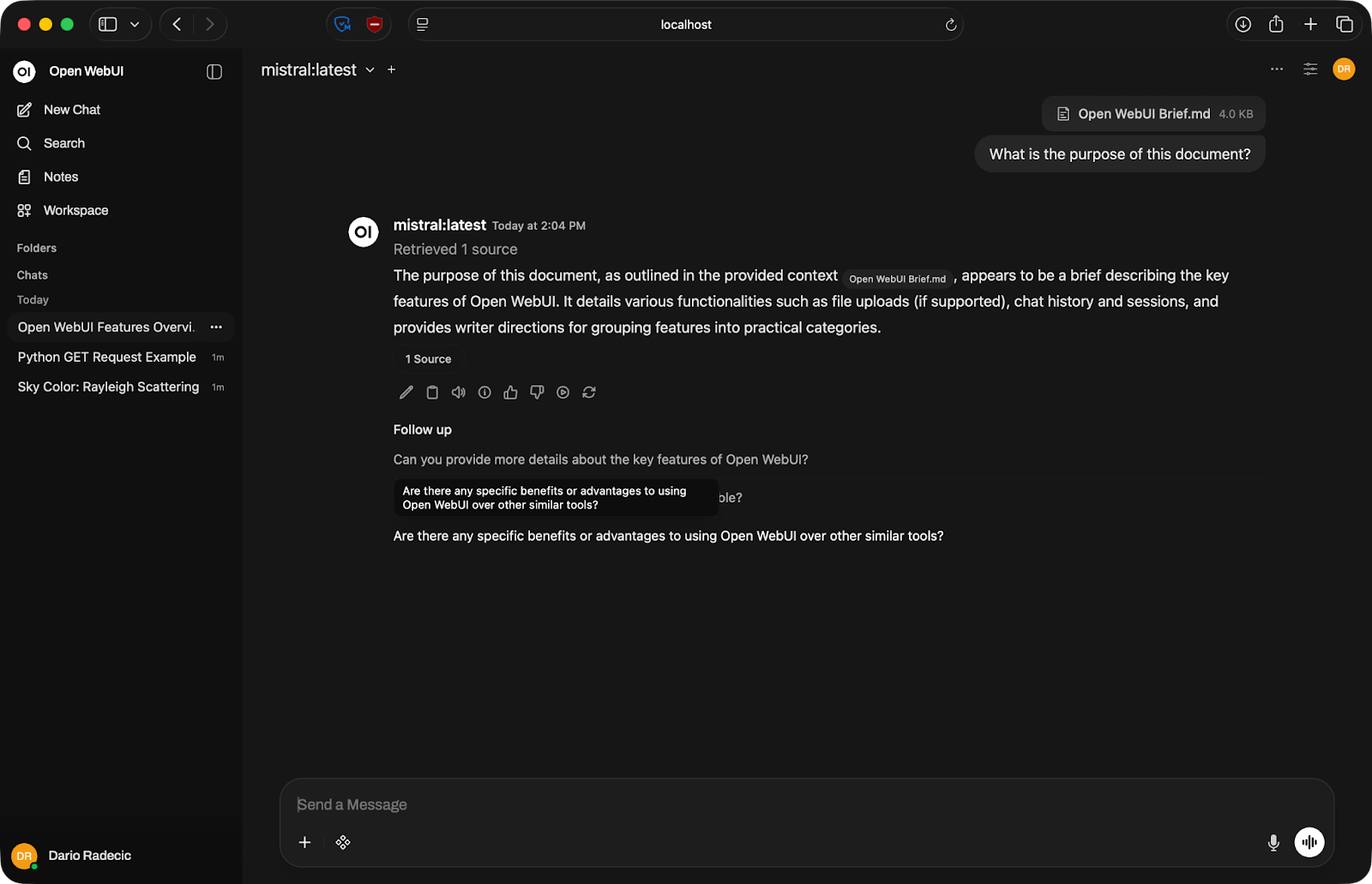

Ejemplo de chat básico

Cada conversación se guarda en la barra lateral izquierda. Puedes renombrarlas para mantener todo organizado o eliminar las que no necesites. Haz clic en cualquier conversación anterior para continuar donde lo dejaste.

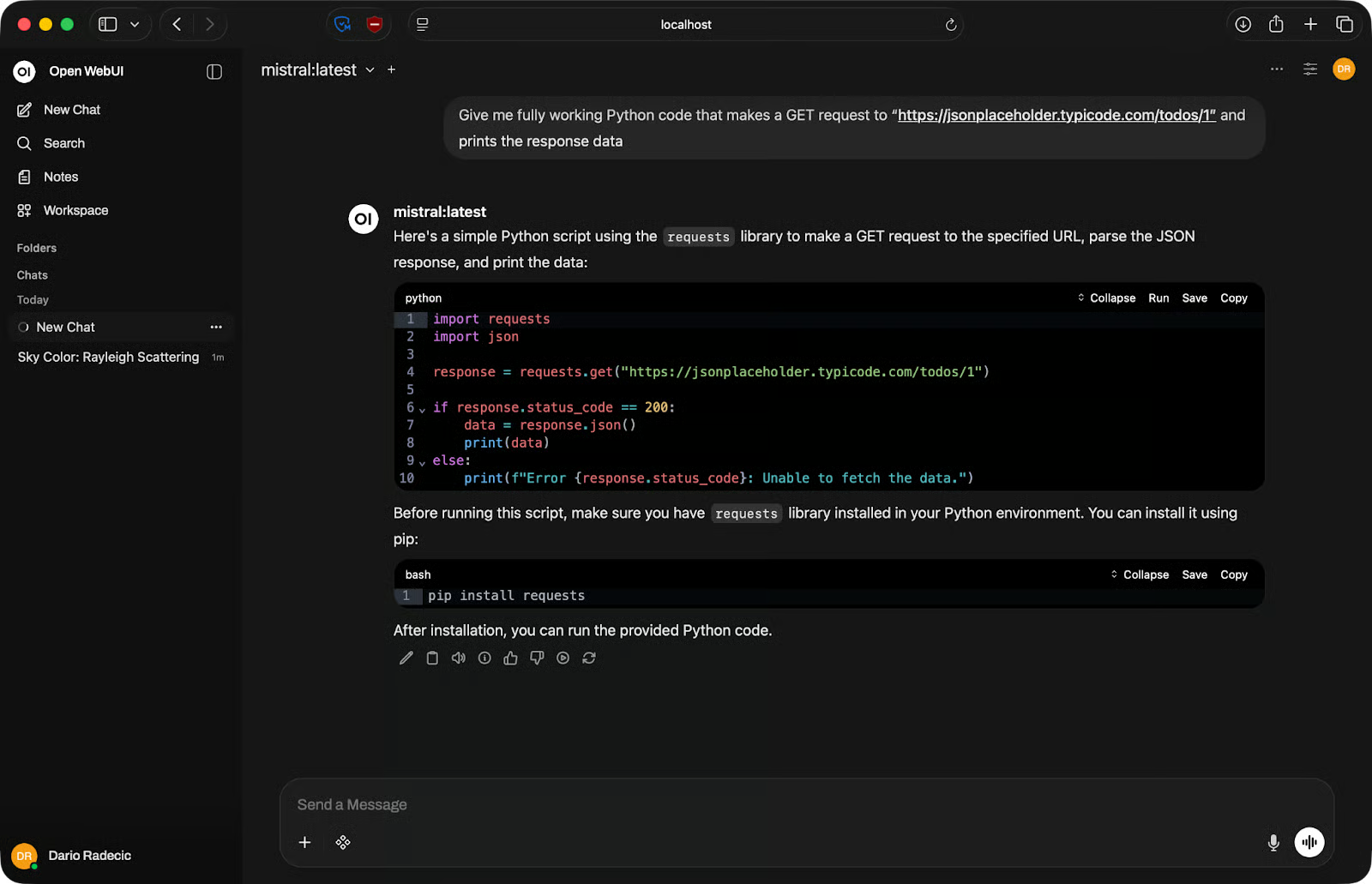

Tareas de programación

Open WebUI funciona muy bien para generar y depurar código. Describe lo que necesitas en lenguaje natural y el modelo te devolverá un bloque de código listo para copiar.

Ejemplo de programación

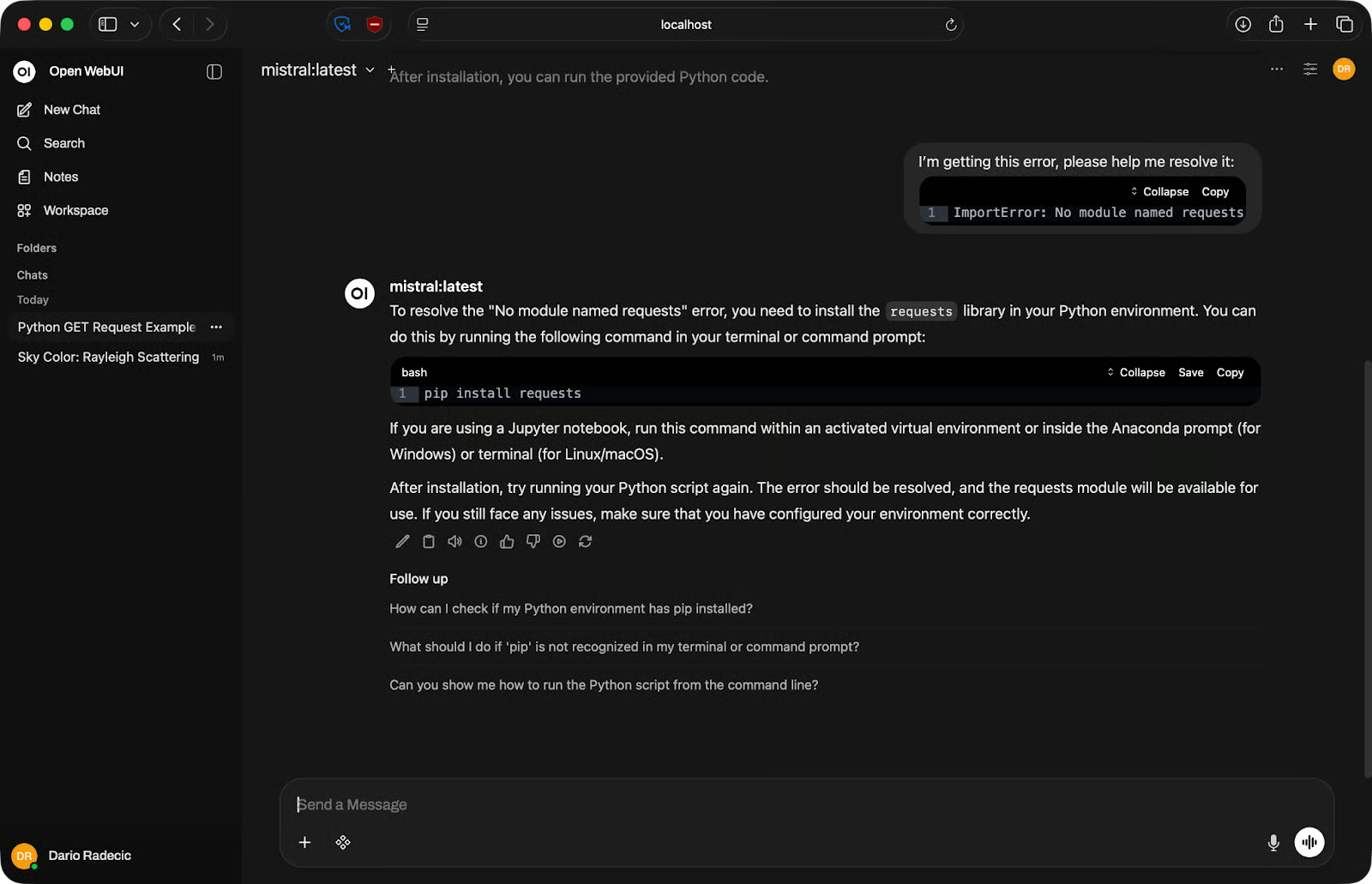

Para depurar, pega tu código y el mensaje de error en el prompt. Sé específico: incluye la traza completa, no solo el tipo de error. Cuanto más contexto des, más útil será la respuesta.

Ejemplo de depuración

Para tareas en varios pasos, no intentes meterlo todo en un único prompt. Divídelo. Pide al modelo que escriba una función, luego que añada manejo de errores y después que cree las pruebas. Los prompts cortos y enfocados funcionan mejor que uno largo que intente hacerlo todo a la vez.

Subida de archivos

Open WebUI permite subir archivos en el chat. Haz clic en el icono de suma en el área de entrada y adjunta un documento: PDF, archivo de texto o similar.

Una vez subido, el contenido del archivo pasa a formar parte del contexto de la conversación. Puedes pedir al modelo que lo resuma, que extraiga información concreta o que responda preguntas basadas en el documento.

Conversación con documento

Ten en cuenta que el modelo solo puede trabajar con lo que cabe en su ventana de contexto: la cantidad máxima de texto que puede procesar a la vez. Los archivos muy grandes pueden truncarse; si trabajas con documentos extensos, divídelos.

Funciones de Open WebUI que importan

Open WebUI tiene muchas opciones, así que repasemos las que realmente te interesan.

Soporte multmodelo

El selector de modelos en la parte superior te permite cambiar de modelo a mitad de sesión sin empezar una conversación nueva. Es útil para probar el mismo prompt en distintos modelos: pásalo por Llama, luego por Mistral y compara resultados al momento.

Selección de modelo

Si estás evaluando modelos para una tarea concreta, te ahorra mucho tiempo.

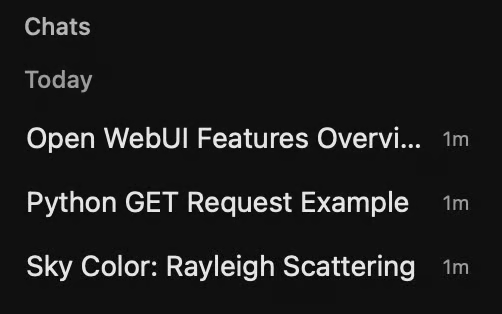

Historial y sesiones de chat

Cada conversación se guarda y aparece en la barra lateral izquierda. Puedes renombrar las sesiones con algo significativo, así evitas una lista interminable de "New Chat".

Sesiones de chat anteriores

Esto hace que Open WebUI sea útil para trabajo continuo. Puedes volver a una sesión de código, continuar un prompt a medias o reutilizar una conversación como referencia.

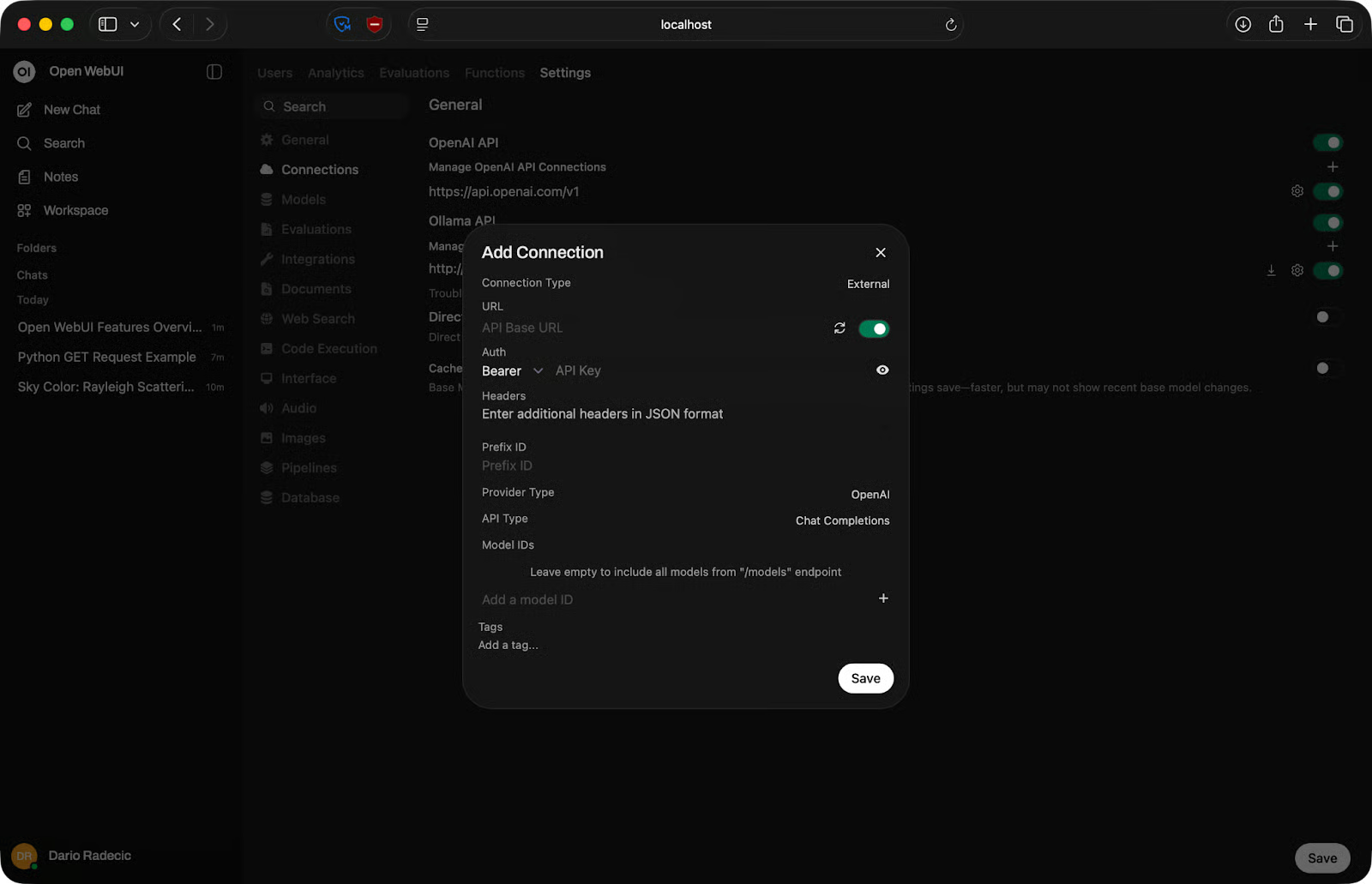

Modelos locales vs. de API

A Open WebUI le da igual qué haya detrás. Puedes conectar un modelo local de Ollama para trabajo privado y una API compatible con OpenAI para tareas en las que tengas un modelo cerrado que, de entrada, no cabría en tu memoria.

Gestión de conexiones con OpenAI

Usa un modelo local pequeño para tareas rápidas y uno grande vía API cuando el trabajo lo requiera (y lo permita).

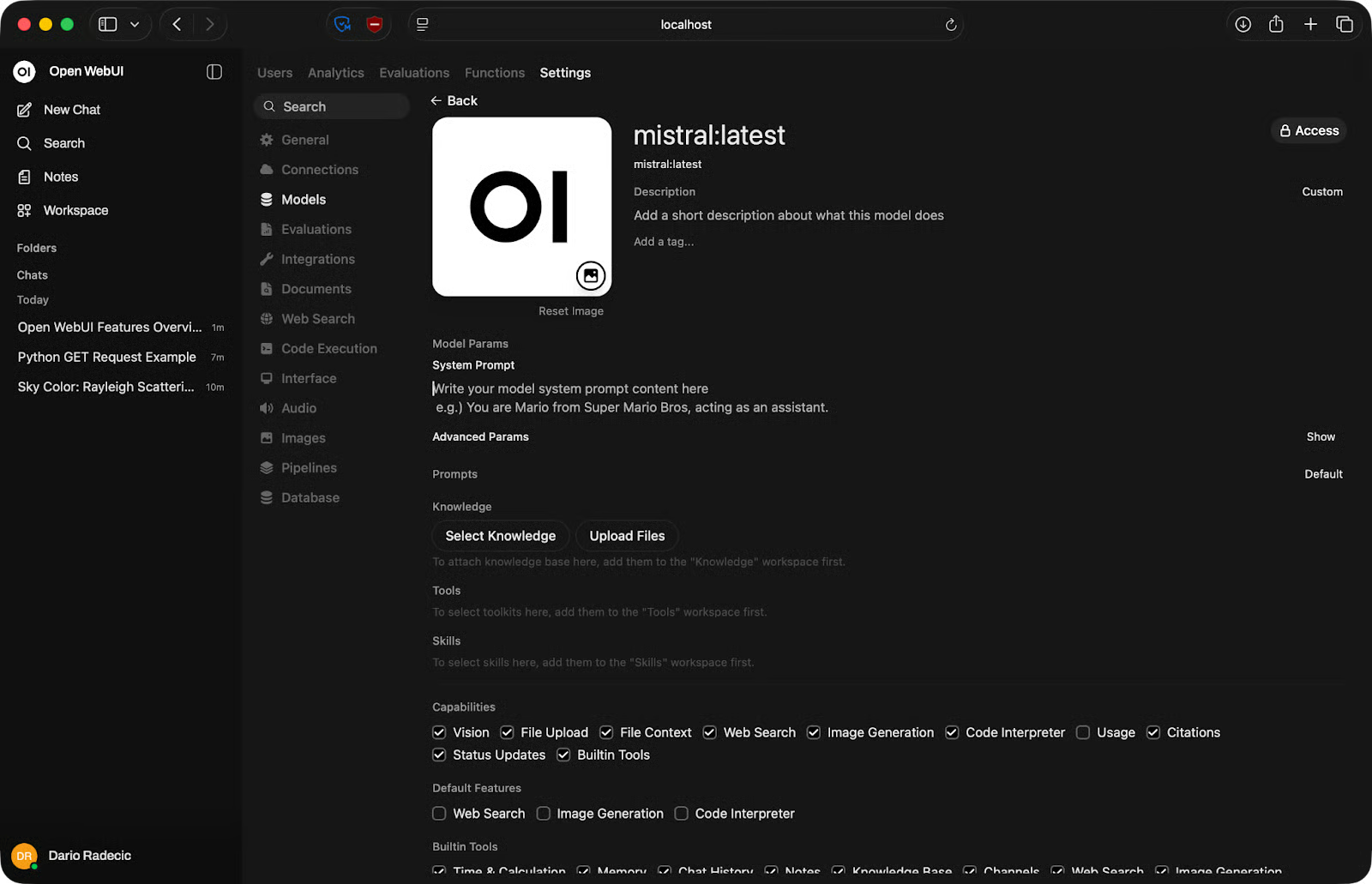

Ajustes personalizados del modelo

Puedes personalizar un montón de aspectos para cada LLM.

En los ajustes del modelo puedes retocar el prompt del sistema, añadir una base de conocimiento (documentos) y conectar el modelo a herramientas y habilidades. También puedes definir para qué capacidades se usará el modelo, como visión, subida de archivos, y si debe realizar tareas como búsqueda web:

Ajuste fino de la configuración del modelo

Open WebUI vs. ChatGPT y otras interfaces

Open WebUI no pretende sustituir a ChatGPT. Resuelve un problema distinto.

Open WebUI vs. ChatGPT

La diferencia clave es el destino de tus datos. Con ChatGPT, cada prompt va a los servidores de OpenAI. Con Open WebUI, todo se queda en tu equipo: la interfaz, el modelo y el historial de conversaciones.

El intercambio es el rendimiento. GPT-5 y modelos en la nube similares son más capaces que la mayoría de modelos que puedes ejecutar en local. Si tu prioridad es la calidad máxima de salida, gana la nube. Si te importa más la privacidad o el acceso sin conexión, gana lo local.

El coste también cuenta. ChatGPT Plus es una cuota mensual fija. Open WebUI es gratis, pero pagas con hardware: una máquina con suficiente RAM y, idealmente, una GPU.

Open WebUI vs. la CLI de Ollama

La CLI de Ollama va bien para pruebas rápidas, pero no está pensada para trabajo real. Escribes un prompt, recibes una respuesta y ya. No hay historial, ni subida de archivos, ni forma de comparar modelos sin cambiar de terminal.

Open WebUI le da a Ollama una interfaz en condiciones. Los modelos y el backend son los mismos, pero con gestión de conversaciones, controles de configuración y una UI que no desaparece al cerrar la terminal.

Si ya usas Ollama, añadir Open WebUI no cuesta nada y mejora mucho la experiencia.

Open WebUI vs. otras herramientas

LM Studio es una app de escritorio con un navegador de modelos integrado y una interfaz de chat similar. Es una buena opción si quieres una GUI autocontenida sin Docker. El inconveniente es que se ata a tu escritorio; Open WebUI corre en el navegador y puedes acceder desde otros dispositivos de tu red.

text-generation-webui es más para usuarios avanzados. Admite más formatos de modelos y controles más granulares, pero su instalación es más compleja y la interfaz es menos intuitiva. Open WebUI es un mejor punto de partida salvo que necesites algo específico de text-generation-webui.

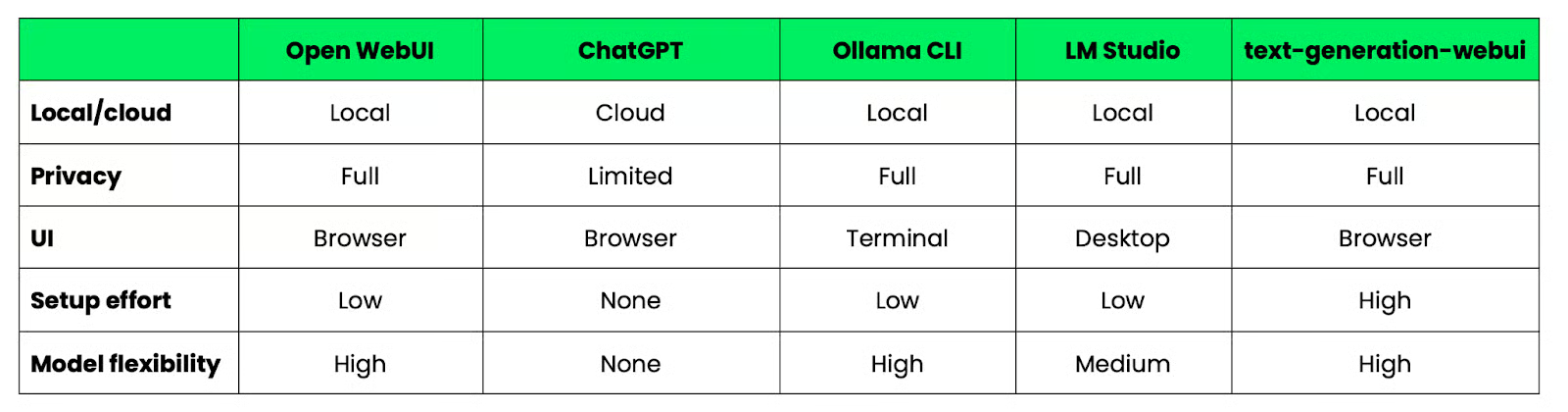

Tabla comparativa

Puedes consultar esta tabla para una comparación rápida entre Open WebUI y sus alternativas:

Open WebUI frente a alternativas

Problemas comunes y cómo resolverlos

La mayoría de los problemas con Open WebUI encajan en cinco categorías, y casi siempre tienen una solución rápida.

El contenedor no arranca

Ejecuta docker logs open-webui justo tras el arranque fallido. Los logs te dirán qué ha pasado. Nueve de cada diez veces es un conflicto de puertos o un problema de permisos en el volumen.

Conflictos de puertos

Si el puerto 3000 ya está en uso en tu máquina, el contenedor no arrancará. Soluciónalo mapeando a otro puerto del host:

docker run -d -p 3001:8080 ...Luego accede a Open WebUI en http://localhost:3001.

No se puede conectar con Ollama

Primero, confirma que Ollama está en ejecución:

ollama serveLuego verifica la URL de la API en Settings - Connections. En Mac y Windows debería ser http://host.docker.internal:11434. En Linux, usa la IP de tu máquina host. Una URL incorrecta aquí es la causa más común de fallo en la conexión.

No aparecen modelos

Si el selector de modelos está vacío, Open WebUI se conectó a Ollama pero no encontró modelos. Ejecuta ollama list para confirmar que tienes al menos uno descargado. Si está vacío, descarga uno:

ollama pull mistralActualiza la página de Open WebUI después de descargarlo: no se actualiza automáticamente.

Rendimiento lento

Las respuestas lentas casi siempre se deben al hardware, no a Open WebUI. El modelo es demasiado grande para tu RAM disponible o no tienes GPU. Cambia a un modelo más pequeño: los de 7B parámetros funcionan razonablemente bien en la mayoría de equipos modernos con 16 GB de RAM. Si solo usas CPU, espera respuestas más lentas independientemente del tamaño del modelo.

Buenas prácticas para usar Open WebUI

Unos cuantos hábitos marcan la diferencia en el día a día.

- Usa modelos pequeños para ganar velocidad: los modelos grandes no siempre son mejores. Uno de 7B responde en segundos y resuelve bien la mayoría de tareas cotidianas. Reserva los más grandes para lo que realmente lo necesite, como razonamiento complejo o generación larga

- Controla la longitud de la conversación: cada mensaje suma al contexto que el modelo debe procesar. Las conversaciones largas se vuelven más lentas y costosas. Si la charla se ha desviado de su objetivo, empieza una nueva en lugar de arrastrar el contexto

- Organiza tus prompts: si repites prompts con frecuencia, guárdalos. Open WebUI permite almacenar presets de prompts para no reescribir lo mismo cada sesión. Un poco de trabajo previo ahorra mucho tiempo

- Vigila los recursos del sistema: los modelos locales usan tu hardware. Si tu equipo sufre, abre el monitor del sistema y revisa RAM y CPU. Ejecutar otros procesos pesados junto a un modelo grande alargará las respuestas. Cierra lo que no necesites

- Combina Open WebUI con tus herramientas: la interfaz es solo el front-end. Puedes canalizar salidas a scripts, subir archivos desde tu editor o usar Open WebUI junto a la terminal para tareas de código.

Cuándo usar Open WebUI

Open WebUI encaja muy bien en casos concretos, no en todos. Aquí tienes cuándo usarlo:

- Desarrollo local es el caso más habitual. Si construyes una app sobre un LLM y quieres probar prompts sin gastar créditos de API, Open WebUI te da un ciclo de feedback rápido

- Experimentación con modelos es donde Open WebUI brilla. Puedes descargar varios modelos con Ollama y comparar cómo responden al mismo prompt desde una única interfaz, sin escribir una sola línea de código

- Flujos sensibles a la privacidad también son un ajuste perfecto. Si trabajas con documentos internos, datos de clientes o información que no quieres enviar a terceros, una configuración local mantiene todo en tu máquina. No sale ningún dato salvo que tú conectes una API externa

- Aprendizaje y prototipado es otro gran escenario. Si estás empezando con LLM y quieres entender su comportamiento sin pagar un plan, Open WebUI te da una vía económica para experimentar. También es útil para prototipos rápidos: un modelo local es suficiente para validar ideas antes de invertir en producción.

Dicho esto, Open WebUI no es la herramienta adecuada si necesitas la mejor salida posible y la privacidad no es un problema. En ese caso, te irá mejor con una API en la nube.

Conclusión

Open WebUI te ofrece una interfaz limpia y práctica para trabajar con modelos locales, y tú controlas completamente el entorno.

No salen datos de tu equipo, no hay límites de uso ni suscripciones obligatorias. Tú eliges los modelos, gestionas la configuración y amplías el sistema como necesites.

Lo mejor es empezar simple. Arranca el contenedor de Docker, conecta un modelo pequeño como Llama o Mistral y lanza unos prompts. Cuando eso funcione, añade más modelos, configura prompts de sistema, conecta APIs externas y ve construyendo desde ahí.

Por si te lo preguntas, también puedes ejecutar Ollama con Docker sin instalación local. Consulta nuestra guía reciente para ver cómo hacerlo.

FAQs

¿Qué es Open WebUI?

Open WebUI es una interfaz autohospedada y basada en navegador para interactuar con modelos de lenguaje grandes. Funciona como ChatGPT, pero se ejecuta íntegramente en tu propia máquina. Lo conectas a un backend de modelo —como Ollama o una API compatible con OpenAI— y todos tus datos permanecen en local.

¿Necesito un equipo potente para ejecutar Open WebUI?

Open WebUI en sí es ligero: lo que requiere recursos es el modelo que corre detrás. Para la mayoría de modelos locales, 16 GB de RAM es una base razonable. Una GPU ayuda a acelerar las respuestas, pero muchos modelos pequeños funcionan aceptablemente solo con CPU.

¿Open WebUI es gratis?

Sí, Open WebUI es de código abierto y gratuito. No pagas por la interfaz en sí. Los únicos costes son tu propio hardware y, opcionalmente, el uso de APIs externas si decides conectar un proveedor de pago como OpenAI.

¿Cuál es la diferencia entre Open WebUI y Ollama?

Ollama es el backend que descarga y ejecuta modelos locales en tu máquina. Open WebUI es el frontend: la interfaz con la que envías prompts y lees respuestas. Ollama gestiona el modelo; Open WebUI, la experiencia de chat. Puedes usar Ollama sin Open WebUI vía su CLI, pero la experiencia es mucho más limitada.

¿Puedo conectar Open WebUI a la API de OpenAI en lugar de a un modelo local?

Sí. Open WebUI admite cualquier endpoint de API compatible con OpenAI. Ve a Settings - Connections, añade tu clave de API y la URL del endpoint, y tus modelos en la nube aparecerán en el selector junto a los locales. Así puedes cambiar entre modelos locales y en la nube desde la misma interfaz.