Program

İstemlerinizi bir bulut sunucusuna göndermek konusunda kararsız mısınız? Güvenlik pek çok kişi için önemli bir endişe ve haklı gerekçeleri var.

ChatGPT veya Claude'u seçer, bir istem yazarsınız ve istek başkasının altyapısına gider. Çoğu kullanım senaryosu için bu sorun olmaz. Ancak hassas veriler veya mülkiyet kodu üzerinde çalışıyorsanız, bu bir güvenlik riski olabilir. Ayrıca, bulut arayüzleri sizi belirli modellere, oran sınırlamalarına ve fiyatlandırma planlarına kilitler.

Open WebUI, LLM'lerle etkileşim kurmak için kendi barındırabileceğiniz, tarayıcı tabanlı bir arayüzdür. ChatGPT'nin arayüzüne benzer, ancak kendi makinenizde çalışır. Ollama'ya, OpenAI uyumlu API'lere ve yerel modellere bağlanır; böylece verileriniz sizin belirlediğiniz yerde kalır.

Bu yazıda, Docker ile Open WebUI'yi kurmayı, yerel bir modele bağlamayı ve sohbet ile kod üretimi gibi gerçek görevler için kullanmayı adım adım göstereceğim.

Open WebUI Nedir ve Nasıl Çalışır

Open WebUI, LLM'lerle etkileşim kurmak için tarayıcı tabanlı bir sohbet arayüzüdür - ChatGPT'ye benzer, ancak kendi makinenizde çalışır.

Mimarisi son derece basittir. Tarayıcıda eriştiğiniz bir ön yüz ve Ollama veya herhangi bir OpenAI uyumlu API gibi model sağlayıcılara bağlanan bir arka uç vardır.

Dolayısıyla Open WebUI modelleri çalıştırmaz - yalnızca işaret ettiğiniz arka uçla konuşur.

Bunu yerel yapay zekâ kurulumunuz için evrensel bir ön kapı olarak düşünün.

Bu, model arka ucunu arayüzde hiçbir değişiklik yapmadan değiştirebileceğiniz ve arayüzü bir makinede, modeli başka bir makinede çalıştırabileceğiniz anlamına gelir.

Open WebUI ile şunlara sahip olursunuz:

- İstem göndermek ve yanıtları okumak için bir sohbet arayüzü

- Sohbetlerinize belgeleri dahil etmek için dosya yükleme

- Aynı arayüzde modeller arasında geçiş yapmaya yönelik çoklu model desteği

- Geçmiş konuşmalarınıza geri dönmenizi ve devam etmenizi sağlayan sohbet geçmişi

ChatGPT veya Claude kullandıysanız arayüz tanıdık gelecektir. Fark, arkasında neyin çalıştığıdır. Şimdi ona geçelim.

Open WebUI Nasıl Kurulur (Docker Yöntemi)

Docker, Open WebUI'yi çalıştırmanın en hızlı yoludur ve ayrıca onu tamamen yalıtılmış bir şekilde çalıştırır.

Önkoşullar

Makinenizde Docker kurulu olmalı. Henüz yoksa resmî Docker web sitesinden edinebilirsiniz.

Ollama bu aşamada isteğe bağlıdır. Open WebUI'yi hemen bir yerel modele bağlamak istiyorsanız önce Ollama'yı kurun ve en az bir model çekin. Sadece arayüzü çalıştırmak ve bağlantıyı daha sonra yapmak istiyorsanız şimdilik bunu atlayın.

Kurulum adımları

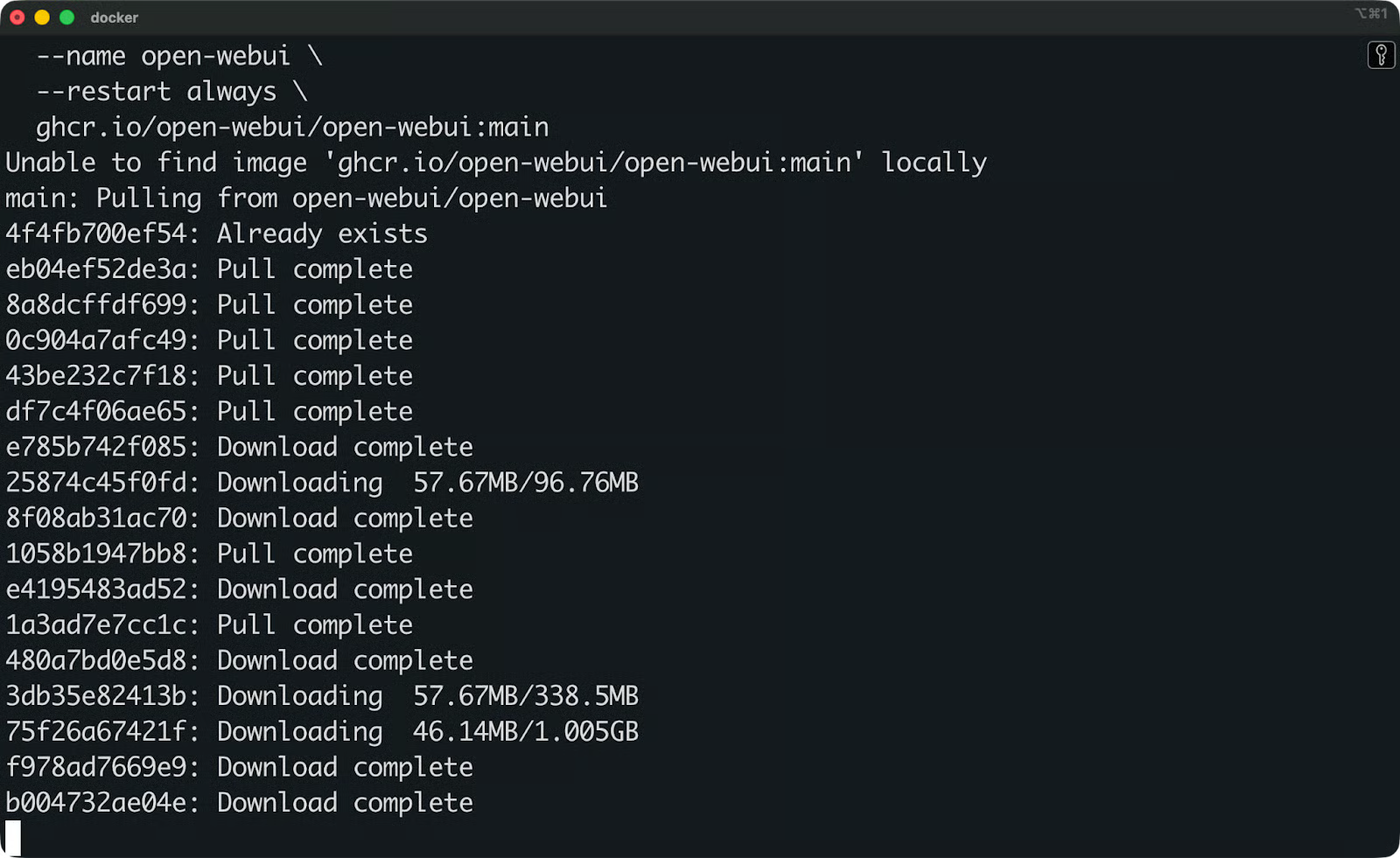

Open WebUI imajını çekmek ve konteyneri başlatmak için bu komutu çalıştırın:

docker run -d \

-p 3000:8080 \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:main

Open WebUI imajı indiriliyor

Her bayrağın ne yaptığı şöyle:

-

dkonteyneri arka planda çalıştırır -

p 3000:8080konteyner içindeki 8080 portunu makinenizdeki 3000 portuna eşler -

v open-webui:/app/backend/dataverilerinizi kalıcı kılmak için bir Docker birimi oluşturur - konuşmalar, ayarlar ve yüklenen dosyalar konteyner yeniden başlatmalarından sonra da kalır -

-restart alwayskonteyner durursa veya makineniz yeniden başlarsa konteyneri yeniden başlatır -

-name open-webuikonteynere daha sonra referans verebilmeniz için okunabilir bir ad verir

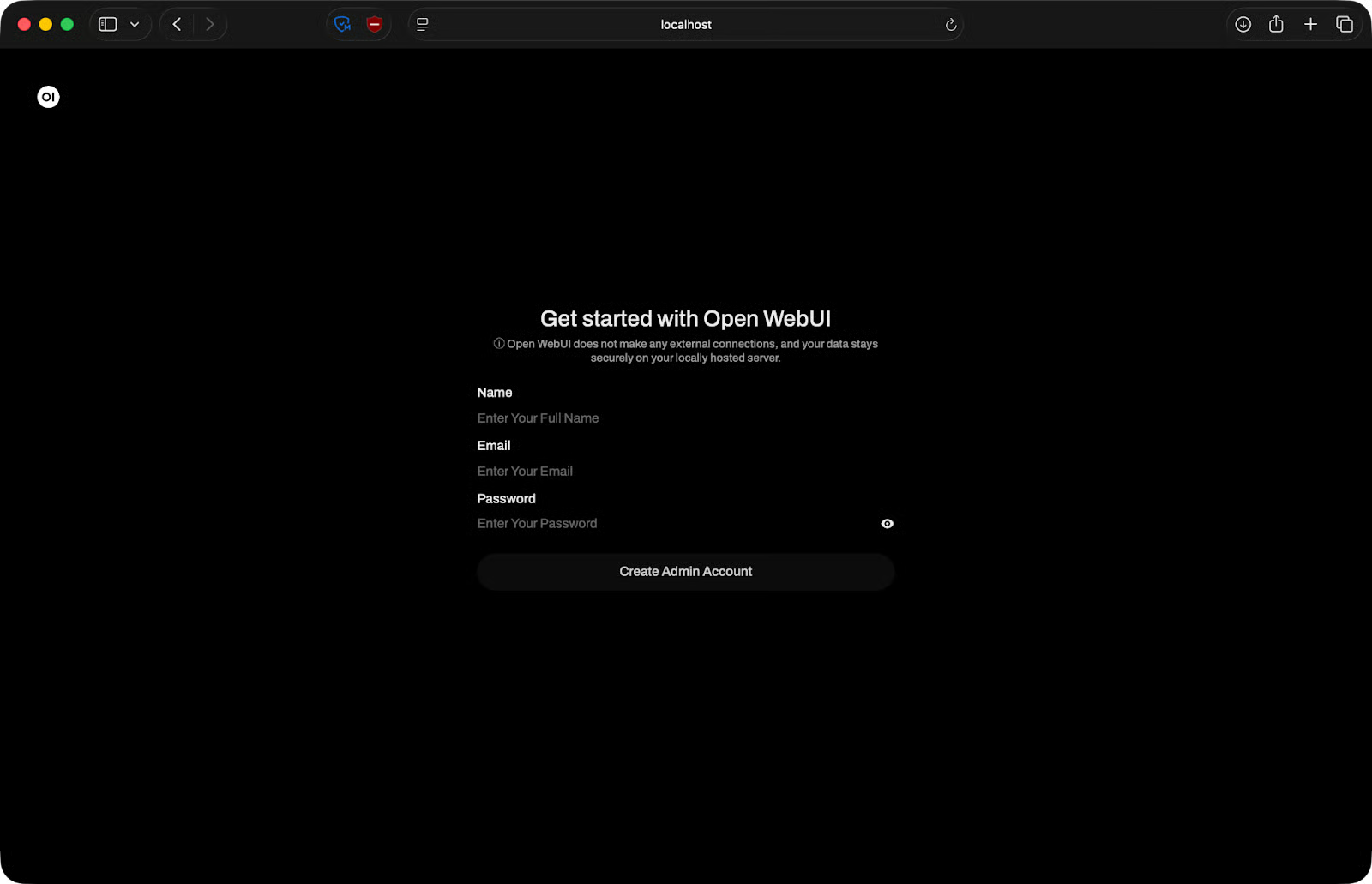

İlk açılış

Konteyner başladıktan sonra tarayıcınızı açın ve http://localhost:3000 adresine gidin.

İlk ziyaretinizde Open WebUI sizden bir yönetici hesabı oluşturmanızı isteyecek. Adınızı, e-postanızı ve parolanızı girin.

Open WebUI kurulum sayfası

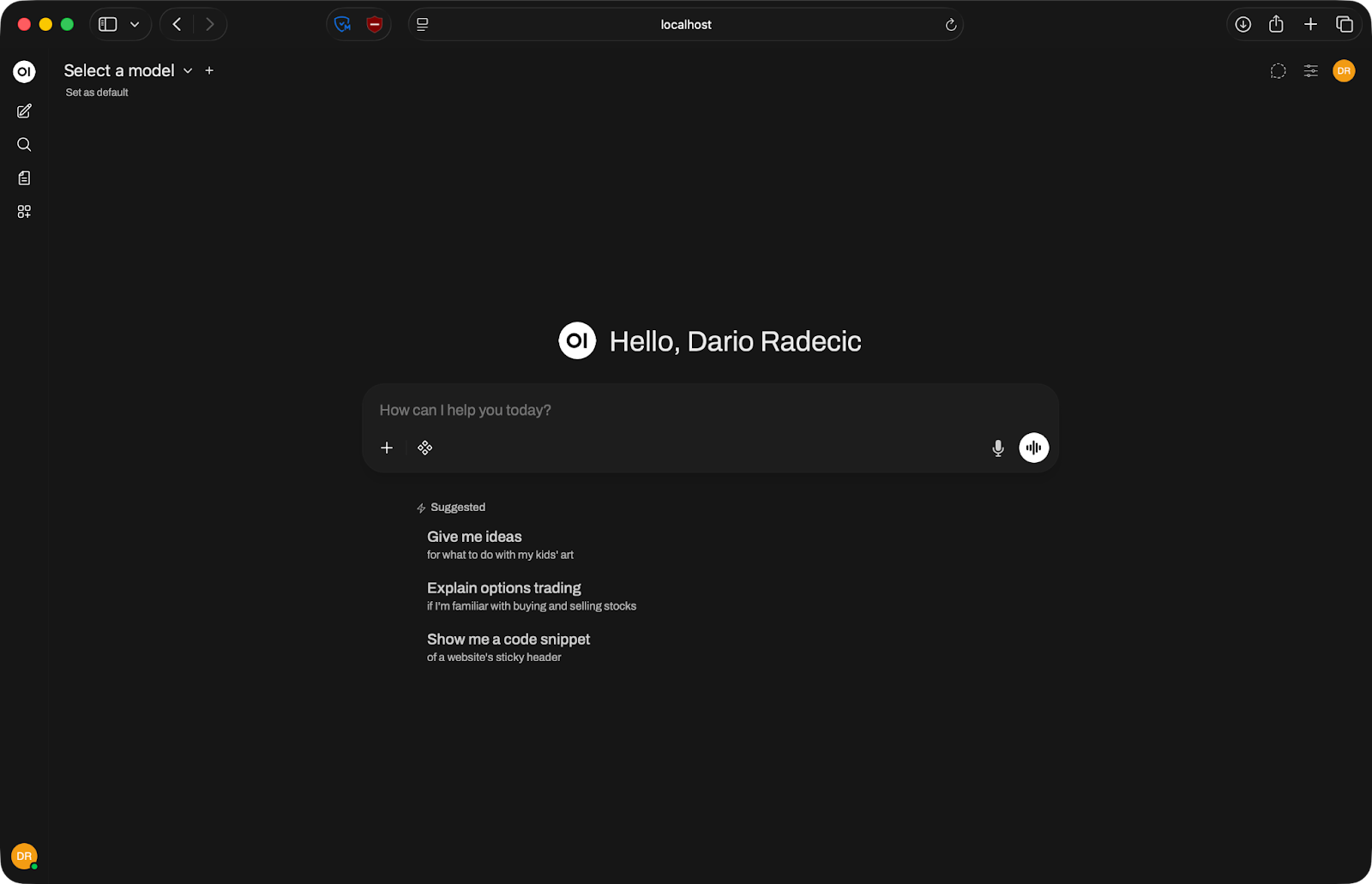

Bundan sonra hazırsınız. Arayüz yüklenir ve bir modele bağlanmaya hazır olursunuz.

Open WebUI ana sayfası

Open WebUI Ollama'ya Nasıl Bağlanır

Ollama, Open WebUI için en yaygın arka uçtur; çünkü yerel modelleri çalıştırmayı son derece basit hale getirir - bir komutla model çekilir, bir komutla çalıştırılır.

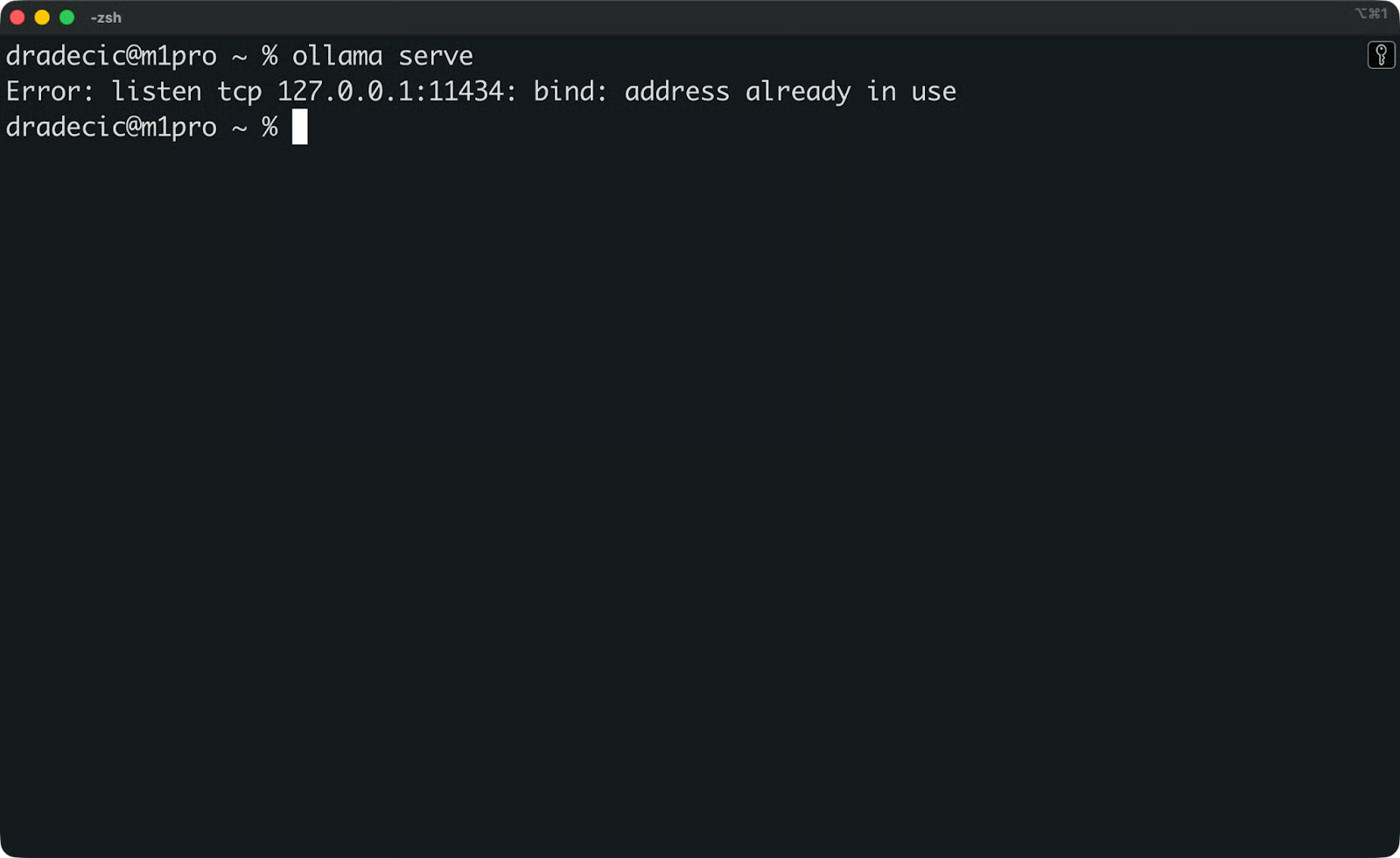

Bağlantı kurmadan önce Ollama'nın gerçekten çalıştığından emin olun. Bir terminal açın ve kontrol edin:

ollama serve

Ollama'nın çalıştığının kontrolü

Ollama zaten arka plan hizmeti olarak çalışıyorsa, adresin kullanımda olduğunu belirten bir mesaj görürsünüz. Bu iyi - çalıştığı anlamına gelir.

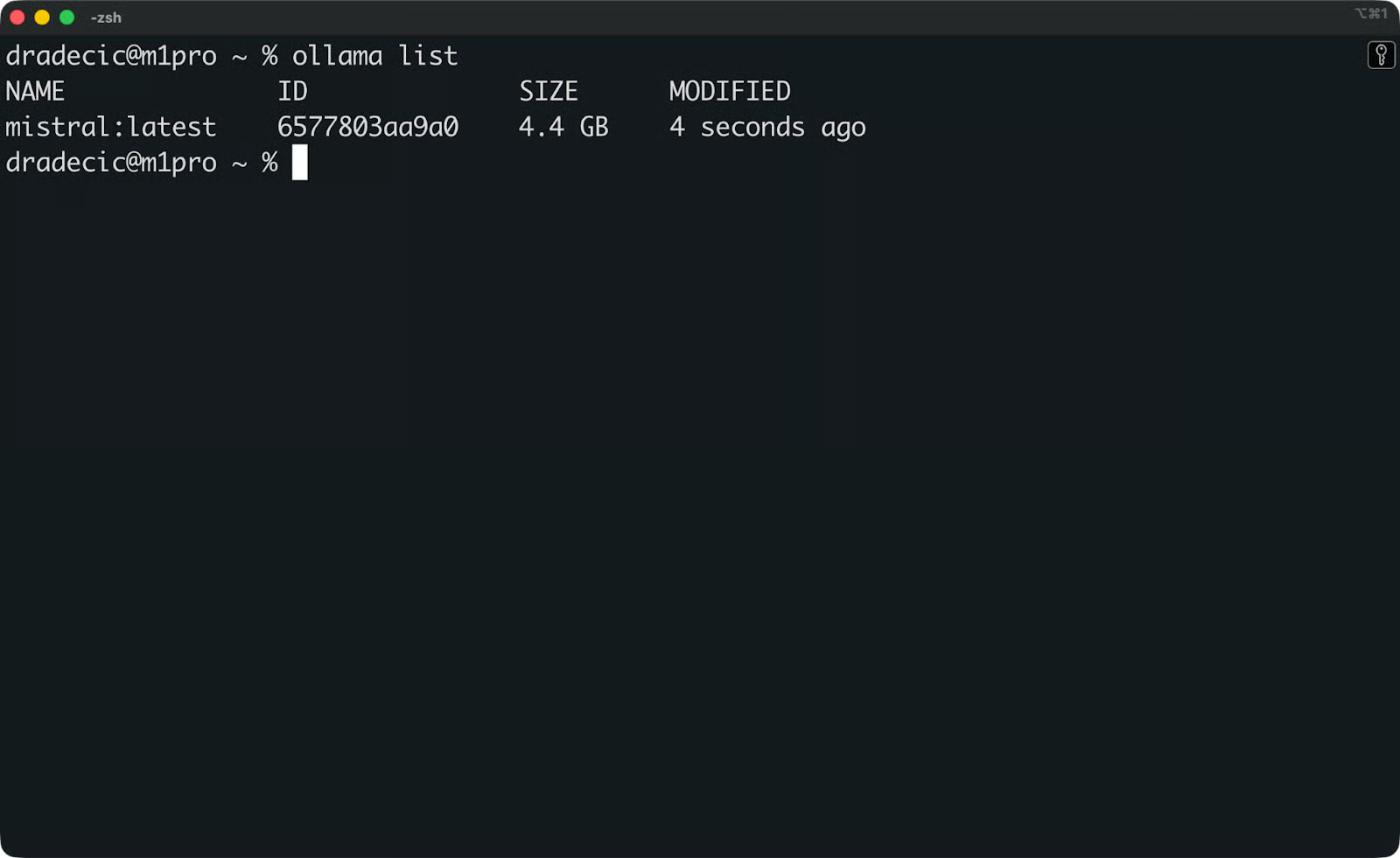

Sonra, en az bir model çekmiş olduğunuzu doğrulayın. Şunu çalıştırın:

ollama list

Mevcut Ollama modelleri

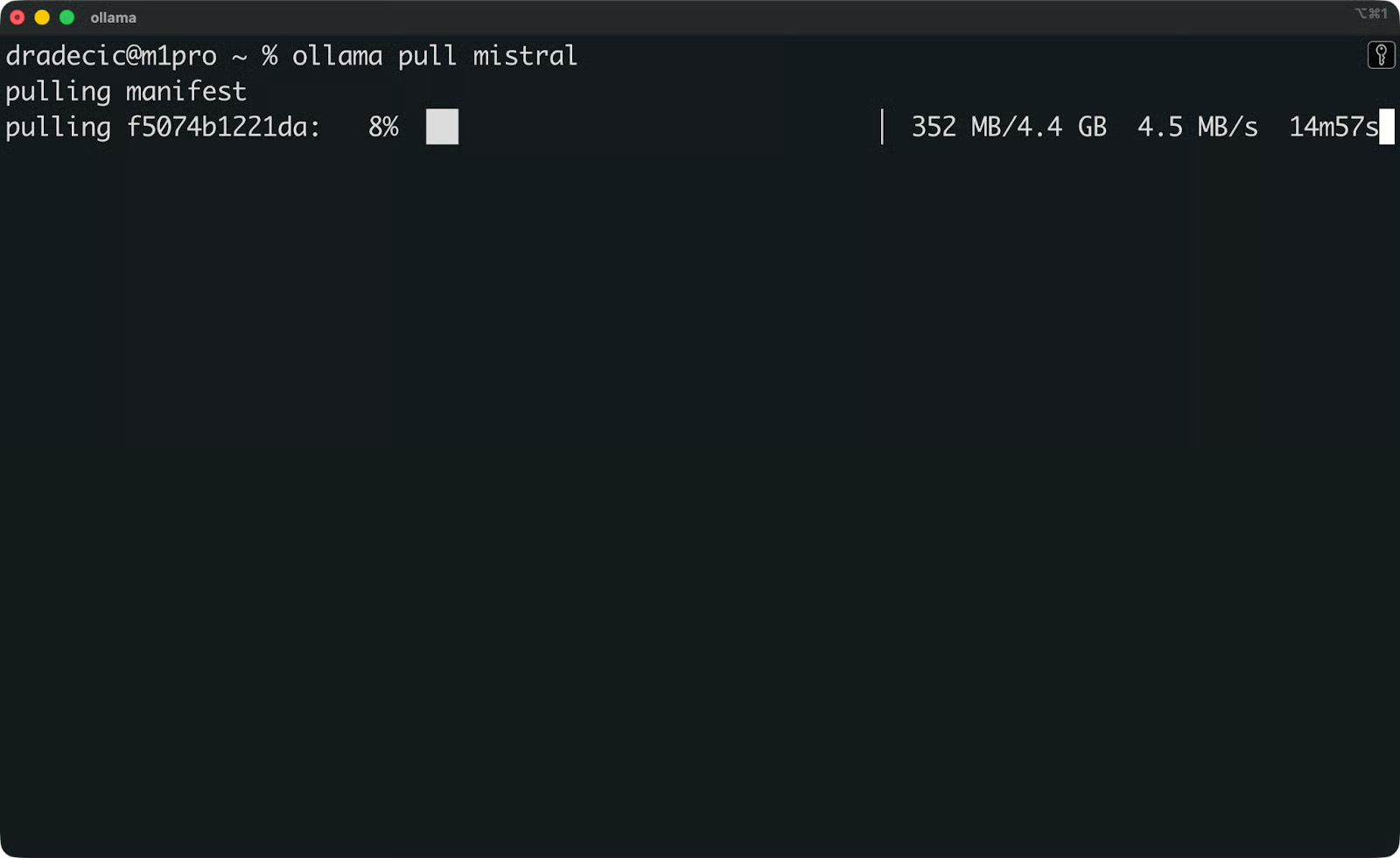

Liste boşsa önce bir model çekin. Mistral iyi bir başlangıç noktasıdır:

ollama pull mistral

Mistral modelinin çekilmesi

Mistral, tüketici donanımında iyi çalışan, sağlam bir genel amaçlı modeldir.

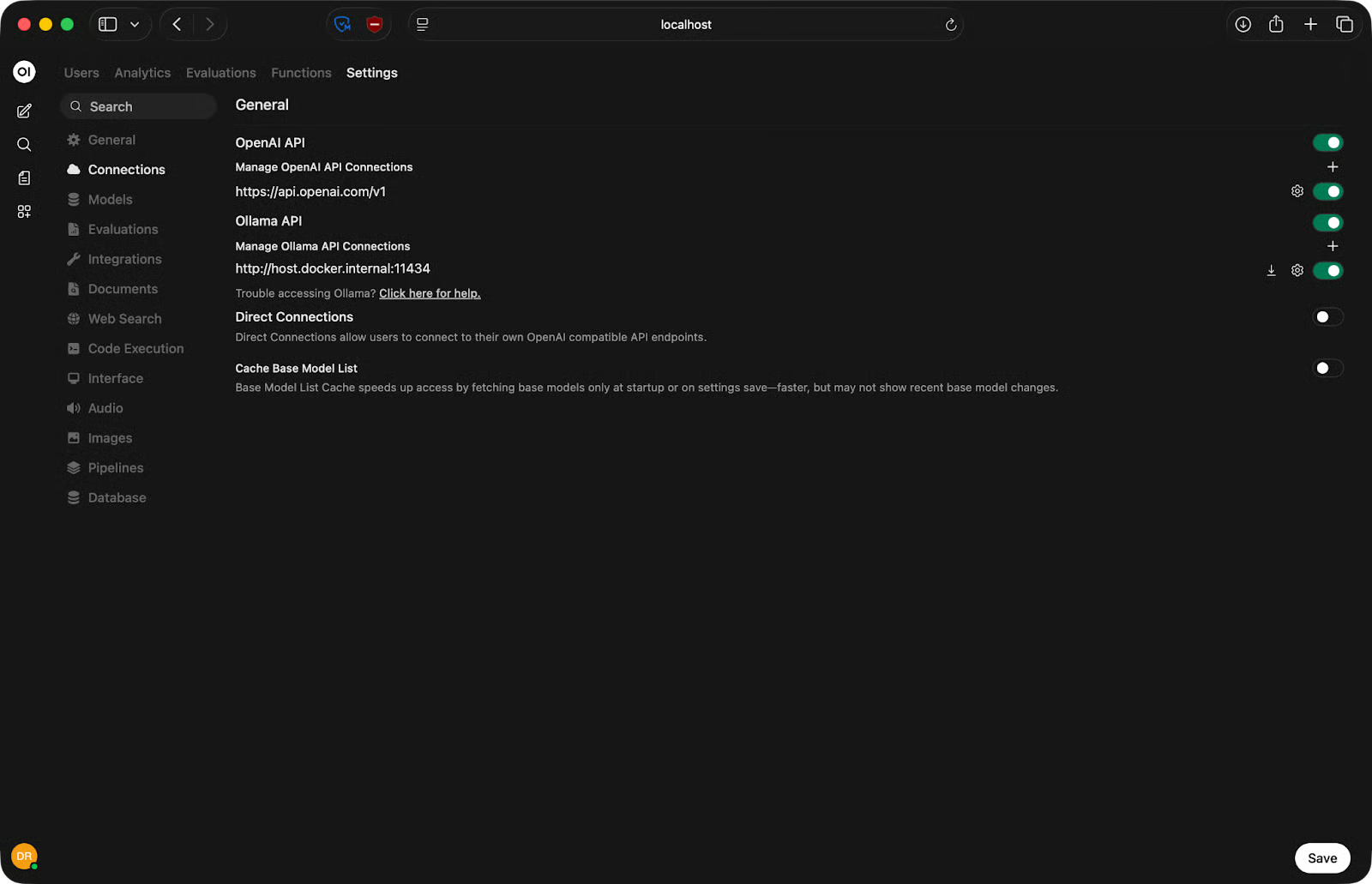

Open WebUI'yi Ollama'ya bağlayın

Şimdi tarayıcınızda http://localhost:3000 adresinde Open WebUI'yi açın. Settings - Connections bölümüne gidin ve Ollama API URL'sini kontrol edin. Varsayılan olarak http://host.docker.internal:11434 olarak ayarlanmıştır.

Ollama API URL'sinin ayarlanması

Bu, Docker Desktop ile Mac ve Windows'ta çalışır. Linux'ta host.docker.internal yerine gerçek ana makine IP'nizi yazın:

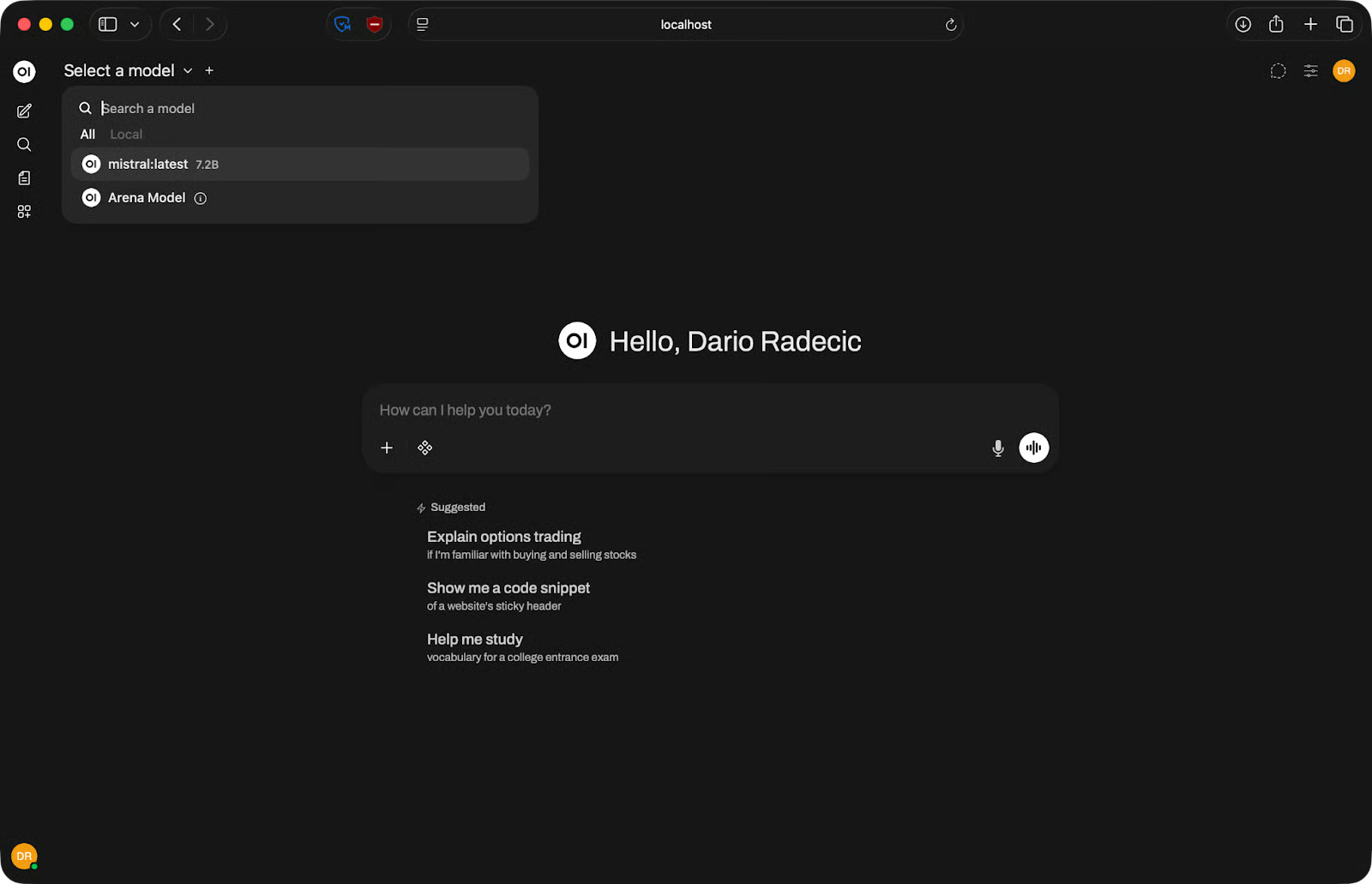

http://<your-ip-address>:11434Save'e tıklayın ve sayfayı yenileyin. Bağlantı başarılıysa Ollama modelleriniz sohbet penceresinin üst kısmındaki model seçicide görünecek. Birini seçin ve sohbete başlamaya hazırsınız.

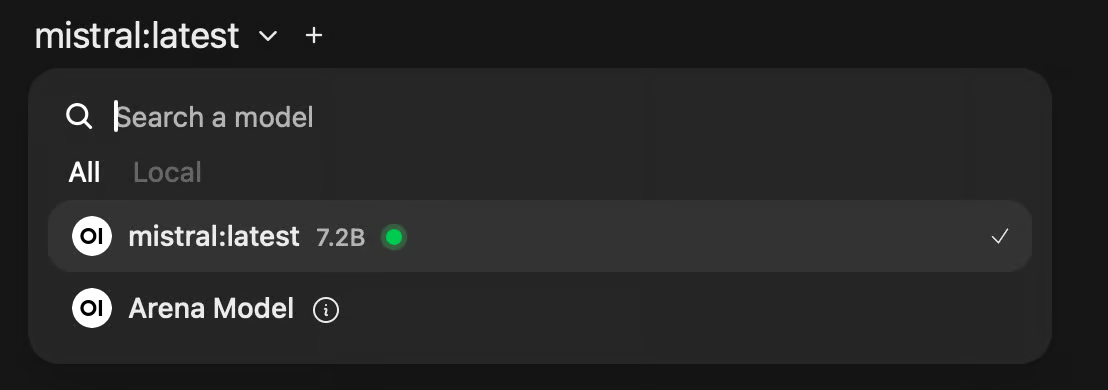

Kullanılabilir modeller

Hiç model görünmüyorsa Ollama'nın çalıştığını ve API URL'sinin işletim sisteminiz için doğru olduğunu tekrar kontrol edin.

Open WebUI Sohbet ve Kodlama İçin Nasıl Kullanılır

Modeliniz bağlandıktan sonra Open WebUI'yi kullanmak, birkaç ek kontrole rağmen büyük ölçüde ChatGPT'ye benzer hissettirir.

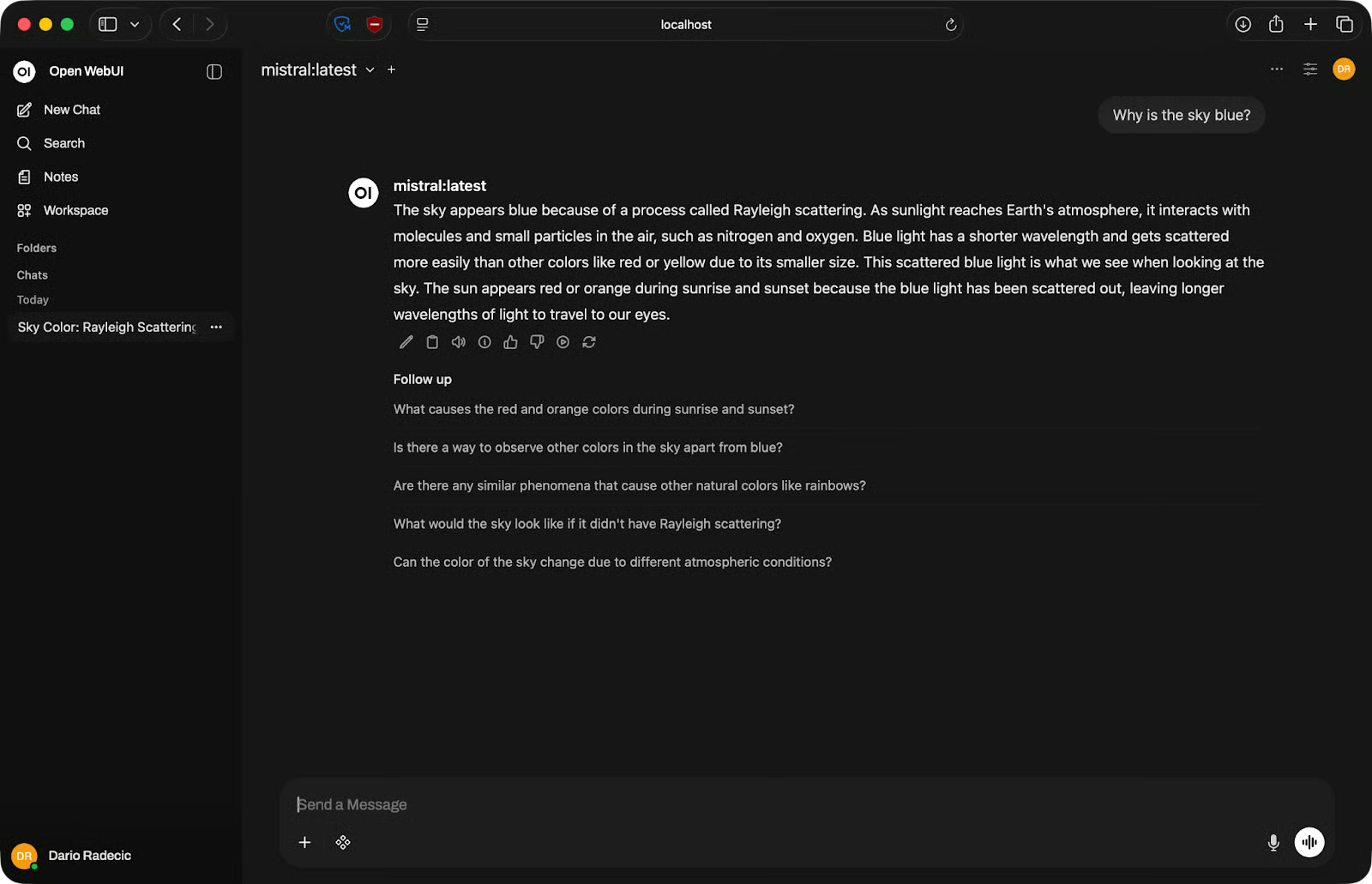

Temel sohbet

Sohbet penceresinin üst kısmında bir model seçici açılır menüsü görürsünüz. Tıklayın ve kullanmak istediğiniz modeli seçin. Birden fazla arka ucu bağladıysanız tüm kullanılabilir modeller burada görünür - Ollama modelleri, API modelleri, hepsi tek listede.

İsteminizi alttaki giriş alanına yazın ve Enter'a basın. Yanıtlar gerçek zamanlı olarak akar; böylece tamamını beklemeden okumaya başlayabilirsiniz.

Temel sohbet örneği

Her konuşma sol kenar çubuğuna kaydedilir. Düzenli tutmak için konuşmaları yeniden adlandırabilir veya gerekmeyenleri silebilirsiniz. Kaldığınız yerden devam etmek için geçmişteki herhangi bir konuşmaya tıklayın.

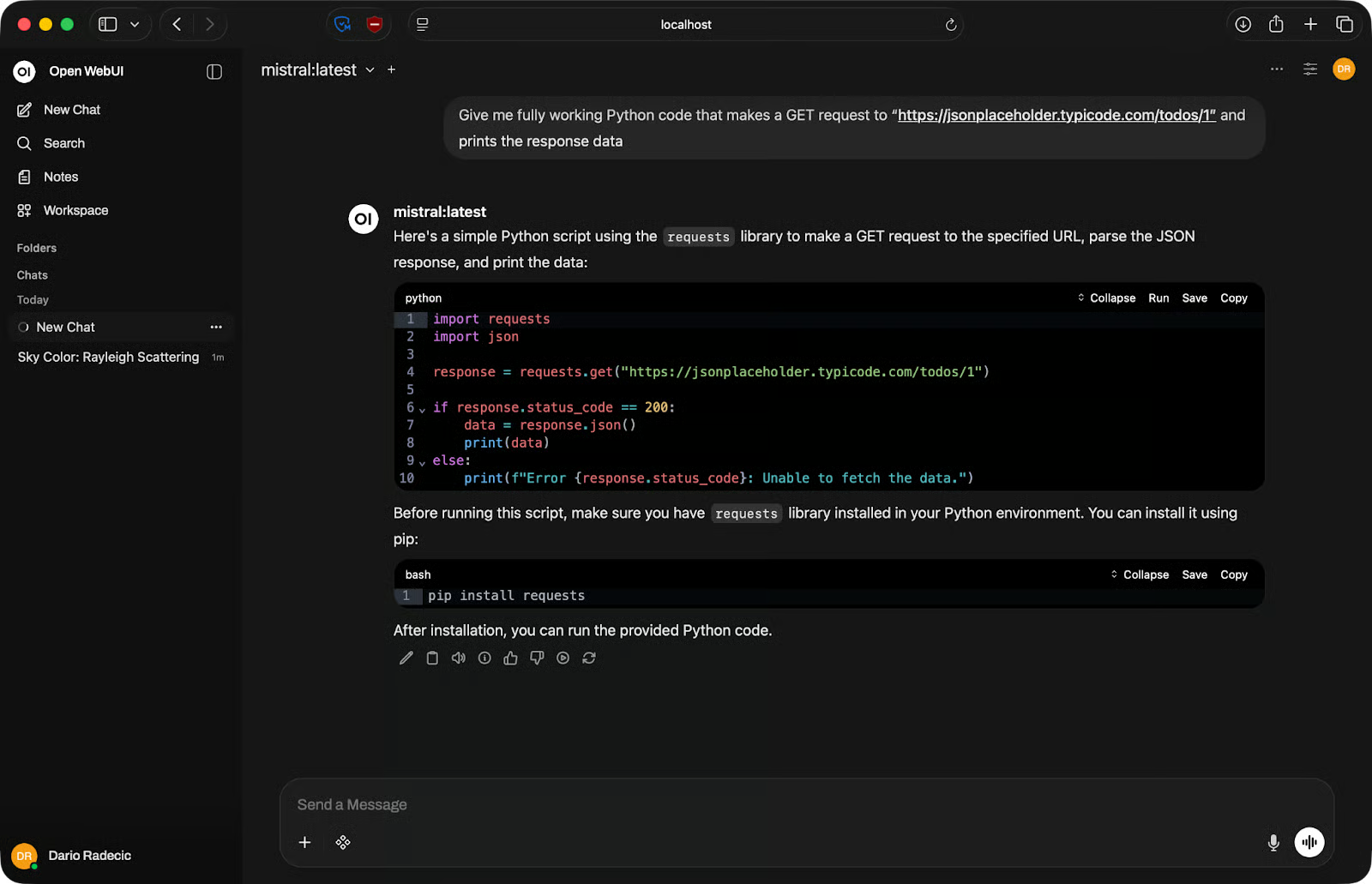

Kodlama görevleri

Open WebUI, kod üretimi ve hata ayıklama için iyi çalışır. İhtiyacınızı sade bir dille anlatın; model kopyalayabileceğiniz bir kod bloğu döndürür.

Kodlama örneği

Hata ayıklama için, kodunuzu ve hata mesajını isteme yapıştırın. Spesifik olun - sadece hata türünü değil, tam hata çıktısını ekleyin. Ne kadar çok bağlam verirseniz yanıt o kadar faydalı olur.

Hata ayıklama örneği

Çok adımlı görevlerde her şeyi tek bir isteme sığdırmaya çalışmayın. Parçalara ayırın. Önce modelden bir fonksiyon yazmasını isteyin, sonra hata yakalamayı eklemesini, ardından testleri yazmasını isteyin. Kısa ve odaklı istemler, her şeyi bir arada yapmaya çalışan uzun istemlerden daha iyi sonuç verir.

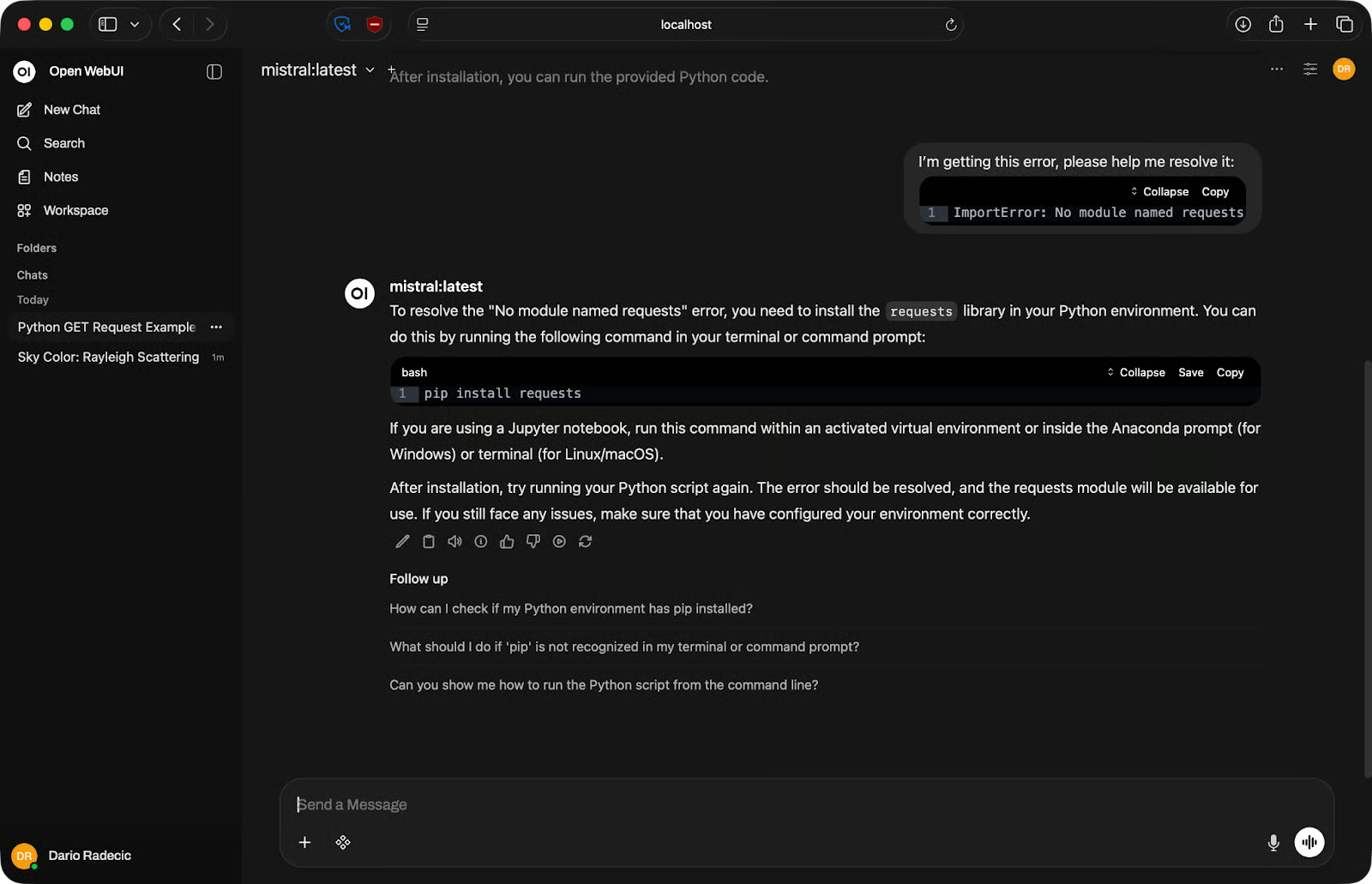

Dosya yüklemeleri

Open WebUI sohbette dosya yüklemeyi destekler. Giriş alanındaki artı simgesine tıklayın ve bir belge ekleyin - PDF, metin dosyası veya benzeri.

Yüklendikten sonra dosyanın içeriği konuşma bağlamının bir parçası olur. Modelden özetlemesini, belirli bilgileri çıkarmasını veya belgedeki içeriğe dayalı soruları yanıtlamasını isteyebilirsiniz.

Belge sohbeti

Aklınızda bulunsun: model yalnızca bağlam penceresine sığanlarla çalışabilir - yani aynı anda işleyebileceği metnin üst sınırı vardır. Çok büyük dosyalar kesilebilir; bu yüzden uzun belgelerle çalışıyorsanız bölün.

Önemli Open WebUI Özellikleri

Open WebUI'de birçok ayar var; ancak gerçekten işinize yarayacak birkaçından bahsedeyim.

Çoklu model desteği

Sohbet penceresinin üstündeki model seçici, yeni bir konuşma başlatmadan oturum ortasında model değiştirmenize olanak tanır. Bu, aynı istemi farklı modellere denemek istediğinizde işinize yarar - önce Llama, sonra Mistral üzerinden çalıştırın ve çıktıları yan yana karşılaştırın.

Model seçimi

Belirli bir görev için modelleri değerlendiriyorsanız bu size çok zaman kazandırır.

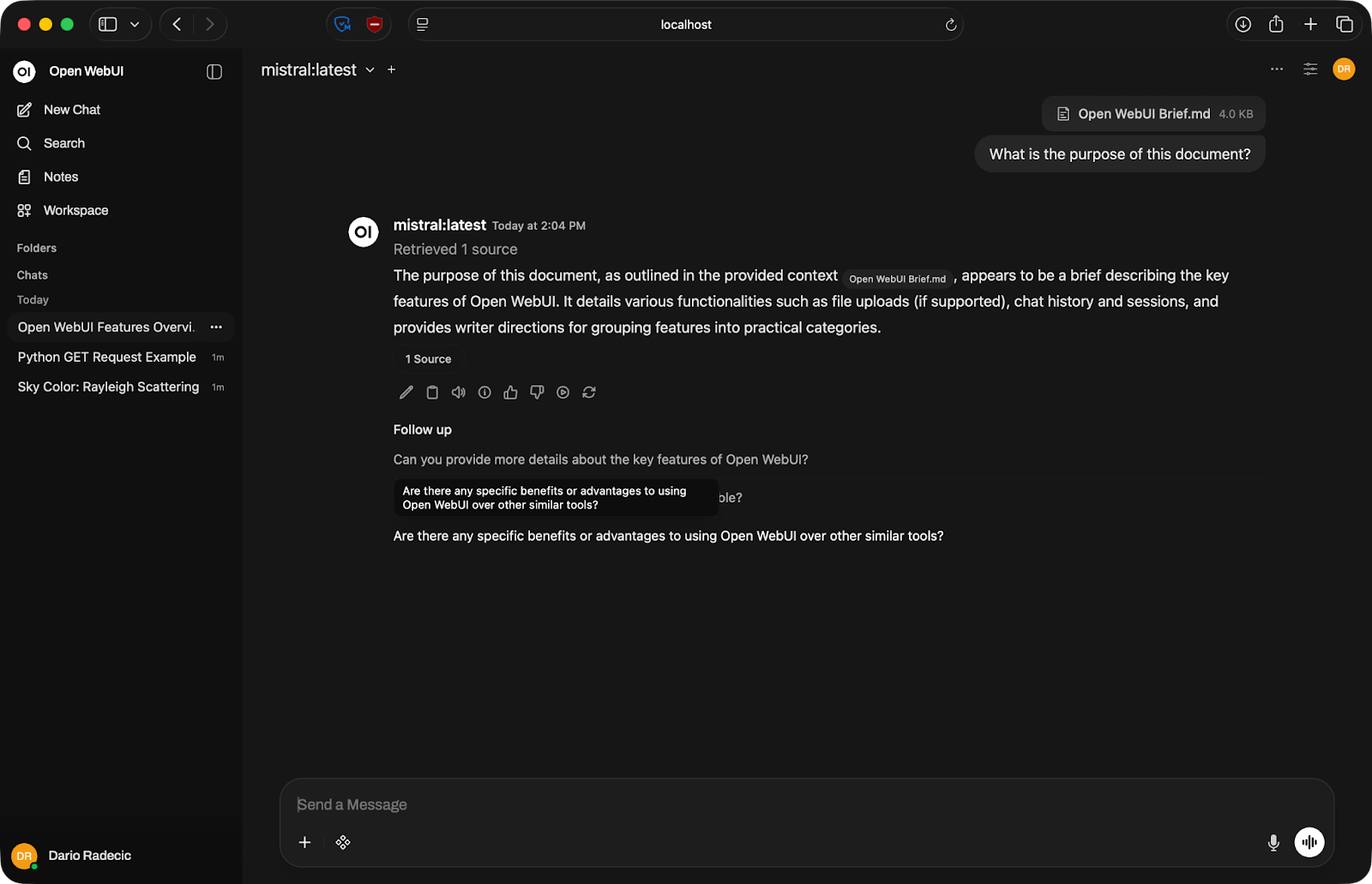

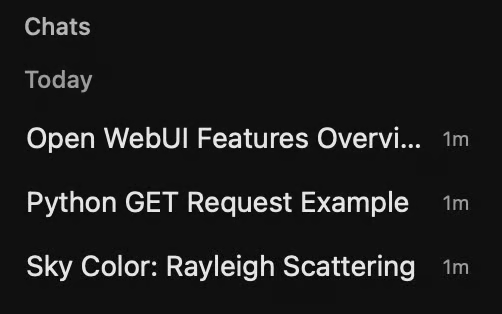

Sohbet geçmişi ve oturumlar

Her konuşma kaydedilir ve sol kenar çubuğunda listelenir. Oturumları anlamlı bir şeyle yeniden adlandırabilirsiniz; böylece daha sonra "Yeni Sohbet" girdilerinin arasında kaybolmazsınız.

Önceki sohbet oturumları

Bu, Open WebUI'yi süreklilik gerektiren işler için kullanışlı kılar. Bir kodlama oturumuna geri dönebilir, yarım kalmış bir isteme devam edebilir veya bir konuşmayı referans olarak yeniden kullanabilirsiniz.

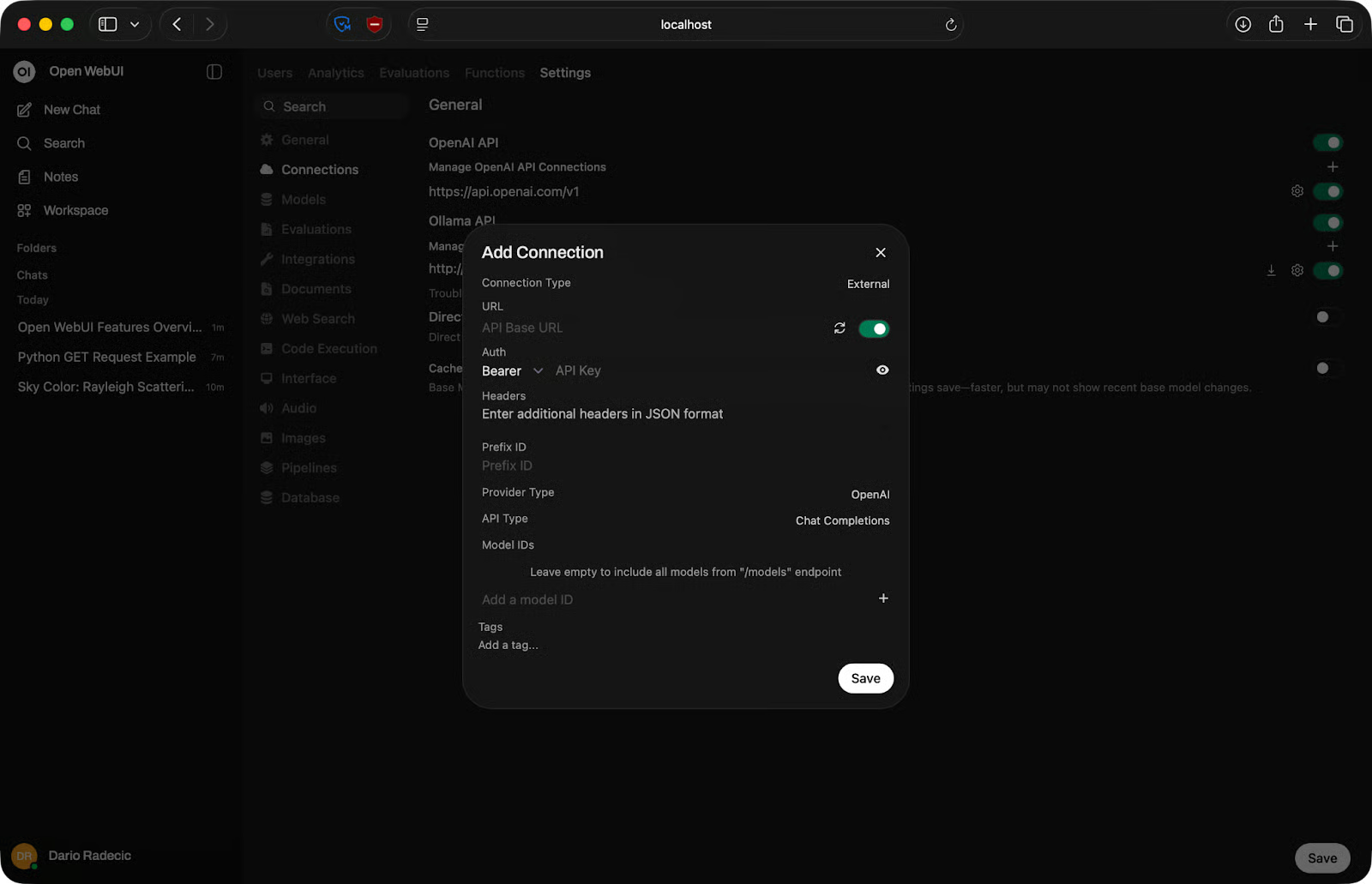

Yerel vs. API modelleri

Open WebUI, arkasında ne çalıştığıyla ilgilenmez. Özel işler için yerel bir Ollama modeline ve belleğinize sığmayacak kapalı kaynaklı bir modele ihtiyaç duyduğunuz görevler için OpenAI uyumlu bir API'ye bağlanabilirsiniz.

OpenAI bağlantılarını yönetme

Hızlı işler için küçük bir yerel model, işin gerektirdiği (ve izin verdiği) durumlarda ise daha büyük, API destekli bir model kullanın.

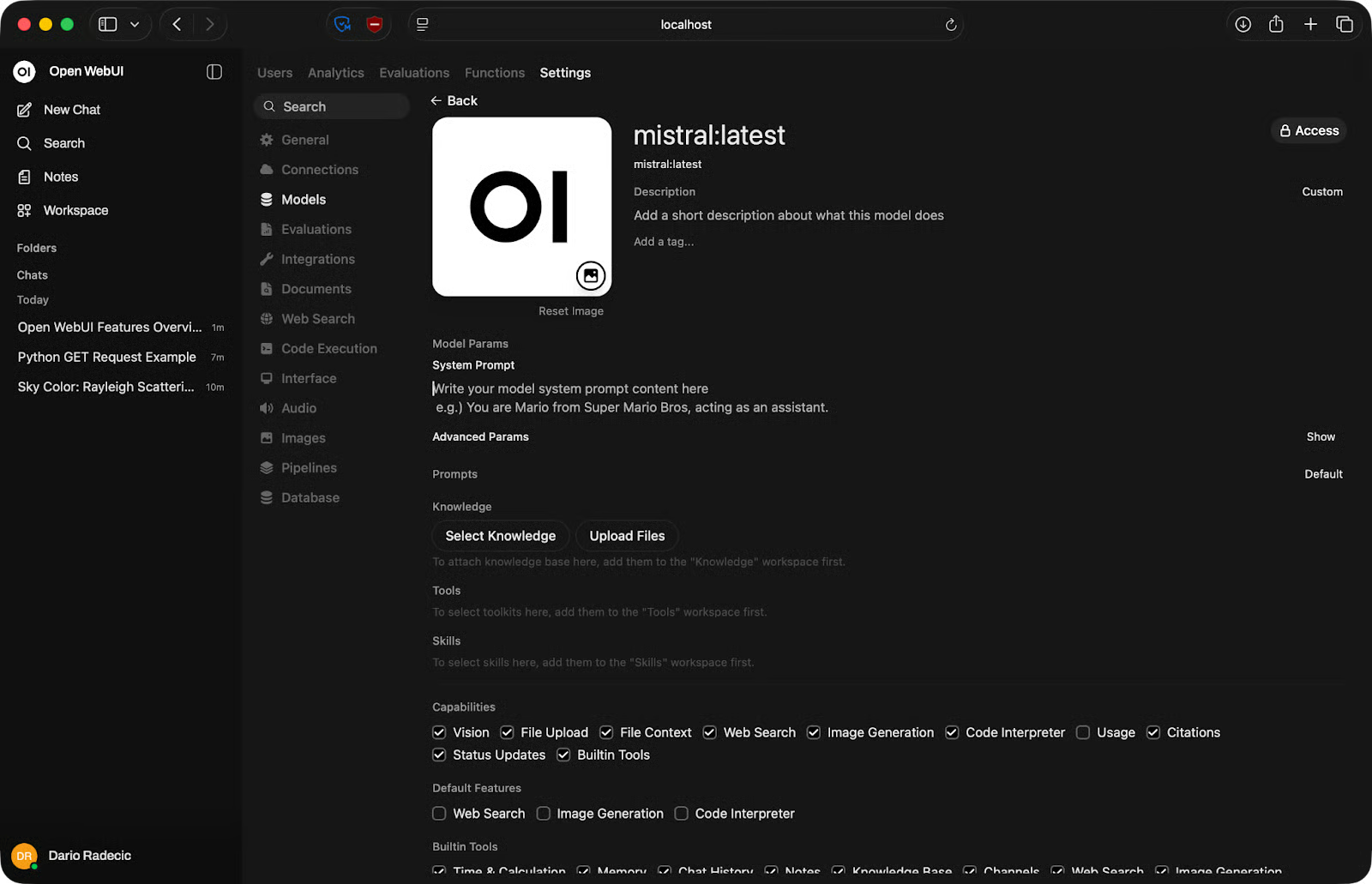

Özel model ayarları

Tek tek LLM'ler için pek çok özelleştirme yapabilirsiniz.

Model ayarlarında sistem istemini ince ayarlayabilir, bir bilgi tabanı (belgeler) ekleyebilir ve modeli araçlara ve yeteneklere bağlayabilirsiniz. Ayrıca görsel algı, dosya yükleme gibi hangi yetenekler için kullanılacağını düzenleyebilir ve modelin web araması gibi görevleri yapıp yapmayacağını seçebilirsiniz:

Model ayarlarının ince ayarı

Open WebUI vs. ChatGPT ve Diğer Arayüzler

Open WebUI, ChatGPT'nin yerini almaya çalışmıyor. Farklı bir sorunu çözmek için kullanılıyor.

Open WebUI vs. ChatGPT

Temel fark, verilerinizin nereye gittiğidir. ChatGPT'de her istem OpenAI'nin sunucularına gider. Open WebUI'de ise her şey makinenizde kalır - arayüz, model ve sohbet geçmişi.

Bunun karşılığında performans farkı vardır. GPT-5 ve benzeri bulut modelleri, yerelde çalıştırabileceğiniz çoğu modelden daha yeteneklidir. Saf çıktı kalitesi önceliğinizse bulut üstün gelir. Gizlilik veya çevrimdışı erişim daha önemliyse yerel kurulum kazanır.

Maliyet de bir faktördür. ChatGPT Plus sabit bir aylık ücrettir. Open WebUI ücretsizdir; ancak donanım maliyeti size aittir - yeterli RAM'e ve ideal olarak bir GPU'ya sahip bir makine.

Open WebUI vs. Ollama CLI

Ollama'nın CLI'ı hızlı denemeler için uygundur, ancak gerçek iş için tasarlanmamıştır. Bir istem yazarsınız, bir yanıt alırsınız ve biter. Geçmiş, dosya yükleme ve terminaller arasında geçiş yapmadan modelleri karşılaştırma imkânı yoktur.

Open WebUI, Ollama'ya düzgün bir arayüz kazandırır. Modeller ve arka uç aynıdır - ancak konuşma yönetimi, ayar kontrolleri ve terminali kapattığınızda kaybolmayan bir arayüzle birlikte gelir.

Zaten Ollama kullanıyorsanız, üzerine Open WebUI eklemek size hiçbir şeye mal olmaz ve kullanıcı deneyimini ciddi ölçüde iyileştirir.

Open WebUI vs. diğer araçlar

LM Studio, yerleşik bir model tarayıcısı ve benzer bir sohbet arayüzü olan bir masaüstü uygulamasıdır. Docker olmadan kendi içinde çalışan bir GUI istiyorsanız iyi bir seçenektir. Dezavantajı masaüstünüze bağlı olmasıdır - Open WebUI tarayıcıda çalışır ve ağınızdaki diğer cihazlardan erişilebilir.

text-generation-webui daha çok ileri düzey kullanıcı aracıdır. Daha geniş bir model formatı yelpazesini destekler ve daha ince ayarlı kontroller sunar; ancak kurulumu daha zahmetlidir ve arayüzü gezinmesi daha zordur. Özel olarak text-generation-webui'nin sunduklarına ihtiyacınız yoksa Open WebUI daha iyi bir başlangıç noktasıdır.

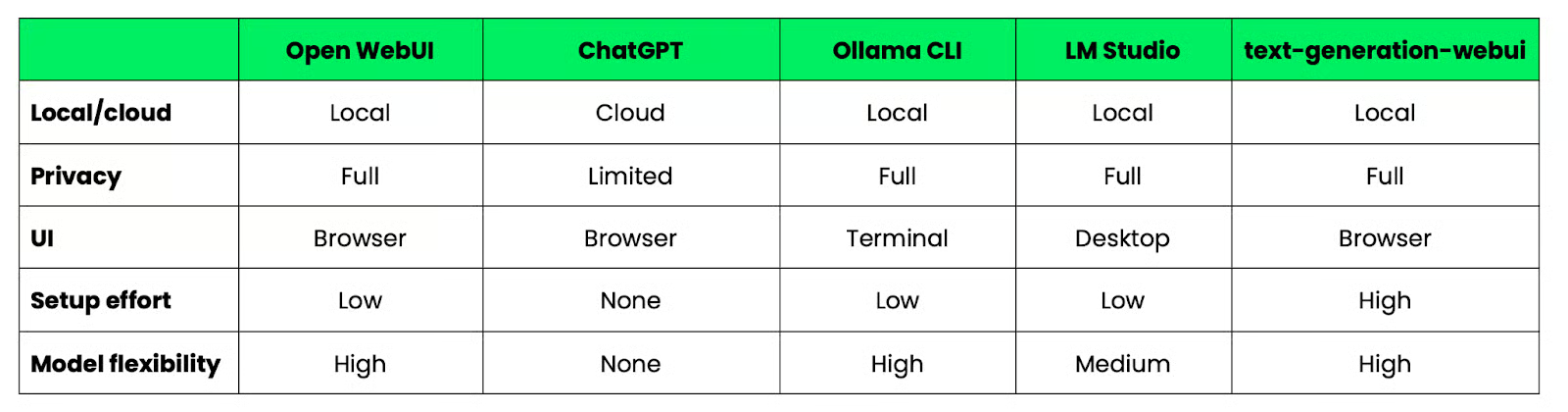

Karşılaştırma tablosu

Open WebUI ile alternatifleri arasında hızlı bir karşılaştırma için bu tabloya bakabilirsiniz:

Open WebUI ve alternatifleri

Yaygın Sorunlar ve Sorun Giderme

Çoğu Open WebUI sorunu beş kategoriden birine girer - ve çoğunun hızlı bir çözümü vardır.

Konteyner başlamıyor

docker logs open-webui komutunu başarısız başlangıcın hemen ardından çalıştırın. Kayıtlar neyin yanlış gittiğini söyleyecektir. On vakadan dokuzunda sorun, bir bağlantı noktası çatışması veya birim izin problemidir.

Bağlantı noktası çatışmaları

Makinenizde 3000 portu zaten kullanılıyorsa konteyner başlamaz. Ana makine portunu farklı eşleyerek düzeltin:

docker run -d -p 3001:8080 ...Ardından Open WebUI'ye http://localhost:3001 adresinden erişin.

Ollama'ya bağlanılamıyor

Önce Ollama'nın gerçekten çalıştığını doğrulayın:

ollama serveArdından Ayarlar - Bağlantılar bölümündeki API URL'sini kontrol edin. Mac ve Windows'ta http://host.docker.internal:11434 olmalıdır. Linux'ta ana makinenizin IP adresini kullanın. Buradaki yanlış bir URL, bağlantının başarısız olmasının en yaygın nedenidir.

Modeller görünmüyor

Model seçici boşsa Open WebUI, Ollama'ya bağlanmış ama model bulamamıştır. En az bir model çektiğinizi doğrulamak için ollama list çalıştırın. Liste boşsa bir tane çekin:

ollama pull mistralÇekme işleminden sonra Open WebUI sayfasını yenileyin - otomatik güncellenmez.

Yavaş performans

Yavaş yanıtlar neredeyse her zaman bir donanım sorunudur, Open WebUI sorunu değil. Model, mevcut RAM'iniz için fazla büyüktür veya GPU'nuz yoktur. Daha küçük bir modele geçin - 7B parametreli modeller, 16GB RAM'e sahip çoğu modern makinede makul derecede iyi çalışır. Yalnızca CPU ile kurulumda, model boyutundan bağımsız olarak daha yavaş yanıtlar bekleyin.

Open WebUI Kullanımı İçin En İyi Uygulamalar

Birkaç alışkanlık, Open WebUI'nin günlük kullanımda sizin için ne kadar iyi çalıştığına büyük fark yaratır.

- Hız için daha küçük modeller kullanın: Daha büyük modeller her zaman daha iyi değildir. 7B parametreli bir model saniyeler içinde yanıt verir ve çoğu günlük görevi yeterince iyi halleder. Daha büyük modelleri, gerçekten ihtiyaç duyulan görevler için saklayın; örneğin karmaşık akıl yürütme veya uzun metin üretimi

- Sohbet uzunluğunuza dikkat edin: Bir konuşmadaki her mesaj, modelin işlemesi gereken bağlama eklenir. Uzun konuşmalar büyüdükçe yavaşlar ve çalıştırma maliyeti artar. Konuşma ilk amacından uzaklaştıysa eski bağlamı sürüklemek yerine yeni bir konuşma başlatın

- İstemlerinizi organize edin: Aynı istemleri düzenli olarak kullanıyorsanız kaydedin. Open WebUI, istem ön ayarlarını saklamanıza olanak tanır; böylece her oturumda aynı talimatları yeniden yazmazsınız. Buraya yapacağınız küçük bir ön çalışma çok zaman kazandırır

- Sistem kaynaklarınızı izleyin: Yerel modeller donanımınızda çalışır. Makineniz zorlanıyorsa bir sistem izleyici açıp RAM ve CPU kullanımını kontrol edin. Büyük bir modelle birlikte diğer ağır işlemleri çalıştırmak yanıt sürelerini uzatır. Gerek duymadıklarınızı kapatın

- Open WebUI'yi mevcut araçlarınızla birleştirin: Arayüz yalnızca ön yüzdür. Çıktıları betiklere yönlendirebilir, editörünüzden dosyaları doğrudan yüklemelerle besleyebilir veya kod görevleri için terminalinizle birlikte Open WebUI'yi kullanabilirsiniz.

Open WebUI'yi Ne Zaman Kullanmalı

Open WebUI belirli durumlar için uygundur - her durum için değil. İşte kullanmanız gereken durumların bir listesi:

- Yerel geliştirme en yaygın kullanım senaryosudur. Bir LLM'in üzerine uygulama inşa ediyor ve API kredilerini harcamadan istemleri test etmek istiyorsanız, Open WebUI size hızlı bir geri bildirim döngüsü sunar

- Modellerle deneme Open WebUI'nin parladığı yerdir. Ollama ile birkaç farklı model çekebilir ve aynı istemi nasıl ele aldıklarını karşılaştırabilirsiniz - hem de tek bir arayüzden, tek satır kod yazmadan

- Gizliliğe duyarlı iş akışları için de harika bir uyumdur. İç belgeler, müşteri verileri veya üçüncü taraf bir sunucuya göndermek istemeyeceğiniz herhangi bir şeyle çalışıyorsanız, yerel bir kurulum her şeyi makinenizde tutar. Harici bir API bağlamayı seçmedikçe hiçbir veri dışarı çıkmaz

- Öğrenme ve prototipleme için de başka iyi bir senaryodur. LLM'lere yeniyseniz ve ücretli bir plana geçmeden davranışlarını anlamak istiyorsanız, Open WebUI düşük maliyetli bir deneme yolu sunar. Hızlı prototipler oluşturmak için de kullanışlıdır - yerel bir model, üretim kurulumuna yatırım yapmadan önce fikirleri test etmek için yeterince hızlıdır.

Öte yandan, Open WebUI, mümkün olan en iyi model çıktısına ihtiyaç duyuyor ve gizlilik bir endişe oluşturmuyorsa doğru araç değildir. Bu durumda bir bulut API'si daha iyi hizmet verir.

Sonuç

Open WebUI, yerel modellerle çalışmak için sade ve işlevsel bir arayüz sunar ve ortamı tamamen siz kontrol edersiniz.

Makinenizden veri çıkışı yok, oran sınırlaması yok, abonelik gerekmez. Modelleri siz seçersiniz, ayarları siz yönetirsiniz ve ihtiyacınıza göre kurulumu genişletirsiniz.

Başlamak için en iyi yol basit tutmaktır. Docker konteynerini çalıştırın, Llama veya Mistral gibi küçük bir modele bağlayın ve birkaç istem gönderin. Bu çalıştıktan sonra daha fazla model ekleyebilir, sistem istemlerini yapılandırabilir, harici API'leri bağlayabilir ve üzerine inşa edebilirsiniz.

Merak ediyorsanız, Ollama'yı Docker ile de çalıştırabilirsiniz; yerel kurulum gerekmez. Nasıl yapılacağını görmek için yakın tarihli rehberimizi okuyun.

SSS

Open WebUI nedir?

Open WebUI, büyük dil modelleriyle etkileşim kurmak için kendi barındırabileceğiniz, tarayıcı tabanlı bir arayüzdür. ChatGPT gibi çalışır, ancak tamamen kendi makinenizde çalışır. Ollama veya OpenAI uyumlu bir API gibi bir model arka ucuna bağlanırsınız ve tüm verileriniz yerelde kalır.

Open WebUI'yi çalıştırmak için güçlü bir makineye ihtiyacım var mı?

Open WebUI'nin kendisi hafiftir - kaynak gerektiren, arkasında çalışan modeldir. Çoğu yerel model için 16GB RAM makul bir tabandır. GPU yanıt hızına yardımcı olur, ancak birçok küçük model yalnızca CPU ile çalışan makinelerde de kabul edilebilir şekilde çalışır.

Open WebUI'yi kullanmak ücretsiz mi?

Evet, Open WebUI açık kaynaklı ve ücretsizdir. Arayüzün kendisi için ödeme yapmazsınız. Söz konusu maliyetler yalnızca kendi donanımınız ve isteğe bağlı olarak, OpenAI gibi ücretli bir model sağlayıcıya bağlanmayı seçerseniz harici API kullanımından ibarettir.

Open WebUI ile Ollama arasındaki fark nedir?

Ollama, yerel modelleri makinenize indiren ve çalıştıran arka uçtur. Open WebUI ise ön yüzdür - istem göndermek ve yanıtları okumak için kullandığınız arayüz. Ollama modeli yönetir, Open WebUI sohbet deneyimini yönetir. Ollama'yı Open WebUI olmadan CLI üzerinden kullanabilirsiniz, ancak deneyim çok daha sınırlıdır.

Open WebUI'yi yerel bir model yerine OpenAI'nin API'sine bağlayabilir miyim?

Evet. Open WebUI herhangi bir OpenAI uyumlu API uç noktasını destekler. Ayarlar - Bağlantılar'a gidin, API anahtarınızı ve uç nokta URL'sini ekleyin; bulut tabanlı modelleriniz yerel olanların yanında model seçicide görünecektir. Bu sayede aynı arayüzden yerel ve bulut modelleri arasında geçiş yapabilirsiniz.