Programa

Fica inseguro em enviar seus prompts para um servidor na nuvem? Segurança é uma grande preocupação para muita gente — e com razão.

Você escolhe o ChatGPT ou o Claude, digita um prompt e a solicitação vai para a infraestrutura de outra empresa. Para a maioria dos casos, tudo bem. Mas se você trabalha com dados sensíveis ou código proprietário, isso pode ser um risco. Além disso, interfaces em nuvem te prendem a modelos específicos, limites de uso e planos de preço.

Open WebUI é uma interface de chat auto-hospedada, acessada pelo navegador, para interagir com LLMs. É como a interface do ChatGPT, mas rodando na sua própria máquina. Ele se conecta ao Ollama, a APIs compatíveis com OpenAI e a modelos locais — assim, seus dados ficam onde você decidir.

Neste artigo, vou te guiar pela instalação do Open WebUI com Docker, a conexão com um modelo local e o uso em tarefas reais como chat e geração de código.

O que é o Open WebUI e como funciona

O Open WebUI é uma interface de chat via navegador para interagir com LLMs — parecido com o ChatGPT, mas rodando na sua máquina.

A arquitetura é o mais simples possível. Há um frontend que você acessa pelo navegador e um backend que se conecta a provedores de modelos como o Ollama ou qualquer API compatível com OpenAI.

Então, o Open WebUI não executa os modelos — ele conversa com o backend que você apontar.

Pense nele como uma porta de entrada universal para sua configuração de IA local.

Isso significa que você pode trocar o backend do modelo sem mudar nada na interface — e pode rodar a interface em uma máquina enquanto o modelo roda em outra.

Com o Open WebUI, você tem:

- Uma interface de chat para enviar prompts e ler as respostas

- Upload de arquivos para inserir documentos nas conversas

- Suporte a múltiplos modelos para alternar entre eles na mesma interface

- Histórico de conversas para revisitar e continuar sessões anteriores

Se você já usou ChatGPT ou Claude, a interface vai parecer familiar. A diferença está no que roda por trás. Vamos ver isso agora.

Como instalar o Open WebUI (método com Docker)

O Docker é a forma mais rápida de colocar o Open WebUI para rodar — e ainda o isola totalmente do seu sistema.

Pré-requisitos

Você precisa do Docker instalado na sua máquina. Se ainda não tem, baixe no site oficial do Docker.

Ollama é opcional neste momento. Se quiser conectar o Open WebUI a um modelo local de imediato, instale o Ollama primeiro e faça o pull de pelo menos um modelo. Se só quer subir a interface agora e conectar depois, pode pular esta etapa.

Passos de instalação

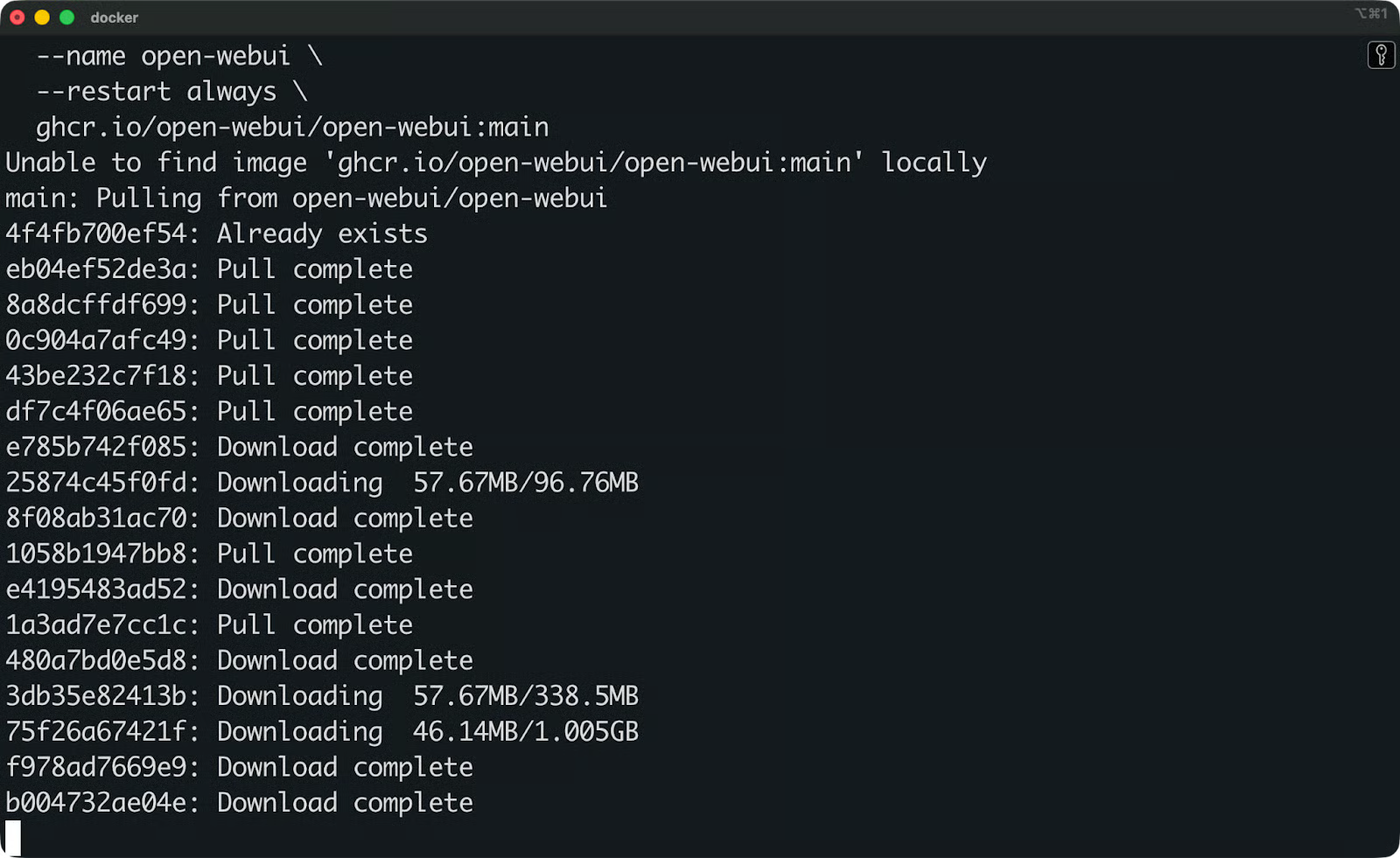

Rode este comando para baixar a imagem do Open WebUI e iniciar o container:

docker run -d \

-p 3000:8080 \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:main

Imagem do Open WebUI sendo baixada

Veja o que cada flag faz:

-

droda o container em background -

p 3000:8080mapeia a porta 8080 dentro do container para a porta 3000 na sua máquina -

v open-webui:/app/backend/datacria um volume Docker para persistir seus dados — conversas, configurações e arquivos enviados permanecem após reiniciar o container -

-restart alwaysreinicia o container se ele parar ou se sua máquina reiniciar -

-name open-webuidá um nome legível ao container para você referenciá-lo depois

Primeira execução

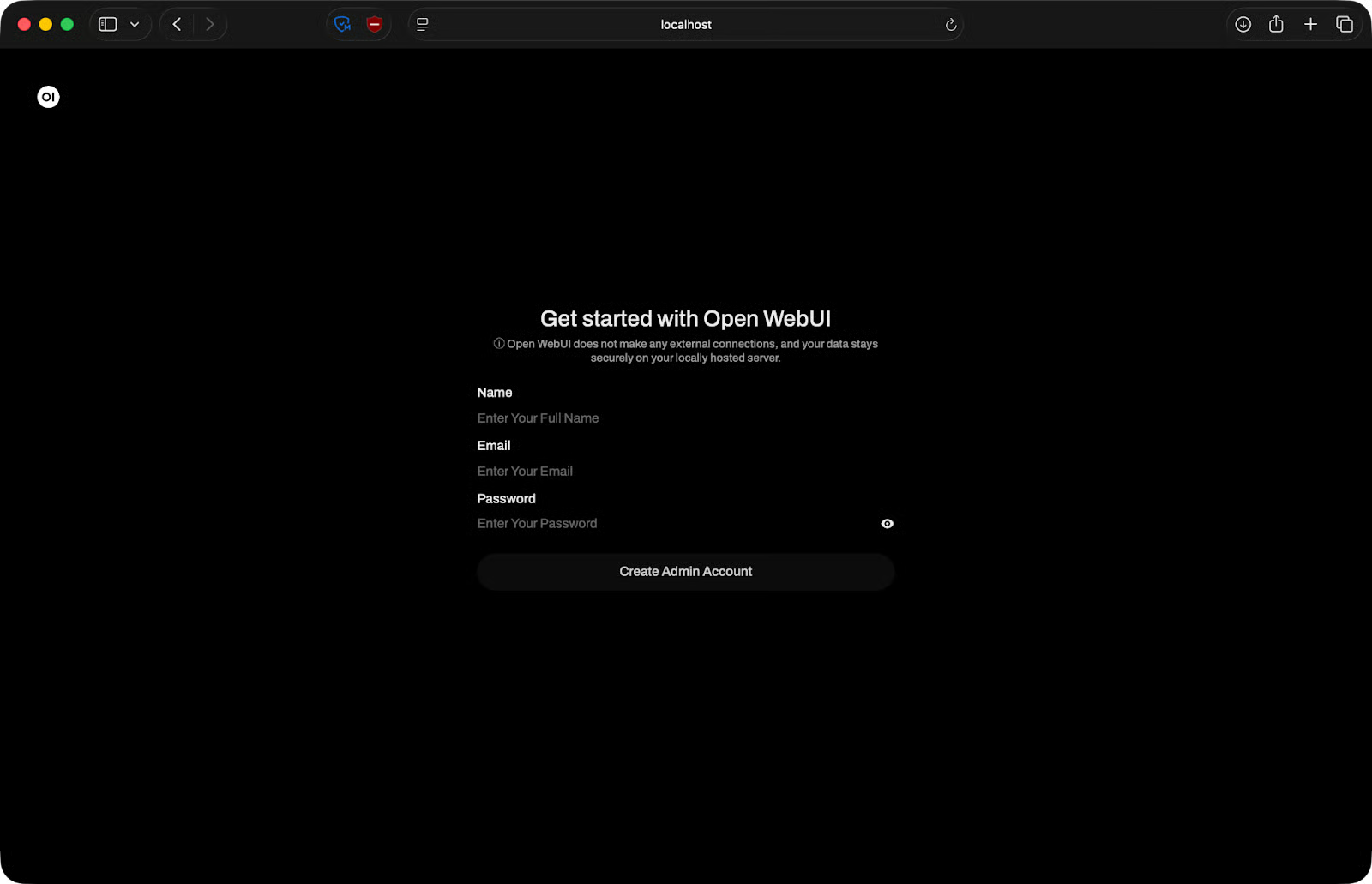

Quando o container iniciar, abra o navegador e vá para http://localhost:3000.

Na primeira visita, o Open WebUI vai pedir para criar uma conta de administrador. Preencha seu nome, e-mail e senha.

Página de configuração do Open WebUI

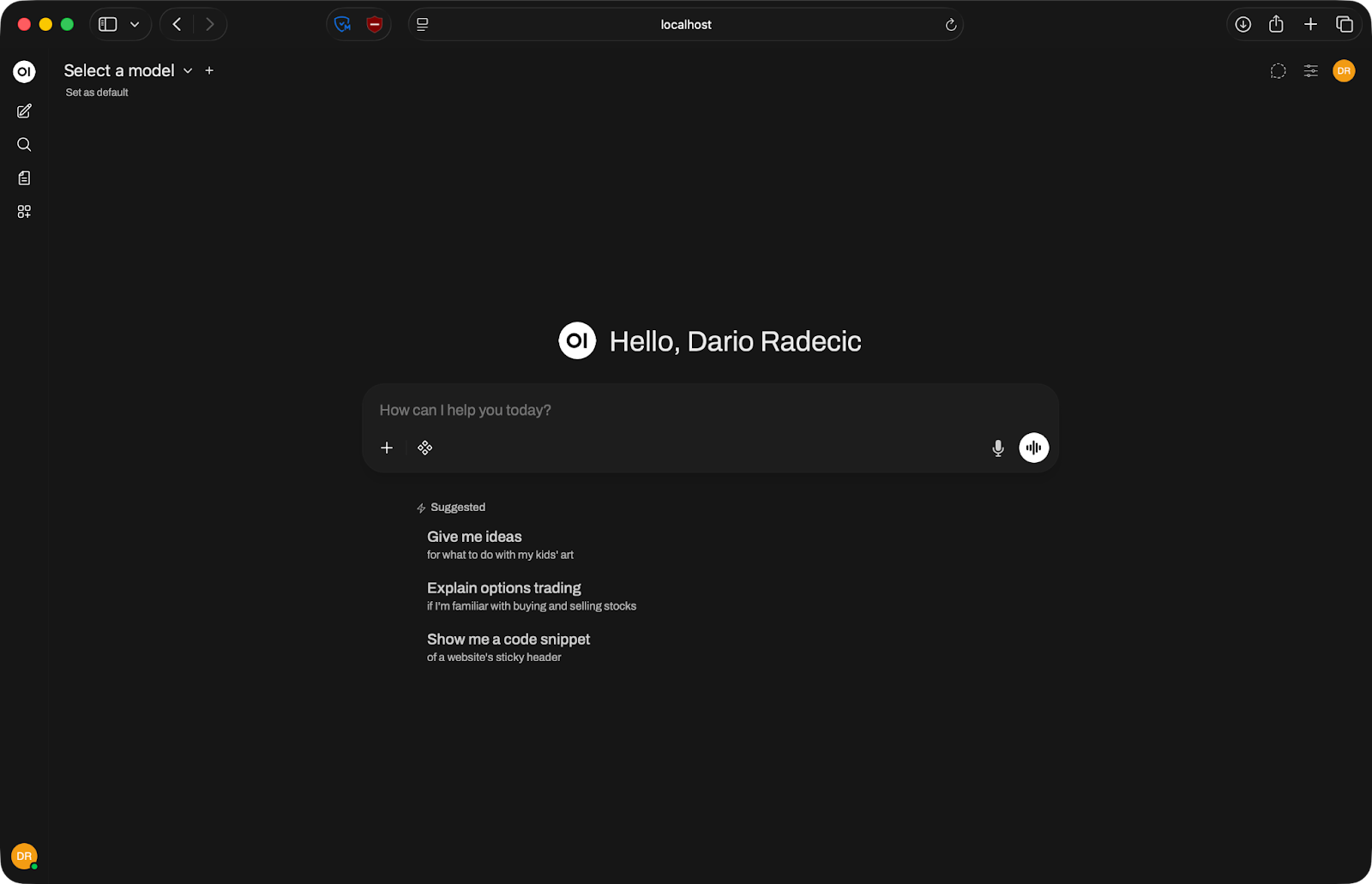

Depois disso, você já está dentro. A interface carrega e você pode conectar um modelo.

Página inicial do Open WebUI

Como conectar o Open WebUI ao Ollama

O Ollama é o backend mais comum para o Open WebUI porque facilita muito rodar modelos locais — um comando para baixar o modelo, outro para executar.

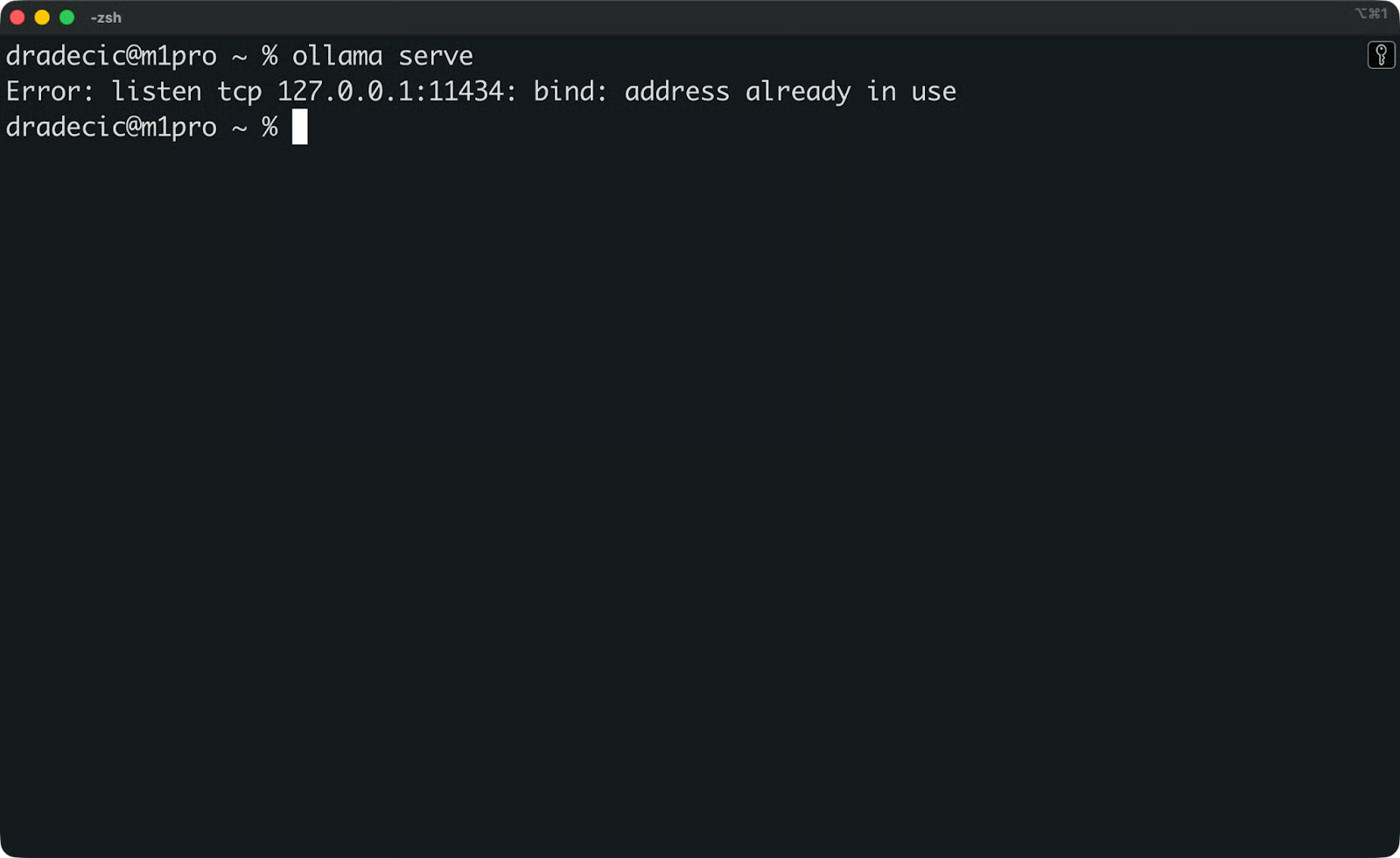

Antes de conectar qualquer coisa, verifique se o Ollama está mesmo rodando. Abra um terminal e confira:

ollama serve

Verificando se o Ollama está em execução

Se o Ollama já estiver rodando como serviço em background, você verá uma mensagem dizendo que o endereço já está em uso. Sem problemas — significa que ele está ativo.

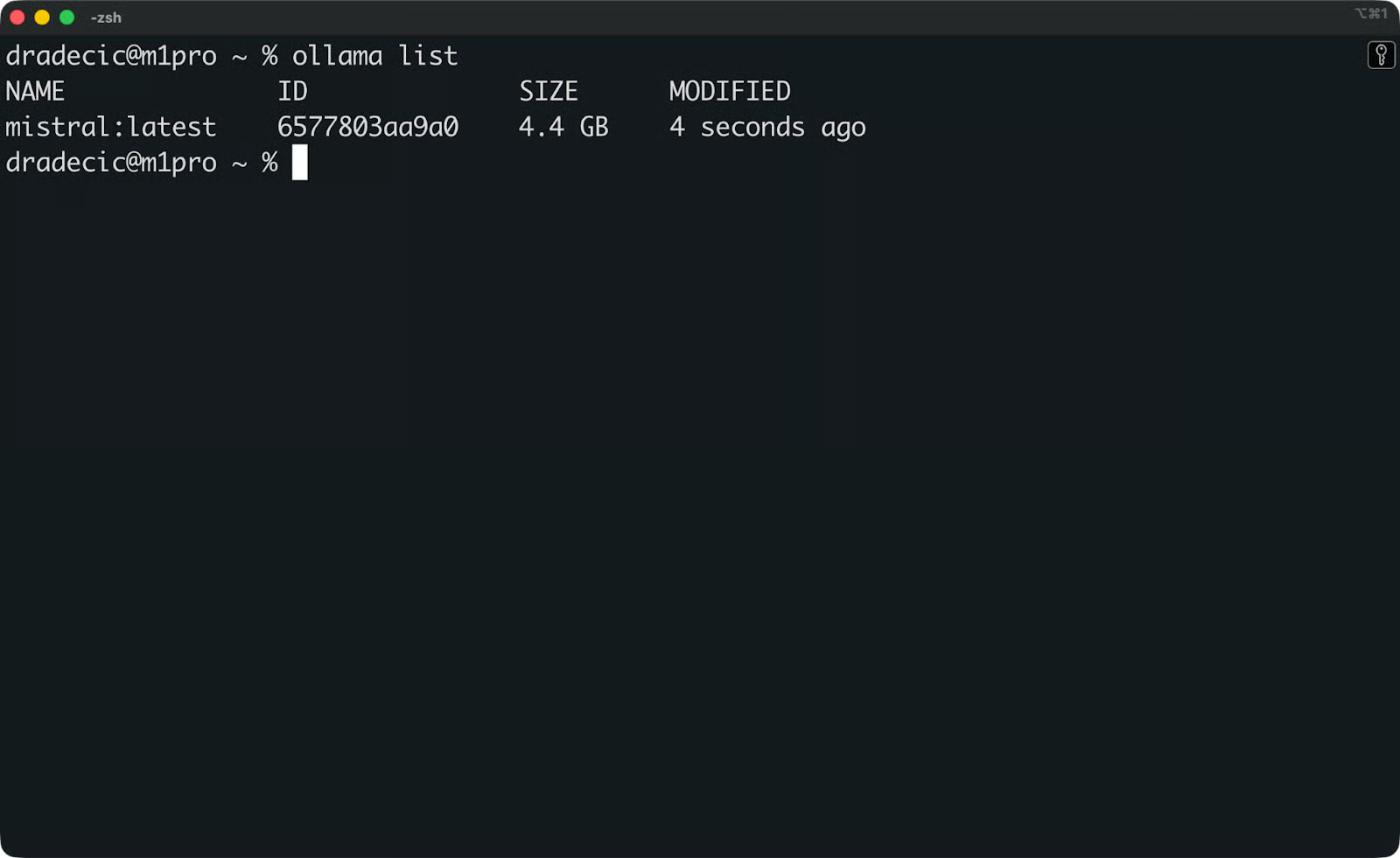

Em seguida, confirme se você já fez o pull de pelo menos um modelo. Rode:

ollama list

Modelos disponíveis no Ollama

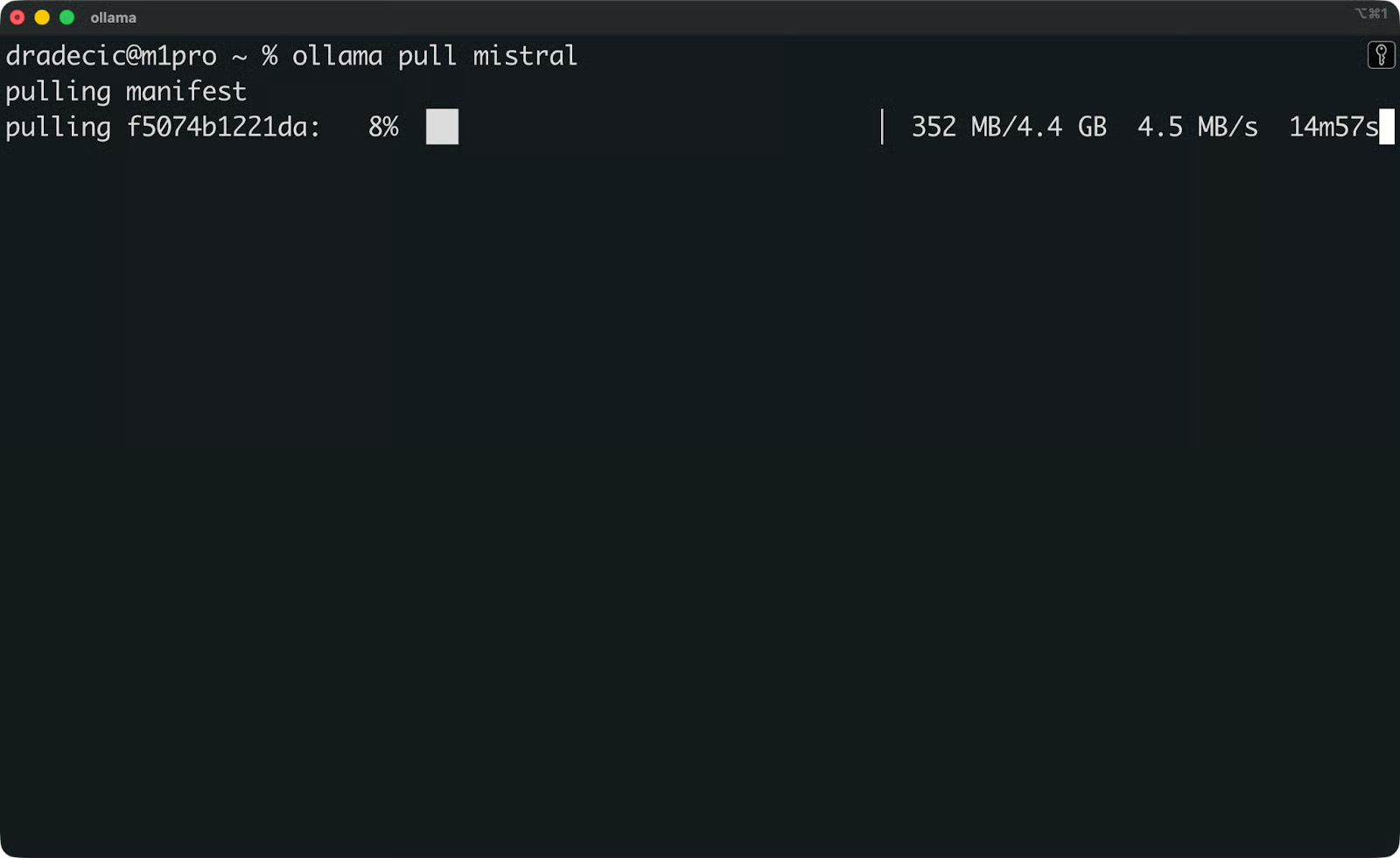

Se a lista estiver vazia, faça o pull de um modelo primeiro. Mistral é um bom ponto de partida:

ollama pull mistral

Fazendo pull do modelo Mistral

O Mistral é um modelo geral sólido que roda bem em hardware de consumo.

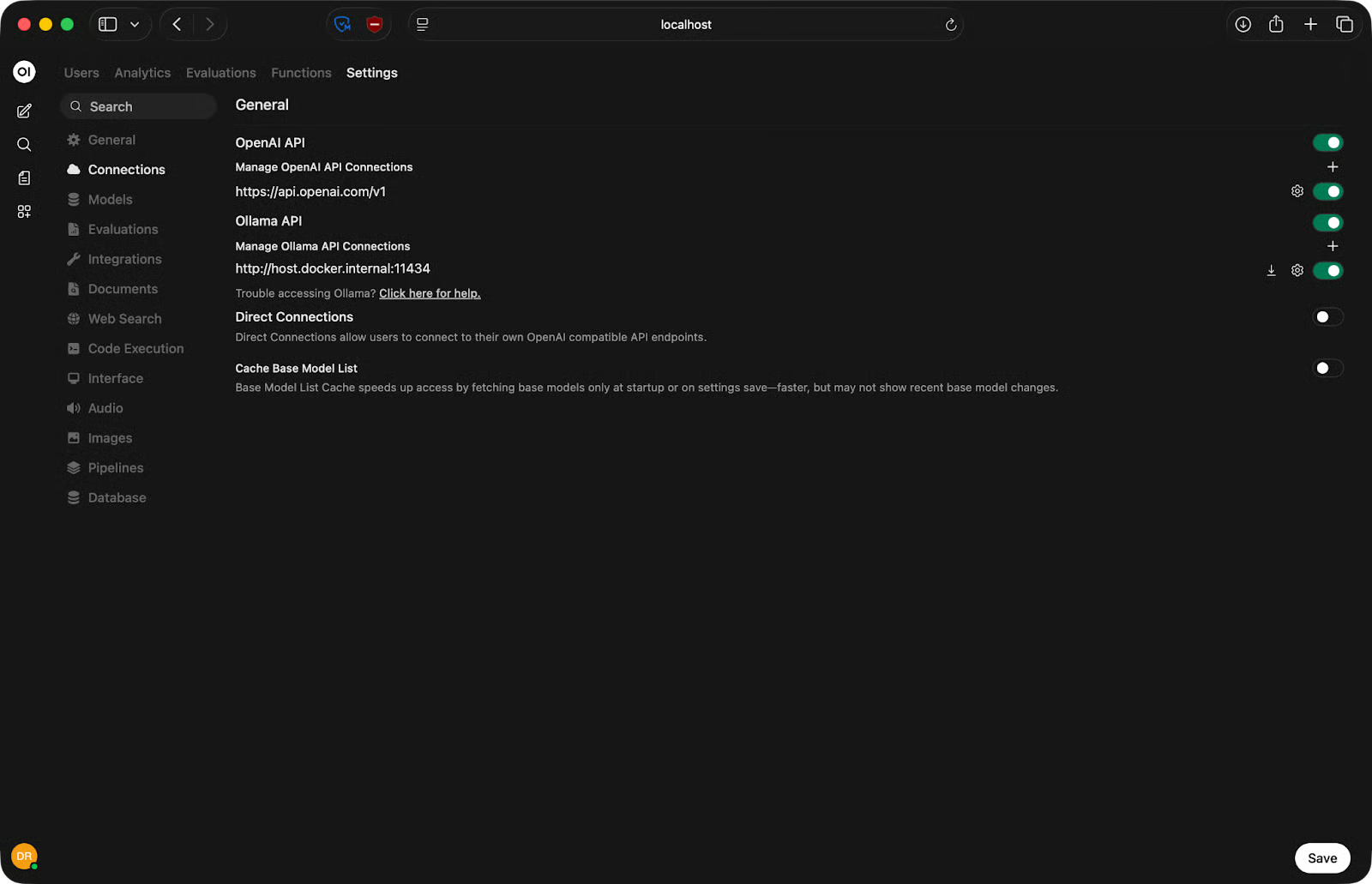

Conectar o Open WebUI ao Ollama

Agora abra o Open WebUI no navegador em http://localhost:3000. Vá em Settings - Connections e confira a URL da API do Ollama. Por padrão, é http://host.docker.internal:11434.

Configurando a URL da API do Ollama

Isso funciona no Mac e Windows com Docker Desktop. No Linux, substitua host.docker.internal pelo IP real da sua máquina:

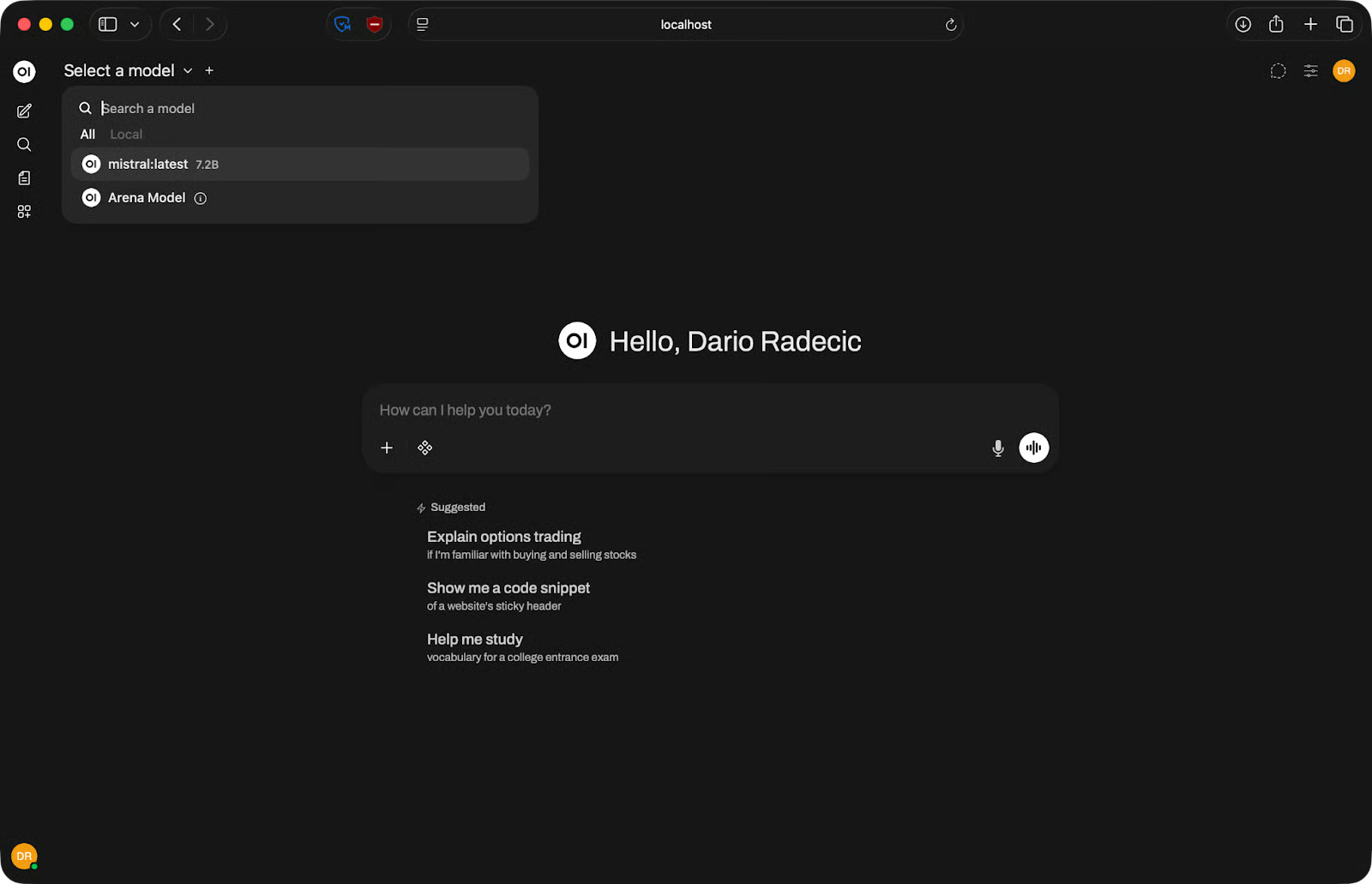

http://<your-ip-address>:11434Clique em Save e atualize a página. Se a conexão for bem-sucedida, seus modelos do Ollama aparecerão no seletor de modelos no topo da janela de chat. Selecione um e comece a conversar.

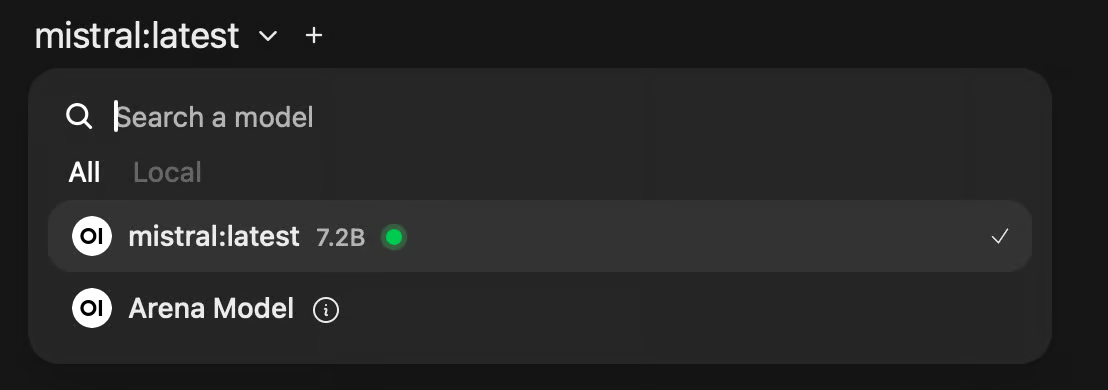

Modelos disponíveis

Se nenhum modelo aparecer, verifique novamente se o Ollama está rodando e se a URL da API está correta para o seu sistema operacional.

Como usar o Open WebUI para chat e código

Com o modelo conectado, usar o Open WebUI é bem parecido com o ChatGPT — mas com alguns controles extras que valem a pena conhecer.

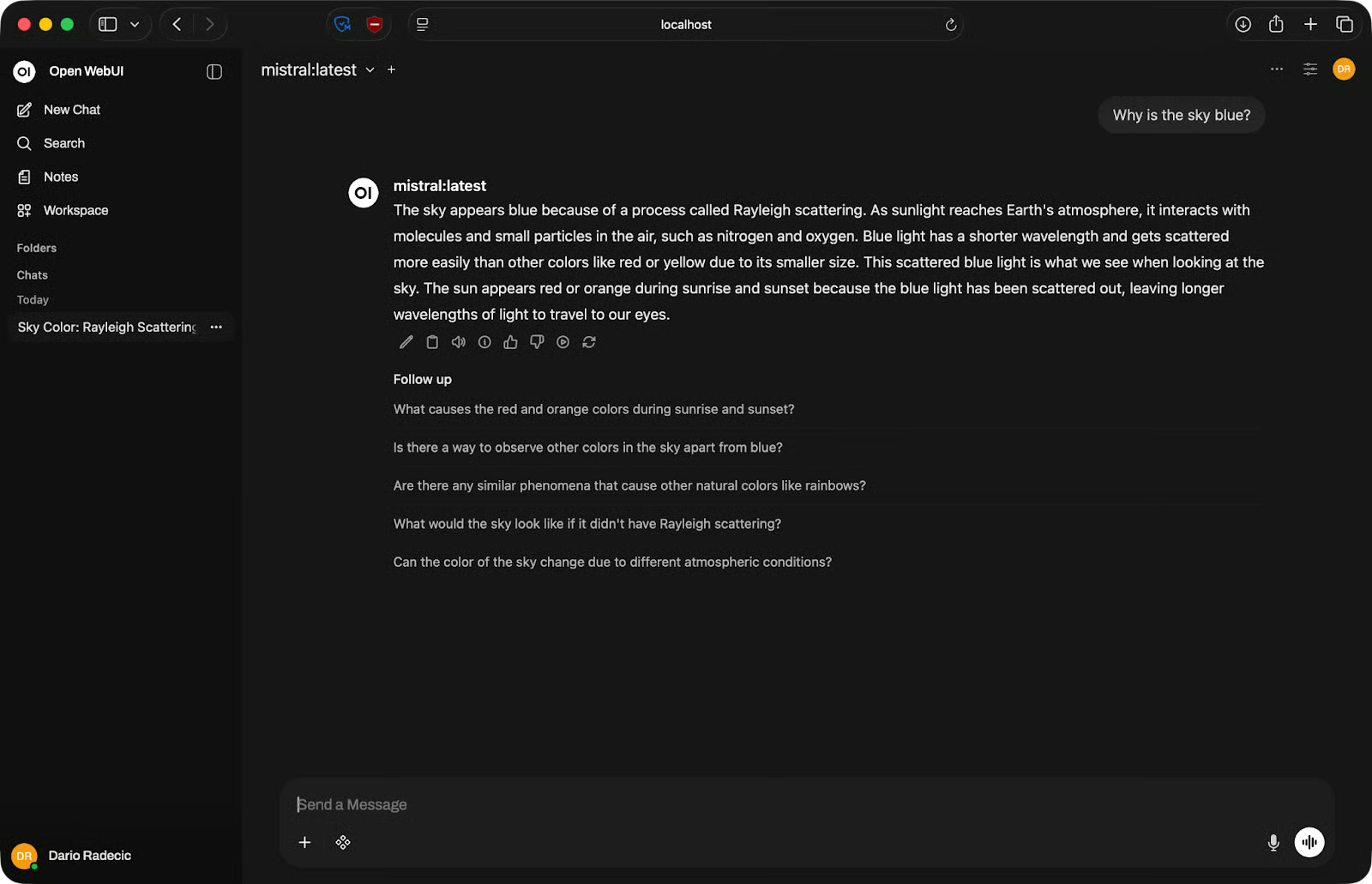

Chat básico

No topo da janela de chat, você verá um seletor de modelos. Clique e escolha o modelo que quer usar. Se você conectou múltiplos backends, todos os modelos disponíveis aparecem ali — modelos do Ollama, de APIs, tudo numa única lista.

Digite seu prompt no campo inferior e pressione Enter. As respostas chegam em tempo real, então você não precisa esperar o texto completo para começar a ler.

Exemplo de chat básico

Cada conversa é salva na barra lateral esquerda. Você pode renomear para manter tudo organizado ou excluir o que não precisar. Clique em qualquer conversa anterior para continuar de onde parou.

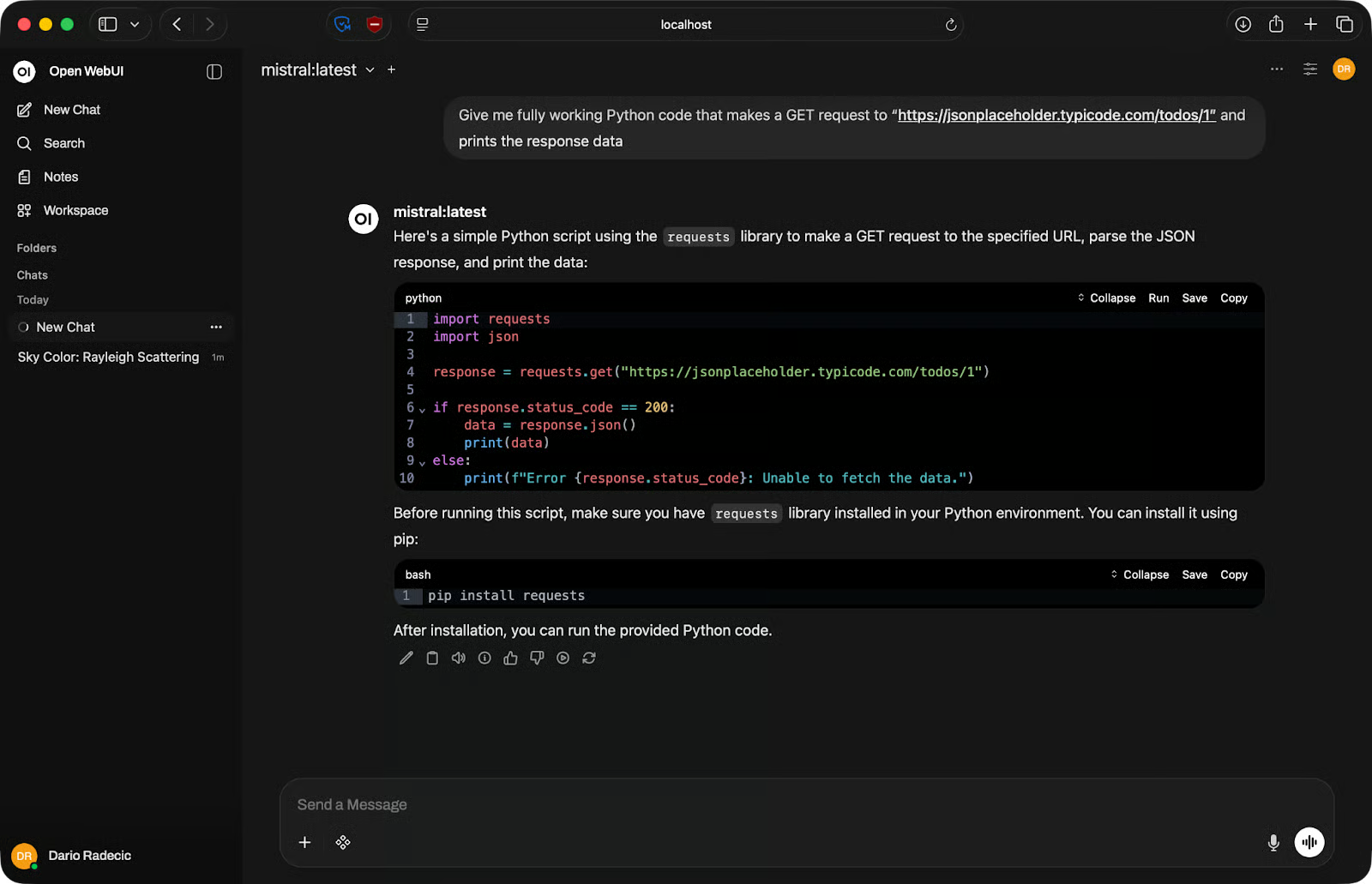

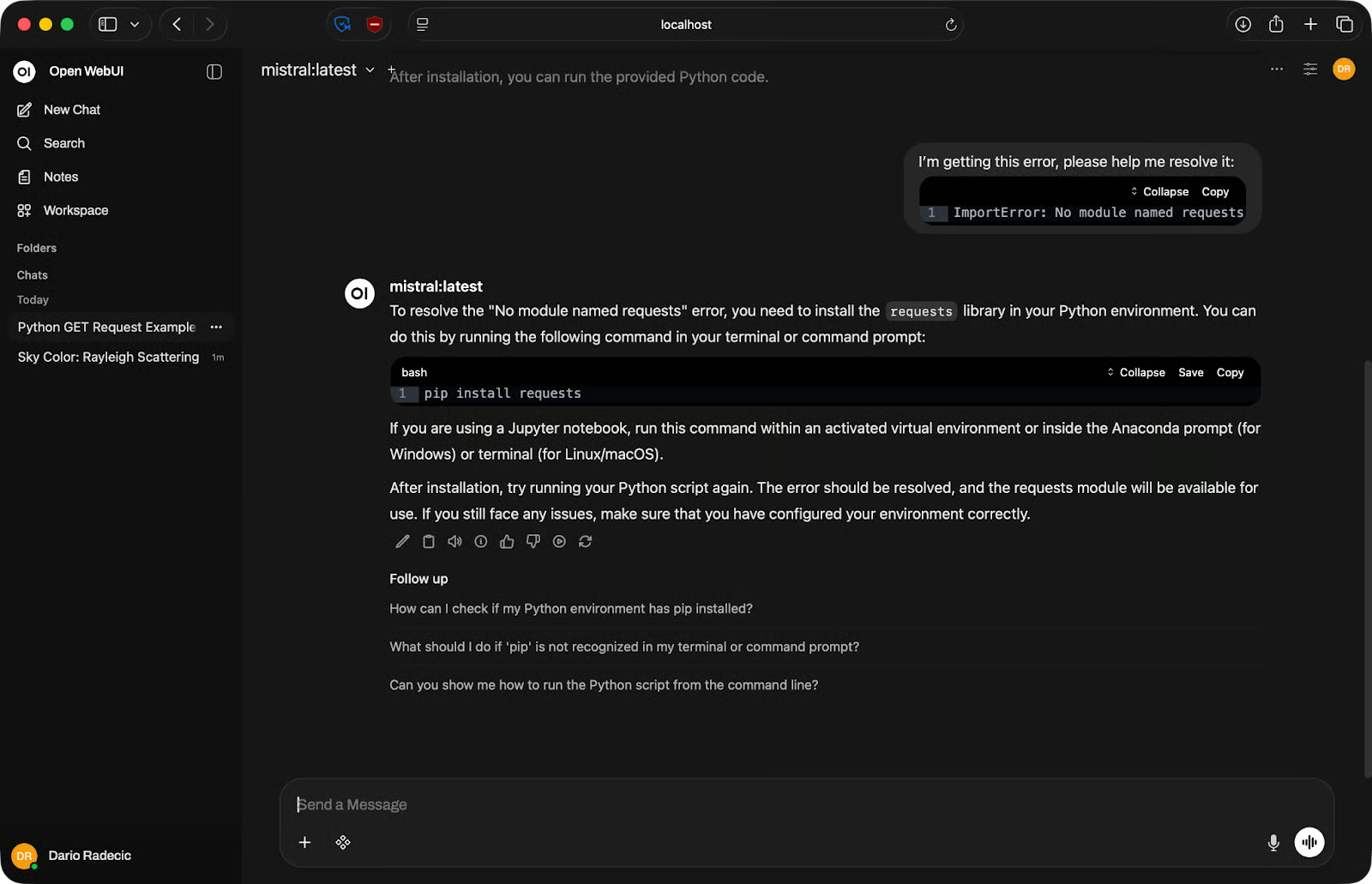

Tarefas de programação

O Open WebUI funciona muito bem para gerar código e depurar. Basta descrever em linguagem natural o que você precisa e o modelo retornará um bloco de código para copiar.

Exemplo de código

Para depuração, cole seu código e a mensagem de erro no prompt. Seja específico — inclua a saída completa do erro, não apenas o tipo. Quanto mais contexto você der, mais útil será a resposta.

Exemplo de depuração

Para tarefas em várias etapas, não tente colocar tudo em um único prompt. Quebre em partes. Peça para o modelo escrever uma função, depois adicionar tratamento de erros, depois escrever testes. Prompts curtos e focados geram resultados melhores do que um longo tentando fazer tudo de uma vez.

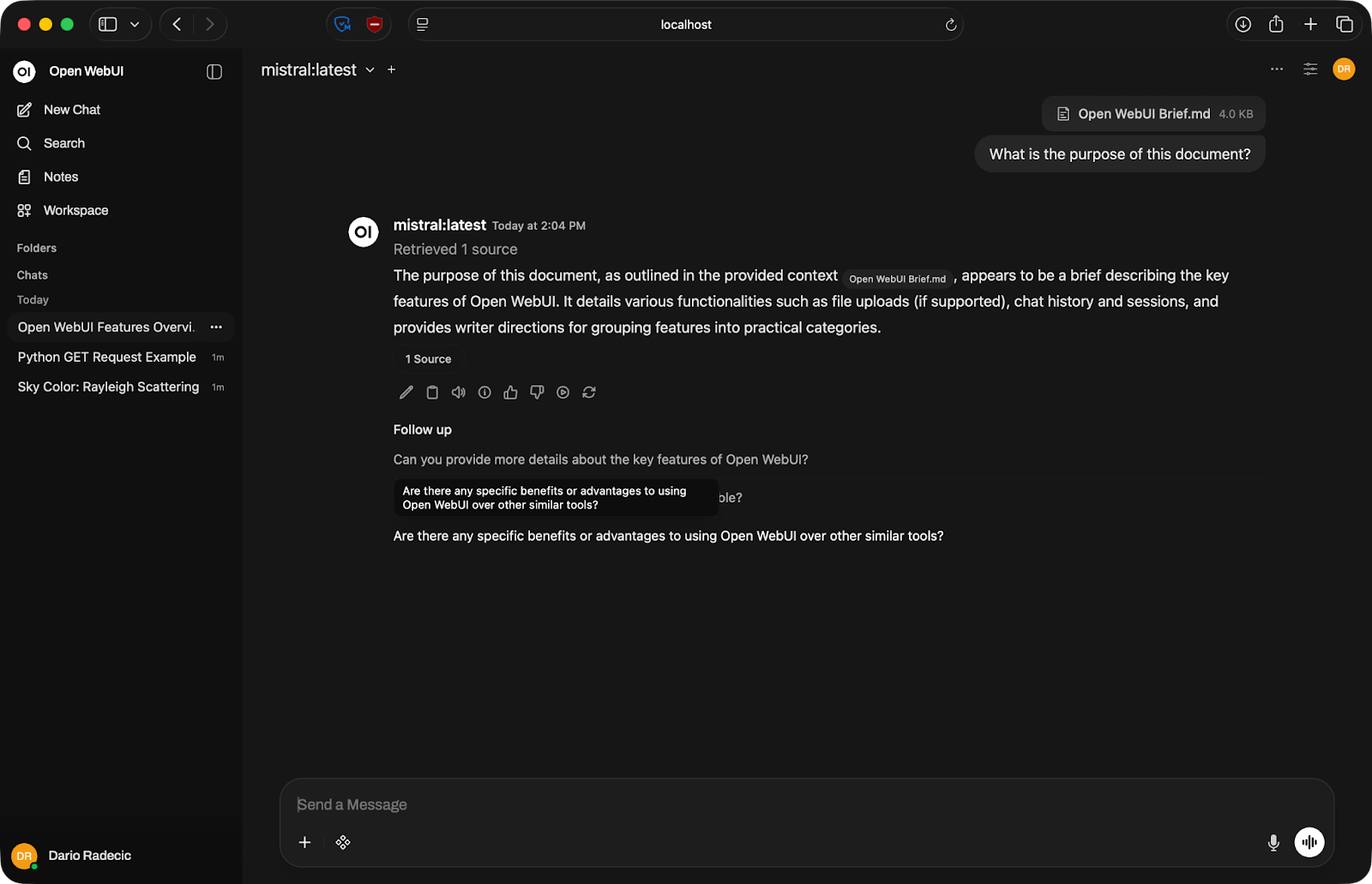

Upload de arquivos

O Open WebUI permite enviar arquivos no chat. Clique no ícone de mais na área de input e anexe um documento — PDF, arquivo de texto, etc.

Após o upload, o conteúdo do arquivo entra no contexto da conversa. Você pode pedir um resumo, extrair informações específicas ou fazer perguntas com base no que está no documento.

Conversa sobre documento

Um ponto de atenção: o modelo só consegue trabalhar com o que cabe na janela de contexto — a quantidade máxima de texto que ele processa de uma vez. Arquivos muito grandes podem ser cortados; se for o caso, divida o documento.

Recursos do Open WebUI que importam

O Open WebUI tem várias configurações, então vou destacar algumas que realmente fazem diferença.

Suporte a múltiplos modelos

O seletor de modelos no topo do chat permite alternar de modelo no meio da sessão sem começar outra conversa. Isso é útil para testar o mesmo prompt em diferentes modelos — rode no Llama, depois no Mistral, e compare os resultados lado a lado.

Seleção de modelos

Se você está avaliando modelos para uma tarefa específica, isso economiza muito tempo.

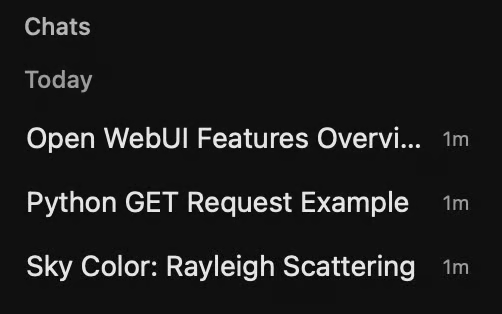

Histórico e sessões de chat

Cada conversa é salva e listada na barra lateral esquerda. Você pode renomear as sessões com títulos significativos, para não ficar com uma lista de "New Chat" depois.

Sessões de chat anteriores

Isso torna o Open WebUI útil para trabalhos contínuos. Você pode voltar a uma sessão de código, continuar um prompt inacabado ou reutilizar uma conversa como referência.

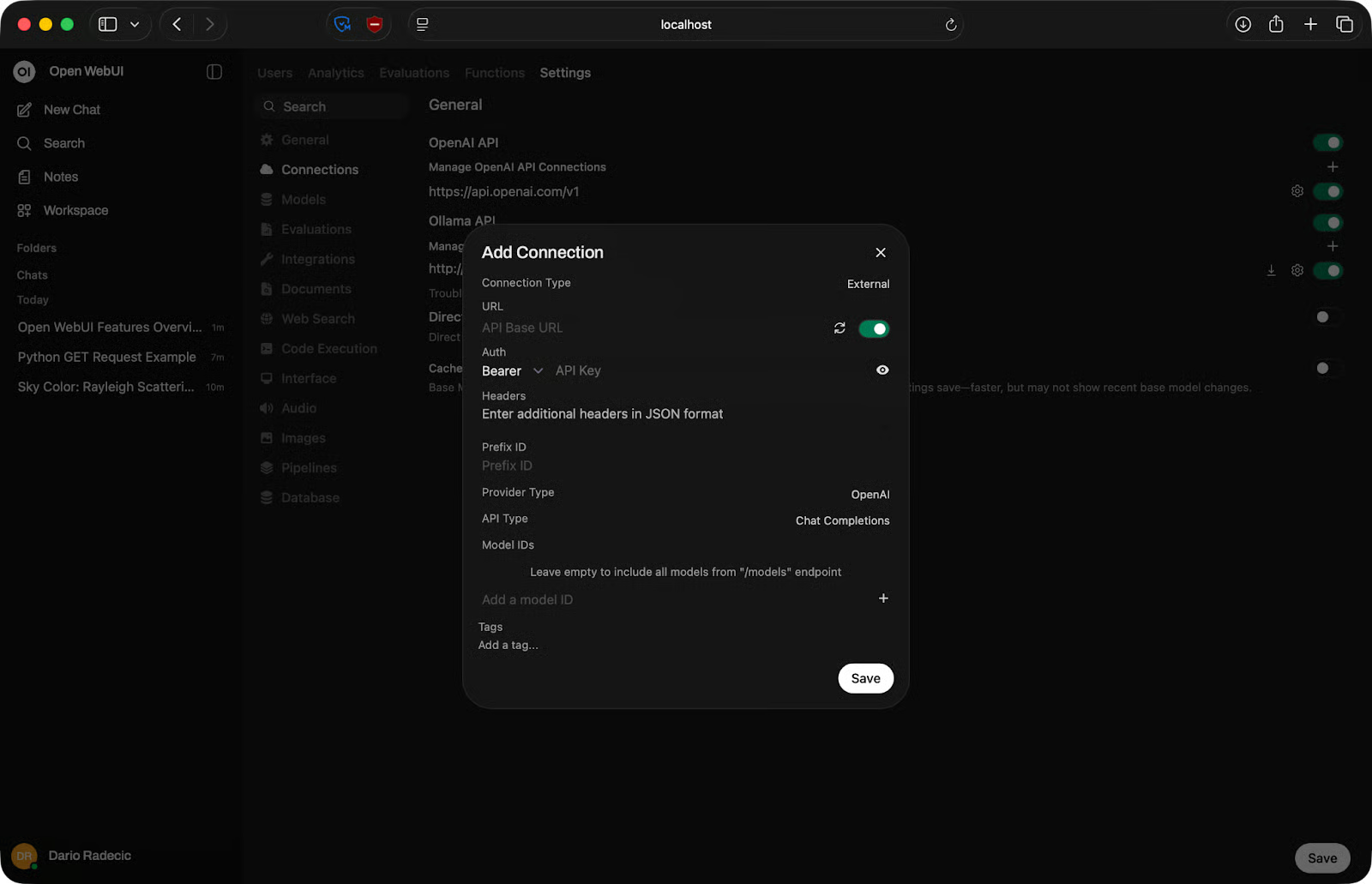

Modelos locais vs. APIs

O Open WebUI não se importa com o que está por trás. Você pode conectar um modelo local via Ollama para trabalho privado e uma API compatível com OpenAI para tarefas em que um modelo fechado não caberia na sua memória de qualquer forma.

Gerenciando conexões OpenAI

Use um modelo local pequeno para tarefas rápidas e um modelo maior via API quando a tarefa exigir (e permitir).

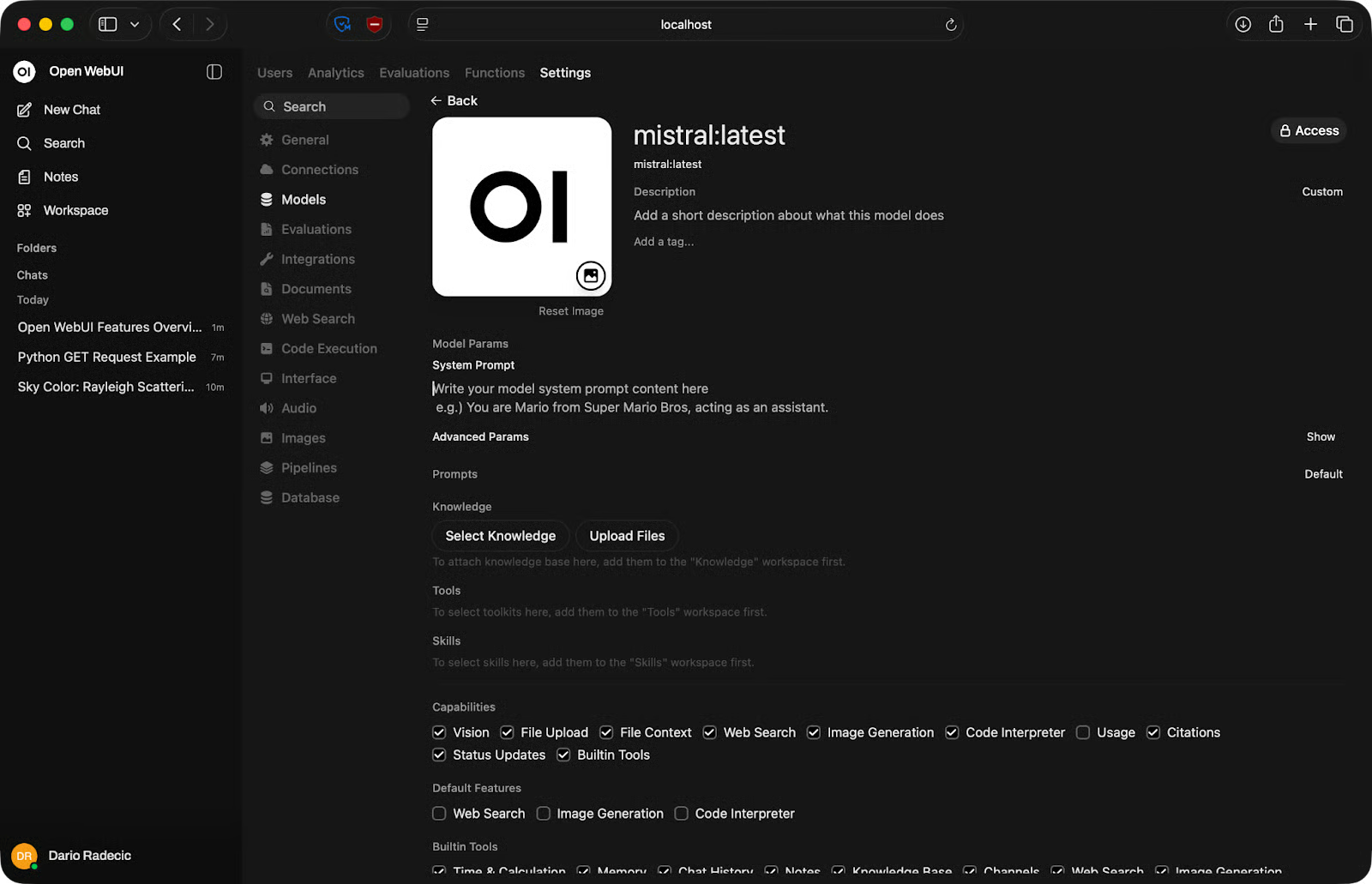

Configurações personalizadas de modelo

Você pode personalizar muita coisa para cada LLM.

Nas configurações do modelo, dá para ajustar o prompt do sistema, adicionar uma base de conhecimento (documentos) e conectar o modelo a ferramentas e skills. Também é possível definir para quais capacidades o modelo será usado, como visão, upload de arquivos, e escolher se ele deve executar tarefas como busca na web:

Ajustando configurações do modelo

Open WebUI vs. ChatGPT e outras interfaces

O Open WebUI não tenta substituir o ChatGPT. A proposta é resolver um problema diferente.

Open WebUI vs. ChatGPT

A diferença central é o destino dos seus dados. No ChatGPT, todo prompt vai para os servidores da OpenAI. No Open WebUI, tudo fica na sua máquina — a interface, o modelo e o histórico de conversas.

O contraponto é o desempenho. GPT-5 e modelos em nuvem similares são mais capazes do que a maioria dos modelos que você consegue rodar localmente. Se a prioridade é qualidade bruta de saída, a nuvem vence. Se privacidade ou acesso offline pesam mais, local vence.

Custo também entra na conta. O ChatGPT Plus tem mensalidade fixa. O Open WebUI é gratuito, mas você "paga" com hardware — uma máquina com RAM suficiente e, de preferência, uma GPU.

Open WebUI vs. Ollama CLI

A CLI do Ollama serve para testes rápidos, mas não foi feita para trabalho do dia a dia. Você digita um prompt, recebe uma resposta e pronto. Não há histórico, upload de arquivos, nem como comparar modelos sem trocar de terminal.

O Open WebUI dá ao Ollama uma interface de verdade. Modelos e backend são os mesmos — mas com gerenciamento de conversas, controles de configuração e uma UI que não some quando você fecha o terminal.

Se você já usa o Ollama, adicionar o Open WebUI por cima não custa nada e melhora muito a experiência.

Open WebUI vs. outras ferramentas

O LM Studio é um app desktop com um navegador de modelos embutido e uma interface de chat similar. É uma boa opção se você quer uma GUI autônoma sem Docker. A desvantagem é ficar preso ao desktop — o Open WebUI roda no navegador e pode ser acessado de outros dispositivos na sua rede.

O text-generation-webui é mais para power users. Suporta uma gama maior de formatos de modelo e tem controles mais detalhados, mas a configuração é mais trabalhosa e a interface é menos intuitiva. O Open WebUI é a melhor porta de entrada, a menos que você precise especificamente do que o text-generation-webui oferece.

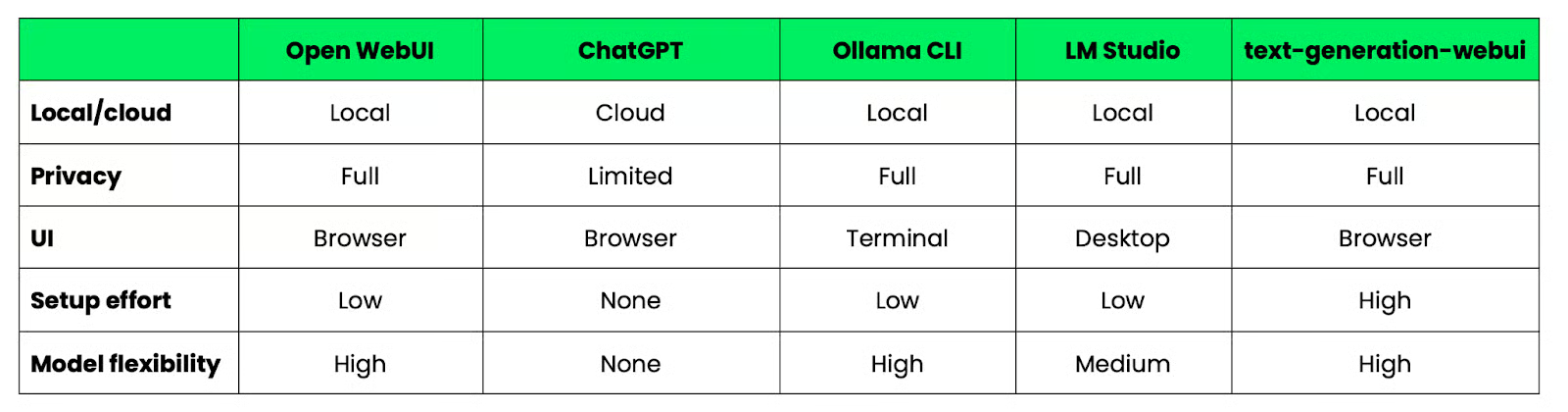

Tabela comparativa

Consulte esta tabela para uma comparação rápida entre o Open WebUI e suas alternativas:

Open WebUI versus alternativas

Problemas comuns e como resolver

A maioria dos problemas com o Open WebUI cai em cinco categorias — e quase sempre há uma correção rápida.

Container não inicia

Rode docker logs open-webui logo após a falha na inicialização. Os logs mostram o que deu errado. Em nove de cada dez casos é conflito de porta ou permissão do volume.

Conflitos de porta

Se a porta 3000 já estiver em uso na sua máquina, o container não vai subir. Resolva mapeando para outra porta no host:

docker run -d -p 3001:8080 ...Depois acesse o Open WebUI em http://localhost:3001.

Não conecta ao Ollama

Primeiro, confirme que o Ollama está rodando:

ollama serveDepois verifique a URL da API em Settings - Connections. No Mac e Windows, deve ser http://host.docker.internal:11434. No Linux, use o endereço IP da sua máquina host. Uma URL errada aqui é o motivo mais comum de falha na conexão.

Modelos não aparecem

Se o seletor de modelos estiver vazio, o Open WebUI conectou ao Ollama, mas não encontrou modelos. Rode ollama list para confirmar se você tem pelo menos um modelo baixado. Se a lista estiver vazia, faça o pull de um:

ollama pull mistralAtualize a página do Open WebUI após o pull — ela não atualiza automaticamente.

Desempenho lento

Respostas lentas quase sempre são questão de hardware, não do Open WebUI. O modelo é grande demais para sua RAM disponível ou você não tem GPU. Troque para um modelo menor — modelos de 7B parâmetros rodam razoavelmente bem na maioria das máquinas modernas com 16 GB de RAM. Em setups só com CPU, espere respostas mais lentas, independentemente do tamanho do modelo.

Boas práticas ao usar o Open WebUI

Alguns hábitos fazem muita diferença no desempenho do Open WebUI no dia a dia.

- Use modelos menores para ter velocidade: Modelos maiores nem sempre são melhores. Um modelo de 7B parâmetros responde em segundos e resolve bem a maioria das tarefas do dia a dia. Deixe os maiores para o que realmente precisa deles, como raciocínio complexo ou geração de textos longos

- Fique de olho no tamanho da conversa: Cada mensagem adiciona contexto que o modelo precisa processar. Conversas longas ficam mais lentas e mais caras de rodar. Se a conversa desviou muito do objetivo inicial, comece uma nova em vez de carregar o contexto antigo

- Organize seus prompts: Se você usa os mesmos prompts com frequência, salve-os. O Open WebUI permite guardar presets de prompt para não digitar as mesmas instruções toda vez. Um pouco de trabalho inicial economiza muito tempo depois

- Monitore os recursos do sistema: Modelos locais rodam no seu hardware. Se a máquina estiver sofrendo, abra um monitor do sistema e veja o uso de RAM e CPU. Rodar outros processos pesados junto com um modelo grande vai alongar os tempos de resposta. Feche o que não for necessário

- Combine o Open WebUI com suas ferramentas atuais: A interface é só a ponta. Você pode direcionar saídas para scripts, enviar arquivos direto do seu editor via upload ou usar o Open WebUI junto com o terminal para tarefas de código.

Quando usar o Open WebUI

O Open WebUI é ideal para situações específicas — não para todas. Veja quando ele se encaixa bem:

- Desenvolvimento local é o caso de uso mais comum. Se você está construindo um app sobre um LLM e quer testar prompts sem queimar créditos de API, o Open WebUI dá um ciclo de feedback rápido

- Experimentação com modelos é onde o Open WebUI brilha. Você pode baixar alguns modelos pelo Ollama e comparar como respondem ao mesmo prompt — tudo na mesma interface, sem escrever uma linha de código

- Fluxos de trabalho com privacidade também são um ótimo encaixe. Se você trabalha com documentos internos, dados de clientes ou qualquer coisa que prefere não enviar para terceiros, uma configuração local mantém tudo na sua máquina. Nenhum dado sai sem você escolher conectar uma API externa

- Aprendizado e prototipagem é outro ótimo cenário. Se você está começando com LLMs e quer entender o comportamento sem assinar um plano pago, o Open WebUI oferece uma forma de baixo custo para experimentar. Também é útil para protótipos rápidos — um modelo local é rápido o suficiente para testar ideias antes de investir em produção.

Dito isso, o Open WebUI não é a melhor ferramenta se você precisa da maior qualidade possível de saída e privacidade não é um problema. Uma API em nuvem vai te atender melhor.

Conclusão

O Open WebUI oferece uma interface limpa e prática para trabalhar com modelos locais — e você tem controle total do ambiente.

Nenhum dado sai da sua máquina, sem limites de taxa, sem assinatura. Você escolhe os modelos, ajusta as configurações e expande o setup do jeito que precisar.

A melhor forma de começar é mantendo a simplicidade. Suba o container no Docker, conecte um modelo pequeno como Llama ou Mistral e envie alguns prompts. Quando estiver funcionando, você pode adicionar mais modelos, configurar prompts de sistema, conectar APIs externas e evoluir a partir daí.

Ah, e se você estiver se perguntando, também dá para rodar o Ollama com Docker sem setup local. Veja nosso guia recente para aprender como.

FAQs

O que é o Open WebUI?

Open WebUI é uma interface auto-hospedada, acessada pelo navegador, para interagir com grandes modelos de linguagem. Funciona como o ChatGPT, mas roda inteiramente na sua máquina. Você o conecta a um backend de modelos — como o Ollama ou uma API compatível com OpenAI — e todos os seus dados permanecem locais.

Preciso de uma máquina potente para rodar o Open WebUI?

O Open WebUI em si é leve — o que demanda recursos é o modelo por trás dele. Para a maioria dos modelos locais, 16 GB de RAM é um bom ponto de partida. Uma GPU ajuda na velocidade de resposta, mas muitos modelos pequenos rodam de forma aceitável apenas com CPU.

O Open WebUI é gratuito?

Sim, o Open WebUI é open-source e gratuito. Você não paga pela interface. Os únicos custos são o seu próprio hardware e, opcionalmente, o uso de APIs externas se decidir conectar um provedor pago como a OpenAI.

Qual a diferença entre Open WebUI e Ollama?

O Ollama é o backend que baixa e executa modelos locais na sua máquina. O Open WebUI é o frontend — a interface para enviar prompts e ler respostas. O Ollama cuida do modelo; o Open WebUI, da experiência de chat. Você pode usar o Ollama sem o Open WebUI via CLI, mas a experiência é bem mais limitada.

Posso conectar o Open WebUI à API da OpenAI em vez de um modelo local?

Sim. O Open WebUI suporta qualquer endpoint de API compatível com OpenAI. Vá em Settings - Connections, adicione sua chave de API e a URL do endpoint, e os modelos em nuvem aparecerão no seletor ao lado dos locais. Assim, você alterna entre modelos locais e em nuvem na mesma interface.